- 1Hcip-datacom自学教程_hcip datacom

- 2python英文语义角色标注_八款中文词性标注工具使用及在线测试

- 3linux 下spark的下载安装及问题解决_spark下载安装很慢怎么办

- 42024年最新GitHub上Stars最多的10个Python项目_github stars

- 5【Langchain多Agent实践】一个有推销功能的旅游聊天机器人

- 6Apollo规划代码ros移植-EM planner

- 7用git下载hugging face上的大模型,以Qwen1.5-7B为例

- 82022年第三届MathorCup高校数学建模挑战赛——大数据竞赛 赛道B 北京移动用户体验影响因素研究 问题一建模方案及代码实现详解_mathorcup大数据竞赛优秀论文

- 9直播预告!正月初六,近屿智能带您学习AIGC大模型工程师和产品经理学习路径图与GPTstore全新视角!

- 102024年上半年系统架构设计师真题-复原程度90%

OpenAI势不可挡|GPT-4o带你走进科幻时代!

赞

踩

当地时间5月13日上午10点,OpenAI在春季发布会上发布了GPT-4的迭代版本——GPT-4o。据悉,GPT-4o的速度是上一代的两倍,并且对用户更友好:语音唤起、实时对话、无需注册、免费使用。OpenAI表示,GPT-4o及其文本和图像能力即日起将开始向API和用户推出,语音和视频能力即将推出。当各家科技公司还在追赶大模型多模态能力,把总结文本、P 图等功能放进手机里的时候,遥遥领先的 OpenAI 直接开了大招,发布的产品连自家 CEO 奥特曼都惊叹:就像电影里一样。

01 GPT-4o升级在哪?

1)融媒能力:GPT-4o同时具备文本、图片、视频、音频多方面的能力,即可以接受任何文本、音频等形式及其组合的输入,并生成同样媒介形式的回答。

2)速度更快:GPT-4o的速度是上一代的5倍,语音延迟大幅改善,可以在232毫秒内回应音频输入,平均为320毫秒,接近人类对话的反应时间。这意味用户可以和GPT-4o实时对话、甚至直接打视频让Ta在线解答各种问题。

3)免费开放:尽管“价格战”的风还是吹到了AI界,但OpenAI显然不买账——发布会即日起,GPT-4o将面向ChatGPT的所有付费和免费用户发布,取消其他所有限制,API价格降价50%。

正如发布会所说,GPT-4o中的“o”代表“omni”,意为全能,从目前功能更新看,得到全栈优化的全新GPT-4o真正成为了一款AI实时语音助手,性能远超Siri。

02 全能模型 GPT-4o

首先介绍的是 GPT-4o,o 代表 Omnimodel(全能模型)。第一次,OpenAI 在一个模型中集成了所有模态,大幅提升了大模型的实用性。OpenAI CTO Muri Murati 表示,GPT-4o 提供了「GPT-4 水准」的智能,但在 GPT-4 的基础上改进了文本、视觉和音频方面的能力,将在未来几周内「迭代式」地在公司产品中推出。「GPT-4o 的理由横跨语音、文本和视觉,」Muri Murati 说道:「我们知道这些模型越来越复杂,但我们希望交互体验变得更自然、更简单,让你完全不用关注用户界面,而只关注与 GPT 的协作。」GPT-4o 在英语文本和代码上的性能与 GPT-4 Turbo 的性能相匹配,但在非英语文本上的性能显著提高,同时 API 的速度也更快,成本降低了 50%。与现有模型相比,GPT-4o 在视觉和音频理解方面尤其出色。在 GPT-4o 上,OpenAI 跨文本、视觉和音频端到端地训练了一个新模型,这意味着所有输入和输出都由同一神经网络处理。GPT-4o 可以跨文本、音频和视频进行实时推理,这是向更自然的人机交互(甚至是人 - 机器 - 机器交互)迈出的重要一步。

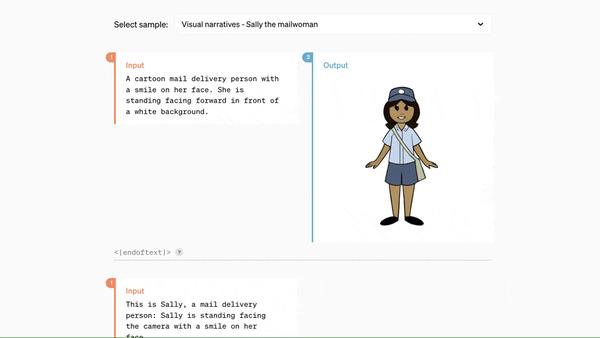

同时,GPT-4o 还拥有 3D 视觉内容生成的能力,能够从 6 个生成的图像进行 3D 重建:

这是一首诗,GPT-4o 可以将其排版为手写样式:

与 GPT-4o 合作,你只需要输入几段文字,就能得到一组连续的漫画分镜:

03 GPT-4o 性能评估结果

OpenAI 技术团队成员在 X 上表示,之前在 LMSYS Chatbot Arena 上引起广泛热议的神秘模型「im-also-a-good-gpt2-chatbot」就是 GPT-4o 的一个版本。

在比较困难的 prompt 集上 —— 特别是编码方面:GPT-4o 相比于 OpenAI 之前的最佳模型,性能提升幅度尤其显著。具体来说,在多项基准测试中,GPT-4o 在文本、推理和编码智能方面实现了 GPT-4 Turbo 级别的性能,同时在多语言、音频和视觉功能上实现了新高。

04 ChatGPT 用户将免费获得更多高级功能

每周都有超过一亿人使用 ChatGPT,OpenAI 表示 GPT-4o 的文本和图像功能今天开始免费在 ChatGPT 中推出,并向 Plus 用户提供高达 5 倍的消息上限。

现在打开 ChatGPT,我们发现 GPT-4o 已经可以使用了。

使用 GPT-4o 时,ChatGPT 免费用户现在可以访问以下功能:体验 GPT-4 级别智能;用户可以从模型和网络获取响应。此外,免费用户还可以有以下选择 ——分析数据并创建图表:

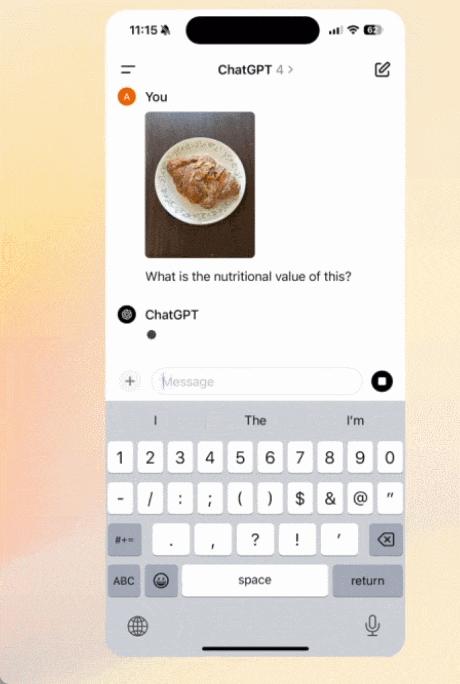

和拍摄的照片对话:

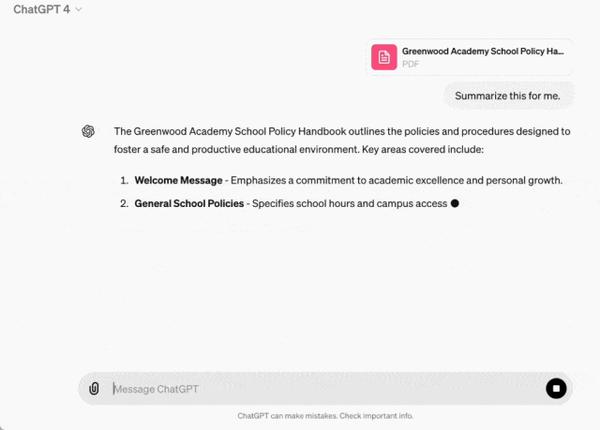

上传文件以获取总结、写作或分析方面的帮助:

发现并使用 GPTs 和 GPT 应用商店:

以及使用记忆功能打造更有帮助的体验。不过,根据使用情况和需求,免费用户可以使用 GPT-4o 发送的消息数量会受到限制。当达到限制时,ChatGPT 将自动切换到 GPT-3.5,以便用户可以继续对话。

此外,OpenAI 还将在未来几周内在 ChatGPT Plus 中推出新版本的语音模式 GPT-4o alpha,并通过 API 向一小部分值得信赖的合作伙伴推出对 GPT-4o 更多新的音频和视频功能。

当然了,通过多次的模型测试和迭代,GPT-4o 在所有模态下都存在一些局限性。在这些不完美的地方,OpenAI 表示正努力改进 GPT-4o。

可以想到的是, GPT-4o 音频模式的开放肯定会带来各种新的风险。在安全性问题上,GPT-4o 通过过滤训练数据和通过训练后细化模型行为等技术,在跨模态设计中内置了安全性。OpenAI 还创建了新的安全系统,为语音输出提供防护。

欢迎加入传神社区

•贡献代码,与我们一同共建更好的OpenCSG

•Github主页

欢迎 :https:// http://github.com/opencsg

•Huggingface主页

欢迎下载:https://huggingface.co/opencsg

•加入我们的用户交流群,分享经验

扫描上方二维码添加传神小助手

“ 关于OpenCSG

开放传神(OpenCSG)成立于2023年,是一家致力于大模型生态社区建设,汇集人工智能行业上下游企业链共同为大模型在垂直行业的应用提供解决方案和工具平台的公司。

关注OpenCSG

加入传神社区