- 1GitHub ssh key的配置_github ssh-rsa 格式

- 2单片机LED灯闪烁的简单代码_51单片机led灯闪烁代码

- 3Element plus的使用_laravel10 element plus

- 4git上传Stm32项目到gitee_stm32gitee

- 5大模型应用开发极简入门

- 6微信小程序wx.request如何进行post请求?_wx.request post

- 7读书笔记—1分钟和陌生人成为朋友

- 8PS解决取色器不能粘贴颜色码(重置取色器)_ps取色器怎么用不了

- 9简化开发插件Lombok使用_lombok.extern.slf4j.slf4j

- 10一键部署!QQ AI 聊天机器人!支持ChatGPT、文心一言、讯飞星火、Bing、Bard、ChatGLM、POE,多账号,人设调教

大地震!OpenAI灵魂人物Ilya官宣离职,Hinton关门弟子、ImageNet一战成名,马斯克曾为其与谷歌创始人决裂..._open ai 灵魂人物辞职

赞

踩

整理 | 王轶群

责编 | 唐小引

出品丨AI 科技大本营(ID:rgznai100)

“时隔近十年,我决定离开 OpenAl。”OpenAI联合创始人兼首席科学家 Ilya Sutskever,在谷歌 I/O 大会结束的仅几个小时候,官宣了离职的消息。

llya写道:“这家公司的发展轨迹堪称奇迹,在Sam Altman、Greg Brockman、Mira Murati 现在再加上 Jakub Pachocki 的卓越研究领导下,OpenAI将打造出既安全又有益的AGI。能与大家一起工作是我的荣幸,我会非常想念每一个人。再见,感谢你们所做的一切。我对接下来要做的事情感到兴奋,这是一个对我个人非常有意义的项目,我会在适当的时候分享细节。”

他还放上了一张OpenAI高层的合影,那是自去年11月OpenAI内乱风波后久违的同框。其中,左一就是接任 Ilya 成为新任 OpenAI 首席科学家的 Jakub Pachocki。此前 Jakub 担任 OpenAI 的研究总监,领导 GPT-4 和 OpenAI Five 的开发。

对此,Sam Altman 罕见地发布了一篇正式且深情的X长文:

“伊利亚和OpenAI要分道扬镳了。这让我很难过,伊利亚无疑是我们这一代最伟大的思想家之一,是我们这个领域的指路明灯,也是大家的挚友。他的才华和远见是众所周知的;他的温暖和同情心是不那么广为人知,但同样重要。

没有他,OpenAl就不会有今天。虽然他有一些对个人有意义的事情要去做,但我永远感激他在这里所做的一切,并致力于完成我们共同开创的使命。我很高兴能在这么长的时间里接近这样一个真正非凡的天才,一个如此专注于为人类创造最好未来的人。

雅各布将成为我们的新首席科学家。雅各布当然也是我们这一代最伟大的思想家之一,我很激动他在这里接过指挥棒。他曾负责我们许多最重要的项目,我非常有信心,他将带领我们朝着确保AGI造福每一个人的使命前行,并取得快速且安全的进展。”

在刚刚发布的最新旗舰模型 GPT-4o 主页上,Ilya 的名字出现在“额外领导者”处。这可能是他为OpenAI做出的最后一个技术贡献。

然而,Ilya所缔造的传奇远不止于此。这也许就是 Sam Altman 痛失良才的原因。

从小立志AGI,赫赫功绩,不止OpenAI联创

7岁自学编程、16岁将 AGI 设为人生目标,他是人工智能教父 Hinton 的关门弟子,在ImageNet一战成名。

Ilya 于 1986 年在俄罗斯下诺夫哥罗德出生,5 岁时搬到耶路撒冷生活,自幼对计算机产生浓厚兴趣, 7 岁开始自学编程。之后,在以色列开放大学学习了一段时间后,16 岁那年再次搬家去了加拿大,转而在多伦多大学读书,据说他在新家的第一件事就是去多伦多公共图书馆找一本关于机器学习的书。那时起,Ilya 对人工智能的热情日益加深,他决定将构建通用人工智能(AGI)设定为自己的主要目标。

在多伦多大学求学期间,Ilya 在2005年在多伦多大学获得数学理学学士学位,2007年获得数学理学硕士学位,2013年获得计算机科学博士学位。他的博士生导师是有着“人工智能教父”“深度学习之父”之称的 Geoffrey Hinton。

2003年,还在就读本科的 Ilya 每天都会敲 Hinton 的门,希望能被接纳进实验室。在读了几篇论文后,他在深度学习领域的思考与 Hinton 教授的思想发生了碰撞,引起了 Hinton 教授对 Ilya 独特之处的认识:他有能力发现那些其他人可能需要数年才能发现的东西。尽管当时正值人工智能领域的寒冬,研究者们对人工智能的兴趣有所下降,但 Hinton 教授依然决定接纳Ilya进入他的实验室。

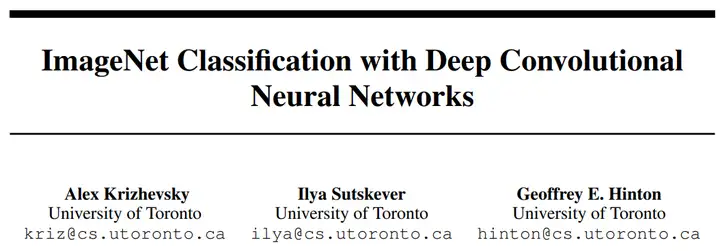

2012年,在被看作计算机视觉研究和人工智能进步的关键标志的ImageNet大赛上,Hinton带着他的两位学生 Ilya Sutskever 和 Alex Krizhevsky 在这次大赛中发明了AlexNet,后来被誉为“图像识别领域革命的开端”。他们摒弃了传统的手工设计解决方案,而是使用了深度神经网络并在 GPU 上训练它们。AlexNet 突破了75% 的准确度,远远超越了所有大厂竞争对手,展示了深度学习的巨大潜力。

Alex Krizhevsky、Ilya Sutskever、Geoffrey Hinton三人共同撰写的 AlexNet 论文引用量超6万次,成为计算机科学领域引用最多的论文之一。当时, Ilya 仅26岁。

这场竞赛后,三人共同创办了一家名为 DNNResearch 的公司。4个月后,该公司被谷歌在2013年3月以4400万美金收购了 DNNResearch。同时,谷歌聘请 Ilya 担任 Google Brain 的研究科学家。

在谷歌工作期间,Ilya 的愿景变得更加宏大,他开始坚信通用人工智能(AGI)近在咫尺。Ilya 参与了谷歌许多后来惊艳世人的工作,比如与 Demis Hassabis 和 David Silver 等人共事,参与 AlphaGo 的核心工作,共事的同事称 Ilya “是个无所畏惧的人”。

2014年 Ilya 发明了一种用于将英语翻译成法语的变体神经网络,提出的序列到序列学习方法捕捉输入的时序结构(如英语句子)并将其映射到具有时序结构的输出(如法语句子)。他的发明击败了表现最佳的翻译器,并促使谷歌翻译重大升级,让机器翻译领域从此焕然一新,引起了自然语言领域的研究新热潮。这背后依托的就是序列到序列学习(Sequence-to-Sequence Learning)算法,对后来Transformer 的诞生做出了重要贡献。

2015年的一天,Ilya 收到了一封来自 Sam Altman 的邀约。他赴约去与 Sam Altman、Greg Brockman 和 Elon Musk 等人共同讨论人工智能的未来。在这场聚会中,OpenAI 的创始理念首次被明确提出——“利用人工智能造福全人类,并以负责任的方式推动人工智能的发展”,这激发了所有参与者的期待和激情。

在马斯克等人的劝说下,经过深思熟虑,2015年底,Ilya 放弃了在谷歌数百万美元的工作机会,加入OpenAI,成为了联合创始人兼首席科学家。

Ilya被马斯克称为“OpenAI最艰难也最重要的招聘”的AI科学家。对此,马斯克不惜与谷歌创始人 Larry Page 决裂。马斯克在11月9日 Fridman 的播客中称,自己和谷歌创始人本可以修复的朋友关系,因为他把 Ilya 挖到了OpenAI,而彻底破裂。

马斯克说:“当时(谷歌DeepMind)Hassabis 在一边,我在另一边(都在争取Ilya)。这是我经历过的最艰难的招聘战之一,但这确实是 OpenAI 取得成功的关键。”马斯克还表示:“ Ilya Sutskever除了聪明之外,还是一个心地善良的好人(a good human—smart, good heart)。”

马斯克曾是OpenAI 的董事会成员,后在 2018 年因与特斯拉发生利益冲突而选择离开。正式由于早期马斯克等人决定向 OpenAI投入 10 亿美元,OpenAI 才能够聘用优秀AI人才。之后,OpenAI 获得微软投资的10 亿美元以及 Azure 云计算平台的使用权限。至此,OpenAI 就不再需要向谷歌支付算力租用费用,微软成为其重要合作伙伴。

OpenAI 首席科学家Ilya,宫斗后唯一留在董事会的核心成员

在微软的支持和 Ilya 等人的领导下,OpenAI 的研究人员在 2018 年创建了原始的 GPT 模型,一年后发布 GPT-2,这个新模型展示了大型语言模型的巨大潜力。与此同时,OpenAI 不再是一个非营利实体,开源作品越来越少,也引发了 AI 社区的不满。

争议存在下,OpenAI 仍取得了显著的研究成果。2020 年,OpenAI 发布GPT-3。GPT-3 的性能出色,却没有引起太多关注。为了让更多的人能够使用 GPT-3,Sam 说服了另外两位创始人,提出了用户友好界面的想法。2020 年 6 月,OpenAI 提出了新概念 Image GPT,旨在利用神经网络依据用户的文本指令生成新的高质量图片。

为实现上述想法,在 Ilya 的领导下,OpenAI 团队创造出了由AI驱动的图像生成模型 DALL-E ,采用与 GPT 模型类似的架构和训练过程,可以根据用户的文本输入生成各种风格的图像。DALL-E 的发展与设计过程对后来的模型(如 DALL-E 2 和 MidJourney)都具有指导作用,为推动多模态领域的研究创新奠定基础。

随后,OpenAI 的研究团队对 GPT-3 模型进一步改进,并将新模型命名为 GPT-3.5,采用了最简单的用户界面。由此,语言模型的不断发展促使了 ChatGPT 在 2022 年11月30日诞生,引领了生成式人工智能领域新浪潮。此后的版本 GPT-4,又将生成式人工智能的成就推向一个新高度,而如今发布的最新旗舰生成式 AI 模型 GPT-4o,更以无延迟视听语音、情绪感知交互等颠覆式创新,为人工智能的可能性带来无限遐想。

在GPT-4o发布前,Sam Altman 表示:“我们一直在努力开发一些我们认为人们会喜欢的新事物!对我来说感觉就像魔法一样。”

这个挥舞魔法棒的首席科学家,在宣布离职前,却有着惊人的人格定力。2023年底,OpenAI 高层宫斗大戏迎来终局,董事会中,Sam Altman 出局、 Greg Brockman 辞职,二人携手加入微软。当时的 OpenAI 董事会,只有首席科学家 Ilya Sutskever 还在任职。

而对于人工智能及AGI安全性的争论,正是OpenAI高层变天的导火索。Ilya 与 Altman 在如何快速商业化生成式人工智能产品,以及采取哪些步骤等问题上存在分歧。

2023年10 月,Ilya 在 MIT Technology Review 的采访中表示,他的新研究重点是如何防止超级人工智能的失控,尽管目前它还不存在。Ilya 说,ChatGPT 让人们看到了人工智能的可能性,尽管有时它返回的结果并不正确,让人们大失所望。

他最近的关注点放在了人工智能的潜在危险上,认为超级人工智能有可能在十年内出现。Ilya 所说的超级人工智能并不是仅仅能与人类匹敌的通用人工智能(AGI),它将比人类更聪明、更强大。

Ilya在采访中表示,任何人构建的超级智能都不能叛变,这一点非常重要。为此,Ilya想要的是引导人工智能系统与人们的预期目标或道德原则保持一致,而不是让它追求非预期目标。

2023年7月,Ilya 与同事 Jan Leike 撰写了一份 OpenAI 公告,涉及一个关于超级智能对齐的项目。公告警示道:虽然超级智能可以帮助解决世界上许多最重要的问题,但它也可能非常危险,并可能导致人类丧失权能,甚至导致人类灭绝。

在2023年上半年,基于同样的顾虑,Ilya 的导师,人工智能教父Hinton 离开了谷歌。Hinton 警告说,人工智能公司的军备竞赛正在给人类造成危险,如OpenAI 的 ChatGPT,我们很难防止坏人利用它做坏事。Hinton 在今年年初的牛津大学公开演讲上,也表达了类似的观点,声称百年后人工智能将产生巨变,比人类更聪明,从而对人类产生威胁。

可见,构建一个安全的 AGI 是多么重要。这也是 Ilya 与 Altman 在今天的发布的推文中反复提及的。安全,将成为人工智能领域接下来工作的重点之一。

超越不了,却可以学习很多

在过去的十多年里,Ilya 立足于人工智能变革的前沿,参与或主导的工作一度改变了计算机视觉领域、机器翻译甚至自然语言处理领域的研究进程,其每个阶段的成果都可能是我们一生也无法企及的高度。

超越不了,却可以从中学到很多。

立志实现 AGI 的 Ilya Sutskever 曾向另一位 AGI 孤勇者 John Carmack 推荐了一份精选的阅读清单,内含尖端的研究论文及资料,包括神经网络架构与理论、深度学习应用、机器学习模型优化与正则化、机器学习系统与算法、人工智能理论与哲学、计算复杂性与算法随机性等干货知识。

Ilya 认为,如果 Carmack 能够深入理解并吸收这些论文的精髓,这位传奇游戏开发者、火箭工程师和VR梦想家将掌握当今科技界最为关键的90%的知识。

同样的道理适用于致力于AI工作的每一个人,超越不了 Ilya,就在他推荐的干货知识里畅游吧!

以下为 Ilya 推荐的学习清单:

《循环神经网络的正则化》 (Recurrent Neural Network Regularization)

论文链接:https://arxiv.org/pdf/1409.2329

该论文提出了适用于长短期记忆网络(LSTM)的Dropout正则化技术,有效减少了过拟合问题,并在多种任务上提高了LSTM的性能。

《简化神经网络的权重信息最小化》 (Keeping Neural Networks Simple by Minimizing the Description Length of the Weights)

论文链接:https://www.cs.toronto.edu/~hinton/absps/colt93.pdf

该论文 探讨了通过最小化权重的描述长度来简化神经网络的方法,并通过引入噪声和调整噪声水平来优化网络的泛化能力。

《指针网络》 (Pointer Networks)

论文链接:https://arxiv.org/pdf/1506.03134

该论文介绍了指针网络,这是一种新型神经网络架构,能够学习输出序列中离散标记的条件概率,使用注意力机制作为指针选择输入序列中的成员作为输出。

《神经图灵机》 (Neural Turing Machines)

论文链接:https://arxiv.org/pdf/1410.5401

该论文介绍了神经图灵机(NTM)结合了神经网络和图灵机的计算模型,能够模拟图灵机的计算过程,并在某些任务上表现出优越的性能。

《关系循环神经网络》 (Relational-RNN: A Deep Curiosity-Driven Framework for Unsupervised Relational Learning)

论文链接:https://arxiv.org/pdf/1806.01822

该论文介绍了关系循环神经网络(Relational-RNN)是一种用于无监督关系学习的深度学习框架,利用好奇心驱动的方法来探索和学习数据中的潜在关系。

《基于深度卷积神经网络的ImageNet图像分类》 (ImageNet Classification with Deep Convolutional Neural Networks)

论文链接:

https://proceedings.neurips.cc/paper_files/paper/2012/file/c399862d3b9d6b76c8436e924a68c45b-Paper.pdf

该论文介绍了深度卷积神经网络在ImageNet图像分类任务上的应用,展示了深度学习进行大规模图像识别的潜力。

《深度残差学习用于图像识别》 (Deep Residual Learning for Image Recognition)

论文链接:https://arxiv.org/pdf/1512.03385

该论文提出了深度残差网络(ResNet),用于解决深度网络中的退化问题,在图像识别任务中取得了突破性的性能。

《通过扩张卷积实现多尺度上下文聚合》 (Atrous Convolution for Semantic Image Segmentation)

论文链接:https://arxiv.org/pdf/1511.07122

该论文介绍了扩张卷积(Atrous Convolution),用于图像分割任务中的多尺度上下文聚合,提高了图像分割的性能。

《深度语音2:端到端的英语和普通话语音识别》 (Deep Speech 2: End-to-End English and Mandarin Speech Recognition)

论文链接:https://arxiv.org/pdf/1512.02595

该论文介绍了深度语音2(Deep Speech 2),一种端到端的语音识别系统,能够识别英语和普通话,展示了深度学习在自动语音识别领域的应用。

《变分有损自编码器》 (Variational Disentangled Autoencoders)

论文链接:https://arxiv.org/pdf/1611.02731

该论文介绍了变分有损自编码器(VDAE),这是一种生成模型,能够学习数据的离散表示,在处理高维数据时表现出了良好的性能。

《GPipe: 利用微批次管道并行化大规模神经网络》 (GPipe: Easy Scaling with Micro-Batch Pipeline Parallelism)

论文链接:https://arxiv.org/pdf/1811.06965

该论文介绍了 GPipe,一个模型并行库,允许通过微批次管道并行化来扩展大型神经网络的容量,在图像分类和多语言机器翻译任务上展示了其应用。

《深度残差网络中的恒等映射》 (Identity Mappings in Deep Residual Networks)

论文链接:https://arxiv.org/pdf/1603.05027

该论文探讨了在深度残差网络中使用恒等映射的好处,尤其是在训练非常深的网络时,有助于梯度的流动,提高网络的训练效率。

《机器超级智能》 (Machine Super Intelligence)

文档链接:

https://www.vetta.org/documents/Machine_Super_Intelligence.pdf

该文档探讨了机器超级智能(MSI)的概念和潜在影响,讨论了人工智能发展的未来趋势和对社会的潜在影响。

《科尔莫哥洛夫复杂性与算法随机性》 (Kolmogorov Complexity and Algorithmic Randomness)

书籍链接:https://www.lirmm.fr/~ashen/kolmbook-eng-scan.pdf

该书籍介绍了 Kolmogorov 复杂性理论及其在算法随机性中的应用,提供了对计算复杂性和随机性深入理解的理论基础。

《用于视觉识别的 CS231n 卷积神经网络》 (Convolutional Neural Networks for Visual Recognition)

课程链接:https://cs231n.github.io/

CS231n是斯坦福大学的一门课程,专注于使用卷积神经网络进行视觉识别,提供了关于CNN架构、训练技巧和最新研究成果的全面介绍。

《量化封闭系统中复杂性的升降:咖啡自动机》 (Quantifying the Complexity of Closed Systems: A Coffee Automaton Example)

论文链接:https://arxiv.org/pdf/1405.6903

该论文探讨了如何量化封闭系统中的复杂性,以咖啡自动机为例进行了说明,研究了复杂性如何随时间增长和减少,并尝试找到潜在的规律。

《神经消息传递在量子化学中的应用》 (SchNet: A Continuous-filter Convolutional Neural Network for Modeling Quantum Interactions)

论文链接:https://arxiv.org/pdf/1704.01212

该论文提出了一种新型的神经网络架构,用于量子化学中的分子性质预测,神经消息传递(Neural Message Passing)提供了一种强大的框架来模拟量子相互作用。

《用于关系推理的简单神经网络模块》 (A Simple, Parameter-free Self-Attention Module for Neural Networks)

论文链接:https://arxiv.org/pdf/1706.01427

该论文提出了一种简单的、无需参数的自注意力模块,用于增强神经网络的关系推理能力,通过聚合来自不同位置的信息来提高网络的性能。

《最小描述长度原则介绍》 (Introduction to the Minimum Description Length Principle)

论文链接:https://arxiv.org/pdf/math/0406077

该论文提供了最小描述长度(MDL)原则的教程介绍,MDL是一种用于模型选择和数据压缩的原则。

结语

下一步 Ilya 会去哪?

在众多猜测中,“加入马斯克xAI”的说法充满戏剧性,也存在可能性。

此前,被 OpenAI 开除的 Pavel Izmailov 曾在 Ilya 手下工作过,目前已经加入xAI,正在研究 AI 推理以及在数学和科学方面的应用。

不管去哪,Ilya 无疑都将在人工智能领域为其理想继续施展才华。有朝一日,当AGI真正改变世界,Ilya 或将被誉为史上最重要的科学家之一。

参考链接:

https://zhuanlan.zhihu.com/p/669195800

https://baijiahao.baidu.com/s?id=1783103303280624047&wfr=spider&for=pc

https://mp.weixin.qq.com/s/dYWmM9qiAA5XzKouOFyUSg