热门标签

热门文章

- 1阿里最新大模型Qwen2-72B-Instruct 开源体验

- 220234116 实验一《Python程序设计》实验报告_python 程序设计课程实验报告

- 3CSS设计之页面滚动条出现时防止页面跳动的方法_css解决滚动条出现后元素mousemover事件闪动

- 4EpicDesigner编辑器的源码修改和扩展“数据库”进行数据库字段设置

- 53D Slicer - 医学图像检测标注教程(导入查看标签与修改标签)_3d slicer同时打开标注

- 6【头歌-Python】集合自学引导_本关任务:编写一个无参无返回值函数的小程序。相关知识为了完成本关任务,你需要掌

- 7pandas导出Excel表格,银行卡号、身份证号无法正常显示的问题,该怎么解决?...

- 8Github 配置 SSH key_github ssh设置

- 9集成学习【一】:集成学习(Ensemble Learning)结合神经网络_神经网络集成学习

- 10php+layui实现大型后台权限管理(RBAC)

当前位置: article > 正文

Interpretable Machine Learning中GLM,GAM等_glm与gam

作者:笔触狂放9 | 2024-06-15 15:40:39

赞

踩

glm与gam

关于GLM,GAM等的描述

线性回归模型的最大优势也是最大的弱点是预测被建模为特征的加权和。此外,线性模型还有许多其他假设。所有这些假设在实际中经常被违反的坏消息是给定特征的结果可能具有非高斯分布,特征可能相互作用,特征与结果之间的关系可能是非线性的。好消息是,统计界已经开发了各种修改,将线性回归模型从简单的刀片转换为瑞士刀。

如广义线性模型(GLM)和广义加法模型(GAM)可扩展线性模型。

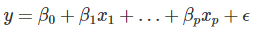

让记住线性回归模型的公式:

线性回归模型假设实例的结果y可以通过其p特征的加权和以及遵循高斯分布的单个误差ε来表示。 通过将数据强制转换为公式的紧身胸衣,我们获得了大量的模型可解释性。 特征效应是相加的,意味着没有相互作用,并且关系是线性的,意味着特征的增加可以直接转化为预测结果的增加/减少。 线性模型允许我们将特征和预期结果之间的关系压缩为单个数字,即估计的权重。

但是,对于许多现实世界的预测问题,简单的加权和过于严格。 在本章中,我们将了解经典线性回归模型的三个问题以及如何解决它们。 可能违反假设的问题还有很多,但我们将重点关注以下三个问题:

问题1:给定特征的目标结果y不遵循高斯分布。

示例:假设我想预测在给定的一天骑自行车的时间。作为特征我有一天的类型,天气等。如果我使用线性模型,它可以预测负分钟,因为它假定高斯分布不会在0分钟停止。此外,如果我想用线性模型预测概率,我可以得到负数或大于1的概率。

解决方案:广义线性模型(GLM)。

问题2:这些特征相

推荐阅读

相关标签