- 1Vue+SpringBoot打造知识图谱构建系统_vue知识图谱

- 2你真的了解大模型吗?从“Kimi崩了”说起_kimi本地部署

- 3小白必备——五个C语言小程序

- 4Ai绘画工具,Stable Diffusion提示词使用指南_ai反向提示词

- 59.30小记——2023年实习总结_北京航天研究院503所怎么样

- 6python中datatype是什么意思_python datatype notes

- 7浅谈管道模型(Pipeline)

- 8香橙派AIpro部署YOLOv5:探索强悍开发板的高效目标检测能力_香橙派 运行yolov5

- 9Odoo企业版问题解决有感_odoo企业版会被停用吗

- 1011张图了解HDFS的架构设计_hdfs、mpp、flink数据架构图

使用Llama3/Qwen2等开源大模型,部署团队私有化Code Copilot和使用教程_部署qwen2并训练

赞

踩

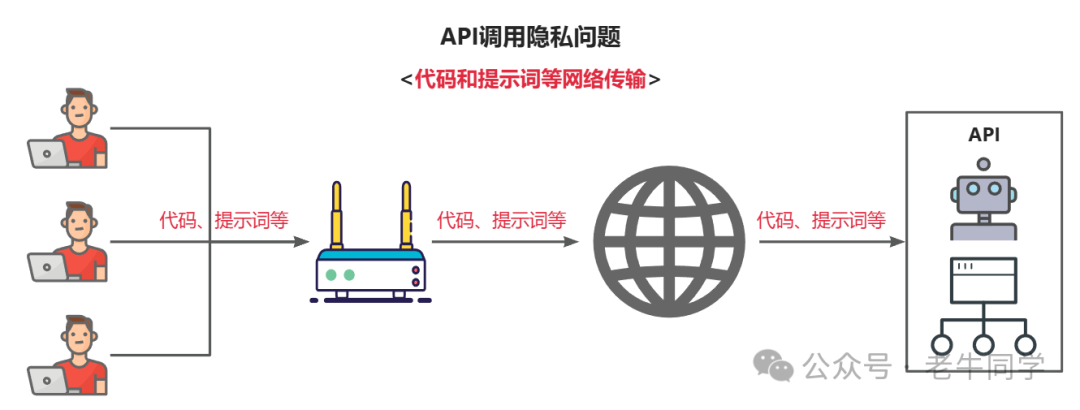

目前市面上有不少基于大模型的 Code Copilot 产品,部分产品对于个人开发者来说可免费使用,比如阿里的通义灵码、百度的文心快码等。这些免费的产品均通过 API 的方式提供服务,因此调用时均必须联网、同时需要把代码、提示词等内容作为 API 的入参在网络中传输和 API 服务器中进行处理,这里就涉及到一个比较重要的问题:隐私安全

Code Copilot的公网API调用

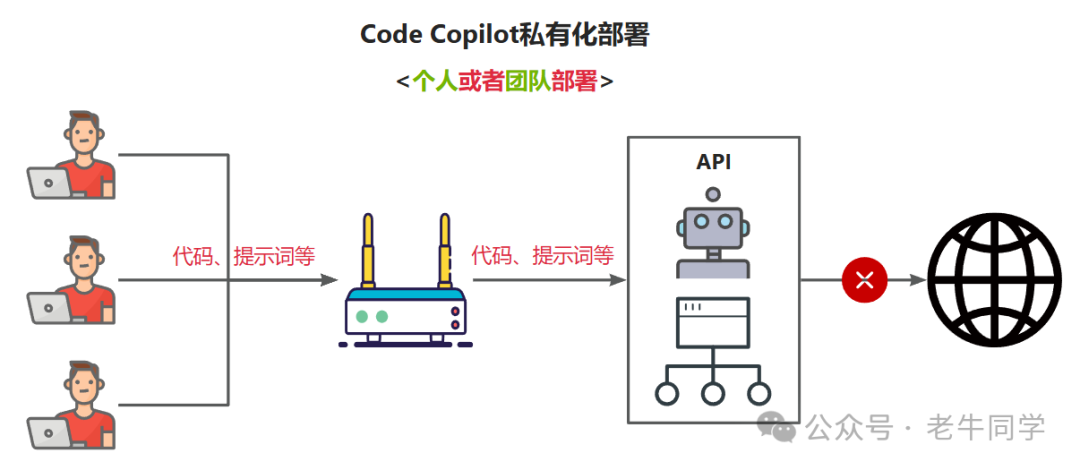

针对小团队私有保密项目、创新团队孵化新产品,隐私安全问题就显得格外重要。因此,团队内部部署私有的Code Copilot方案就应运而出了:

Code Copilot的内部API服务

今天老牛同学和大家一起来使用Qwen2-7构建个人或者团队专属的私有化 Code Copilot,除了代码生成之外,还可以是支持 AI 问答、代码解释、语言转换、生成单元测试用例等功能。不但可以提高我们的研发效率,还可以保护我们的代码隐私。

第一步:部署私有的大模型(Qwen2-7B)

前面老牛同学介绍了本地部署大模型和使用教程,包括Llama3-8B、Qwen2-7B、GLM4-9B、和Phi3等。大家可以看一下之前的部署教程,老牛同学今天使用Qwen2-7B作为我们 Copilot 底层大模型,对于本文Code Copilot的部署和使用,其他大模型都是一样的,看大家的喜好,没有特殊要求。

老牛同学这里简单列一下部署教程:

环境安装: 主要是Miniconda包管理安装,参见教程,注意只需要安装Miniconda和Python即可,其他非必须:大模型应用研发基础环境配置(Miniconda、Python、Jupyter Lab、Ollama 等):https://mp.weixin.qq.com/s/P_ufvz4MWVSqv_VM-rJp9w

Code Copilot底层大模型的部署方式,老牛同学验证主要以下 2 种,任选一种即可:

方式一 基于 Ollama 部署:

-

下载并安装Ollama本地模型管理软件(Windows/Mac/Linux 均支持):https://ollama.com/download

-

通过 Ollama 下载并启动大模型:

ollama run qwen2:7b

通过以上 2 步,即完成了大模型的部署。特别注意的是:GLM系列大模型还不支持 Ollama 管理!因此如果你希望用 GLM 系列(如:GLM4-9B)大模型,那么请看方式二。

方式二 通过 Python 部署:通用方法,所有模型都支持,以下是老牛同学验证过的部署教程

-

Phi3:Phi-3 模型手机部署教程(微软发布的可与 GPT-3.5 媲美的小模型)

-

Qwen2-7B:Qwen2 阿里最强开源大模型(Qwen2-7B)本地部署、API 调用和 WebUI 对话机器人

-

Llama3-8B:玩转 AI,笔记本电脑安装属于自己的 Llama 3 8B 大模型和对话客户端

-

GLM4-9B:本地部署 GLM-4-9B 清华智谱开源大模型方法和对话效果体验

第二步:IDE 安装和配置 Continue 插件

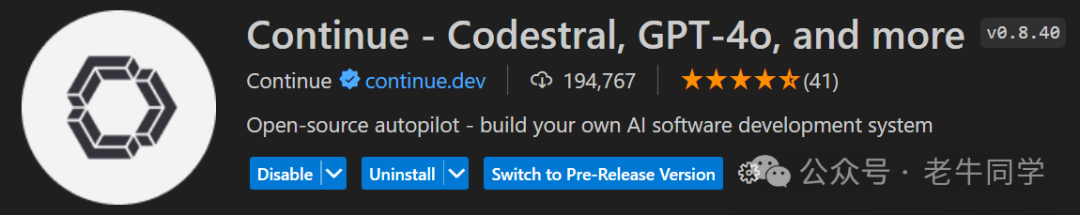

Code Copilot Continue是目前最受欢迎的插件之一,它插件的形式使用,目前支持VS Code和JetBrains 全家桶这 2 个主流 IDE 的扩展,可以在对应的插件市场中直接搜索Continue下载安装。Continue插件的一个最大优势在于它可以指定连接本地或者局域网内的大模型,所以对于信息安全高的项目,我们完全可以在本地或者局域网内部署大模型,然后用Continue插件连接使用,在提高开发生产效率同时保护了研发代码的隐私。目前Continue插件的社区活跃,GitHub 仓库已达12K星,插件版本更新频繁,越来越成熟。

因为老牛同学日常使用VS Code较多,因此下面的安装和配置,基于VS Code完成,JetBrains(如:PyCharm 等)的方式类同。

安装 Continue 插件: 插件管理器中,搜索Continue,点击安装,安装成功之后重启 IDE 即可。

安装Continue插件

Continue 插件状态: 安装成功并重启之后,可以看到VS Code的左侧多了一个Continue按钮。同时,右下角也多了一个Continue状态图标:√ Continue则代表Continue在 IDE 中生效了,

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。