热门标签

热门文章

- 1.Net-using-Class:MemoryCache 类

- 2PYTORCH 依赖 cuda 11.8 , cuda 12.1 cpu 里 torch torchvision torchaudio对应关系_stable diffusion cuda 12.1和cuda 11.8

- 3——黑马程序员——C语言中二维数组、字符数组和字符串_二维数组的结束字符

- 42024-03-26 AIGC-大模型学习路线

- 5@@VMWARE@@ UTS_RELEASE

- 6神器来袭,手把手教你使用 Milvus_cli

- 7区块链搭建eos开发环境_eos swap

- 8【pytorch-常见问题】numpy:DLL load failed while importing _multiarray_umath: 找不到指定的模块。_numpy: dll load failed while importing _common: 找不

- 9VNC:虚拟网络计算技术及在VMware中开启VNC连接教程_vncviewer怎么连接vmware的linux

- 10基于python的网络爬虫爬取天气数据及可视化分析(Matplotlib、sk-learn等,包括ppt,视频)_csdn 天气预报分析论文

当前位置: article > 正文

生成式预训练语言模型能否视作闭卷问答的知识库?_closed book qa

作者:花生_TL007 | 2024-04-03 05:14:42

赞

踩

closed book qa

©原创作者 | 朱林

论文解读:

Can Generative Pre-trained Language Models Serve as Knowledge Bases for Closed-book QA?

论文作者:

Cunxiang Wang, Pai Liu, Yue Zhang

论文地址:

https://aclanthology.org/2021.acl-long.251.pdf

收录会议:

ACL2021

代码和数据集:

https://github.com/wangcunxiang/Can_PLM_Server_as_KB

01 背景

图1 预训练语言模型

BERT、GPT等大型预训练语言模型(Pre-trained Language Model, PLM)显著提高了各种自然语言处理(NLP)任务的性能。

越来越多的证据表明PLM中蕴含着大千世界丰富的知识,故最新的实验研究着重探究“LM as KB”的范式,即直接生成语言模型作为知识库(Knowledge Base, KB)来解决问题。

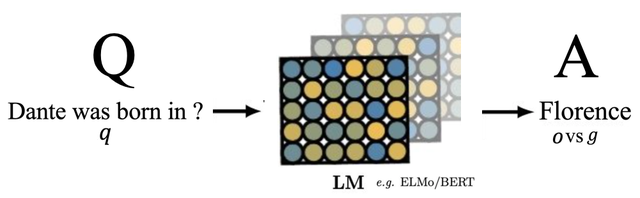

图2 LM直接完成闭卷问答任务

本文探讨的就是是否可以用PLM作为KB来完成闭卷问答(Closed-book QA)任务。该任务是一项极具挑战性的任务,它需要一个模型能直接回答问题,而无需访问外部知识。

形式上如图2所示,输入问题q,输出词序列o,同时将正确答案g与输出结果o进行比较来评估模型准确性。

02 问题

由于PLM天然可以存储和使用知识,所以它们可以在闭卷问答任务中实现较高的性能。然而,现有的研究留下了许多悬而未决的问题,比如:

(1) PLM在闭卷问答任务上到底有多少潜力?比如:用于训练的数据集仅包含了标准问答对数据集,是否可以通过其他语料数据来训练?

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/花生_TL007/article/detail/354487

推荐阅读

相关标签