热门标签

热门文章

- 1DockerUI如何部署结合内网穿透实现公网环境管理本地docker容器_docker ui

- 2Machine Learning Engineering Case Studies with Python notebook

- 3无监督学习的主流算法及其优缺点

- 42024年鸿蒙最全鸿蒙HarmonyOS应用开发-自定义实现验证码框_鸿蒙开发字母验证码,2024年最新到了三面试成功率高吗_鸿蒙textinput隐藏光标

- 5数据结构——树(二叉树)的基础知识 & 堆 & 堆排序 & 时间复杂度讲解 & topk问题(详解)_二叉堆新增节点的时间复杂度

- 6国内大语言模型的相对比较:ChatGLM2-6B、BAICHUAN2-7B、通义千问-6B、ChatGPT3.5_atom-7b-chat和chatglm哪个性能好一点

- 7聆思CSK6大模型开发板视觉识别类开源SDK介绍_csk6 目标检测

- 8android自定义view_android 自定义view

- 9ad电阻原理图_105篇DIY开源资料汇总分享:原理图/PCB图/源码/BOM表/相关资料文档等...

- 10粒子群算法(Python代码实例)_假设有一个粒子群算法应用于解决优化问题,初始时有20个粒子,搜索空间是二维平面。

当前位置: article > 正文

基于ollama搭建本地chatGPT_ollama本地地址

作者:花生_TL007 | 2024-06-15 14:32:28

赞

踩

ollama本地地址

ollama帮助我们可以快速在本地运行一个大模型,再整合一个可视化页面就能构建一个chatGPT,可视化页面我选择了chat-ollama(因为它还能支持知识库,可玩性更高),如果只是为了聊天更推荐chatbox

部署步骤

- 下载ollama并启动,参考:https://ollama.com/download

# 启动命令

ollama serve

- 1

- 2

- 下载chat-ollama,参考:https://github.com/sugarforever/chat-ollama。本人使用docker安装的

docker compose up

# 如果您是第一次启动,需要初始化 SQLite 数据库,在新的控制台运行

docker-compose exec chatollama npx prisma migrate dev

- 1

- 2

- 3

- 访问chat-ollama,网址:http://localhost:3000

- 配置ollama地址

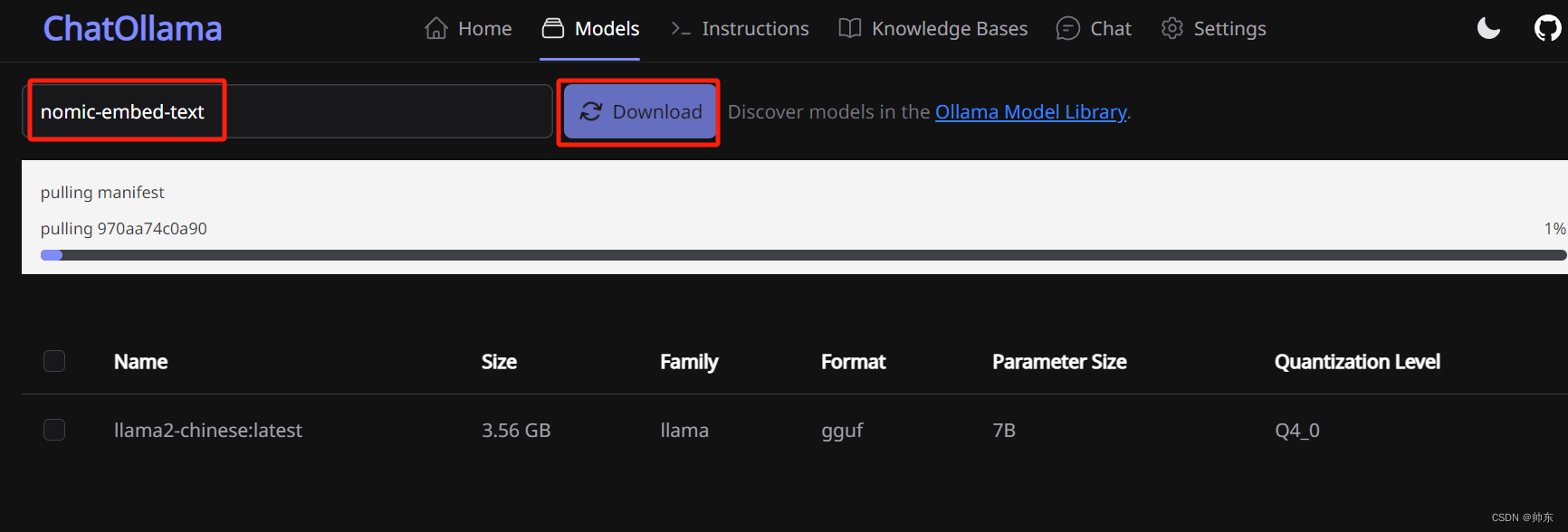

- 点击models,下载模型llama2-chinese。因为Llama 2 本身的中文比较弱。

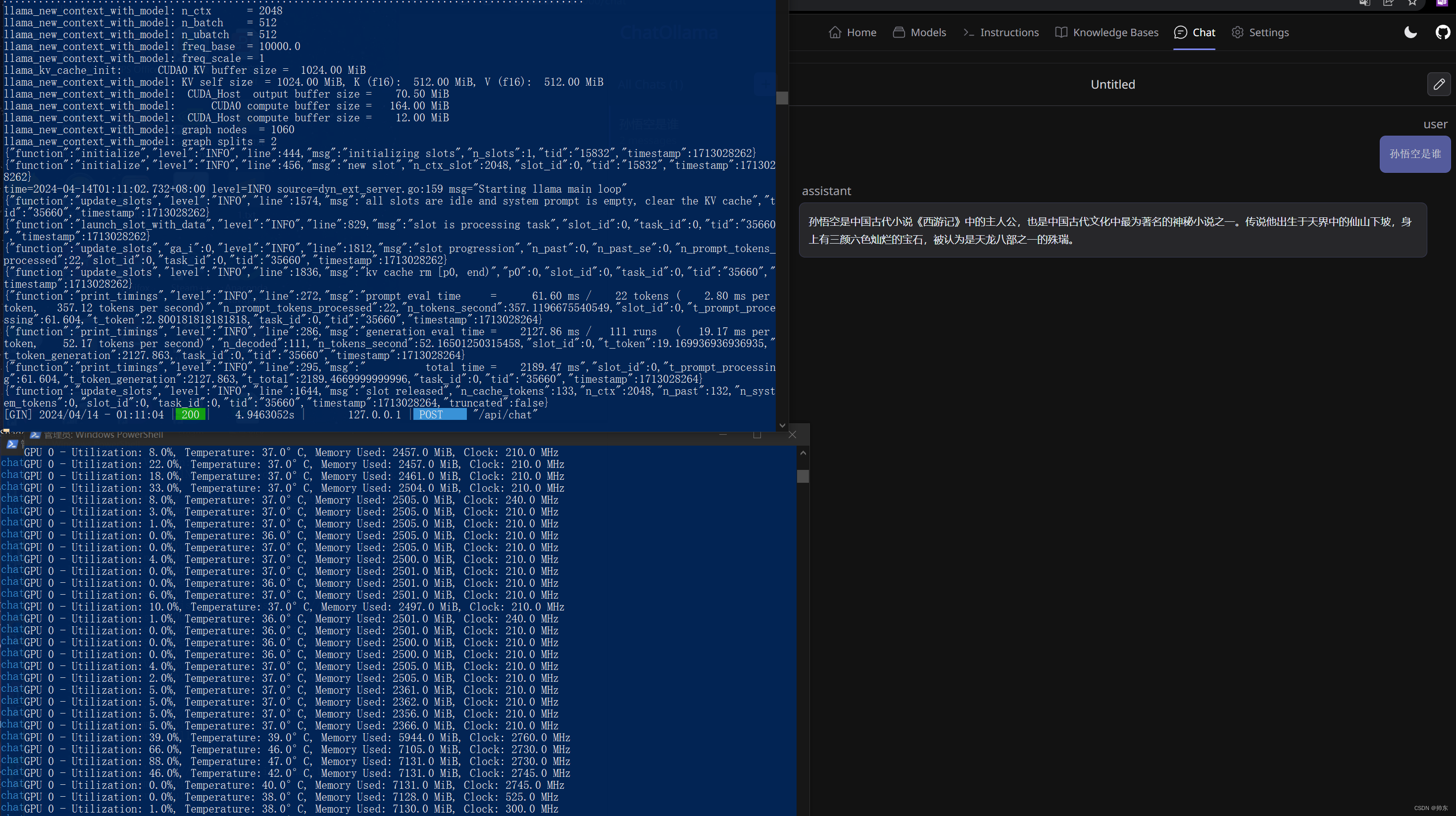

- 开始聊天

注意

llama2-chinese模型最少要8G内存

- 7b models generally require at least 8GB of RAM

- 13b models generally require at least 16GB of RAM

CPU跑的太慢,用GPU的话也要差不多8G显存

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/花生_TL007/article/detail/722675

推荐阅读

相关标签