热门标签

热门文章

- 1【AI的未来 - AI Agent系列】【MetaGPT】6. 用ActionNode重写技术文档助手

- 2LLM的理论古往今来(持续更新ing...)_domain specialization as the key to make large lan

- 3git 切换远程地址分支 推送到指定地址分支 版本回退_git 切换远程仓库

- 4使用Angular-cli搭建Angular开发环境_angular inlinestyle

- 5华为lab-rs-v1-1.2_链路聚合

- 6最新PyCharm安装详细教程及pycharm配置_pycharm安装教程_pycharm最新版本安装教程及首次使用说明

- 7NLP工具最新版Spacy及语言包en_core_web_sm下载安装指南_spacy下载

- 8代码随想录-二分查找题目分析

- 93月全国计算机等级考试报名时间,2022年3月计算机等级考试报名时间及考试时间通知_2022年3月份计算机二级是那版

- 10MySQL-第七讲:数据库编程_mysql编程

当前位置: article > 正文

M2 Mac mini跑Llama3

作者:菜鸟追梦旅行 | 2024-05-04 07:32:36

赞

踩

M2 Mac mini跑Llama3

前言

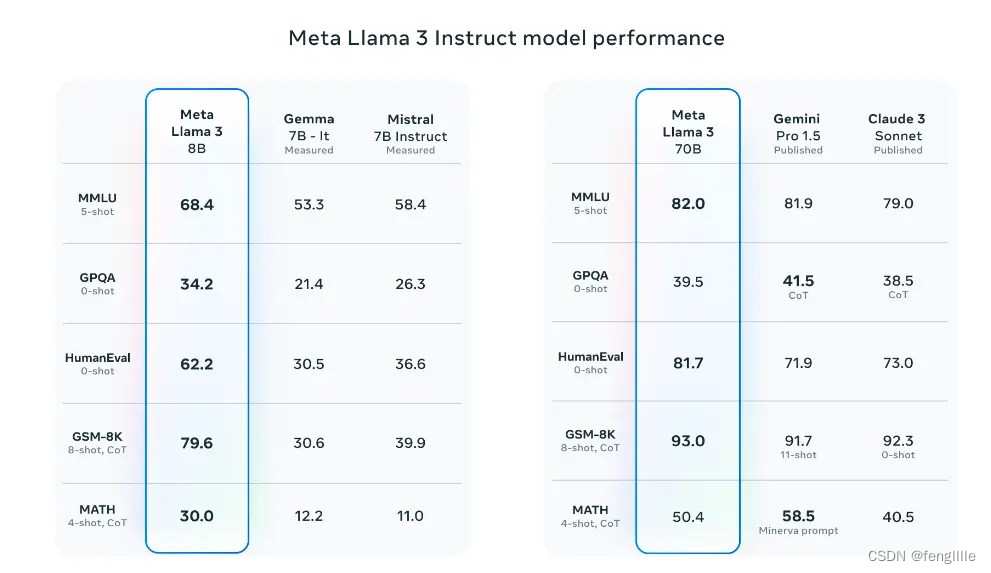

在4-19左右,Meta 宣布正式推出下一代开源大语言模型 Llama 3;共包括 80 亿和 700 亿参数两种版本,号称 “是 Llama 2 的重大飞跃”,并为这些规模的 LLM 确立了新的标准。实际上笔者早就体验过,只不过自己电脑没什么显卡(核显),所以一直没跑llama,但是最近听说m2芯片可以运行,就体验了一下。

看图表8B的数据可以在本地运行,70B就不用想了。试了一下真的可行。

使用Ollama

ollama:Get up and running with large language models.实际上就是封装已经训练的模型数据,提供运行程序

分为ollama的安装,拉取模型数据,运行模型

安装很简单:Download Ollama on macOS

mac直接解压app,放在applications下,运行后点击install,输入密码即可,实际上是安装ollama指令。

模型文件:https://ollama.com/library

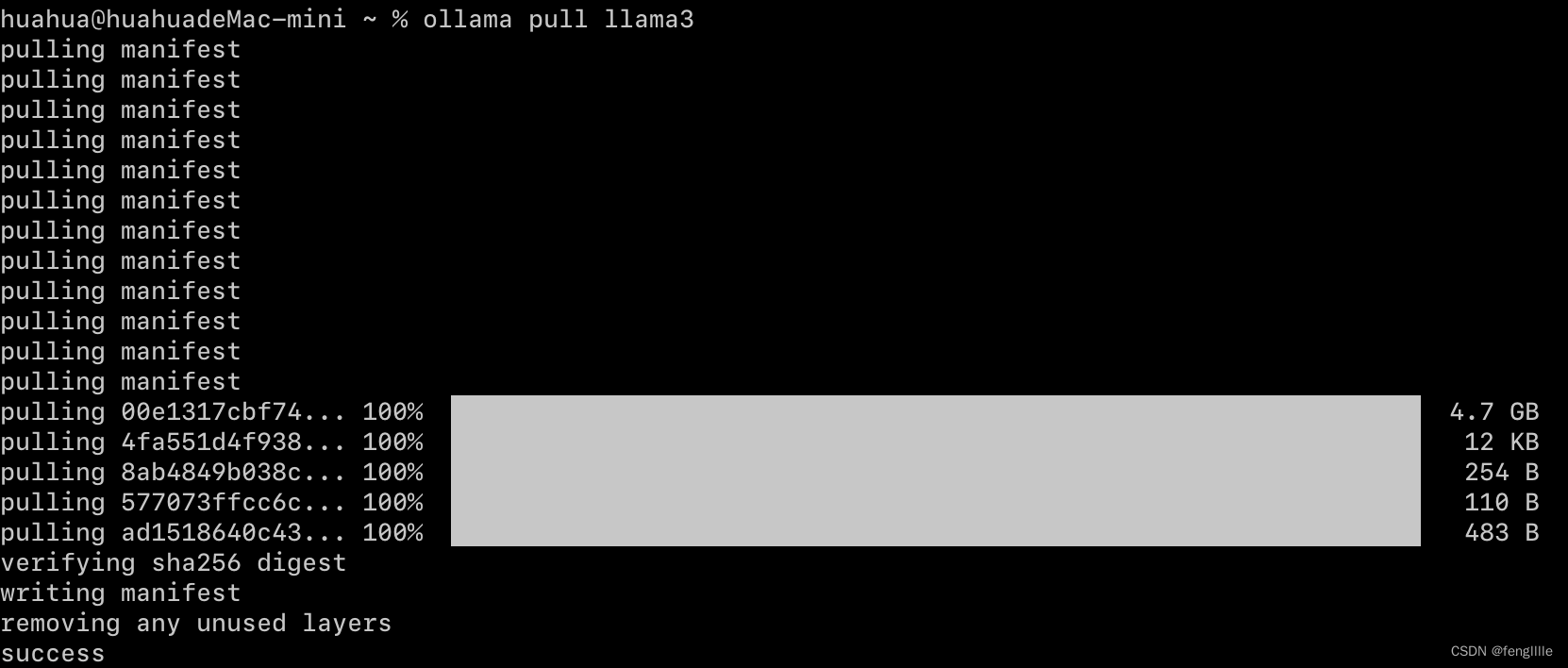

ollama pull llama3

根据电脑的配置情况,默认llama即8B模型,如果要运行70B:ollama run llama3:70b,估计需要64G内存,没这么大的,所以只跑了8B

然后执行run,有点docker的设计思想

ollama run llama3

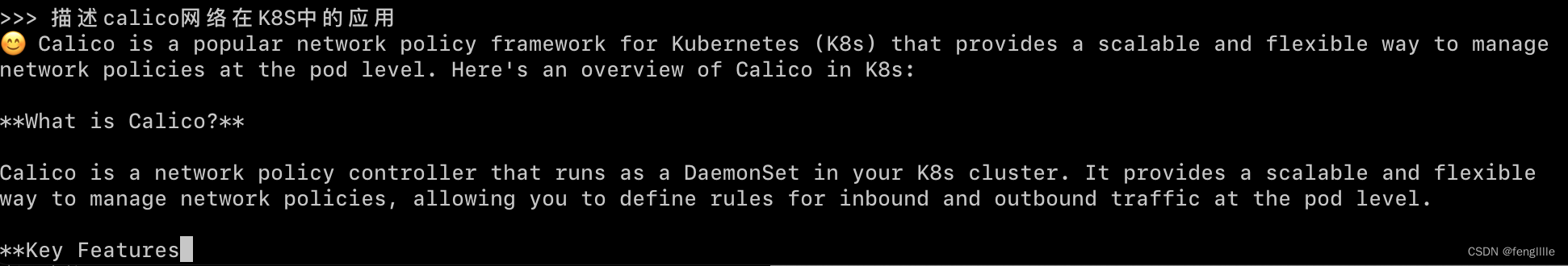

基本上问答是英文,训练的语料估计主要是国外的,毕竟meta开源

总结

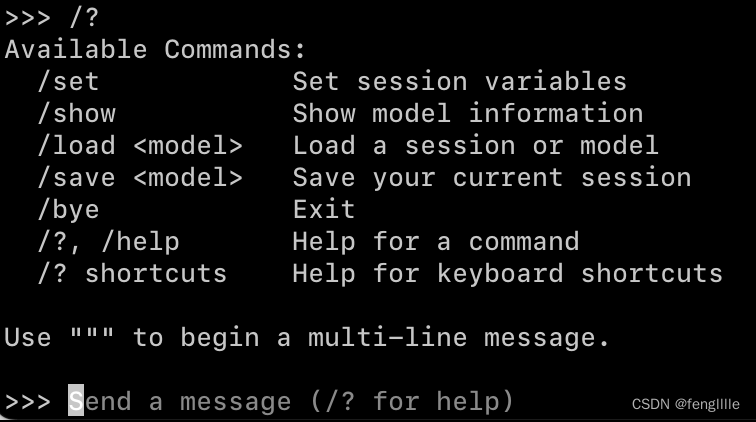

实际上就是本地体验一下,如果要调模型还是相对难一些,体验发现llama3主要是英文答复,不过8B模型在mac mini运行还是很快的,另外可以根据提示做一些Ollama的指令,关键的是load model和save model,可以载入和存储模型。

![]()

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/菜鸟追梦旅行/article/detail/533386

推荐阅读

相关标签