- 1在美团,我从暑期实习到转正

- 2python胶水语言?Python的简介及下载安装_python 胶水语言

- 3深圳 Community Day 活动剧透!惊喜彩蛋等你发现!

- 4Docker 容器镜像删除命令_docker用什么命令删除容器

- 5【愚公系列】2024年03月 《AI智能化办公:ChatGPT使用方法与技巧从入门到精通》 011-用 ChatGPT 生成文章(文章的生成策略)

- 6使用LangSmith来快速学习LangChain_langsmith 邀请码

- 7Mysql- 流程函数-(If, CASE WHEN)的使用及练习_mysql if函数的使用

- 8写一个程序,分析一个文本文件(英文文章)中各个单词出现的频率,并且把频率最高的10词打印出来_编写程序,统计输入英文文章中不同单词出现的次数,并输入出现频率最高的单词。

- 9顺序表、栈(stack)、队列(queue)(Python实现)_基于列表实现stack类、queue类、priorityqueue类python

- 10使用Python 机器学习-5-Python Mini Project–使用深度学习进行乳腺癌分类

昇思25天学习打卡营第1天|基本介绍与快速入门

赞

踩

目录

基本介绍

昇思MindSpore是一个全场景深度学习框架,旨在实现易开发、高效执行、全场景统一部署三大目标。

其中,易开发表现为API友好、调试难度低;高效执行包括计算效率、数据预处理效率和分布式训练效率;全场景则指框架同时支持云、边缘以及端侧场景。

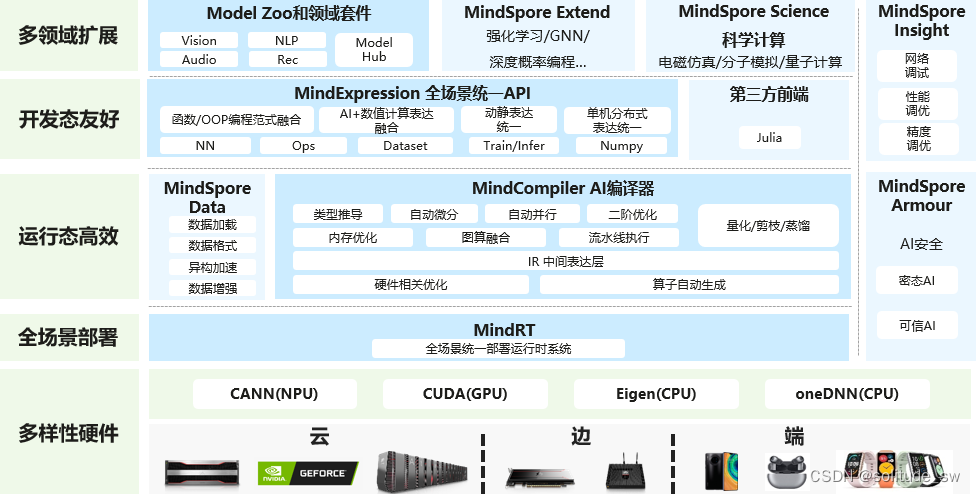

昇思MindSpore总体架构如下图所示:

执行流程

有了对昇思MindSpore总体架构的了解后,我们可以看看各个模块之间的整体配合关系,具体如图所示:

昇思MindSpore作为全场景AI框架,所支持的有端(手机与IOT设备)、边(基站与路由设备)、云(服务器)场景的不同系列硬件,包括昇腾系列产品、英伟达NVIDIA系列产品、Arm系列的高通骁龙、华为麒麟的芯片等系列产品。

左边蓝色方框的是MindSpore主体框架,主要提供神经网络在训练、验证过程中相关的基础API功能,另外还会默认提供自动微分、自动并行等功能。

蓝色方框往下是MindSpore Data模块,可以利用该模块进行数据预处理,包括数据采样、数据迭代、数据格式转换等不同的数据操作。在训练的过程会遇到很多调试调优的问题,因此有MindSpore Insight模块对loss曲线、算子执行情况、权重参数变量等调试调优相关的数据进行可视化,方便用户在训练过程中进行调试调优。

AI安全最简单的场景就是从攻防的视角来看,例如,攻击者在训练阶段掺入恶意数据,影响AI模型推理能力,于是MindSpore推出了MindSpore Armour模块,为MindSpore提供AI安全机制。

蓝色方框往上的内容跟算法开发相关的用户更加贴近,包括存放大量的AI算法模型库ModelZoo,提供面向不同领域的开发工具套件MindSpore DevKit,另外还有高阶拓展库MindSpore Extend,这里面值得一提的就是MindSpore Extend中的科学计算套件MindSciences,MindSpore首次探索将科学计算与深度学习结合,将数值计算与深度学习相结合,通过深度学习来支持电磁仿真、药物分子仿真等等。

神经网络模型训练完后,可以导出模型或者加载存放在MindSpore Hub中已经训练好的模型。接着有MindIR提供端云统一的IR格式,通过统一IR定义了网络的逻辑结构和算子的属性,将MindIR格式的模型文件 与硬件平台解耦,实现一次训练多次部署。因此如图所示,通过IR把模型导出到不同的模块执行推理。

设计理念

支持全场景统一部署

提供Python编程范式,简化AI编程

提供动态图和静态图统一的编码方式

采用AI和科学计算融合编程,使用户聚焦于模型算法的数学原生表达

分布式训练原生

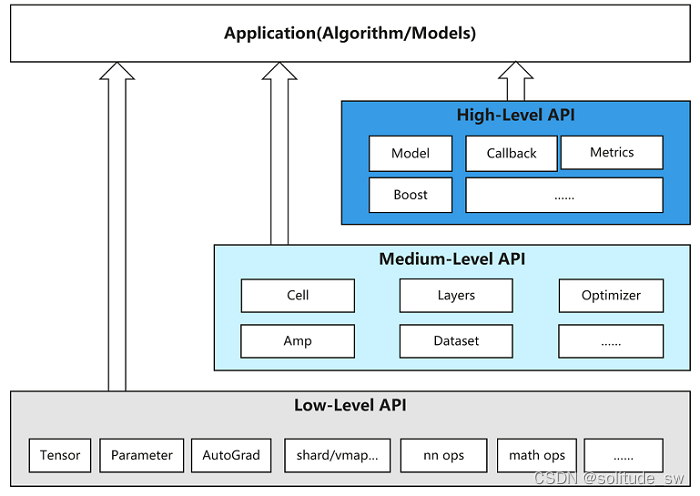

层次结构

昇思MindSpore向用户提供了3个不同层次的API,支撑用户进行AI应用(算法/模型)开发,从高到低分别为High-Level Python API、Medium-Level Python API以及Low-Level Python API。高阶API提供了更好的封装性,低阶API提供更好的灵活性,中阶API兼顾灵活及封装,满足不同领域和层次的开发者需求。

High-Level Python API

第一层为高阶API,其在中阶API的基础上又提供了训练推理的管理、混合精度训练、调试调优等高级接口,方便用户控制整网的执行流程和实现神经网络的训练推理及调优。例如用户使用Model接口,指定要训练的神经网络模型和相关的训练设置,对神经网络模型进行训练。

Medium-Level Python API

第二层为中阶API,其封装了低阶API,提供网络层、优化器、损失函数等模块,用户可通过中阶API灵活构建神经网络和控制执行流程,快速实现模型算法逻辑。例如用户可调用Cell接口构建神经网络模型和计算逻辑,通过使用Loss模块和Optimizer接口为神经网络模型添加损失函数和优化方式,利用Dataset模块对数据进行处理以供模型的训练和推导使用。

Low-Level Python API

第三层为低阶API,主要包括张量定义、基础算子、自动微分等模块,用户可使用低阶API轻松实现张量定义和求导计算。例如用户可通过Tensor接口自定义张量,使用grad接口计算函数在指定处的导数。

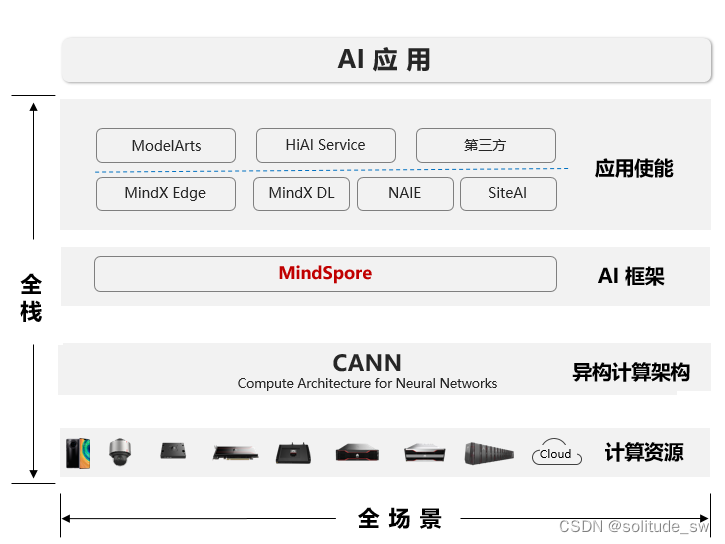

华为昇腾AI全栈介绍

昇腾计算,是基于昇腾系列处理器构建的全栈AI计算基础设施及应用,包括昇腾Ascend系列芯片、Atlas系列硬件、CANN芯片使能、MindSpore AI框架、ModelArts、MindX应用使能等。

华为Atlas人工智能计算解决方案,是基于昇腾系列AI处理器,通过模块、板卡、小站、服务器、集群等丰富的产品形态,打造面向“端、边、云”的全场景AI基础设施方案,涵盖数据中心解决方案、智能边缘解决方案,覆盖深度学习领域推理和训练全流程。

昇腾AI全栈如下图所示:

下面简单介绍每个模块的作用:

- 昇腾应用使能:华为各大产品线基于MindSpore提供的AI平台或服务能力

- MindSpore:支持端、边、云独立的和协同的统一训练和推理框架

- CANN:昇腾芯片使能、驱动层(了解更多)。

- 计算资源:昇腾系列化IP、芯片和服务器

快速入门

- import mindspore

- from mindspore import nn

- from mindspore.dataset import vision, transforms

- from mindspore.dataset import MnistDataset

处理数据集¶

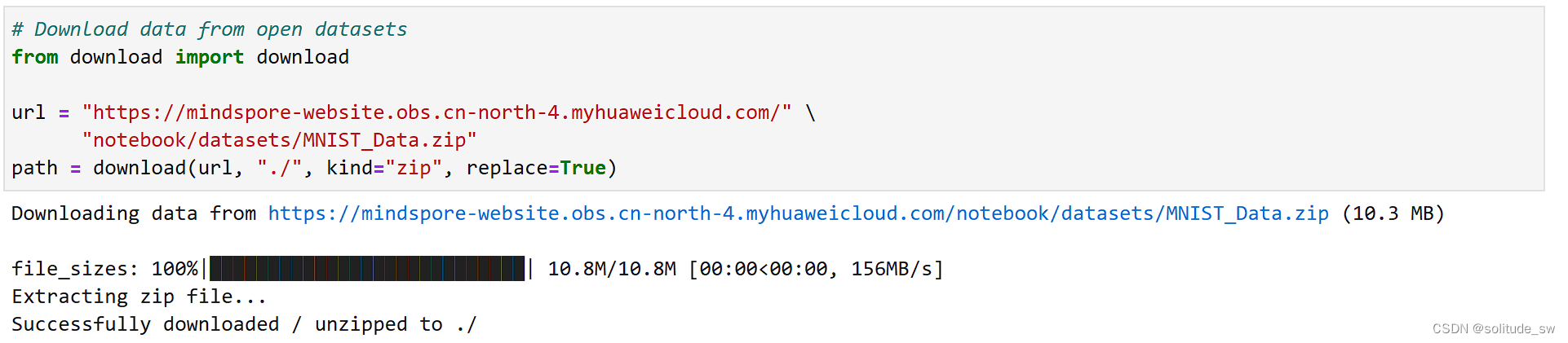

MindSpore提供基于Pipeline的数据引擎,通过数据集(Dataset)和数据变换(Transforms)实现高效的数据预处理。在本教程中,我们使用Mnist数据集,自动下载完成后,使用mindspore.dataset提供的数据变换进行预处理。

- from download import download

-

- url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \

- "notebook/datasets/MNIST_Data.zip"

- path = download(url, "./", kind="zip", replace=True)

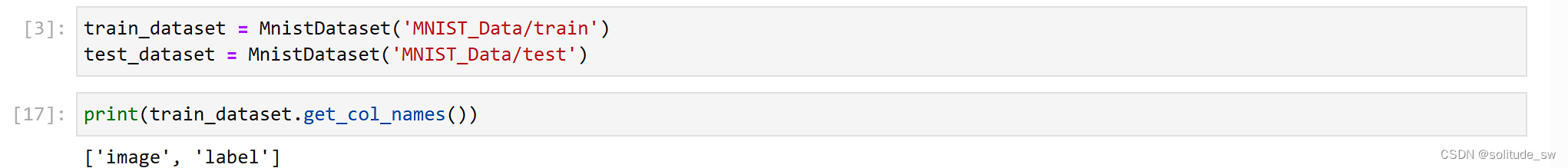

获取数据集对象,并打印数据页名

- train_dataset = MnistDataset('MNIST_Data/train')

- test_dataset = MnistDataset('MNIST_Data/test')

- print(train_dataset.get_col_names())

流水线处理,并打包为64大小的batch

- def datapipe(dataset, batch_size):

- image_transforms = [

- vision.Rescale(1.0 / 255.0, 0),

- vision.Normalize(mean=(0.1307,), std=(0.3081,)),

- vision.HWC2CHW()

- ]

- label_transform = transforms.TypeCast(mindspore.int32)

-

- dataset = dataset.map(image_transforms, 'image')

- dataset = dataset.map(label_transform, 'label')

- dataset = dataset.batch(batch_size)

- return dataset

-

- # Map vision transforms and batch dataset

- train_dataset = datapipe(train_dataset, 64)

- test_dataset = datapipe(test_dataset, 64)

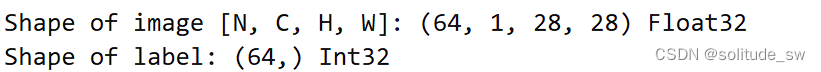

使用create_tuple_iterator 或create_dict_iterator对数据集进行迭代访问,查看数据和标签的shape和datatype。

- for image, label in test_dataset.create_tuple_iterator():

- print(f"Shape of image [N, C, H, W]: {image.shape} {image.dtype}")

- print(f"Shape of label: {label.shape} {label.dtype}")

- break

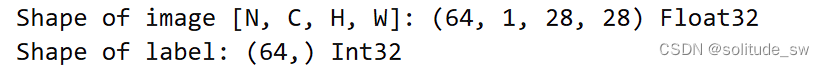

- for data in test_dataset.create_dict_iterator():

- print(f"Shape of image [N, C, H, W]: {data['image'].shape} {data['image'].dtype}")

- print(f"Shape of label: {data['label'].shape} {data['label'].dtype}")

- break

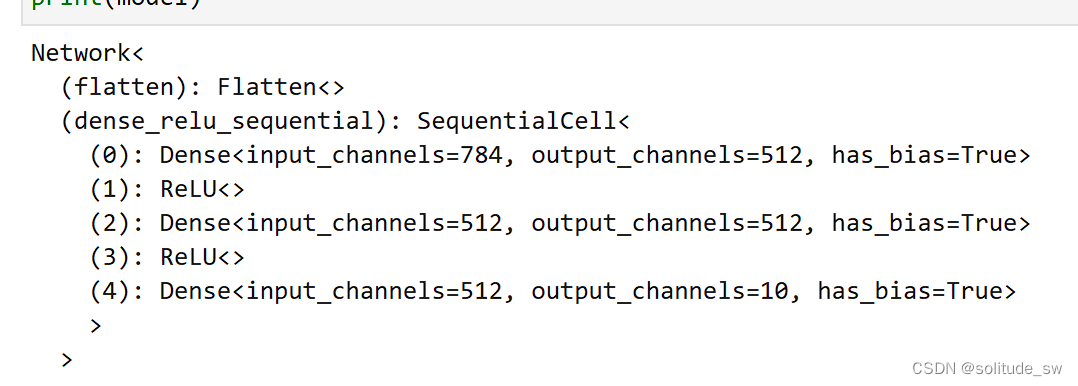

网络构建

mindspore.nn类是构建所有网络的基类,也是网络的基本单元。当用户需要自定义网络时,可以继承nn.Cell类,并重写__init__方法和construct方法。__init__包含所有网络层的定义,construct中包含数据(Tensor)的变换过程。

- # Define model

- class Network(nn.Cell):

- def __init__(self):

- super().__init__()

- self.flatten = nn.Flatten()

- self.dense_relu_sequential = nn.SequentialCell(

- nn.Dense(28*28, 512),

- nn.ReLU(),

- nn.Dense(512, 512),

- nn.ReLU(),

- nn.Dense(512, 10)

- )

-

- def construct(self, x):

- x = self.flatten(x)

- logits = self.dense_relu_sequential(x)

- return logits

-

- model = Network()

- print(model)

模型训练

在模型训练中,一个完整的训练过程(step)需要实现以下三步:

- 正向计算:模型预测结果(logits),并与正确标签(label)求预测损失(loss)。

- 反向传播:利用自动微分机制,自动求模型参数(parameters)对于loss的梯度(gradients)。

- 参数优化:将梯度更新到参数上。

MindSpore使用函数式自动微分机制,因此针对上述步骤需要实现:

- 定义正向计算函数。

- 使用value_and_grad通过函数变换获得梯度计算函数。

- 定义训练函数,使用set_train设置为训练模式,执行正向计算、反向传播和参数优化。

- # Instantiate loss function and optimizer

- loss_fn = nn.CrossEntropyLoss()

- optimizer = nn.SGD(model.trainable_params(), 1e-2)

-

- # 1. Define forward function

- def forward_fn(data, label):

- logits = model(data)

- loss = loss_fn(logits, label)

- return loss, logits

-

- # 2. Get gradient function

- grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True)

-

- # 3. Define function of one-step training

- def train_step(data, label):

- (loss, _), grads = grad_fn(data, label)

- optimizer(grads)

- return loss

-

- def train(model, dataset):

- size = dataset.get_dataset_size()

- model.set_train()

- for batch, (data, label) in enumerate(dataset.create_tuple_iterator()):

- loss = train_step(data, label)

-

- if batch % 100 == 0:

- loss, current = loss.asnumpy(), batch

- print(f"loss: {loss:>7f} [{current:>3d}/{size:>3d}]")

定义测试函数,以评估性能

- def test(model, dataset, loss_fn):

- num_batches = dataset.get_dataset_size()

- model.set_train(False)

- total, test_loss, correct = 0, 0, 0

- for data, label in dataset.create_tuple_iterator():

- pred = model(data)

- total += len(data)

- test_loss += loss_fn(pred, label).asnumpy()

- correct += (pred.argmax(1) == label).asnumpy().sum()

- test_loss /= num_batches

- correct /= total

- print(f"Test: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

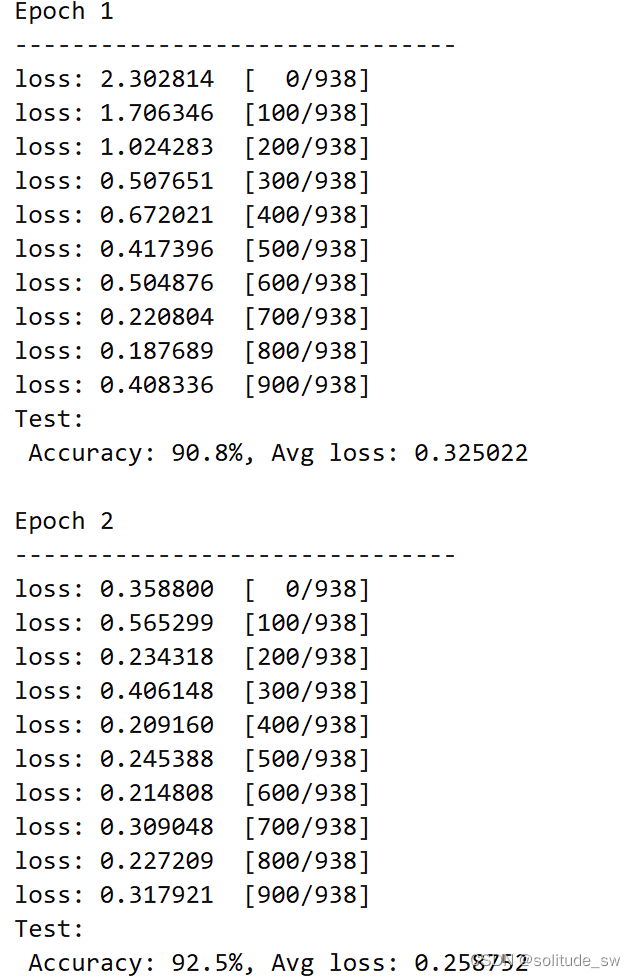

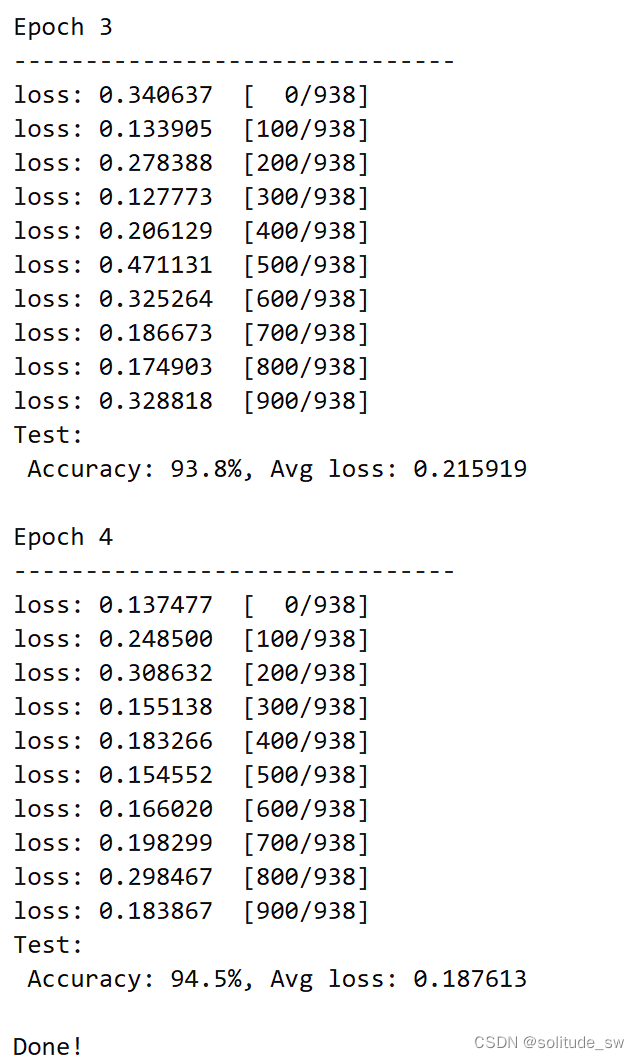

训练过程需多次迭代数据集,一次完整的迭代称为一轮(epoch)。在每一轮,遍历训练集进行训练,结束后使用测试集进行预测。打印每一轮的loss值和预测准确率(Accuracy),可以看到loss在不断下降,Accuracy在不断提高。

这里使用四轮迭代

- epochs = 4

- for t in range(epochs):

- print(f"Epoch {t+1}\n-------------------------------")

- train(model, train_dataset)

- test(model, test_dataset, loss_fn)

- print("Done!")

保存模型

模型训练完成后,需要将其参数进行保存。

- # Save checkpoint

- mindspore.save_checkpoint(model, "model.ckpt")

- print("Saved Model to model.ckpt")

加载模型

加载保存的权重分为两步:

- 重新实例化模型对象,构造模型。

- 加载模型参数,并将其加载至模型上。

- # Instantiate a random initialized model

- model = Network()

- # Load checkpoint and load parameter to model

- param_dict = mindspore.load_checkpoint("model.ckpt")

- param_not_load, _ = mindspore.load_param_into_net(model, param_dict)

- print(param_not_load)

param_not_load是未被加载的参数列表,为空时代表所有参数均加载成功。

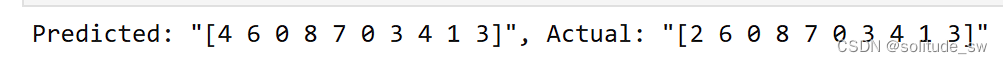

加载模型后预测推理

- model.set_train(False)

- for data, label in test_dataset:

- pred = model(data)

- predicted = pred.argmax(1)

- print(f'Predicted: "{predicted[:10]}", Actual: "{label[:10]}"')

- break

时间打卡

打印为UTC时间,+8即12:34:09即为打卡时的北京时间

心得

对于大模型了解还不多的我,通过第一天的学习,对于MindSpore框架的一些基础知识和MindSpore的架构有了一些了解,通过一个简单的demo对于MindSpore的数据集处理、网络构建、模型训练以及模型推理的一些基础代码有了一些了解,亲自动手实践的效果远比简单看一遍要好的多,希望第一天的学习能起一个好头支撑自己完成接下来的打卡