- 1【数据结构】——八大排序(详解+图+代码详解)看完你会有一个全新认识_数据结构排序算法代码

- 2AI智能行为分析预警系统技术方案

- 3【Golang】slice切片

- 4PyTorch碎片:PyToch和Torchvision对应版本_pytorch与torchvision版本对应

- 5Quartus Prime 19.1 下载教程_quartus ii 19.1

- 6【雕爷学编程】Arduino智能家居之基于Bluetooth的智能控制_arduino blue tooth

- 7asp.net 微信小程序源码 微信分销源码 源文件完全开源 源码_net 微信 商城

- 8想远程控制手机,用哪个软件好?

- 9使用XPath来解析网页数据_xpath 网页

- 10用python写一个完整的图书管理系统

中国版GPT-4o炸场:国内首个流式多模态交互模型,现场实时且丝滑

赞

踩

金磊 发自 WAIC

量子位 | 公众号 QbitAI

没等到GPT-4o,商汤先把《Her》给发布出来了!

就在刚刚,商汤直接在现场来了个炸裂的Live Show,话不多说,直接看效果:

不仅声音非常拟人(观众直呼好磁性),而且还是实时、随时可以打断的那种!

它宛如被安上了一对儿眼睛,可以做到精准无误的所见即所得。

就连手绘的粗糙的简笔画,AI也能俏皮地跟人类做互动:

一波Live Show秀下来,引得观众掌声连连、“哇”声一片。

这就是商汤发布的国内首个流式原生多模态交互模型——6000亿参数日日新5.5系列中的5o所达到的效果。

据了解,这是一种全新的AI交互模式,把文本、声音、图像还有视频等模态全都囊括到了一起,可以让AI跟人们交流的时候变得更加生动丰富。

可以说是真·电影走进现实了。

而且商汤CEO徐立现场表示,很快就可以用上了!

但新的AI交互模型,也还仅仅是商汤在这次发布中的一隅。

纵观整场活动,商汤可以说是围绕着日日新5.5,把多模态这事给玩儿得66的。

各位看官,咱们继续往下瞧。

计算机巨佬们“活”了起来

你没看错,商汤用新AI搞的另一个花活儿,就是“复活”了图灵、冯诺依曼等计算机巨佬们。

并且还致敬了已故的人工智能科学家,商汤科技创始人汤晓鸥老师,徐立表示:

致敬我们的创始人汤晓鸥教授对人工智能的执着,以及对于人才的培养,奠定了我们今天可以站在这里跟大家分享我们关于人工智能的一些想法。

请看VCR:

这个新AI,名叫Vimi,是基于日日新5.5能力打造的首个可控人物视频生成大模型。

而且是只需要一张任意风格照片就能搞定、普通用户都可以用、长达1分钟的那种哦~

要知道,“人物可控”这事一直是用大模型搞生成的一道难题,就连Sora在内大模型也面临无法精准控制动作、连续性不稳定(突然变脸)等问题。

但Vimi就不一样了,它不仅能够精确地控制人物的面部表情,还能在半身像的范围内调节人物的自然姿态。

并且也能够自动生成与人物相匹配的头发、服装以及背景的变化;时长方面更是达到了分钟级别。

由此,以后要是想打造一个自己的大片儿,例如冰雪女王,那就是一张照片的事儿了:

以为这就完了?No,No,No。

你的表情包又要变丰富了 。

。

总而言之,Vimi的出现可以说是利好视频创作者,让他们有了另一个高质量AI工具的选择。

值得一提的是,Vimi还被这次世界人工智能大会(WAIC)官方授予了最高荣誉——镇馆之宝。

怎么做到的?

对于能取得上述效果背后的杀手锏技术,商汤在现场也做出了大揭秘。

一方面是架构。

日日新5.5采用的是混合端边云协同专家架构,可以最大限度发挥云边端协同,降低推理成本。

另一方面是数据。

日日新5.5在模型训练上基于超过10TB tokens高质量训练数据,包括大量合成的思维链数据,其语言理解和交互能力全面升级。

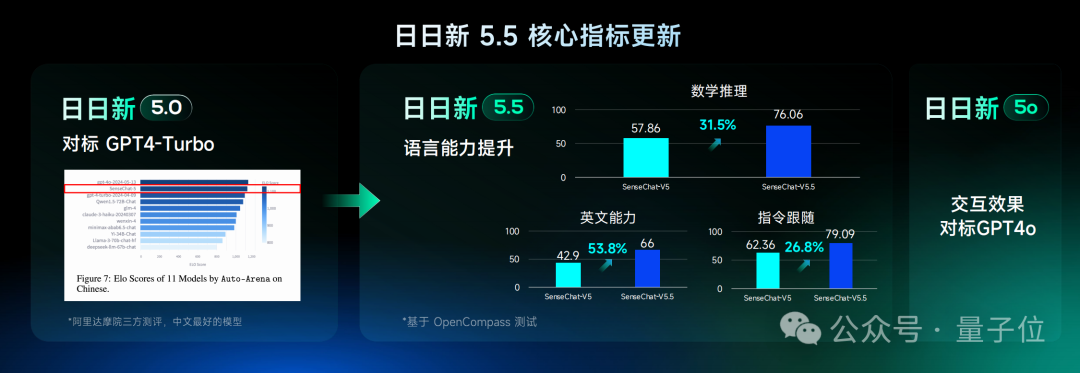

因此,日日新5.5在数学、推理、编程等多个维度较上个版本具有较大的提升,尤其是在数学推理(↑31.5%)英文理解(↑53.8%)、指令跟随(↑26.8%)等核心指标方面。

那么这一点又该如何体现呢?权威评测榜单,便是一个很好的印证。

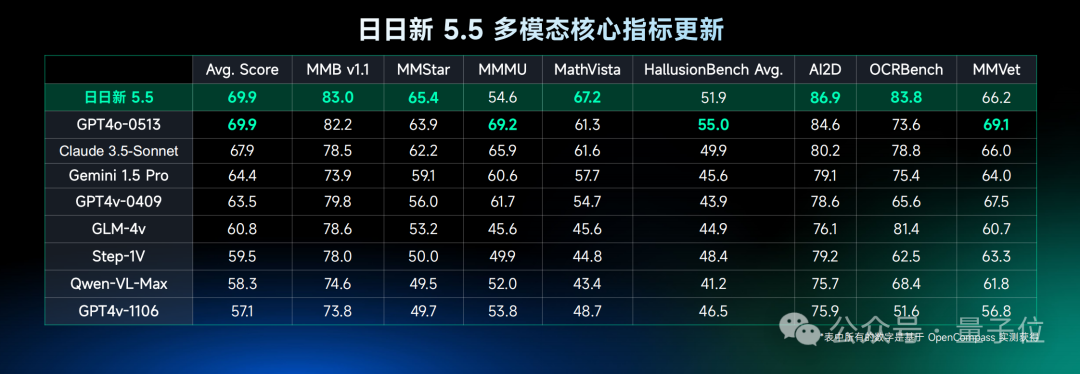

例如根据OpenCompass的评测,日日新5.5的平均分数已经与GPT-4o持平,并且多想细分维度的分数是超越了GPT-4o的。

不要999,不要99,只要9.9元全年

除了多模态之外,端侧,也是此次商汤着重的发力点之一。

现在的日日新端侧模型5.5 Lite同样也在性能指标的各维度上做到了全面升级。

基于手机旗舰平台,5.5 Lite首次安装包的耗时仅为0.19秒,相较于之前的版本减少了40%。

它的推理速度提高了15%,达到每秒90.2个汉字的处理速度。

此外,商汤还推出了端侧模型矩阵,其中包括商量Mini写作助手、总结助手和百科助手等专门定制的模型。

这些专项模型在相应的场景下具有更优异的性能,能够满足客户复杂业务场景的需求,同时也能够提供不同的专项模型供客户选择或定制。

而且基于日日新5.5的端侧大模型还做到了“多快好”,还做到了“省”——每台使用成本最低可达每年9.9元。

在企业方面,与商汤达成合作的企业用户已经超过3000家,覆盖领域包括互联网、医疗、金融和编程等等。

而说到价格,说到普惠,就不得不提商汤此次提出的“0元Go”计划了:

即日起,成为商汤“日日新SenseNova”用户,可获得涉及调用、迁徙、训练等多项免费服务大礼包。

同时赠送5000万Tokens包,并且派出专属搬家顾问,让新用户入驻新家舒适顺利。

那么看完商汤此次的整场发布,我们还需要回答一个问题:

重塑交互为什么重要?

对于这个问题,商汤CEO徐立给出了他的解读:

我曾经的想法是我们所处的行业虽然很热,但它还没有到超级时刻,是因为它没有真正的走进到一个行业的垂直应用当中引起广泛的变化。

但现在我的想法有点改变,超级时刻和应用应该是互相成就的,只有超级时刻带来的认知的变化,最后才能推动这样一个应用。

因此,应用,或许就成为了决定这个时代是不是人工智能超级时刻的一个关键。

这也就是为什么商汤要推出流式原生多模态交互模型的原因了,只有做到了更丰富更精准的多模态,以及更低延时更可控,方可让应用这件事更上一层楼。

总而言之,思路已然清晰,技术不断进步,属于AI2.0的超级时刻或许正在加速向我们逼近。

— 完 —

点这里

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。