- 1解决ADB错误“more than one device and emulator”的方法_adb.exe: more than one device/emulator

- 2Windows 10日语输入法无法输入假名问题_微软日文输入法打不了假名

- 3C# 两种方法实现HTTP协议迷你服务器

- 4重要通知 | 3月31日前小程序未完成备案,将予清退!

- 5简单了解 vue2.0 是如何用 Object.defineProperty() 来实现 双向绑定的_vue2 object.definedproperty原理

- 6上海亚商投顾:市场呈现窄幅震荡 新能源类行业受热炒

- 7Anroid模拟器(AVD)切换屏幕_avd模拟双屏

- 8Android中类加载机制解析_basedexclassloader dalvik.system.pathclassloader

- 9OpenHarmony端云一体化应用开发快速入门练习(上)基础配置_端云一体化开发框架

- 10cornerstone 使用

Nature | 人工智能模型越大就越好吗?_群体智能nature超过大模型 白皮书

赞

踩

随着生成式人工智能模型(AI)变得越来越大、越来越强大,一些AI科学家开始提倡更精简、更节能的系统。针对这个趋势,著名科技杂志《Nature》最近发表Anil Ananthaswamy博士的专题文章“人工智能模型总是越大型越好吗?”(In AI, is bigger always better?)。下面是这篇《Nature》专题文章的主要观点。

前言

可以生成流畅语言的人工智能系统,例如OpenAI的ChatGPT,是技术界的新宠。但是当它们遇到需要一些推导的数学问题时,这些大型语言模型(LLM)就常常会犯错。比如说这个代数题吧:

“一条直线与y=4x+6平行且经过(5, 10)。它和y轴的交点的纵坐标是多少?”

虽然LLM有时候能给出正确答案,答错的情况更多。在早期的推导能力测试中,ChatGPT面对中学水平的“数学”题集时只答对了26%(见https://arxiv.org/abs/2210.14891)。

这是可以理解的:给定输入文本之后,LLM只会根据模型训练集中词语、符号和句子的统计规律生成新的文本。要是学习语言模式就能让LLM稳定模仿出数学推导,那才是怪事呢。

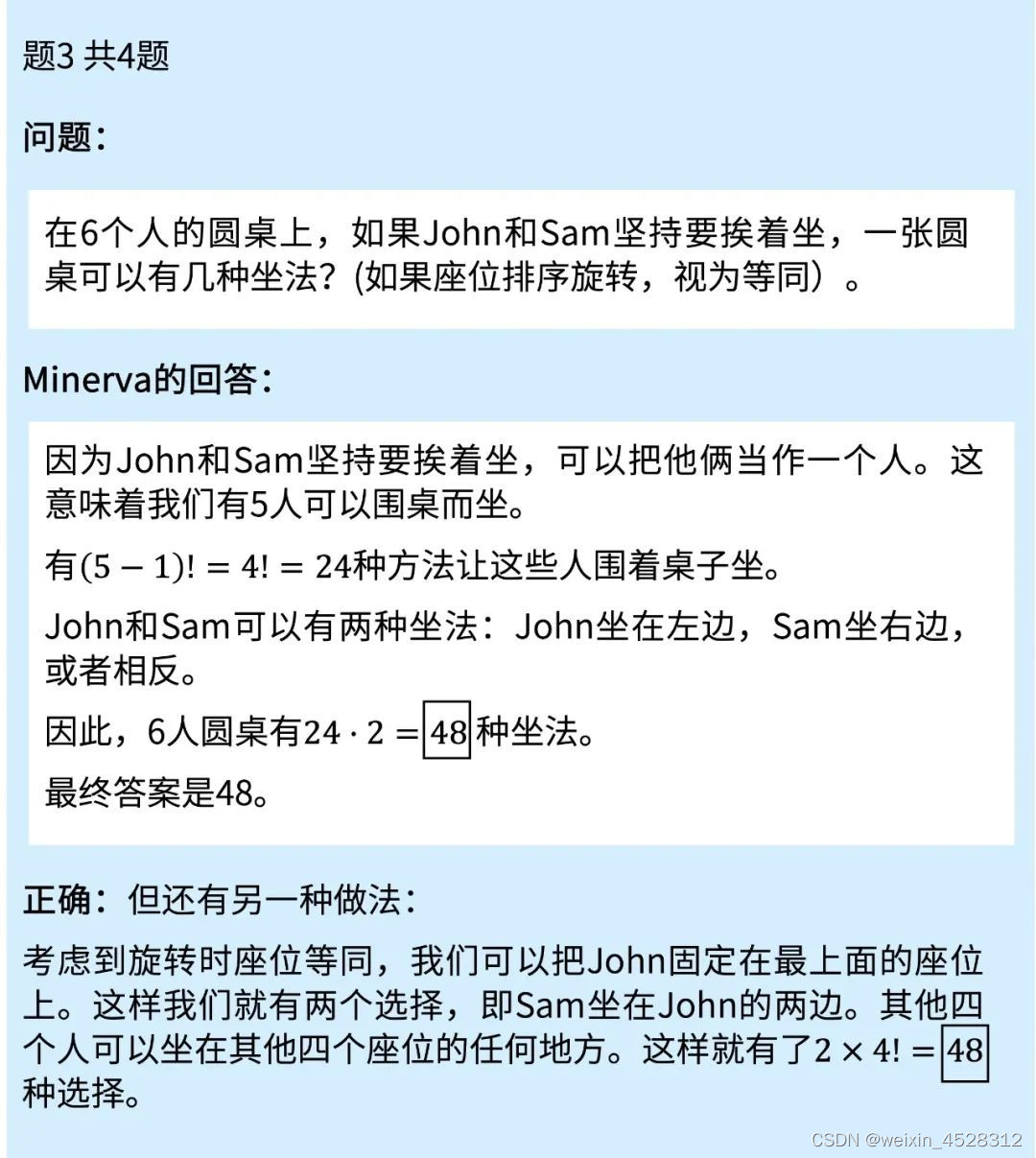

但在2022年6月,Google做的一款叫作Minerva的LLM多少算是突破了这种预期。Minerva在数学题集中答对了50%,这一结论让一些人工智能(AI)领域的研究者们大为吃惊(如下图)。

一个称为Minerva的大语言模型在“数学”数据集(中学水平的数学题)中得分50%。上面是它答对和答错的两题。

“这个圈子里说,这还真是个新奇事。”微软研究院的机器学习专家Sébastien Bubeck说。

Minerva的优势在于它是在数学相关的文本上训练的。但Google的研究提出了模型表现出色的另一重要原因——它的大小。这个模型大约有ChatGPT三倍大。

Minerva的结果佐证了一些研究者们长时间以来的怀疑:训练更大的LLM并输入更多数据,就可以让它们——只通过模式识别——解决理论上要求推导的问题。若真是如此,一些AI研究者们说,这种“越大越好”策略或许可以构建出一条通往强大AI的路。

不过,这个观点有理由加以质疑。LLM仍然还在犯很明显的错误,有些科学家提出,更大的模型只是在碰巧与训练集相关的问题上回答得更为出色,而没有获得回答全新问题的能力。

这个争论正在AI领域最前沿上演。商业公司通过更大的AI模型取得了更好的成果,因此他们推出了越来越大的LLM——每一个都要花上几百万美元来训练和运行(见“走向更大AI模型的驱动力”)。但这些模型有很严重的问题。除了输出不值得信任,以及可能会使假信息传播更严重的问题外,它们还非常贵,会吃掉大量能源。

也有批评者认为,大型LLM最终也无法模拟出、或是学到足以稳定回答推导类问题的技术。相反,有些科学家说,小型且能耗更经济的AI才是进步的道路——某种程度上是受到了大脑学习并构建连接方式的启发。

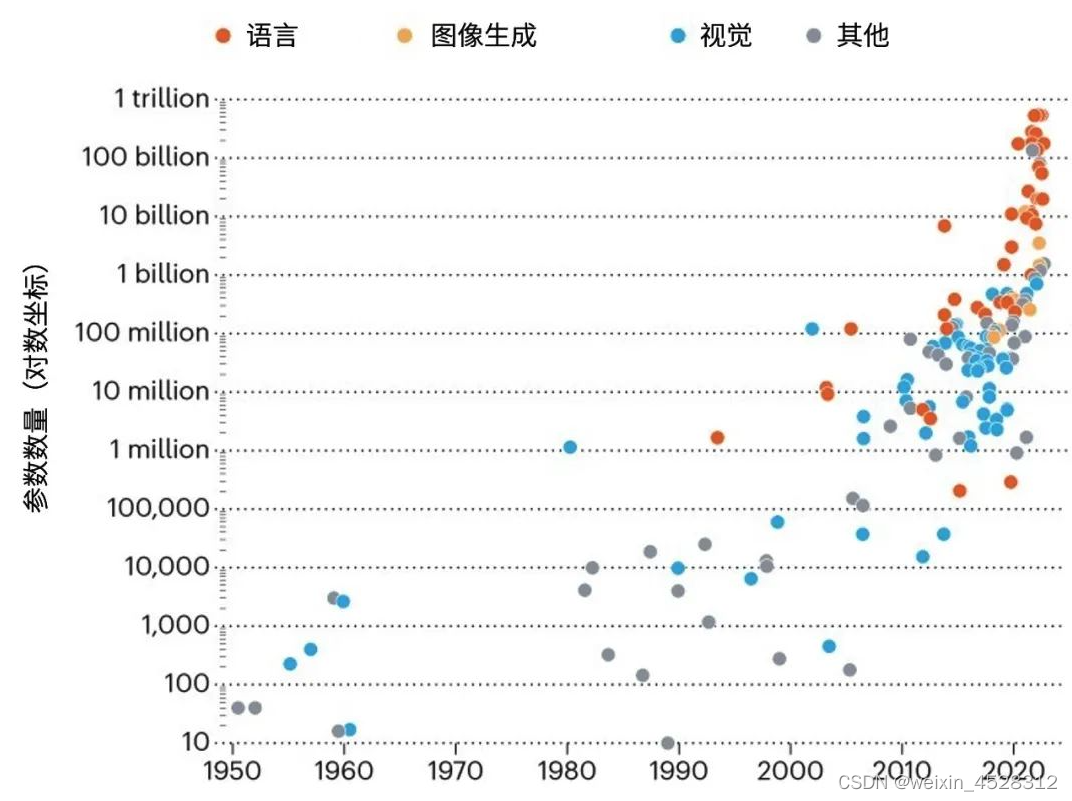

走向更大AI模型的驱动力。根据模型参数的数量级来看,人工智能神经网络的规模正在以指数级增长。

AI模型是越大越好吗?

像ChatGPT和Minerva这样的LLM是由计算单元(又称人工神经元)构成的多层巨大网络。LLM的大小可以由其参数的数量表示——这是一个可调节的数值,描述了神经元之间连接的强度。训练这种网络的过程是把已知的句子的一部分盖住,让它预测被盖住的部分,然后调节参数让算法下次能做到更好。

用人类写作的几十亿句子重复这一流程,神经网络就可以学到模拟人类写作时的内部表现。在这一阶段,LLM被称为经过了“预训练”(pretrain):它的参数掌握住了它在训练阶段所看到的书面语言的统计结构,包括文本中的所有事实、偏见和错误。接下来就需要使用专业数据“精调”模型。

用Minerva举例,研究者们是从Google的Pathways语言模型(PaLM)开始的。PaLM有5400亿个参数,是在一套拥有7800亿个“词元”(token)的数据集上预训练出来的。一个词元可以是一个词,一个数字或是其他信息单位。PaLM的训练集从英语和多语言的网络文本、书籍和代码中搜集到了这些词元。将PaLM在数百亿个词元的科技文献和数学相关网页上精调之后,就得到了Minerva。

Minerva能答出来的输入例如:30的倍数中不超过520的最大一个是多少?LLM看起来可以一步一步思考,但它所做的就只是把问题转化成词元的序列,生成统计上更可能的下个词元,接到原本的句子之后,再生成一个词元,如此循环:这个过程被称为推理(inference)。

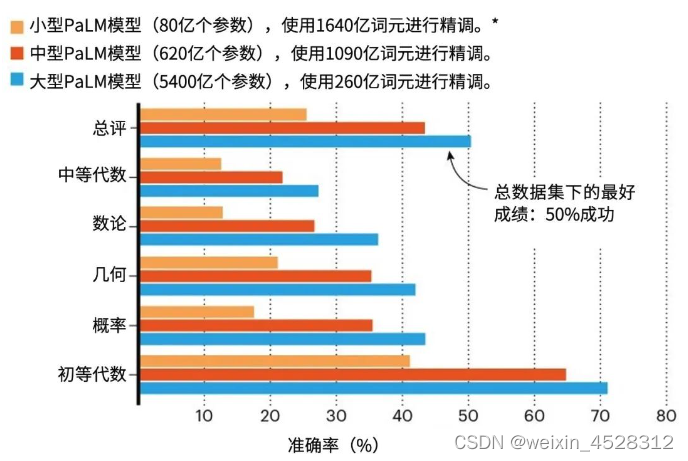

Google的研究者们精调了三个尺寸的Minerva模型,分别使用了80亿,620亿和5400亿个参数的预训练PaLM模型。Minerva的表现水平随规模增加。在整个MATH数据集上,最小的模型有25%准确率,中等的达到了43%,而最大的一个超过了50%的分数(见下图)

更大的聊天机器人数学更好吗?一款构建于大型语言模型PaLM的人工智能工具Minerva在高中等级的数学题里获得了50%的分数。数据显示,PaLM的模型越大,Minerva的表现就越好。

最大的模型精调时所使用的数据量也是最小的——它精调仅仅使用了260亿个词元,而最小的模型读了1640亿个词元。但最大的模型花了一个月来精调,使用的是专门的硬件,计算力是最小模型的8倍,而最小的模型只花了两周。理想情况下,最大的模型应该使用更多词元来精调的,Google研究Minerva团队的成员Ethan Dyer说;这可能会产生更好的结果。但团队感觉计算花销不太可行。

模型精度与模型大小的标度律

最大的Minerva模型表现最好,这和其他研究发现的标度律是一致的——这条定理说明模型性能随着模型大小增长而变好。2020年的一项研究表明,模型在三种情况下会性能更好:更多参数;更多训练数据或是更多计算量(训练时所执行的运算次数)。性能会遵循幂函数增长,也就是说它的提升速度是比如参数数量的若干次幂,符合标度定律。

但是,研究者们不太清楚为什么。“这是纯粹的经验规律。” Irina Rish说,她是加拿大蒙特利尔大学和蒙特利尔学习算法研究所的计算机科学家。

为了产生最好的效果,2020年的研究表明,训练数据加倍时,模型大小就需要增长5倍。去年的研究稍微修正了一下这个定理。3月,伦敦的AI公司DeepMind提出,最好是让模型大小和训练数据集同时增长;使用更多数据训练的小模型比使用更少数据训练的大模型表现要好(见https://arxiv.org/abs/2203.15556)。例如,DeepMind的Chinchilla模型有700亿个参数;使用了1.4兆词元进行训练;而2800亿参数的Gopher模型使用了3000亿个词元进行训练。Chinchilla在评估LLM学到什么的任务上表现好于Gopher(见下图)。

过去几年里,AI的大型语言模型使用了更多的算力和参数来训练。一些较小而表现更佳的模型也出现了,但是他们需要更多的数据来训练。图中的⭕️的大小表示AI训练的次数,黄色、橙色、红色分别表示模型生成的时间(2020,2021,2022)。

Meta研究团队的科学家在今年二月份使用了他们自己的少参数模型LLaMA拓展了这套概念。LLaMA使用了1.4兆词元进行训练。研究者们说,130亿参数版本的LLaMA超越了ChatGPT的先驱GPT-3(1750亿个参数),而650亿参数版本的LLaMA可以媲美Chinchilla甚至PaLM(见go.nature.com/3kje2fj)。

去年十月,麦吉尔大学的Ethan Caballero和Rish等人一起宣布了大小和性能之间更复杂的关系。在某些例子里,多个幂律可以描述性能随模型尺寸增长的增长关系,研究者们说(见https://arxiv.org/abs/2210.14891)。

例如,在他们发现的一个拟合通用函数的假设场景里,性能随模型尺寸会首先慢速增长,然后增长得更快,但是在参数继续增长时稍微下滑,之后又回重新增长。这种复杂关系的特征是由每个模型的具体情况和训练方式决定的。最终,研究者们希望能够在每个LLM扩大规模之前提前预测。

另一项独立的理论研究同样支持了对更大模型的追求——也就是2021年Bubeck和斯坦福大学的统计学家Mark Sellke提出的机器学习“稳健性规则”(law of robustness)。如果输入中有小扰动但仍然能给出稳定的回答,那么模型就是稳健的。有些AI是出了名的脆弱。例如,一些AI被训练来识别狗的图片,而它们会在图片中有一些不会骗过人类的小噪声时做出错误的分类(见https://arxiv.org/pdf/2105.12806.pdf)。

利用人工智能模型来识别狗的图片

AI越稳健,它就越能泛化到此前没见过的数据上。Bubeck和Selke在数学上证明了增加模型参数数量可以提高稳健性,因而提高泛化能力。Bubeck说该规则证明了提高规模是提高泛用性时必要的,但并没有证明它的充分性。不过,它被用来论证模型越来越大的趋势,他说,“我觉得这也合理。”

Minerva也利用了一项被称为思维链提示(chain-of-thought prompting)的关键创新。用户会在问题的最开始附上一些包含了几个问题和解答的例子作为提示,其中也包括得到答案的推导过程——阐明了一种典型的思维链。在推理时,LLM会从这段文字中提取线索,并产生很像推导的逐步回答。这并不需要更新模型的参数,因此不需要精调所需的额外计算力。

能够回应“思维链提示”类输入的能力只出现在1000亿参数以上的LLM里。这项发现帮助了更大的模型按照实证规模定理提升性能,Google研究团队的Blaise Agüera y Arcas说,“更大模型表现得越来越好。”

关于AI模型‘智力’的担忧

Google的AI研究员François Chollet是持怀疑态度的人之一,他认为无论LLM大到什么程度,都永远无法获得推导(或是模拟出推导)以可靠解决新问题的能力。LLM显示出推导能力只是因为能用此前遇到过的模版而已,无论模版来源于训练集还是输入。他说:“它并不能当场理解此前没见过的东西。”

LLM可能做到的最好的程度也不过是吸收足够多的训练数据,让语言的统计模式本身能够在回答问题时,给出非常接近过去见过的答案。

但是,Agüera y Arcas则认为LLM确实获得了一些没有特意训练的意外能力。他特别提到了一些用来测试人有没有所谓心智理论的测试——也就是能不能总结或是猜测其他人的精神状态。举个简单的例子,Alice把眼镜放到了抽屉里。然后Alice不知道的Bob把眼镜藏到了椅垫下。Alice会从哪里开始寻找眼镜?问小孩这个问题时,实际上是要测试他们是否理解:Alice自己所相信的事情,可能和小孩所知的不同(如下图)。

在他用Google的另一款LLM——对话应用的语言模型(LaMDA)时,Agüera y Arcas发现LaMDA可以正确回答出更广义的这类对话。对他来说,这表示LLM可能有能力在内部描述其他人的意图。“这些只管预测序列的模型发展出了一系列特别的能力,其中就包括心智理论。”Agüera y Arcas说(见“心智理论?”)。但他也承认这些模型容易出错,并且他也不确定仅提高规模(虽然必要)是否足够产生可靠的推理。

AI的心灵测试实验。华盛顿州西雅图谷歌研究院的 Blaise Agüera y Arcas 在博客中讲述了他与 LaMDA(谷歌大型语言模型之一)的对话。 阿奎拉·阿卡斯 (Agüera y Arcas) 认为这是一次令人印象深刻的交流,其中 LaMDA 似乎能够一致地模拟故事中两个对话者知道和不知道的事情——模仿一种明显的心理理论。

即使当LLM的回答是正确的,但实际上它并没有产生真正的理解,Chollet说:“你要是多戳两下,立刻就能明显看出来它里面全是空的。ChatGPT没有关于自己在说什么的模型。”他说,“就像在看一场傀儡戏,相信那些傀儡是活的。”

至今为止,LLM仍然会犯人类绝不会犯下的荒谬错误,Melanie Mitchell说,她在圣塔菲研究所研究AI系统的概念抽象和类比。这引发了很多担忧,人们不放心将LLM无安全网放入社会的安全性问题。

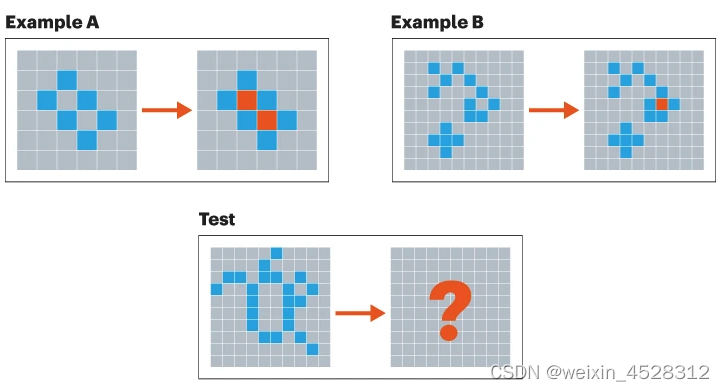

Mitchell补充说,关于LLM是否能尝试解决全新未知问题,一个问题在于,我们没有办法全面测试这种能力。“目前的评估标准不充分。”她说,“它们并没有系统性地测试东西。我们其实还不知道该怎么做。”Chollet提倡使用一套他自己设计的测试来测试抽象推导能力,叫做“抽象推导题集”。(见下图)

一种更高级的AI智力测试:这种测试要求AI模型根据例子中显示的模式来预测输入色块如何转换成输出格点。

一种更高级的AI智力测试:这种测试要求AI模型根据例子中显示的模式来预测输入色块如何转换成输出格点。

模型标度率有问题吗?

语言模型越来越大的趋势已经引起了大家的担忧。其中的担忧之一是训练大型LLM时所花费的数据集、计算力和费用会让它们的发展——以及研究方向——被限制在了有大型计算资源的公司里。OpenAI尚未证实制作ChatGPT的费用,但其他公司基于所需的计算量估算出预训练GPT-3(ChatGPT的前身)的费用应该超过了400万美元。OpenAI运行ChatGPT每个月可能要花费上百万美元,因为这款免费的聊天机器人会收到大量的请求。“我们已经深入腹地。”Bubeck说,“只有少数几个公司有超过1000亿参数的模型。”

政府正在带着支援介入,这可能会拓宽赛道。去年6月,一支包含了约1000名学术志愿者的团队,带着法国政府、美国一家叫Hugging Face的AI公司和其他来源的资助,利用价值700万美元的计算时间训练了一个1750亿参数的模型BLOOM (见https://arxiv.org/abs/2211.05100)。11月,美国能源部向Rish和她的同事们提供了超级计算机的计算时间,以建立大型模型并研究其表现。“我们希望能训练出一个类似Chinchilla的700亿参数模型——不一定是最大的,但可能是性能规模比最好的。”Rish说。

无论是谁来构建,LLM模型都会引发电力消耗的担忧。例如,Google说PaLM的训练在2个月内消耗了大约3.4吉瓦时(gigawatt-hours)的电力。这是大约300个美国家庭一年的电力消耗。Google训练PaLM是在俄克拉荷马州的数据中心进行的,这里的电力有89%来源于无碳能源,主要是风力和其他可再生的资源。但对业界AI模型的调查表明,大多数的训练都使用了主要由化石燃料供能的电网。

Chollet的担忧是,当各个公司开始训练并使用更大的模型时,它们就可能消耗更多电力。“每个大型技术公司都会开始在产品中置入LLM,不管这是不是个好主意。”他说。

AI模型是否应该越来越小?

对很多科学家来说,迫切需要减少LLM的能耗——让神经网络更小,更有效率,以及也许还能更聪明。除了训练LLM的电力消耗之外(这虽然大,但是是一次性的),推理——也就是LLM作答时——用的电力会随着用户增加而激增。大型科技企业未就他们模型的电力使用费用做出评论。不过Hugging Face公开说,他们的BLOOM模型在Google云平台上运行了18天,回答了230768条问题(这比ChatGPT少得多,后者二月一个月就达到一亿活跃用户了),它的平均功耗是1664瓦。

相比之下,我们的大脑要复杂得多,比任何LLM都大,有860亿神经元,大约100兆突触连接。但是,人类大脑的功耗大约是20-50瓦,瑞士弗雷德里克-米歇尔生物医学研究所的Friedemann Zenke说。

因此一些研究者希望,模仿大脑的某些方面,可以帮助LLM和其他神经网络变得更小,更聪明,更有效率。

大脑的智慧和效率的原因之一可能是它的循环或是反馈连接。LLM本质上是“前馈”网络。这就意味着信息是单向流通的:从输入,通过LLM的各层,到输出。大脑的连接方式不同。例如,在人类的视觉系统里,神经元会把大脑里最初接收视觉信息的区域与更后面的区域连接起来。但其中也有反馈连接,能让信息反过来传输。“在(人类)视觉系统里,反馈连接可能有前馈连接的十倍。”Mitchell说。但是LLM没有反馈连接。

同时使用反馈和前馈连接的人工神经网络通常称为循环神经网络(RNN)。这种网络(和前馈LLM不同)可以识别出数据内随时间变化的模式。这是“所有自然智慧体验和学习世界的方式的基础。”西奈山伊坎医学院的计算神经科学家Kanaka Rajan说。但是RNN也有它的挑战,Rajan说。例如,训练它们很难很慢,因此难以把规模扩大到现在LLM的程度。

大脑有效率的另一个原因在于,生物神经元大多数都很安静——它们只有偶尔才会产生一个活跃的脉冲。相反,大多数神经网络中的神经元在模型中是常时开启的。研究者们正在研究这种脉冲人工神经元(模仿真实的神经元),但想把训练标准神经网络的算法应用到脉冲神经元上很难。但是,使用小数据集(例如,使用10000段音频训练识别人念数字的神经网络)的研究表明,使用脉冲神经元的RNN比使用标准神经元的表现要好。并且在理论上计算力需求会少三倍(见Accurate and efficient time-domain classification with adaptive spiking recurrent neural networks | Nature Machine Intelligence)。在阿姆斯特丹数学与计算机科学国立研究院研究这一领域的Sander Bohté说,“进展很快很大。”

但是,如果脉冲神经元只是在软件中模拟出来的话,它就没办法真的提供效率提升(因为模拟它们的硬件仍然消耗电力)。这种计算单元需要被内置于硬件,安到神经形态芯片里,才能体现出效果。

如何训练出省电的大型语言模型(LLM)?

与此同时,研究者们在尝试不同的办法给现有的LLM节省电力,以及变得更聪明。2021年12月,Google的DeepMind报告了一套称为RETRO的系统,将LLM连接到一个外部的数据库里。LLM在推理时使用了这个数据库中提取的相关文字来帮助它做出预测。DeepMind的研究者展示了一个75亿参数的LLM,配上了一个2兆词元的数据库,而它的表现超越了参数量多25倍的LLM(见https://arxiv.org/abs/2112.04426)。研究者们写道,这种方式“在我们试图建立更强大的语言模型时,它比试图提高原始参数规模的方法更有效”。

同一个月,Google研究团队的科学家报告了另一个提高规模时增加能效的方法。他们的通用语言模型GLaM有1.2兆参数 (见https://arxiv.org/abs/2112.06905)。但是这些参数并不是一个巨大的神经网络;在内部分成了64个更小的神经网络,以及其他几个层。这个LLM训练之后,在推理过程中只会使用2个网络来完成一项任务;总体上说,它对每个词元只会使用其一兆多参数的8%。据Google说,GLaM使用了和训练GPT-3相同的计算资源,但是由于训练软件和硬件的改进,只花费大约三分之一电力。在推理过程中,GLaM使用的资源是GPT-3所需的一半。并且使用同样数量的数据训练时,表现比GPT-3要好。

要想进一步改进的话,即使这些能效高的LLM似乎也注定会变大,使用更多数据和计算力。研究者们会关注规模变大后会有什么新的表现。“它会不会完全解锁推导能力,我不确定。”Bubeck说,“也没人知道。”

小知识:什么是LLM大语言模型?

最后,我们简单介绍一下这篇文章涉及的一个中心概念:大型语言模型。

大语言模型(英文:Large Language Model,缩写LLM),是一种人工智能模型,旨在理解和生成人类语言。它们在大量的文本数据上进行训练,可以执行广泛的任务,包括文本总结、翻译、情感分析等等。LLM的特点是规模庞大,包含数十亿的参数,帮助它们学习语言数据中的复杂模式。这些模型通常基于深度学习架构,如转化器,这有助于它们在各种NLP任务上取得令人印象深刻的表现。

拿 GPT 来说, GPT 其实出现了好几代,GPT 3 它有 45 个TB的训练数据,那么整个维基百科里面的数据只相当于他训练数据的 0. 6%。我们在这个训练的时候把这个东西称作语料,就语言材料,这个语料的量是可以说是集中到我们人类所有语言文明的精华在里面,这是一个非常非常庞大的一个数据库。

一般来讲,GPT包含三个方面的能力:

- 上下文学习。GPT-3 正式引入了上下文学习能力:假设语言模型已经提供了自然语言指令和多个任务描述,它可以通过完成输入文本的词序列来生成测试实例的预期输出,而无需额外的训练或梯度更新。

- 指令遵循。通过对自然语言描述(即指令)格式化的多任务数据集的混合进行微调,LLM 在微小的任务上表现良好,这些任务也以指令的形式所描述。这种能力下,指令调优使 LLM 能够在不使用显式样本的情况下通过理解任务指令来执行新任务,这可以大大提高泛化能力。

- 循序渐进的推理。对于小语言模型,通常很难解决涉及多个推理步骤的复杂任务,例如数学学科单词问题。同时,通过思维链推理策略,LLM 可以通过利用涉及中间推理步骤的 prompt 机制来解决此类任务得出最终答案。据推测,这种能力可能是通过代码训练获得的。

LLM的发展历史上来讲,2017谷歌最早推出 transformer 模型;2018 年的时候谷歌提出了 Bert 的模型;然后到 GPT 2,从 340 兆到 10 亿 、15 亿,然后到 83 亿,然后到 170 亿,然后到 GPT3 1750 亿的参数。

这最早推出的那个transformer模型,就是我们所了解的那个GPT。GPT 名字里面有一个叫做transformer,就是这个 transformer 模型。它是 2017 年出现的,其实也很早,所以计算机领域来说, 2017 年可以归结于上一个时代的产品。然后 2018 年第一代 GPT 出来,当时还不行,相对来说比较差,性能也不行,然后像一个玩具一样。然后 2018 年谷歌又推出了一个新的模型,叫BERT,但是这些模型都是基于之前谷歌推出的这个 transformer 模型进行发展的。然后到了 2019 年, open AI 除了 GPT 2 也没有什么特别,就是它没有办法来产生一个语言逻辑流畅通顺的一段名词,你一看就知道这是机器写的。

但是到了 2020 年的5月, GPT 3 出来之后,其实就有了非常大的变化, GPT 3 的性能比 GPT 2 好很多,它的数参数的数量级大概是 GPT 2- 10 倍以上。

训练语言模型需要向其提供大量的文本数据,模型利用这些数据来学习人类语言的结构、语法和语义。这个过程通常是通过无监督学习完成的,使用一种叫做自我监督学习的技术。在自我监督学习中,模型通过预测序列中的下一个词或标记,为输入的数据生成自己的标签,并给出之前的词。

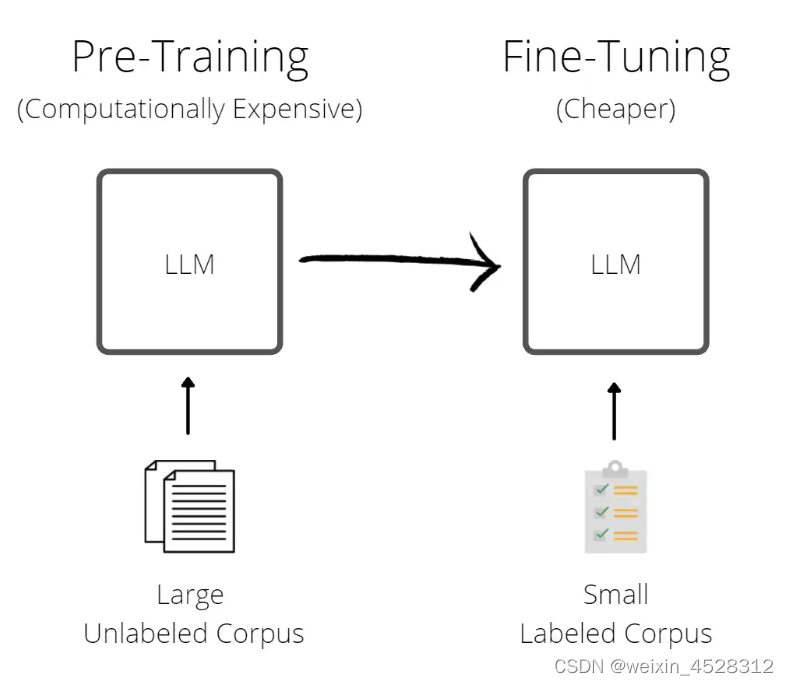

LLM的训练过程包括两个主要步骤:预训练(pre-training)和微调(fine-tuning):(1)在预训练阶段,模型从一个巨大的、多样化的数据集中学习,通常包含来自不同来源的数十亿词汇,如网站、书籍和文章。这个阶段允许模型学习一般的语言模式和表征。(2)在微调阶段,模型在与目标任务或领域相关的更具体、更小的数据集上进一步训练。这有助于模型微调其理解,并适应任务的特殊要求(如下图)。

大型语言模型训练示意图

最常见的大语言模型包括:

- GPT-3(OpenAI): Generative Pre-trained Transformer 3(GPT-3)是最著名的LLM之一,拥有1750亿个参数。该模型在文本生成、翻译和其他任务中表现出显著的性能,在全球范围内引起了热烈的反响,目前OpenAI已经迭代到了GPT-4版本。

- BERT(谷歌):Bidirectional Encoder Representations from Transformers(BERT)是另一个流行的LLM,对NLP研究产生了重大影响。该模型使用双向方法从一个词的左右两边捕捉上下文,使得各种任务的性能提高,如情感分析和命名实体识别。

- T5(谷歌): 文本到文本转换器(T5)是一个LLM,该模型将所有的NLP任务限定为文本到文本问题,简化了模型适应不同任务的过程。T5在总结、翻译和问题回答等任务中表现出强大的性能。

- ERNIE 3.0 文心大模型(百度):百度推出的大语言模型ERNIE 3.0首次在百亿级和千亿级预训练模型中引入大规模知识图谱,提出了海量无监督文本与大规模知识图谱的平行预训练方法。