- 1通义灵码-IDEA的使用教程_idea 通义灵码

- 2ollama调用本地模型时出现502_ollama serve报错

- 3npu算力如何计算_麒麟990 5G芯片的NPU如何做到算力暴涨?华为自研达芬奇架构详解...

- 4通过远程桌面连接Windows实例,提示“为安全考虑,已锁定该用户账户,原因是登录尝试或密码更改尝试过多”_为安全考虑,已锁定该用户帐户,原因是登录尝试或密码更改尝试过多。请稍候片刻再重

- 5MySQL入门篇

- 6Yolov5笔记--检测bilibili下载好的视频_yolo检测视频

- 751-LED点阵屏_hc595驱动led点阵

- 8企业数字化转型AI能力中台(总体架构、系统功能)建设方案_ai中台系统架构

- 9封装了一个仿照抖音效果的iOS评论弹窗

- 10Loading class `com.mysql.jdbc.Driver‘. This is deprecated._loading class `com.mysql.jdbc.driver'. this is dep

目标检测——day46 可转移交互性知识的人机交互检测_交互关系检测最新方法

赞

踩

Transferable Interactiveness Knowledge for Human-Object Interaction Detection

Human-Object Interaction Detection)

论文pdf下载(含笔记)

Transferable Interactiveness Knowledge for Human-Object Interaction Detection

1 INTRODUCTION

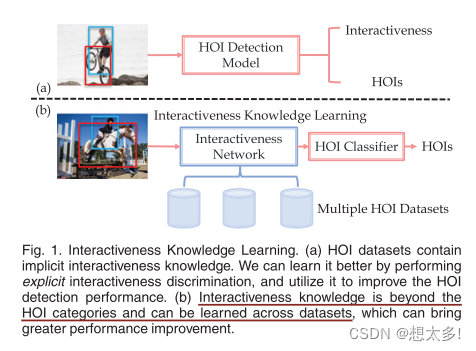

Fig. 1,与传统HOI相比,本文所提出的HOI增加了交互性知识的学习

- 不仅提升了HOI检测性能

- 交互性知识超出了HOI类别,可以跨数据集学习,这可以带来更大的性能改进

3 PRELIMINARY

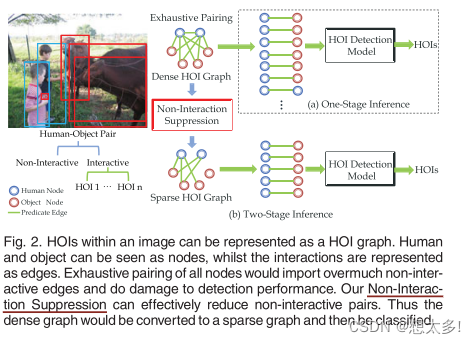

Fig. 2,图二中展示了HOI中(人,物)所构成的图,并且由提出的非相关抑制将稠密图变为稀疏图,然后进行分类。

4 METHOD

4.1 Overview

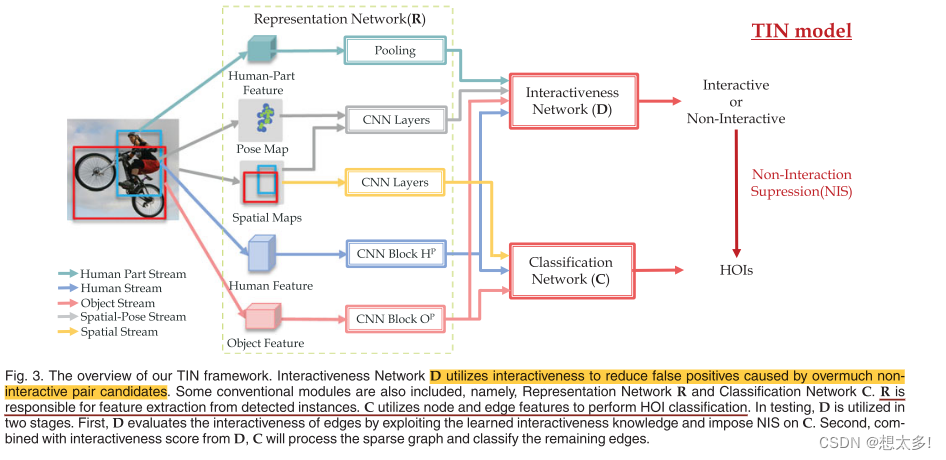

我们的TIN框架的概述如 Fig. 3所示。

- 我们提出了交互性网络D(交互性鉴别器),它利用交互性来减少由过多的非交互性候选对引起的误报。利用学习到的交互性知识来评估边的交互性,从而将稠密的HOI图转换为稀疏的图

- R负责从检测到的实例中提取特征

- C对稀疏图进行处理,利用节点和边缘特征对HOIs进行分类

4.2 Representation and Classification Networks

简要介绍表示网络R和分类网络C

Representation Network,在训练和测试过程中,R被冻结,并作为一个特征提取器。给定检测到的边界框,我们通过根据框坐标裁剪ROI池特征图来生成人和对象特征

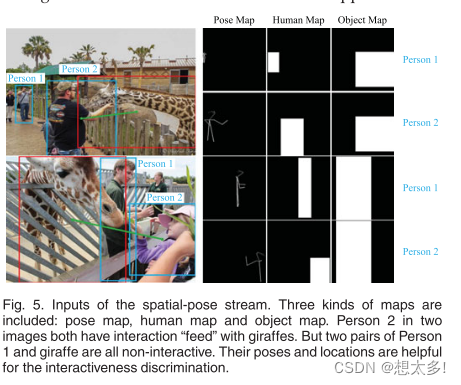

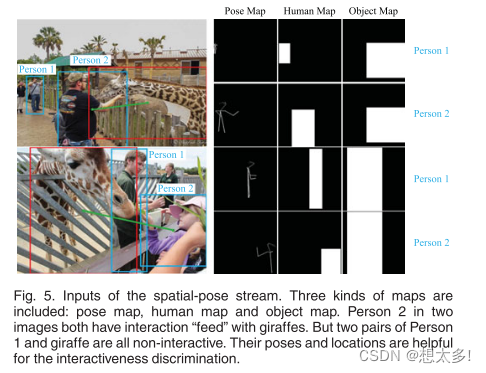

Classification Network,使用多流架构和后期融合策略,如Fig. 5所示,分为人、物和空间三个通道,确定多个人和物的交互性需要用到空间流进行判断。

4.3 Interactiveness Network

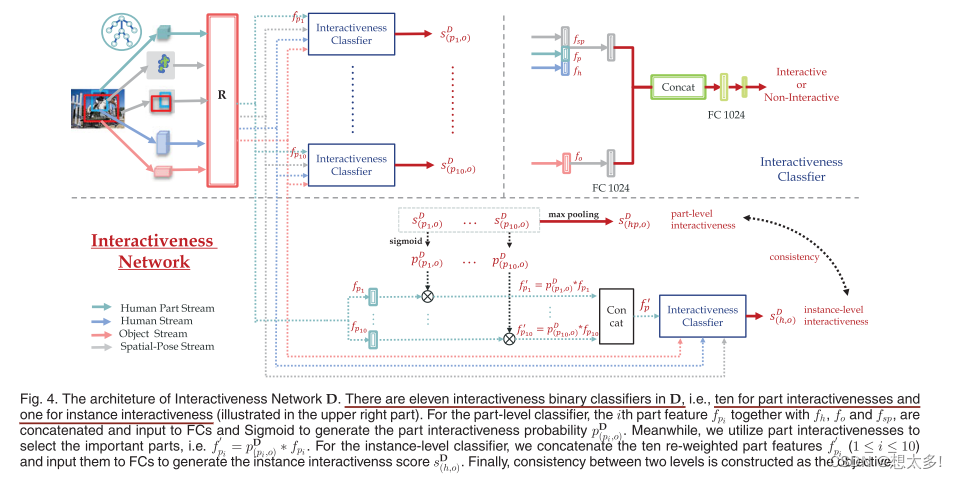

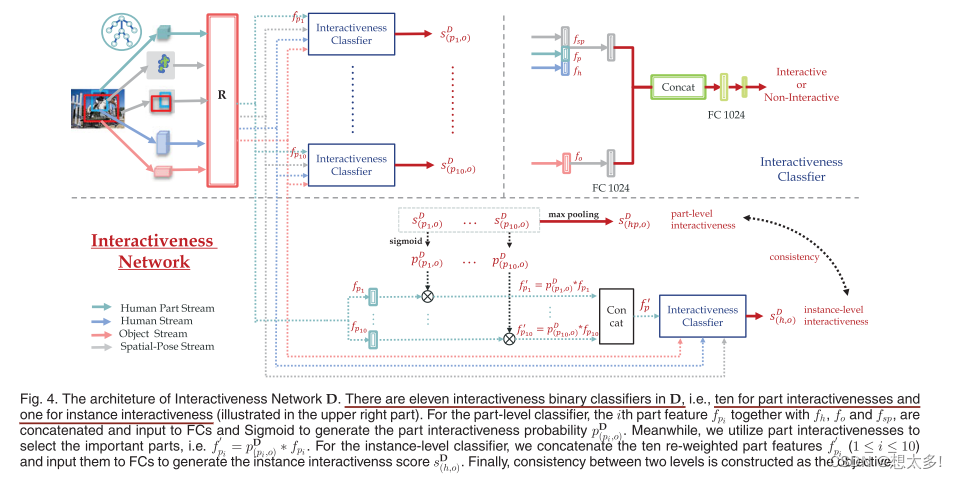

交互性网络d被设计用于二进制分类:交互式/非交互式,d中有四种流(人、物体、空间姿态和部分),每一种流都侧重于图像中HOIs的不同元素。交互性网络D的体系结构如Fig. 4所示。

4.3.1 Three Streams With Instance-Level Features

需要通过提取和组合基本信息来学习交互性。显然需要人和物体的视觉外观。此外,交互式和非交互式对还具有其他显着特征,例如空间位置和人类姿势信息。

D需要将所有这些关键元素编码在一起,以学习互动性知识。

4.3.2 Part Stream With Part-Level Features

探索在互动学习中采用人体部分特征。

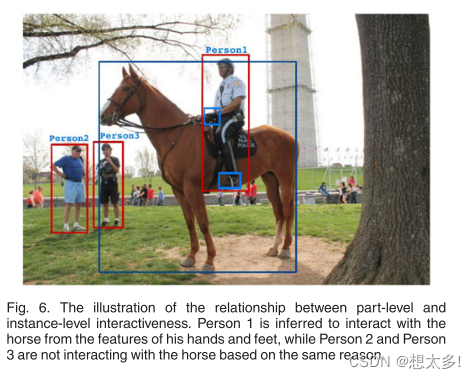

首先使用姿态估计构建了10个零件框Fig. 6,即头部、上臂、手、臀部、大腿和脚。每个零件箱都以相应的检测接头为中心。零件盒的大小是通过测量颈部和骨盆关节之间的距离来决定的。其次,对于部分流,我们从检测到的部分框中提取ROI池特征作为部分特征。

4.3.3 Binary Interactiveness Classifier

D中有11个结构交互的二值分类器(Fig. 4中的“交互分类器”),即10个部分交互,实例交互1个。它们都将上述四个流中的四种特征作为输入,并由简单的连接操作和全连接层层构造。交互性分类器的详细结构如Fig. 4右上方所示。

4.3.4 Interactiveness Consistency

当且仅当至少一个身体部位与物体互动时,人是互动的,当且仅当没有一个互动时,人不是互动的。

-

对于一个人-对象对,我们的方法的预测应该遵循:

-

预测的交互性得分来构建一致性损失:

-

综上所述,交互性鉴别器D的损失可以表示为:

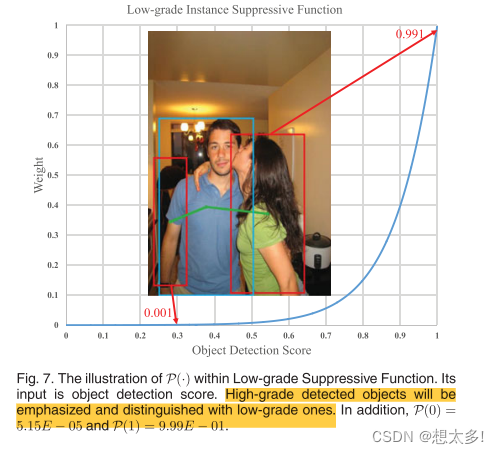

4.4 Testing With Non-Interaction Suppression

如Fig.7,提出了一种低级别抑制功能(LIS),它具有增强区分高低级别物体检测的能力。高分检测对象将被强调并与低分对象区分