- 1SpringCloud 面试题_springcloud面试题

- 2基于python的微博舆情分析与研究—以《北京冬奥会》为关键词_微博舆情词云

- 3搜索如何屏蔽特定某个网站?在搜索引擎中设置搜索技巧_google搜索某个关键词,不想给搜索出来

- 4最佳实践:MySQL CDC 同步数据到 ES_flink cdc mysql es

- 5Python获取cookie用法介绍

- 6反乌托邦的捷径——给大脑装个芯片,与计算机相连……

- 7Eureka服务端集群数据同步原理_eureka集群同步原理

- 8SSL/VPN远程接入技术架构

- 9【华为OD机试真题 Python】 密码解密_华为od密码解密

- 10推荐一些经典的技术书籍给你们

浅谈电商网络爬虫技术

赞

踩

摘 要

目前网络上存在着海量的数据资料,将这些数据爬取保存下来,并进行进一步操作,即可挖掘出数据的潜在价值。如今的互联网存在的缺陷是用户很难获得有用的数据资料,虽然传统的搜索引擎可以为用户返回大量信息,但是用户需要在庞杂的数据中寻找对自己有用的信息。因此现如今越来越多的平台开始搭建属于自己的数据爬取系统,并在爬取的数据基础上展开服务。本文将会对网络爬虫技术进行概述,并阐述其基本原理。

一、网络爬虫技术概述

网络爬虫又叫网络蜘蛛、网络机器人等,可以将其理解为一个在互联网上自动提取网页信息并进行解析抓取的程序。网络爬虫不仅能够复制网页信息和下载音视频,还可以做到行为链执行与网站的模拟登录。身处大数据时代,不论是人工智能还是数据分析,都需要有海量的数据在背后做支撑,如果单单是依靠人力去手工采集,不仅成本高昂而且效率低下,在这一需求下,自动化且高效可并发执行的网络爬虫便担起了获取数据的重任。

二、网络爬虫基本原理

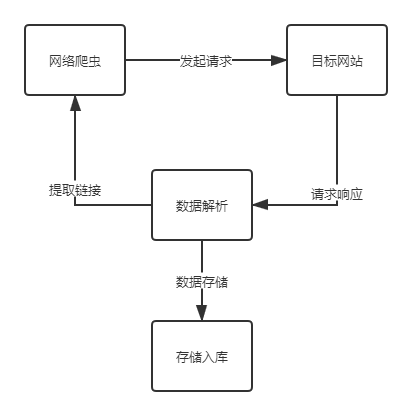

理论上来说,任何编程语言都可以用来编写网络爬虫,只有难易之分。因为网络爬虫本质上只是对目标服务器发起HTTP请求,并对HTTP响应做出处理,提取关键信息进行清洗入库。这里的服务器可以理解为要爬取的网站站点,爬虫程序发起一次HTTP请求,网站服务器对请求做出一次响应,就构成了一次网络爬虫行为,但是仅仅发起请求是不完整的,还需要将网站返回回来的信息进行数据解析和数据清洗,将最终需要的数据存储到数据库或是本地文件里才算是完成了一整套的爬虫流程。

如图1所示,完整的爬虫流程应当是编写的网络爬虫在发起请求之后,目标服务器返回指定的请求响应,通过对请求响应返回的响应体进行解析,找到需要的信息进行数据存储。如果需要翻页或者进行跳转,则从当前页面或者响应体中提取出链接再次发起请求。

图 1 网络爬虫流程

通常来说,开发一个网络爬虫主要有两个途径,一个是根据请求包和解析包从头开始爬虫编写,另一个是基于现行的爬虫框架,进行框架化开发。

1.脚本编写爬虫

Python实现了许多第三方库来帮开发者完成这个操作,比如github上开源的requests库便是发起HTTP请求的利器,这就省去了实现请求程序的时间,bs4解析库更是让开发者只需要专注于网页信息的定位,操作网站返回的主体信息就可以了。开发重心也就从协议处理转化到了具体网页的数据提取。不过如果爬虫编写者是要对有着反爬虫措施的网站进行数据采集,则需要花费精力去应对反爬虫手段,诸如JavaScript逆向、代码混淆或者指纹风控之类的手段。

2.基于框架开发爬虫

如今流行的网络爬虫框架Scrapy,其基于异步Twisted引擎,将爬虫请求的每个阶段都进行了拆分,并建立了钩子能够让开发者在每一阶段进行定制化开发,可以大大加快网络爬虫的开发速度,并且其异步特性可以很好地实现并发爬取。

Scrapy框架模块化和程序化的编写方式,符合团队合作的风格,相较于脚本编写爬虫,更易于集体开发和维护。但缺点是需要进行第三方的拓展时不如直接进行脚本编写方便,如今的爬虫大多需要进行JS逆向、验证码识别之类的操作,外接其他编程语言进行开发,这需要对Scrapy有着深入了解才能做到程序稳定运行。

三、网络爬虫分类

实际开发中根据具体的代码实现与爬虫架构,网络爬虫可以被分为通用网络爬虫、聚焦网络爬虫、增量式网络爬虫与深层网络爬虫。

1.通用网络爬虫(General Purpose Web Crawler)

通用网络爬虫又叫全网爬虫,顾名思义,它的目标数据是整个互联网,爬取的数据极为丰富,因此常用于搜索引擎当中。它们往往从一些种子URL出发,辗转爬取最终拓展到整个网络。在爬虫流程里讲过,一个爬虫程序的设计离不开发起请求,解析页面和内容存储三个方面。既然要存储海量的互联网数据,那这类爬虫对于爬虫的性能和数据的存储空间就会具有高要求,而且因为URL数量过多,通用网络爬虫常常会忽略爬行页面的顺序,并且采取并发的模式来提高爬取速度。

正是因为它要爬取海量的数据,所以此类爬虫的爬取策略常常需要进行严格的设计与实践。就目前而言,深度优先爬取策略和广度优先爬取策略是较为常见的。不过真正应用于实践当中的通用网络爬虫策略往往会非常复杂,并且穿插各类算法在其中。

(1) 深度优先:按照页面深度进行排序,一次访问下一级URL,直到触底无法深入。

(2) 广度优先:按照页面内容目录层次进行划分,爬取完同一层次的URL才会继续进入下一层进行爬取。

2.聚焦网络爬虫(Focused Crawler)

聚焦网络爬虫更加适用于日常的爬虫需求,并不需要爬虫程序去获取整个互联网的资源,那是搜索引擎该做的事。它专注于某一主题,选择性爬取网页上与开发者已经定义的规则相匹配的数据资源,能够满足对于特定网站或者领域的信息爬取工作。

聚焦网络爬虫的爬取策略有4种:

(1) 基于内容评价:将用户输入的信息作为主题进行爬取,页面包含用户输入信息则认为主题相关。

(2) 基于链接评价:根据页面结构信息分析爬取的URL重要性,根据重要程度进行爬取优先级的排序。

(3) 基于增强学习:利用概率统计中的贝叶斯分类器,根据网页内容和链接文本对URL进行分类,计算出URL的权重,以决定爬取顺序。

(4) 基于语境图:结合机器学习系统,计算当前页面到相关的网页的距离,距离越近的页面的URL访问越优先。

3.增量式网络爬虫(Incremental Web Crawler)

增量式网络爬虫主要目的是长久地维持一个数据库,对于其中数据的稳健性和实时性具有高要求。简单来说,它对已经爬取过的网页页面采取增量式更新,再次爬取的时候就会仅仅爬取新出现的或者发生改变的数据,对于没有发生变化的页面或数据则不会爬取。

此类爬虫常用的策略有三:

(1) 统一更新:每隔一段时间将所有的页面再次访问一遍,以达到更新数据的目的。

(2) 个体更新:根据个体网站的数据变化频率来指定重新访问的时间。

(3) 分类更新:将网页区分为数据变化迅速的和数据变化缓慢的,以不同频率访问这两类网页。

4.深层网络爬虫(Deep Web Crawler)

深层网络主要指的是没办法直接访问到的页面,这类网页信息通常需要满足一定的要求才可以浏览,隐藏在一些表单之后,不能通过静态链接直接获取。例如日常生活中遇到的一些必须登录注册后才可以访问的网站便属于深层网络的范畴。这类爬虫的需求也极其旺盛,不过只需要搭配GET和POST请求便可以访问,主要难点在于破解POST提交信息时候的网页数据加密,即JavaScript加密参数。

四、网络爬虫与搜索引擎

首先,搜索引擎的制作离不开网络爬虫,如百度搜索引擎又叫作百度爬虫(BaiduSpider),谷歌搜索引擎又被称为谷歌机器人(Googlebot),而且通用网络爬虫有时候也可以用来指代搜索引擎,是否搜索引擎就是网络爬虫呢?答案是否定的。搜索引擎是一项综合性的技术,网络爬虫是实现搜索引擎的比必不可少的一环,爬虫只为搜索引擎提供数据,除此之外还有建立全文索引,进行倒排文件以及提供查询服务等技术糅合在里边。

除此之外,搜索引擎更关注的是大而全,为大多数用户提供检索服务,所以有些冷门的没有被列入索引的网站就没办法被实时获取到,而网络爬虫则可以通过个人定制,爬取一些搜索引擎关照不到的地方,典型的案例便是深层网络爬虫以及在robots.txt中明确禁止搜索引擎爬取的网站,而理论上开发者编写的网络爬虫可以到达世界上的任何网站。

虽然开发者日常编写的网络爬虫远不及搜索引擎那般复杂与精密,但是却能够让人了解到搜索引擎内部的工作原理。而且搜索引擎也可以看作是日常编写的一个个定向聚焦的网络爬虫聚合而来的,当搜索引擎没办法完成定向的数据搜集工作的时候,编写一个自己的网络爬虫就显得极为重要了。