热门标签

热门文章

- 1在 ARM 架构的 CentOS 上安装 OpenJDK 1.8_jdk1.8 arm

- 2Superset dashboard看板加载性能优化_superset 性能

- 3【微信】竞品分析_微信竞品分析

- 4在自动驾驶中,单线激光雷达能干什么?

- 5读书笔记 摘自:《硅谷钢铁侠:埃隆·马斯克的冒险人生》的笔记(作者: 【美】阿什利·万斯)_硅谷钢铁侠:埃隆·马斯克的冒险人生各章节简述

- 6揭秘AIGC如何助力金融行业软件开发:从需求分析到系统运营

- 7Windows编程bat脚本教程_windows bat脚本

- 8CoordinatorLayout + TabLayout + ViewPager2(里面再嵌套一个RecyclerView),RecyclerView的滑动冲突解决_viewpager2嵌套recyclerview

- 9北京移动CM311-5s-ZG_GK6323V100C_2+8_免拆一键卡刷固件包

- 10花2个月面过阿里测开岗,拿个26K也不算过分吧?_阿里社招测开

当前位置: article > 正文

注意力机制与Transformer_经过注意力机制之后输出的矩阵是什么

作者:AllinToyou | 2024-04-16 10:50:22

赞

踩

经过注意力机制之后输出的矩阵是什么

注意力机制(Attention)

简介

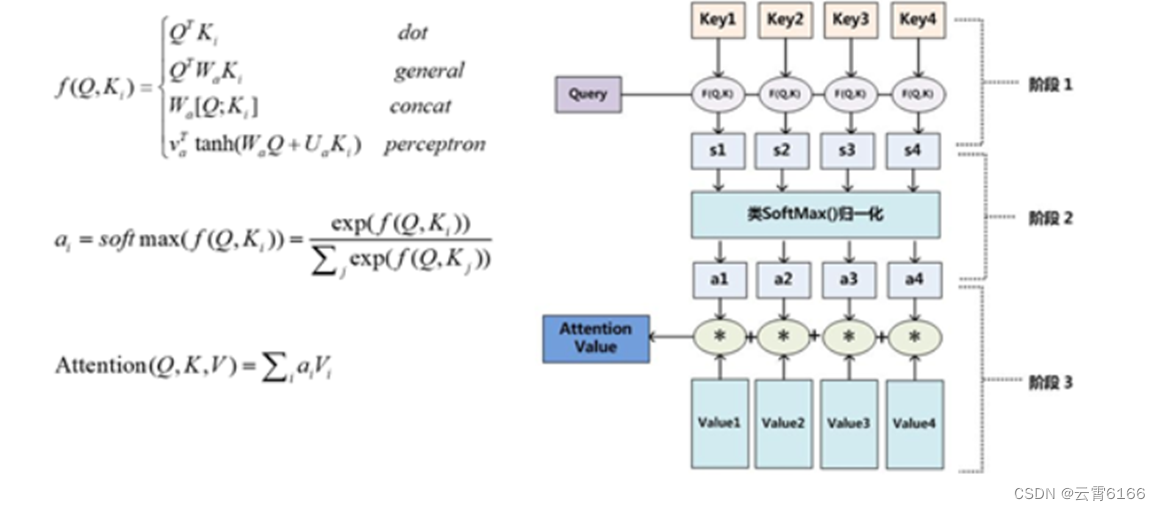

Attention机制可以描述为将一个query和一组key-value对映射到一个输出,其中query,keys,values和输出均是向量。输出是values的加权求和,其中每个value的权重 通过query与相应key的兼容函数来计算。

计算步骤

那么Query,Key,Value是什么意思呢?它们在Attention的计算中扮演着什么角色呢?先看一下Attention的计算方法,整个过程分成7步:

- 如上文,将输入单词转化成嵌入向量;

- 根据嵌入向量得到Q,K,V三个向量;

- 为每个向量计算一个score=Q*K;

- 为了梯度的稳定,Transformer使用了score归一化,即除以√(声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/AllinToyou/article/detail/433731

推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。