热门标签

热门文章

- 1【SAP GUI Scripting】 入门系列(1)_基本设置

- 2记录一次删了开发环境数据库文件恢复的过程!(大部分恢复)_微信开发者工具删除文件恢复

- 3CodeGeeX AI编程助手提升.NET开发工作效率

- 4微信小程序错误提示:readFile:fail parameter error: parameter.filePath should be String instead of Undefined;...

- 5realsense-viewer 不识别 T265——Realsense SDK 在 v2.54.1 版本以后不再支持T265相机的解决办法_realsense viewer

- 6欧拉Linux设置定时备份,免密登录,构建web网站_欧拉系统crontab命令

- 7人生需要注意的事情_苦难守恒定律

- 8Jmeter环境安装(超级简单)

- 9Python 机器学习 基础 之 处理文本数据 【处理文本数据/用字符串表示数据类型/将文本数据表示为词袋】的简单说明

- 10教你玩转微服务--基于DDD的微服务架构落地实践之路_基于 ddd 思想的应用架构 cola 在华为服务研发的落地实践.pdf

当前位置: article > 正文

Ollama接入GLM或Baichuan2等本地LLM模型_ollama glm

作者:AllinToyou | 2024-06-06 06:34:23

赞

踩

ollama glm

安装配置Ollama

下载Ollama二进制文件,直接使用.sh安装网络太卡了,即便是开了代理也卡,故在此使用二进制安装。

sudo curl -L https://ollama.com/download/ollama-linux-amd64 -o /usr/bin/ollama

sudo chmod +x /usr/bin/ollama

- 1

- 2

创建一个用户名为ollama:

sudo useradd -r -s /bin/false -m -d /usr/share/ollama ollama

- 1

创建一个自定义配置文件:

vi Modelfile

- 1

使用vi往里面输入,在此我用的是Baichuan2 13B Chat,为了保险起见采用绝对路径。

FROM /hy-tmp/Models/Baichuan2-13B-gguf/baichuan2-13b-chat.gguf

- 1

启动Ollama(本终端会一直被占用)

ollama start

- 1

新建一个连接终端,跑模型。

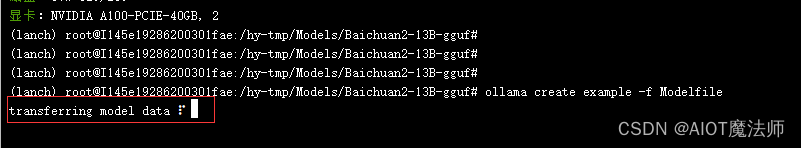

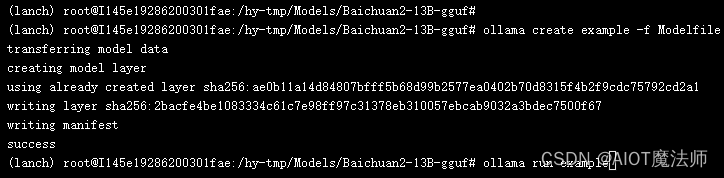

ollama create example -f Modelfile

ollama run example

- 1

- 2

由于我系统盘只有20G加载模型时候报错了,因此我做了一个映射(空间够忽略这条)

#在该路径下有个blobs目录

cd /root/.ollama/models

# 移动 blobs 目录

sudo mv /root/.ollama/models/blobs /hy-tmp/

# 在原来的位置创建一个符号链接我转存到了/hy-tmp/blobs

sudo ln -s /hy-tmp/blobs /root/.ollama/models/blobs

- 1

- 2

- 3

- 4

- 5

- 6

成功的效果图:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/AllinToyou/article/detail/679914

推荐阅读

相关标签