热门标签

热门文章

- 1为什么今年的Java面试很难呢?和前两年相比,你有感觉吗?_java现在面试越来越难

- 2目前已知摄像头的内参矩阵和外参矩阵,已知摄像头画面宽高,某一物体在该画面中的位置坐标,以及该物体中心距离摄像头的距离,求该物体在现实世界中的坐标,用c++实现...

- 35. Windows安全 —— DNS域名解析及WEB服务_windows 域名解析

- 4正确解决java.lang.NoClassDefFoundException (未找到类定义错误)的有效解决方法_exception:java.lang.noclassdefound error thrown fr

- 5git difftool对比差异,避免推送不相关内容_git difftool 版本

- 6树莓派Pi 3B V1.2学习2——GPIO驱动_树莓派3bv1.2

- 7【数据结构】如何创建一棵红黑树(附动图讲解)_构造红黑树

- 8微信小程序开发学习笔记②组件和API_swiper-item :key

- 9Java后端架构技术面试汇总:基础+设计模式+MySQL+分布式+微服务等_java亿级项目架构设计与落地应

- 10FPGA实现的高效CIC滤波器:内插滤波器与数字信号多采样率处理_高效 数字滤波

当前位置: article > 正文

【Ollama】AI大模型本地部署_ollama base url

作者:不正经 | 2024-06-04 22:46:29

赞

踩

ollama base url

Ollama

Ollama轻量级、可扩展的框架,用于在本地机器上构建和运行大型语言模型(LLM)。提供了一个简单的API来创建、运行和管理模型,以及一个预构建模型库,可以轻松用于各种应用程序。

明显优势:易于使用、轻量级、可扩展、预构建模块库

人群价值:研究人员、开发人员、爱好者

应用场景:文本生成、翻译、问答、代码生成

项目优点:易用性、性能、功能、社区

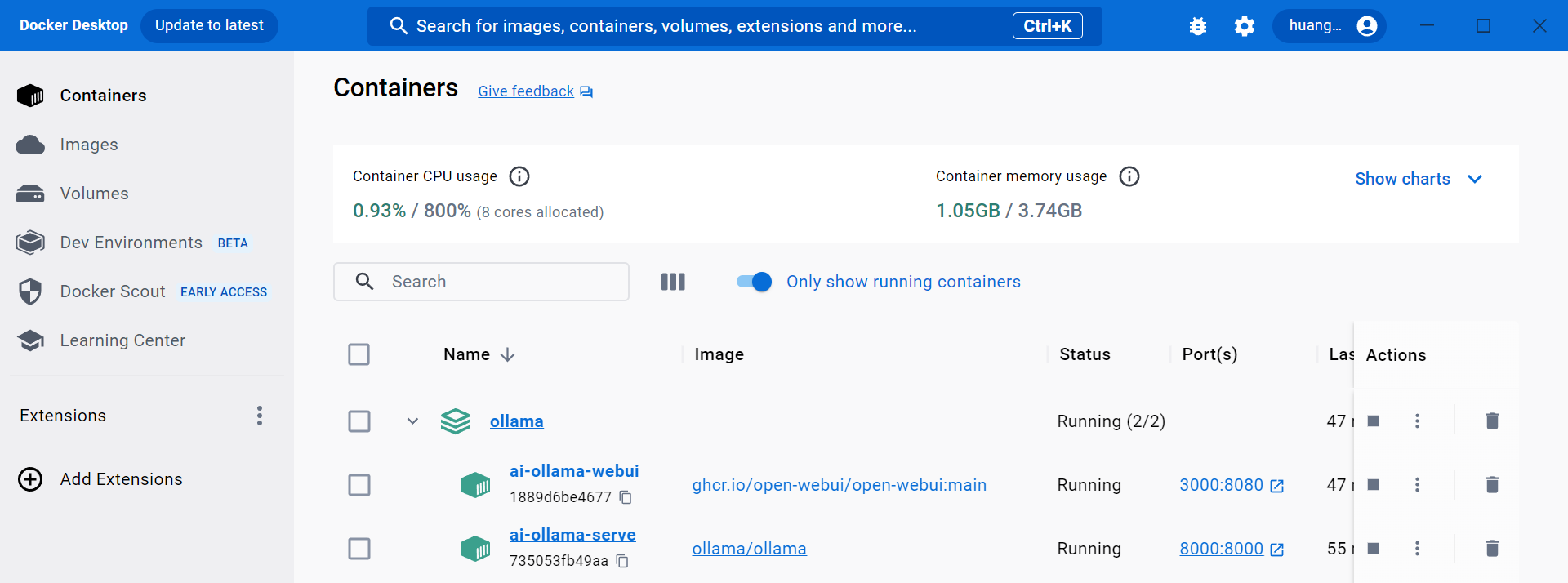

容器

文件

- docker-compose.ollama.yml

version: '3.5' services: ollama: #restart: always container_name: ai-ollama-serve image: ollama/ollama ports: - 8000:8000 environment: - OLLAMA_HOST=0.0.0.0:8000 - OLLAMA_MODELS=/data/models #volumes: # - ./ollama_serve/models:/data/models # 先注释 # 命令启动 serve command: serve ollama-webui: #restart: always container_name: ai-ollama-webui image: ghcr.io/open-webui/open-webui:main ports: - 3000:8080 environment: - OLLAMA_BASE_URL=http://【地址】:8000 #volumes: #- ./ollama-webui/backend/data:/app/backend/data # 先注释 ##################### 使用ollama部署大模型 ##################### # docker-compose -f docker-compose.ollama.yml up -d # OLLAMA_HOST The host:port to bind to (default "127.0.0.1:11434") # OLLAMA_ORIGINS A comma separated list of allowed origins. # OLLAMA_MODELS The path to the models directory (default is "~/.ollama/models") # llama2 | qwen:0.5b-chat | llava | llama2-chinese # https://github.com/open-webui/open-webui#troubleshooting # 拷贝到本地存 # docker cp ai-ollama-serve:/data/models/ ./ollama_serve/models/ # docker cp ai-ollama-webui:/app/backend/data/ ./ollama-webui/backend/

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

运行docker-compose -f docker-compose.ollama.yml up -d

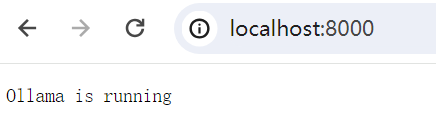

验证

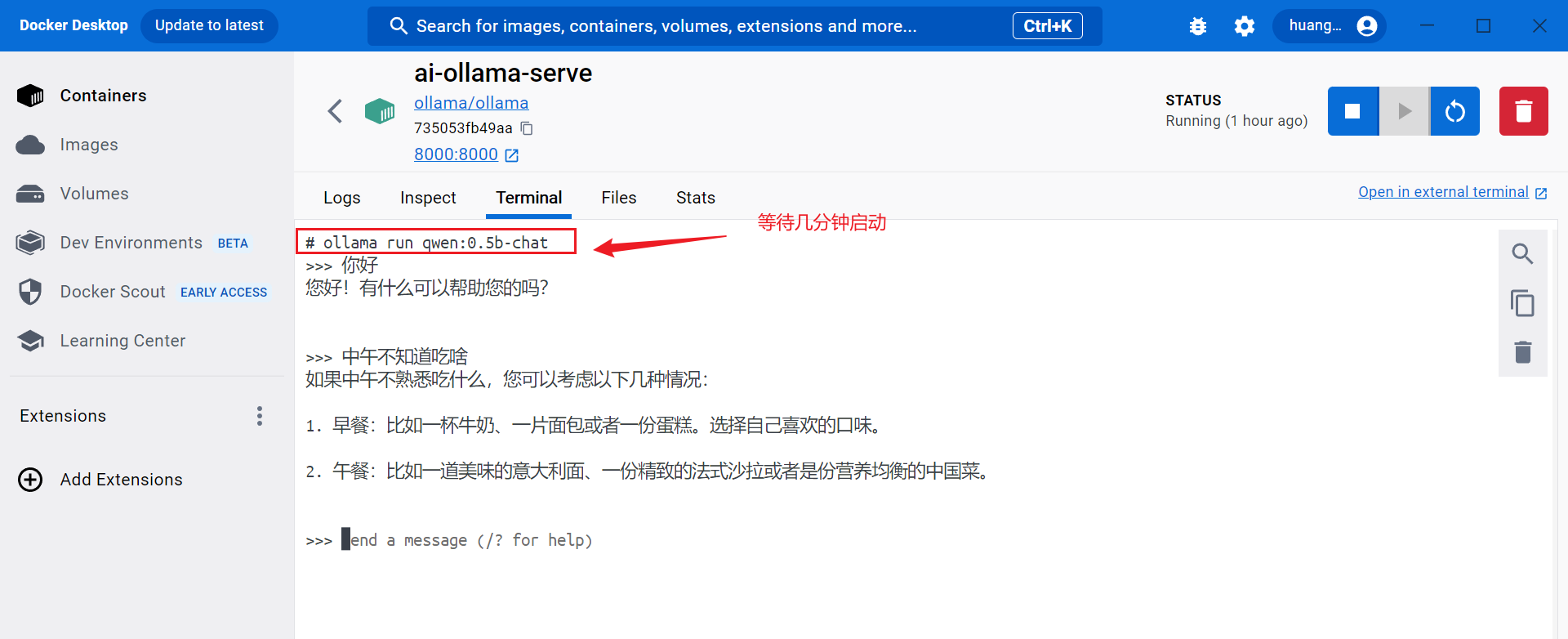

服务端

- 运行

ollama run qwen:0.5b-chat

- 1

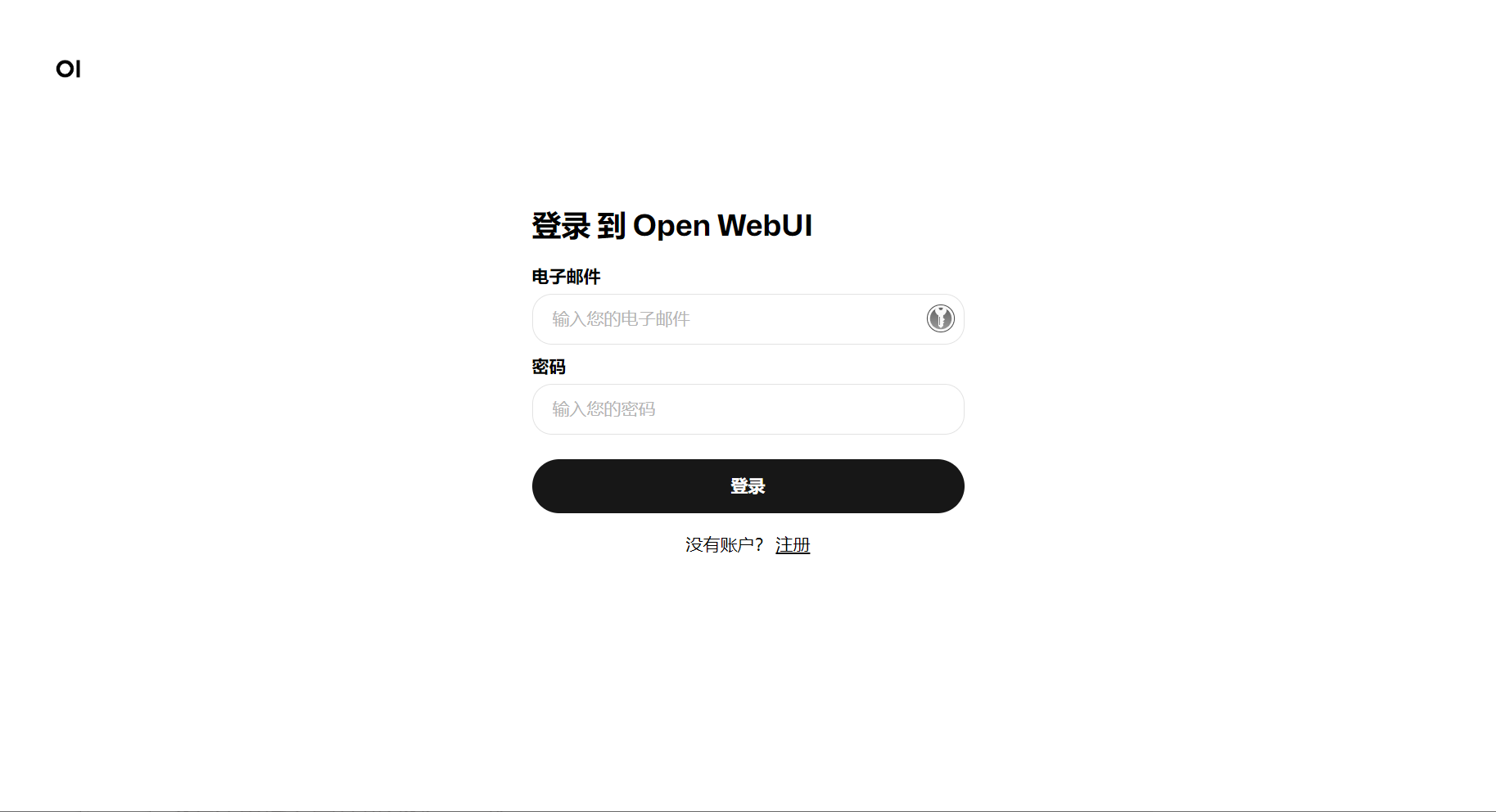

网页端

使用

快捷

https://ollama.com

https://ollama.com/library/qwen

https://github.com/open-webui/open-webui

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/不正经/article/detail/673830

推荐阅读

相关标签