- 1java datainputstream_Java中DataInputStream的用法

- 2M1安装JDK_macos m1安装jdk8

- 3渗透测试中powershell基础_(new-object system.net.webclient).downloadfile

- 4【玩转幻兽帕鲁】一键迁移本地单人世界(房间)存档上云【腾讯云版】

- 5基于mqtt协议的物联网项目之微信小程序(二)_微信小程序使用mqtt协议

- 6DataFunSummit:2022年数据治理在线峰会:核心内容与学习收获(附大会核心PPT下载)

- 7zabbix自定义监控项、监控内存使用率、监控磁盘使用率并创建图形_zabbix监控磁盘使用率

- 8python基础语法整理汇总,python基础语法菜鸟教程_python语法基础

- 9关系型(MySql)、键值型(Redis)、列型(HBase)、文档型(MongoDB)和图型(Neo4j)数据库优缺点选型对比-《七周七数据库》读书笔记_mongodb、hbase、redis、neo4j数据库对比分析

- 10金三银四面试必看,复盘字节测试开发面试:一次测试负责人岗位面试总结_测试开发岗位面试要求

清华系创企RealAI:独家“隐私保护机器学习”技术,全球首款编译级产品

赞

踩

原创:谭婧

以侵犯隐私的方式处理数据,已属非法行为,违法必究,犯罪分子,瑟瑟发抖。

但数据,作为人工智能(AI)的“石油”,不能简单粗暴一刀切,如何加高数据安全的“围栏”,加厚隐私保护的“盔甲”,是基础中的基础。

数据安全,保护隐私,第一要重视。总有人嬉皮笑脸,觉得丢了数据、隐私没什么。第二要有方法,技术得跟上。宏观层面,“算法可靠、数据安全和应用可控”,早已提上日程。

纯聊技术,哪些方法可以破解?

答案是“隐私保护机器学习技术”。技术背后的道理很朴素。从数据中“走”出来的信息,既能够完成模型训练,又不能丢失、泄露、互换数据,暗地里搞些见不得人的事情,从而保护了隐私。

有了安全的技术,很多以前失控的事情,都变得可控起来。比如,在AI模型训练时,用于AI模型训练的数据不能交换,留在原地不动。但是AI模型的信息在多个地方交换。为AI算法模型性能提高,提供了“养分”。

AI模型性能越高,越“聪明”,越“智能”。

“隐私保护机器学习”技术有啥特点?

特点一,异地恋。(“多个地方”也就是必须用分布式算法和系统。)

特点二,保镖傍身。(请了“密码学”做保镖,传输模型参数以加密的方式进行,算法设计方法的根本变化是密码学参与。)

如此一来,这一技术是桃园三结义。分布式、密码学与人工智能三者强强联手,清华学霸就是喜欢挑战高难度技术,无难题,不兴奋。

对了,是不是应该把这一技术叫做“分布式隐私保护机器学习”?

不是,因为隐私保护机器学习必然包含了分布式技术。

所以,前缀再加分布式,就重复了。

(注释:隐私保护机器学习并不是一个全新的概念,类似的术语还包括联邦学习,但为了强调隐私保护的理念,文章中我们使用隐私保护机器学习一词。)

当业界都在讨论,“强监管下的数据应用”会不会造成“数据用不了”,AI没了数据,人工智能变人工智障,怎么办?

在2020年最后一个月,清华系学霸创企RealAI利刃出鞘——推出一个名叫“RealSecure”的隐私保护机器学习平台。

此处应有掌声,大约持续三分钟。

现阶段,隐私保护的AI算法和系统的开发与部署有很多难题,因为隐私保护机器学习的技术、开发者、生态都大不相同。

换句话说,就算有不少机器学习的积累,也甭想立刻上马“隐私保护机器学习”技术。

这一点没有撸起袖子,干隐私保护的企业,是感觉不到的。

更糟的是,也没有什么别国经验可以借鉴,国外企业一出事,要么动辄高额罚金,要么股价异动,被人声讨。如果“对不起”有用,那要警察干啥。

先遣部队,总是最先遭遇最大火力的狙击战。

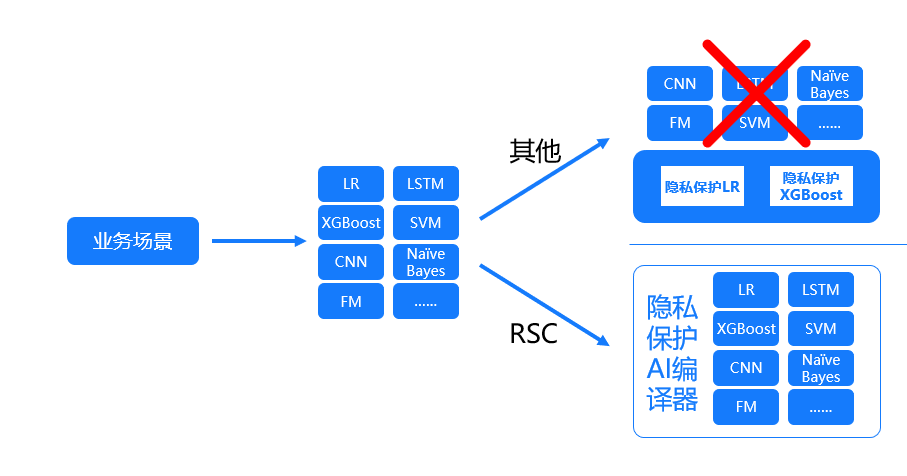

一般人能看到的表象是,将AI的各类算法被改写成的隐私保护的专属算法,比如XGboost算法改写成联邦XGboost算法,堆算法工程师的人力,用手工逐个改写模型,有可能还需要重新组建一支专门做隐私保护机器学习的团队。

本质上,已有的AI方法论和隐私保护AI技术并不能天然复用。换句话说,虽然都是AI技术,但是隐私保护机器学习是融合多学科的,密码学、AI算法,还有通信。

一个普通的AI算法工程师,想要够到隐私保护机器学习技术,需要对这些学科知识都有所掌握。

一号难题,少量的模型改写工作是有进展,但是效率慢。

二号难题,开源平台有一定的支持,但是范围有限。

这些困难无法解决,也就意味着隐私学习技术的大规模商业化落地,道(hao)长(wu)且(xi)阻(wang)。

困境都看到了,重点在于,谁来解决?又怎么解决?

隐私保护AI编译器架构在这种背景下应运而生,官方说法是:“这是一种编译器级别的隐私保护机器学习工具。”

那么问题又来了,为什么要从编译器层面入手呢?

计算机常识告诉我们,计算机编译器承担着集成电路机器码(二进制)和代码的底层“翻译”工作。

深入编译器层面,更易对“以隐私保护为目的”的底层技术的革新。

那是不是从数量和规模上,编译器就成了“计算机技术革新的入口”?当然不是,因为编译器技术是非常有难度的底层技术,有了金刚钻才敢揽瓷器活儿。

我们接着聊革新,宋朝人笑了。中国四大发明,三个都诞生于宋代。

北宋仁宗庆历年间,毕昇发明了一种更进步的印刷方法——活字印刷术,把我国的印刷技术大大提高了一步。

四方长柱体胶泥制字,一字为一印,一个个汉字印可以理解为一个个“算子”,算子盘就是活字库。

算子盘里可以实现灵活的组合,用来适配多种多样的机器学习算法公式,这样就有了一个解决通用性的好抓手。

有了算子盘,隐私保护机器学习,从“雕版印刷”,迈向了“活字印刷”。

RealAI CEO 田天说:“这个名叫‘RealSecure’的隐私保护机器学习平台,其实是一个‘活字印刷版’的隐私保护机器学习平台。”

越是底层技术,对上层建筑物的影响越大。近千年前发明活字印刷,繁荣华夏文化,宋体到现在仍在使用,可见其影响力。

底层编译器做得好,上层自动化空间大,就容易出现意想不到的优化效果。因为编译是一个自动翻译和自动优化的技术。

“隐私保护AI编译器”是从商业角度出发的一种定义,本质是:调优、分布式、加密工作自动完成。

一个能称得上“独家”技术的产品,肯定不会只有一门绝活。

官方的产品逻辑是:隐私保护AI编译器架构,以“数据流图”,可视化算法计算逻辑,针对不同算法可实现自动编译生成,最终,实现数据隐私安全性的自动验证。

想要说人话,得这样表达。

要保护隐私,传出去的消息一定要经过“武林高手”的保护。多方安全计算、密码学都是武林高手,且还有个共同点,练功讲究排场,消耗非常大,也就是“代价大”。

消耗大,就得有一把尺子,来衡量全盘得失,清华学霸科学家就给“尺子”起了个名字,叫做“计算代价”。

数据流图如何工作,很依靠这套闭关“七七四十九天”自研顿悟出的量化机制。

计算代价包括什么呢?

其一,加密的代价。

其二,通信的代价。

其三,本地计算代价。

把隐私保护机器学习的过程拉成一幅清明上河图,画家在找地方,在哪画有北宋特色的地标性建筑?科学家也在找地方,在找“哪里需要加密?”

需要加密的地方是数据泄露的风险点。高危地点,得亮起猩红色刺眼的信号灯。

以前,都是科学家用人脑来判断信号灯的位置。比如哪一部分是A执行,哪一部分B 执行,A到B该不该加密,该怎么加密……RealAI CEO田天认为,这个过程得自动化,不能光靠人,得靠编译器的判断。

机器依靠“计算代价”的“成绩单”,来做决定。

这个决定,是整体判断,因为是一个整体调度的过程。只有编译器级别技术才有资格从调度的角度去思考问题。

所以,隐私保护AI编译器来了。

在很多人还在实验室里埋头苦写隐私保护AI编译器论文,这帮清华AI学霸,已经把产品推向市场了。

业务团队和销售团队接过研发团队的接力棒,冲向需要隐私保护地方,准备一展身手。

RealAI技术和产品的自信都来自底层技术栈。RealAI CEO田天告诉《亲爱的数据》:“RealAI的AI技术优势不是产品规模与知识产权的数量,而是底层技术栈优势。”

“底层”是技术发力点,“栈”意味着积累。

从技术角度来看,这个从底层技术栈中喷薄而出的,解决问题的“神器”是RealSecure,它的核心是隐私保护AI编译器架构。

我们细看一下,隐私保护AI编译器还有哪些自研的秘密?答案是,数据流图。

以前的思路是,密码学专家协助证明隐私保护机器学习模型的安全性,但也有槽点:“你的代码那么长,让专家审核,专家敢对安全负全责吗?”

专家的判定是非标准化的,但是标准化更稳定,更容易解决信任问题。

有了数据流图,过程清晰可见,在隐私保护里,可以成为一种标准。有了标准,不用把证明安全性的大山压在专家身上。

大家都带着数据流图去展示,相当于用同一套语言去沟通,就可以证明或者说更容易获得安全方面的信任,容易达成共识。

这里的“大家”是指,隐私保护机器学习各方。

怎么建AI模型,就怎样建隐私保护机器学习模型,不用重新学习隐私保护机器学习的建模技术,AI建模的技术与经验照样用。

这里补充数据流图工作的全套过程,学渣可跳读:

首先,整体生成数据流图,再对其进行分析,再判断潜在的数据泄露风险点,并根据性能模型计算每个操作符在每个参与方的计算代价。

以计算代价最小的方案,得到每个操作符执行方的方案,即切图过程,这也是模型分布式计算的过程。

“自动完成以隐私保护为目的的模型并行”,这句话并不简单。“自动”这个动作,需要“专家级别的知识”,是以安全计算专家知识为驱动的静态自动模型并行。

此处,还得喊一嗓子,分布式带来的“异地恋”问题,解决了。

RealAI CEO 田天讲出了技术突破带来的好处:“广角镜头下,以数据流图的视角揭示机器学习算法与分布式隐私保护机器学习算法的联系,有助于实现两种算法生态的一体化。”

AI技术用单兵深入的打法已经越来越难,平台产品是一个趋势。

那么,什么样的平台产品才能帮到隐私保护的数据生态?

其一,完善、安全、便利的拉通方式,

其二,服务不同行业(业务)、不同类型、不同维度的数据,

其三,很高的性能,速度上不去,技术天天拖业务的后腿。

能同时解决这三个问题的技术路线,可谓一条“少有人走的路”。

RealSecure隐私保护机器学习平台能从计算基础设施的硬件层,系统平台层和应用软件层三个层面全方位发力。

市场上,AI产品通常定位SaaS或者PaaS,最多下沉到硬件的优化,而隐私保护和数据安全类的产品的天然属性设计,会渗透到SaaS、PaaS、IaaS所有层面。

首先,RealSecure隐私保护机器学习平台,从软件层面上,可以看做是SaaS产品。

再者,从所有数据具有决定性意义的产业生态层面上,可以看做是PaaS产品,能提供一个数据生态平台。

从企业数据化转型发展一定基于数据能力的层面,又可以定义为IaaS级别的产品,具有极强的基础设施属性,安全责任渗透在计算架构的所有层面。

最后,RealAI CEO 田天也提道:

“我们采用的技术路线目前已经可以支持抗量子攻击,属于底层技术栈的优势”。由于涉及企业商业机密,这次产品发布会没有详细解释抗量子攻击的技术与产品内容。

(完)

这里还有个注释,别错过:

谷歌在这一领域也有涉足,在大名鼎鼎的深度学习框架TensorFlow的基础上,搭建的TF-Encrypted(Python软件包),它绑定了“秘密共享(secret-share)”这一多方安全计算技术,作为底层支持。

准确地讲,TF-Encrypted属于绑定应用级的实现。RealSecure产品有秘密共享技术、全同态加密、半同态加密等底层密码学技术。在实现上,RealSecure产品更侧重中间层的流图展示级实现。

总体来说,“TF-Encrypted”和“RealSecure隐私保护机器学习平台”不可以放在同一个层面上比较。

你还可以看:

2.世间可有“最低订单IT成本”? 京东颜伟鹏的《善战兵法》:

3.揭秘AI 公司盈利“生意经”,竹间智能CEO简仁贤的AI产品化和工程化

随手点赞(这里应该有一个小桃心)

主编微信号:18611208992