热门标签

热门文章

- 1 高并发架构系列:Kafka、RocketMQ、RabbitMQ的优劣势比较 ...

- 2车载以太网自动化测试套件(SOME/IP)- AETP. TC8 SOME/IP

- 3深度学习-大模型LLM-微调经验分享&总结_大模型llm同时做实体和关系抽取

- 4实时数仓-Flink使用总结_flink实时开发平台

- 5【3DGS】从新视角合成到3D Gaussian Splatting_σ′ = jwσw j

- 6PostgreSQL索引(一)_pgsql 索引

- 7IDEA 连接mysql_driver class 'com.mysql.cj.jdbc.driver' not found

- 8嵌入式之Qt开发_qt嵌入式开发

- 9androidstudio旧版本下载_android studio 旧版本下载

- 10AI大模型探索之路-训练篇21:Llama2微调实战-LoRA技术微调步骤详解

当前位置: article > 正文

HADOOP集群搭建, HDFS简易配置_hdfs搭建

作者:Gausst松鼠会 | 2024-05-27 21:53:36

赞

踩

hdfs搭建

概念:

HADOOP在多计算机集群环境中营造一个统一而稳定的存储和计算环境。

Hadoop Distributed File System (HDFS)

主节点:Master NameNode

从结点:Slave DataNode

配置

前提:安装好mysql和java环境

需要配置静态ip

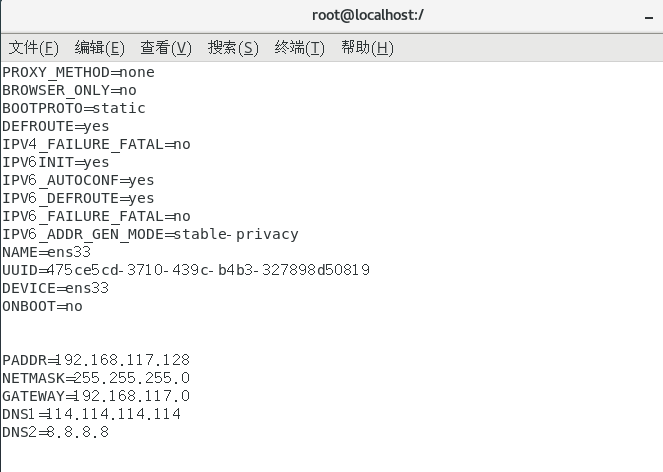

vim /etc/sysconfig/network-scripts/ifcfg-ens33

- 1

把bootproto改为static

在最下面加入如下内容

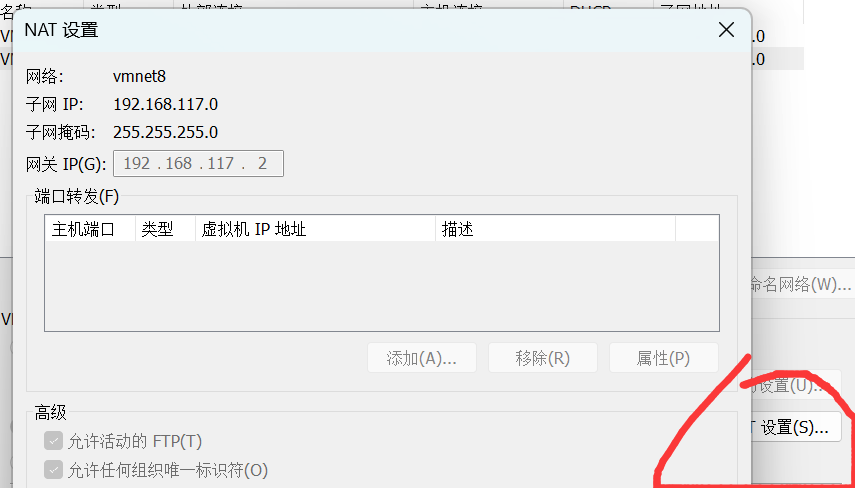

IPADDR=192.168.70.100 这里修改为你的ip

NETMASK=255.255.255.0

GATEWAY=192.168.70.2 这里修改为你的网关

DNS1=114.114.114.114

DNS2=8.8.8.8

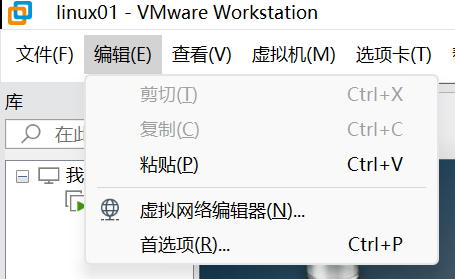

ip和网关可以在如下地方查看

这样就ok了

HDFS配置

官网下载tar包,并上传tar包至服务器

解压tar包

tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module

- 1

进入配置文件路径,修改配置文件

cd /opt/module/hadoop-3.1.3/etc/hadoop

- 1

vim hadoop-env.sh

- 1

JAVA_HOME=/opt/module/jdk1.8.0_212

- 1

2>

vim core-site.xml

- 1

在configuration添加内容

<!-- 指定NameNode的地址 --> <property> <name>fs.defaultFS</name> <value>hdfs://192.168.70.100:9000</value> </property> <!-- 指定hadoop数据的存储目录 --> <property> <name>hadoop.tmp.dir</name> <value>/opt/module/hadoop-3.1.3/data</value> </property> <!-- 配置HDFS网页登录使用的静态用户为root --> <property> <name>hadoop.http.staticuser.user</name> <value>root</value> </property> <!-- 配置该root(superUser)允许通过代理访问的主机节点 --> <property> <name>hadoop.proxyuser.root.hosts</name> <value>*</value> </property> <!-- 配置该root(superUser)允许通过代理用户所属组 --> <property> <name>hadoop.proxyuser.root.groups</name> <value>*</value> </property> <!-- 配置该root(superUser)允许通过代理的用户--> <property> <name>hadoop.proxyuser.root.groups</name> <value>*</value> </property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

注意: hdfs://192.168.70.100:9000 ip需修改为你自己的

3>

vim hdfs-site.xml

- 1

增加如下内容

<!-- nn web端访问地址-->

<property>

<name>dfs.namenode.http-address</name>

<value>192.168.70.100:50070</value>

</property>

<!-- 2nn web端访问地址-->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>192.168.70.100:50090</value>

</property>

<!--副本数的配置-->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

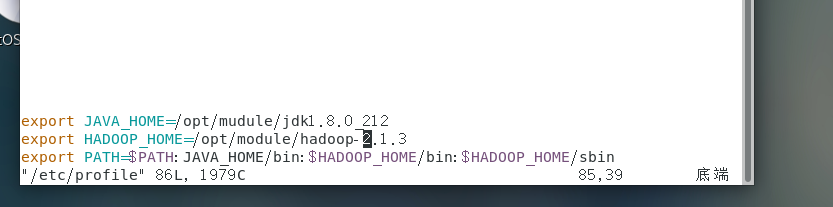

配置hadoop环境变量

vim /etc/profile

- 1

source /etc/profile

- 1

初始化集群

hdfs namenode -format

- 1

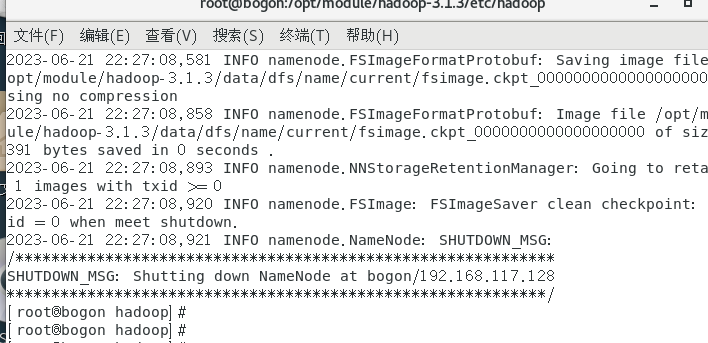

初始化完成

启动配置

配置ssh免密登录

cd /root

ssh-keygen

- 1

- 2

分发钥匙

ssh-copy-id 192.168.117.128

- 1

输入yes和密码

ssh-copy-id localhost

- 1

启动Hadoop

start-dfs.sh //此时应当在hadoop的目录

- 1

注意:如果想root用户启动,需在配置文件添加如下内容

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

- 1

- 2

- 3

- 4

- 5

后续依然要source

source /etc/profile

- 1

可以看到启动成功

访问web端也是正常打开

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Gausst松鼠会/article/detail/634233

推荐阅读

相关标签