热门标签

热门文章

- 1天津中医药大学全新的毕业设计题目推荐50例

- 2浅谈Android实现圆形头像效果的几种思路和方法_安卓 自定义圆形头像,展示长方形图像

- 3linux arm 相机,基于ARM和LINUX的嵌入式CCD相机采集系统研究

- 4【软件安装故障排除】安装完PyCharm,启动时弹出“Failed to load JVM DLL\bin\server\jvm.dll“解决方案

- 5Spring Boot整合actuator实现监控管理

- 6【自动驾驶传感器融合系列】01自动驾驶中常用的传感器_目标跟踪的传感器有哪些

- 7ethers.js常用的操作方法

- 8深度学习在自闭症谱系障碍神经成像诊断和康复中的应用_aal图集

- 9初学者入门|一文带你读懂Kubernetes_kubemetes是由apache基金会发起,也是当前非常流行容器管理平台,它不仅仅想管理容

- 10【python】时间与时间戳互相转换_python 时间戳转换

当前位置: article > 正文

2.3k Star!腾讯又悄悄地开源了一款音频驱动的真实肖像动画合成框架!_开源 语音驱动的视频生成技术

作者:Guff_9hys | 2024-07-14 20:01:55

赞

踩

开源 语音驱动的视频生成技术

图像和视频处理技术的发展日新月异,每时每刻都在变化,都在进步,也激发了各大研究人员和AI实验室的创造力和可能性。

而近日发现了一款开源项目: AniPortrait,可以实现肖像到视频的生成。看开源作者标注机构是Tencent,它又一次悄摸摸的开源了一款AI项目。

该项目仅上线不到一周,即揽获了2.3k Star。相当的爆火了。

项目介绍

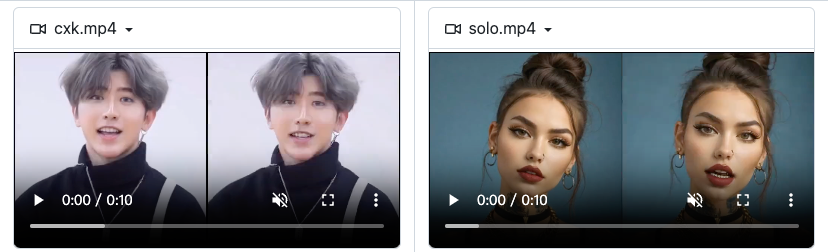

AniPortrait 是一个由音频驱动的真实肖像动画合成框架,能够生成高质量的面部动画,并提供人脸再现功能。

GitHub:https://github.com/Zejun-Yang/AniPortrait

通过使用多种预训练模型,包括 StableDiffusion V1.5、sd-vae-ft-mse、image_encoder和wav2vec2-base-960h,该项目实现了从音频和参考肖像图像驱动的高质量动画生成。

通过提取音频中的3D中间表现形式并转换为2D面部标志,进而利用扩散模型和运动模块生成逼真且时间上连贯的肖像动画。

重点功能:

-

自我驱动的视频生成

-

面部再现

-

音频驱动的视频生成

使用方法

通过下载官方项目包,并完成python环境和cuda相应版本的安装。

下载好项目依赖的预训练模型,然后根据自己的需求输入相关指令生成。具体可查看项目文档。

应用场景

AniPortrait 框架在计算机视觉、模式识别、图形学以及图像和视频处理等多个学科领域具有广泛的应用前景。

其优越的面部动画生成能力可在影视制作、虚拟人物设计、面部运动编辑等领域发挥重要作用。

总结

AniPortrait 的推出为音频驱动的真实肖像动画合成领域注入了新的活力,展现了出色的技术实力和创新能力。

其强大的功能和广泛的应用前景使其成为当前数字图像处理领域的一项重要工具。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Guff_9hys/article/detail/826153

推荐阅读

相关标签