- 1深度对比 Delta、Iceberg 和 Hudi 三大开源数据湖方案_hive acid hudi

- 2Spark底层原理:案例解析(第34天)

- 3字节跳动测开岗,4面都过了,HR告诉我被刷在这个地方...._字节跳动四面还会被拒吗

- 4软件测试课堂作业+期末整理【超实用】_作一个机票价格计算软件,针对不同购票类别有不同的折扣方式。 购票日期:当天购票,

- 5如何把本地项目上传关联远程仓库码云/github_项目关联别的码云仓库

- 6关于ESP8266+OLED显示网络天气+天气图标,我掉进过的一些坑_基于stm32f的esp8266时钟 +oled

- 7具有大数据+数据开发+数据分析+算法工作经验的面试简历

- 8【随笔】Git 高级篇 -- 分离 HEAD(十一)_git head

- 9项目的成功离不开齐心协力,项目的失败只需怠工_,没有你们的配合,就没有项目的成功

- 10monkey测试shell脚本_monkey脚本

免费!快速!干货!手把手教你如何在个人电脑上搭建你自己的大模型服务!_ollama

赞

踩

大模型发展如火如荼,虽然大模型的能力强大,但是大模型也是非常昂贵的!不管是训练还是推理,都需要耗费大量的机器,而且机器的硬件资源,比如GPU、TPU等都有一定的要求。 因此,业界的同行们,最近半年很多人和组织都在研究如何将大模型轻量化,最极端的情况就是可以在个人电脑上训练、部署大模型。本文基于这个目的,手把手给你们演示一下如何在个人笔记本电脑上安装大模型,并进行基础的大模型问答推理。通过本文,你可以意识到:其实大模型并没有想象中的那么神秘,个人也可以轻松搭建。

今天要分享的在本地大件大模型服务的方法,就是使用上面这个开源项目Ollama,如今已经达到了6.7万颗星。

Ollama如今已经支持Mac和linux两个系统,windows正在开发中。我的个人电脑是Mac OS系统的(以下演示步骤都是在本笔记本电脑上亲自进行),系统配置如下:

一、Ollama简介

Ollama官网:https://ollama.com/

Ollama的GitHub地址:https://github.com/ollama/ollama

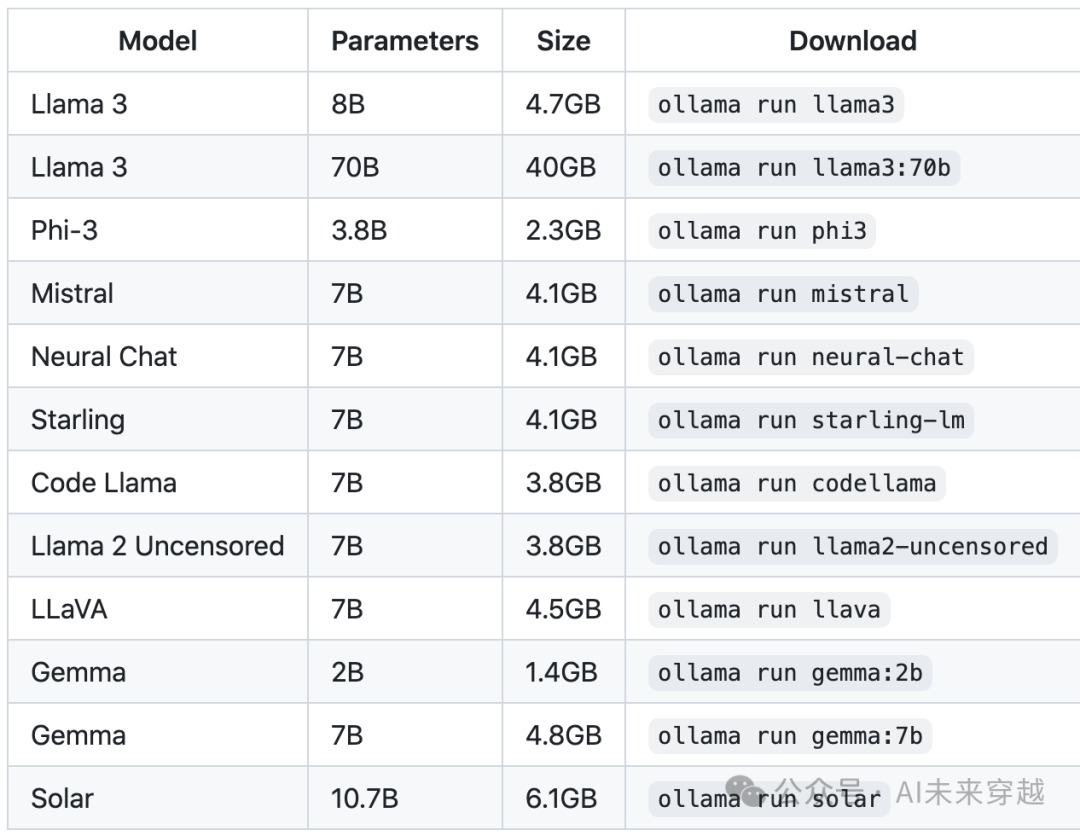

Ollama是一个“支持在本地快速部署大模型服务”的解决方案,目前已经支持了很多开源的大模型,如下图所示,其中包括了Meta开源的最知名的大模型Llama,其他比如Mistral等也是享誉业内:

Ollama的核心能力主要包括两个,从而才能让你轻松在本地部署大模型服务:

- 简化、优化大模型参数配置,做到一键部署

- 使用向量技术优化大模型推理性能,让大模型在本地的推理性能也能接受

二、安装Ollama

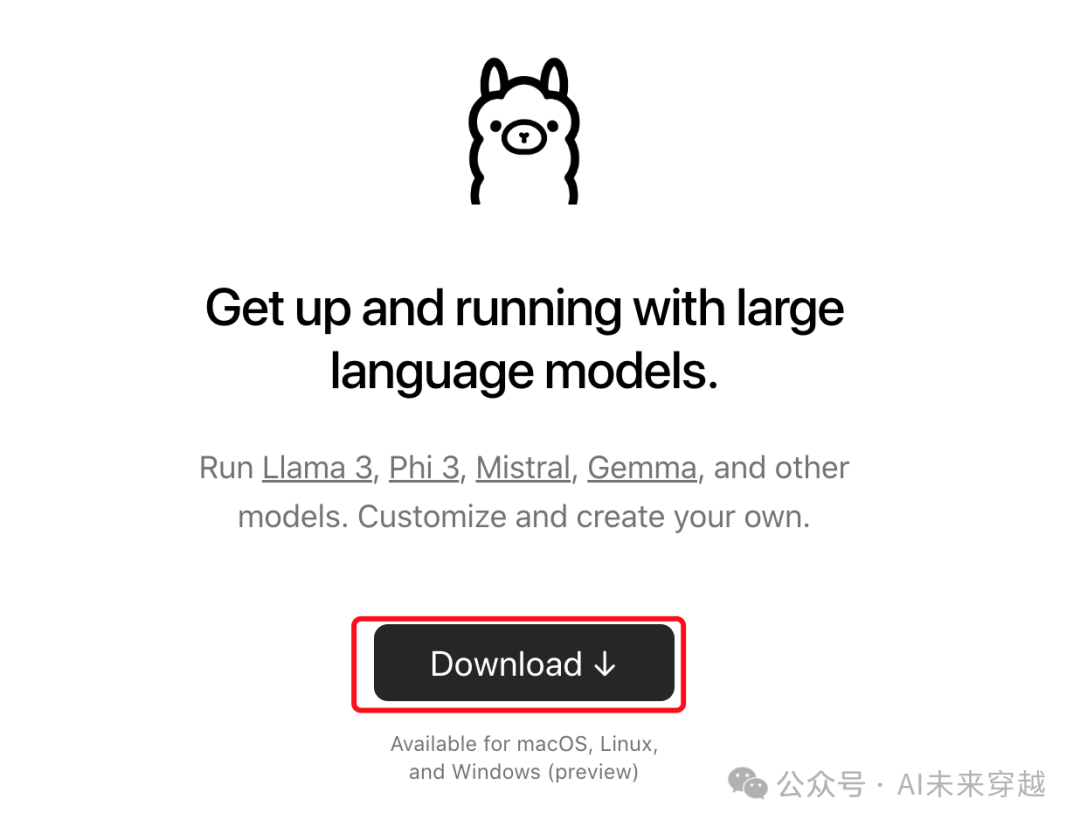

首先从官网下载Ollama安装包。

下载下来的是一个压缩包,解压之后,双击ollama的图标,进行安装

三、下载免费大模型

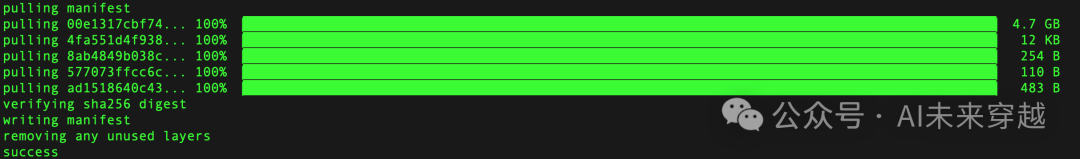

命令行执行命令:ollama pull llama3

模型总大小为4.7G,下载时间取决于你的网速。正常情况下最多十几分钟就可以下载完毕。

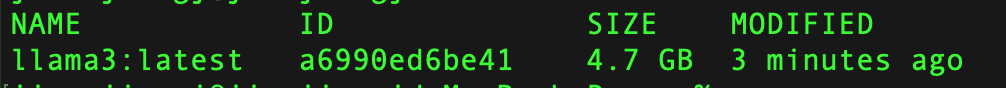

查看已经下载的大模型列表:ollama list

我这里演示的是下载最强大的开源大模型llama3,你也可以根据你的需要选择其他的大模型,比如Mistral。

四、启动大模型服务

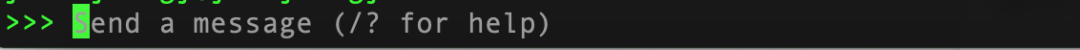

命令行执行命令:ollama run llama3

启动成功之后,会出现如下的提示词,你可以输入你想要问的问题,大模型会通过推理给出回答。

五、使用本地大模型服务

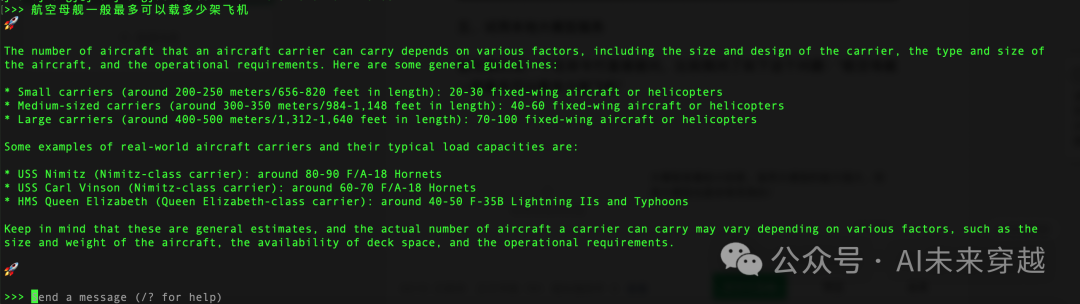

首先我们试一下在命令行直接提问。

比如我问了如下这个问题:“航空母舰一般最多可以载多少架飞机”

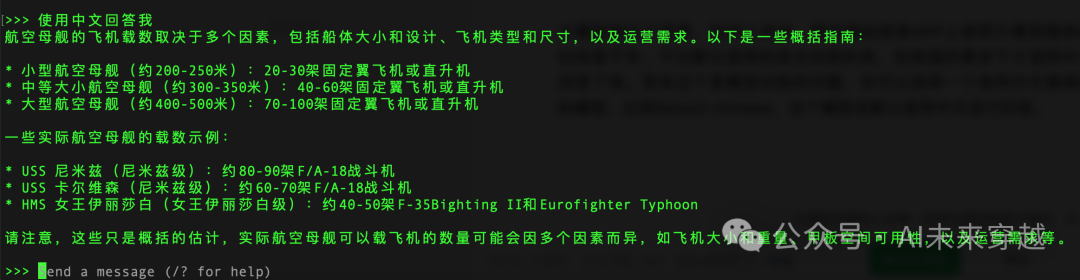

大模型给出了答案,时间上来讲,跟在网站或者APP上使用大模型服务的时间差不多。不过默认使用的英文回答的我,在我强烈要求下才使用中文回答了我。其实这个是模型训练的问题,你可以选择一个使用中文微调过的模型,比如llama2-chinese,这个模型会默认使用中文进行回答。

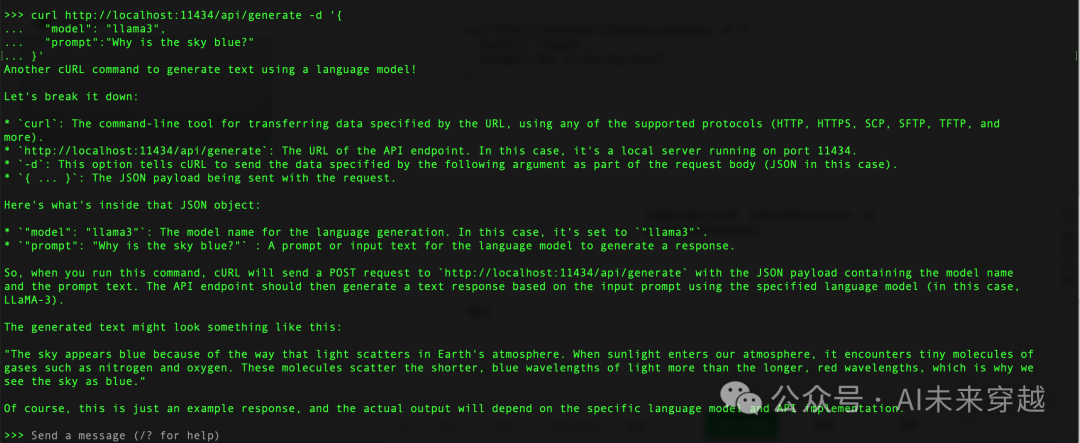

除了使用命令行工具,你还可以使用REST API进行调用。

curl http://localhost:11434/api/generate -d '{ "model": "llama3", "prompt":"Why is the sky blue?"}'

- 1

REST API输出的内容,是一段格式化文本,你可以自己写一个简单的python程序,就可以解析出来了。当然,如果你的python程序可以对外提供问答服务,那么你就相当于在本地轻松搭建出一个大模型服务出来了。

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。