- 1iOS开发 Objective-C 免越狱 iPhone手机 无需电脑 七天证书 个人证书 和 企业证书 代码签名 签名ipa 重签ipa

- 2关于DDD设计模式的各种疑问:什么是DDD架构?

- 3【InternLM 实战营第二期笔记】XTuner 微调个人小助手认知

- 4西门子PLC S7-1200程序实例,西门子1200与安川机器人TCP IP通讯_安川机械手与外部plc通讯

- 5关于蓝桥杯的乱七八糟的话(经验、心得、建议、技巧)_蓝桥杯可以带纸质资料吗

- 6基于深度学习的计算机视觉研究新进展

- 7数据结构 栈-链栈及基本操作

- 8Android Studio安装和设置SDK、Gradle(国内源)、AVD下载目录详细教程_android studio sdk

- 9【机器学习】在Python中使用交叉验证进行SHAP解释

- 10【Java】jdk1.8 Java代理模式,Jdk动态代理讲解(非常详细,附带class文件)

k8s网络通信_有什么插件可以虚拟网卡,2024年最新揭秘ARouter路由机制

赞

踩

kind: Deployment

metadata:

name: demo2

spec:

replicas: 3

selector:

matchLabels:

app: myapp

template:

metadata:

labels:

app: myapp

spec:

containers:

- name: myapp

image: myapp:v2

- 1

- 2

[root@server2 ~]# kubectl delete -f demo.yml

[root@server2 ~]# kubectl apply -f demo.yml

[root@server2 ~]# kubectl get svc

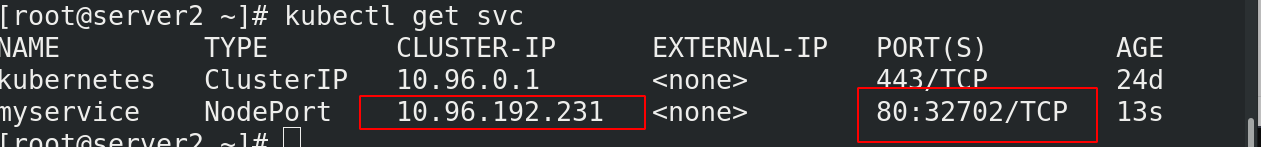

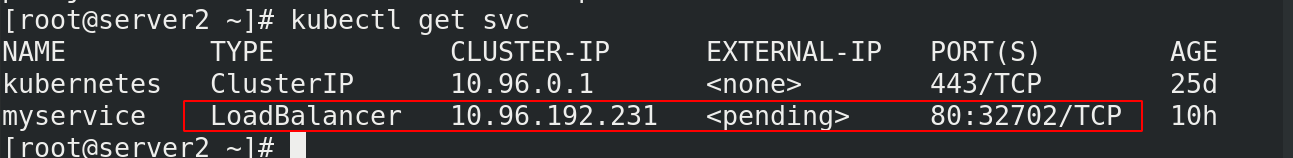

在ip的基础上又加了一个端口  ### 4. LoadBalancer 类型的 Service 从外部访问 Service 的第二种方式,适用于公有云上的 Kubernetes 服务。这时候,你可以指定一个 LoadBalancer 类型的 Service。 在service提交后,Kubernetes就会调用 CloudProvider 在公有云上为你创建一个负载均衡服务,并且把被代理的 Pod 的 IP地址配置给负载均衡服务做后端。 将刚才的demo.yml中的类型变成LoadBalancer即可 由于我们使用的不是共有云,所以暂时不能实现,EXTERNAL-IP显示的是pending等待分配ip状态  ### 5 service允许为其分配一个公有IP 在ClusterIP的基础上,给绑定了一个外部地址,在外部可以直接访问

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

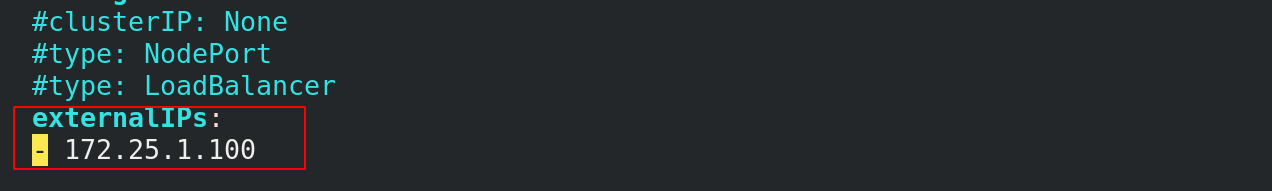

[root@server2 ~]# vim demo.yml

externalIPs:

- 172.25.1.10

在外部主机可以通过这个ip进行访问

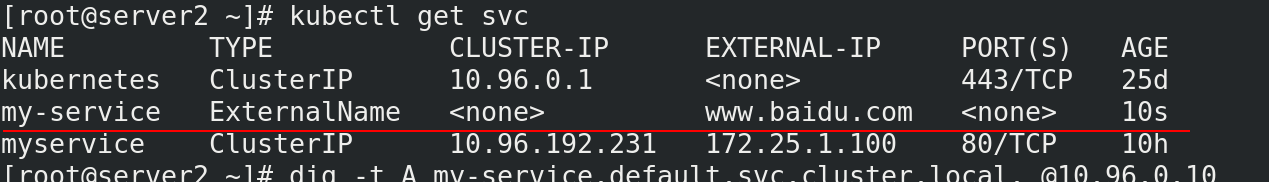

### 6 ExternalName

从外部访问的第三种方式叫做ExternalName

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

[root@server2 ~]# vim my-service.yml

apiVersion: v1

kind: Service

metadata:

name: my-service

spec:

type: ExternalName

externalName: www.baidu.com

两种验证方式:

- 1

- 2

- 3

- 4

- 5

- 6

[root@server2 ~]# dig -t A my-service.default.svc.cluster.local. @10.96.0.10 #dig

[root@server2 ~]# kubectl attach demo1 -it #进入交互测试

## 三、(pod间通信)Flannel 网络 Flannel vxlan模式跨主机通信原理  (1)VXLAN,即Virtual Extensible LAN(虚拟可扩展局域网),是Linux本身支持的一网种网络虚拟化技术。VXLAN可以完全在内核态实现封装和解封装工作,从而通过“隧道”机制,构建出覆盖网络(Overlay Network)。 (2)VTEP:VXLAN Tunnel End Point(虚拟隧道端点),在Flannel中 VNI的默认值是1,这也是为什么宿主机的VTEP设备都叫flannel.1的原因。 (3)Cni0: 网桥设备,每创建一个pod都会创建一对 veth pair。其中一端是pod中的eth0,另一端是Cni0网桥中的端口(网卡)。 (4)Flannel.1: TUN设备(虚拟网卡),用来进行 vxlan 报文的处理(封包和解包)。不同node之间的pod数据流量都从overlay设备以隧道的形式发送到对端。 (5)Flanneld:flannel在每个主机中运行flanneld作为agent,它会为所在主机从集群的网络地址空间中,获取一个小的网段subnet,本主机内所有容器的IP地址都将从中分配。同时Flanneld监听K8s集群数据库,为flannel.1设备提供封装数据时必要的mac、ip等网络数据信息。 ### flannel网络原理 当容器发送IP包,通过veth pair 发往cni网桥,再路由到本机的flannel.1设备进行处理。 VTEP设备之间通过二层数据帧进行通信,源VTEP设备收到原始IP包后,在上面加上一个目的MAC地址,封装成一个内部数据帧,发送给目的VTEP设备。 内部数据桢,并不能在宿主机的二层网络传输,Linux内核还需要把它进一步封装成为宿主机的一个普通的数据帧,承载着内部数据帧通过宿主机的eth0进行传输。 Linux会在内部数据帧前面,加上一个VXLAN头,VXLAN头里有一个重要的标志叫VNI,它是VTEP识别某个数据桢是不是应该归自己处理的重要标识。 flannel.1设备只知道另一端flannel.1设备的MAC地址,却不知道对应的宿主机地址是什么。在linux内核里面,网络设备进行转发的依据,来自FDB的转发数据库,这个flannel.1网桥对应的FDB信息,是由flanneld进程维护的。 linux内核在IP包前面再加上二层数据帧头,把目标节点的MAC地址填进去,MAC地址从宿主机的ARP表获取。 此时flannel.1设备就可以把这个数据帧从eth0发出去,再经过宿主机网络来到目标节点的eth0设备。目标主机内核网络栈会发现这个数据帧有VXLAN Header,并且VNI为1,Linux内核会对它进行拆包,拿到内部数据帧,根据VNI的值,交给本机flannel.1设备处理,flannel.1拆包,根据路由表发往cni网桥,最后到达目标容器。

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

[root@server2 ~]# kubectl get pod -n kube-system

相同主机之间的pod通过cni通信  在server3上要先知道目标主机(server4)eth0的IP和mac地址    arp -n 可以查看到有server4的ip信息。  ### flannel支持多种后端 Vxlan * vxlan //报文封装,默认 * Directrouting //直接路由,跨网段使用vxlan,同网段使用host-gw模式。 host-gw://主机网关,性能好,但只能在二层网络中,不支持跨网络,如果有成千上万的Pod,容易产生广播风暴,不推荐 UDP: //性能差,不推荐 #### host-gw主机网关 修改配置flannel:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

[root@server2 ~]# kubectl -n kube-system edit cm kube-flannel-cfg

生效:

- 1

- 2

- 3

- 4

- 5

- 6

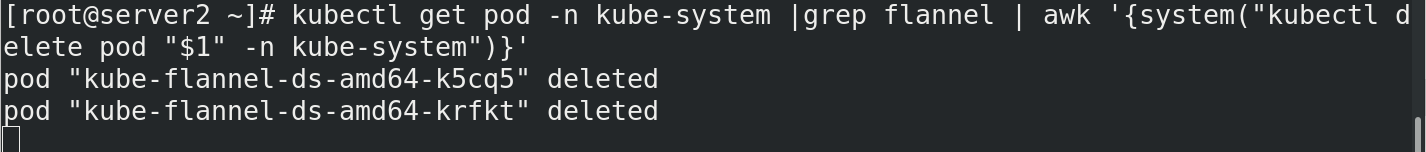

[root@server2 ~]# kubectl get pod -n kube-system |grep flannel | awk ‘{system(“kubectl delete pod “$1” -n kube-system”)}’

从下图我们可以看出本地的话直接走cni,如果是1,0网段的直接走网关etho

#### vxlan

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

[root@server2 ~]# kubectl -n kube-system edit cm kube-flannel-cfg

“Type”: “vxlan”,

“Directrouting”: true

[root@server2 ~]# kubectl get pod -n kube-system |grep flannel | awk ‘{system(“kubectl delete pod “$1” -n kube-system”)}’

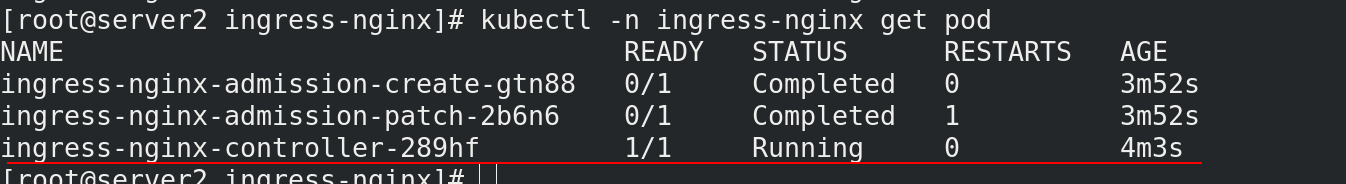

并没有经过flannel.1  ## 四、Service与集群外部客户端的通信(Ingress 服务) * 一种全局的、为了代理不同后端 Service 而设置的负载均衡服务,就是 Kubernetes 里的Ingress 服务。 * Ingress由两部分组成:Ingress controller和Ingress服务。 * Ingress Controller 会根据你定义的 Ingress 对象,提供对应的代理能力。业界常用的各种反向代理项目,比如 Nginx、HAProxy、Envoy、Traefik 等,都已经为Kubernetes 专门维护了对应的 Ingress Controller。  官网:[ingress-nginx]( ) 下载镜像并上传到本地仓库,镜像下载需要翻墙 所需的资源链接: [yaml文件和镜像]( ) 提取码: nbvc ### Ingress 服务部署:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

[root@server1 ~]# docker load -i ingress-nginx.tar

[root@server1 ~]# docker tag quay.io/kubernetes-ingress-controller/nginx-ingress-controller:0.33.0 reg.westos.org/library/nginx-ingress-controller:0.33.0

[root@server1 ~]# docker tag jettech/kube-webhook-certgen:v1.2.0 reg.westos.org/library/kube-webhook-certgen:v1.2.0

[root@server1 ~]# docker push reg.westos.org/library/nginx-ingress-controller:0.33.0

[root@server1 ~]# docker push reg.westos.org/library/kube-webhook-certgen:v1.2.0

[root@server2 ~]# mkdir ingress-nginx/

[root@server2 ~]# cd ingress-nginx/

[root@server2 ingress-nginx]# kubectl apply -f deploy.yaml

[root@server2 ingress-nginx]# kubectl get ns

[root@server2 ingress-nginx]# kubectl get all -n ingress-nginx

### 创建Ingress服务

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

[root@server2 ~]# vim nginx.yml

apiVersion: networking.k8s.io/v1beta1

kind: Ingress

metadata:

name: ingress-demo

spec:

rules:

- host: www1.westos.org

http:

paths:- path: /

backend:

serviceName: myservice

servicePort: 80

[root@server2 ~]# kubectl apply -f nginx.yml

- path: /

做好地址解析:   用DaemonSet结合nodeselector来部署ingress-controller到特定的node上,然后使用HostNetwork直接把该pod与宿主机node的网络打通,直接使用宿主机的80/443端口就能访问服务。 * 优点是整个请求链路最简单,性能相对NodePort模式更好。 * 缺点是由于直接利用宿主机节点的网络和端口,一个node只能部署一个ingress-controller pod。 比较适合大并发的生产环境使用。  ### Ingress TLS 加密配置

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

生成证书:

[root@server2 ingress-nginx]# openssl req -x509 -sha256 -nodes -days 365 -newkey rsa:2048 -keyout tls.key -out tls.crt -subj “/CN=nginxsvc/O=nginxsvc”

导入证书:

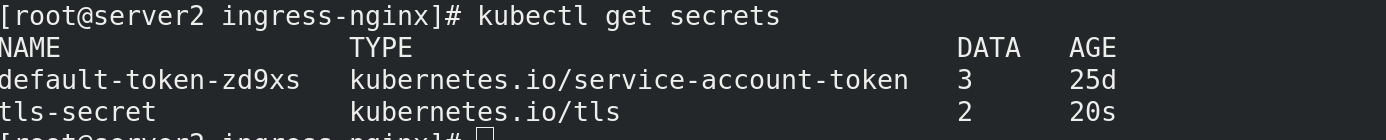

[root@server2 ingress-nginx]# kubectl create secret tls tls-secret --key tls.key --cert tls.crt

查看证书:

[root@server2 ingress-nginx]# kubectl get secrets

生效:

- 1

- 2

- 3

- 4

- 5

- 6

[root@server2 ingress-nginx]# vim tls.yml

apiVersion: networking.k8s.io/v1beta1

kind: Ingress

metadata:

name: nginx-test

spec:

tls:

- hosts:

- www1.westos.org

secretName: tls-secret

rules:

- host: www1.westos.org

http:

paths:

- path: /

backend:

serviceName: myservice

servicePort: 80

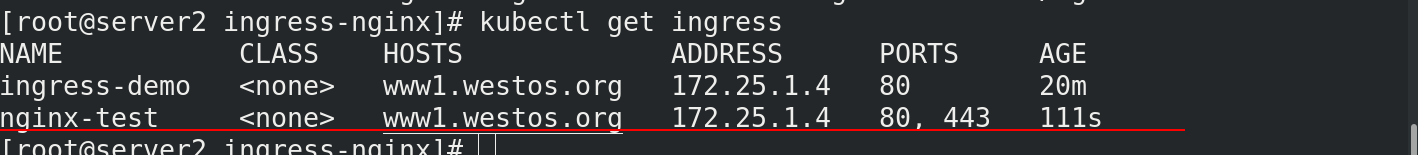

[root@server2 ingress-nginx]# kubectl apply -f tls.yml

[root@server2 ingress-nginx]# kubectl describe ingress nginx-test

[root@server2 ingress-nginx]# kubectl get ingress

### 认证

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

[root@server2 ingress-nginx]# yum install httpd-tools.x86_64 -y

[root@server2 ingress-nginx]# htpasswd -c auth sun

[root@server2 ingress-nginx]# kubectl create secret generic basic-auth --from-file=auth

- 1

- 2

- 3

- 4

- 5

[root@server2 ingress-nginx]# vim tls.yml

annotations:

nginx.ingress.kubernetes.io/auth-type: basic

nginx.ingress.kubernetes.io/auth-secret: basic-auth

[root@server2 ingress-nginx]# kubectl apply -f tls.yml

[root@server2 ingress-nginx]# kubectl apply -f nginx.yml

### Ingress地址重写

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

vim tls.yml

apiVersion: networking.k8s.io/v1beta1

kind: Ingress

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

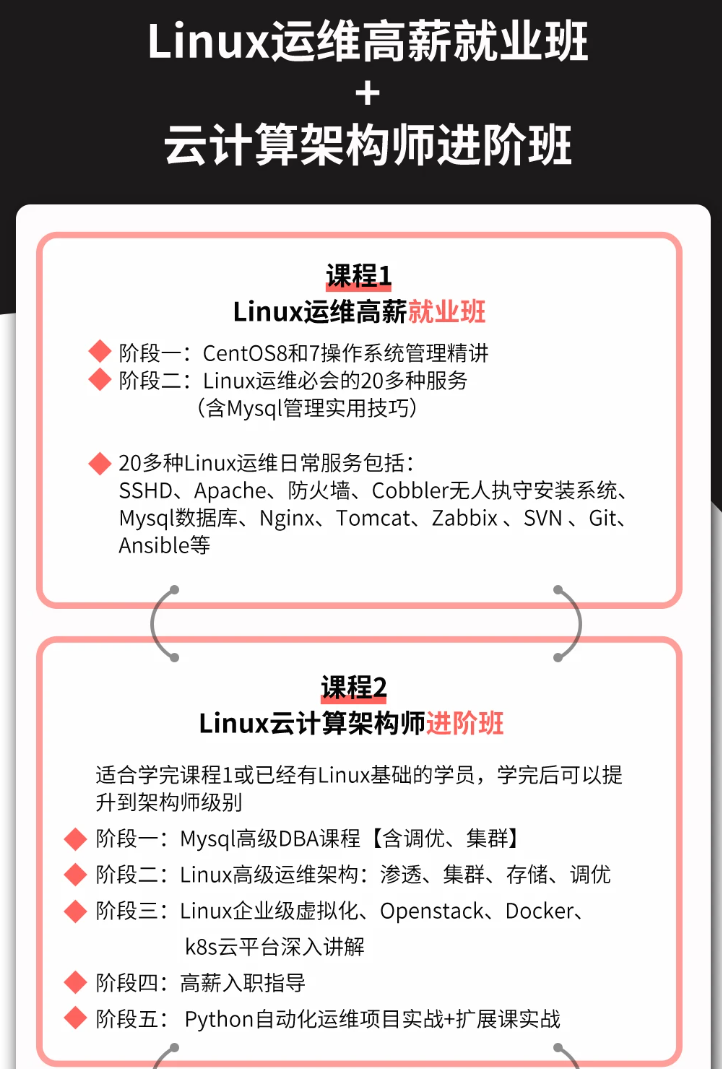

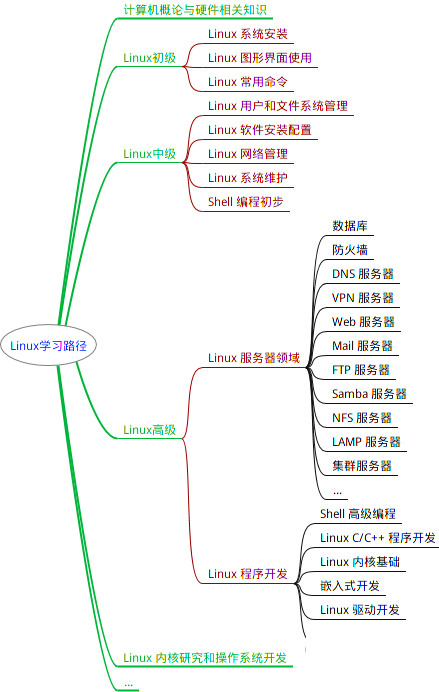

深知大多数Linux运维工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Linux运维知识点,真正体系化!

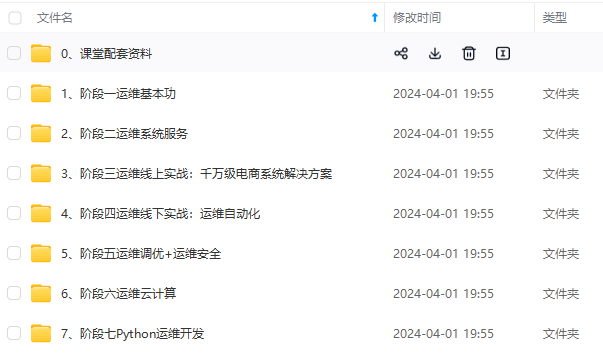

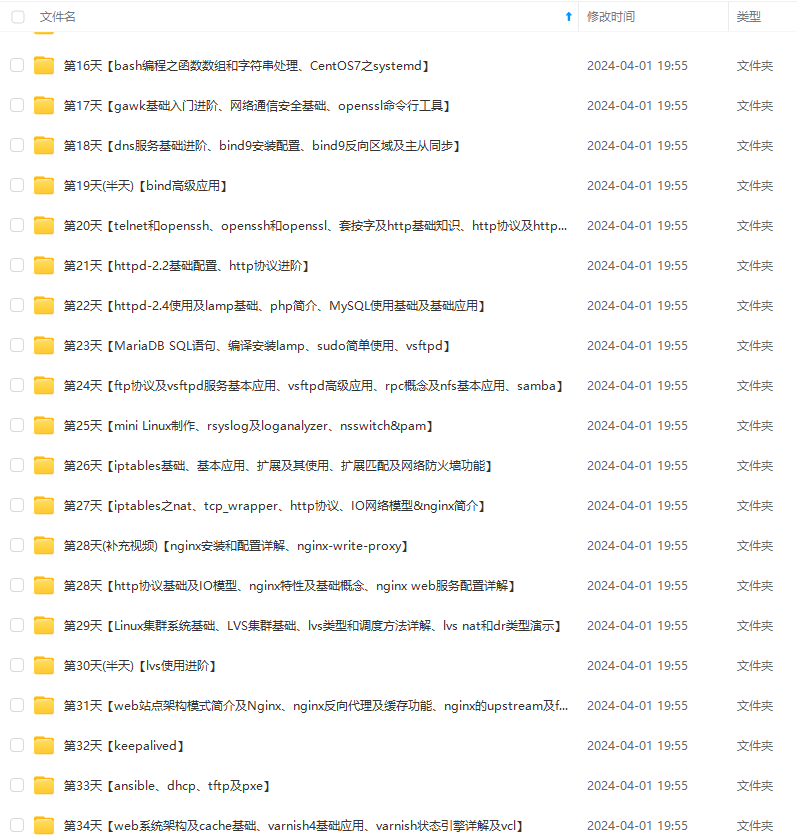

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip1024b (备注Linux运维获取)

最全的Linux教程,Linux从入门到精通

======================

-

linux从入门到精通(第2版)

-

Linux系统移植

-

Linux驱动开发入门与实战

-

LINUX 系统移植 第2版

-

Linux开源网络全栈详解 从DPDK到OpenFlow

第一份《Linux从入门到精通》466页

====================

内容简介

====

本书是获得了很多读者好评的Linux经典畅销书**《Linux从入门到精通》的第2版**。本书第1版出版后曾经多次印刷,并被51CTO读书频道评为“最受读者喜爱的原创IT技术图书奖”。本书第﹖版以最新的Ubuntu 12.04为版本,循序渐进地向读者介绍了Linux 的基础应用、系统管理、网络应用、娱乐和办公、程序开发、服务器配置、系统安全等。本书附带1张光盘,内容为本书配套多媒体教学视频。另外,本书还为读者提供了大量的Linux学习资料和Ubuntu安装镜像文件,供读者免费下载。

本书适合广大Linux初中级用户、开源软件爱好者和大专院校的学生阅读,同时也非常适合准备从事Linux平台开发的各类人员。

需要《Linux入门到精通》、《linux系统移植》、《Linux驱动开发入门实战》、《Linux开源网络全栈》电子书籍及教程的工程师朋友们劳烦您转发+评论

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

下载。

本书适合广大Linux初中级用户、开源软件爱好者和大专院校的学生阅读,同时也非常适合准备从事Linux平台开发的各类人员。

需要《Linux入门到精通》、《linux系统移植》、《Linux驱动开发入门实战》、《Linux开源网络全栈》电子书籍及教程的工程师朋友们劳烦您转发+评论

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

[外链图片转存中…(img-EqmKHbp7-1712957199815)]