- 1【redis】Redis命令行命令基本操作详解_命令行操作redis

- 2tensorflow2报错AttributeError: module ‘tensorflow‘ has no attribute ‘variable_scope‘_partially initialized module 'tensorflow' has no a

- 3第15届全国大学生智能汽车竞赛 人工智能挑战赛(百度)_智能车竞赛需要学什么

- 4实验过程演示【计算机网络实验】

- 5OpenHarmony开发实战:深入了解开发版-RK3568_鸿蒙开发 rk3568

- 6浅谈电力行业网络安全与防护_电网信息安全防护

- 7预测模型搭建和评估(基本操作)_python预测模型

- 8蓝易云:Ubuntu系统版本和架构查询方法

- 9BERT模型系列大全解读

- 10用RSA加密实现Web登录密码加密传输

Linux平台利用Ollama和Open WebUI部署大模型_open webui 如何添加模型_ollama linux 配置多并发多模型

赞

踩

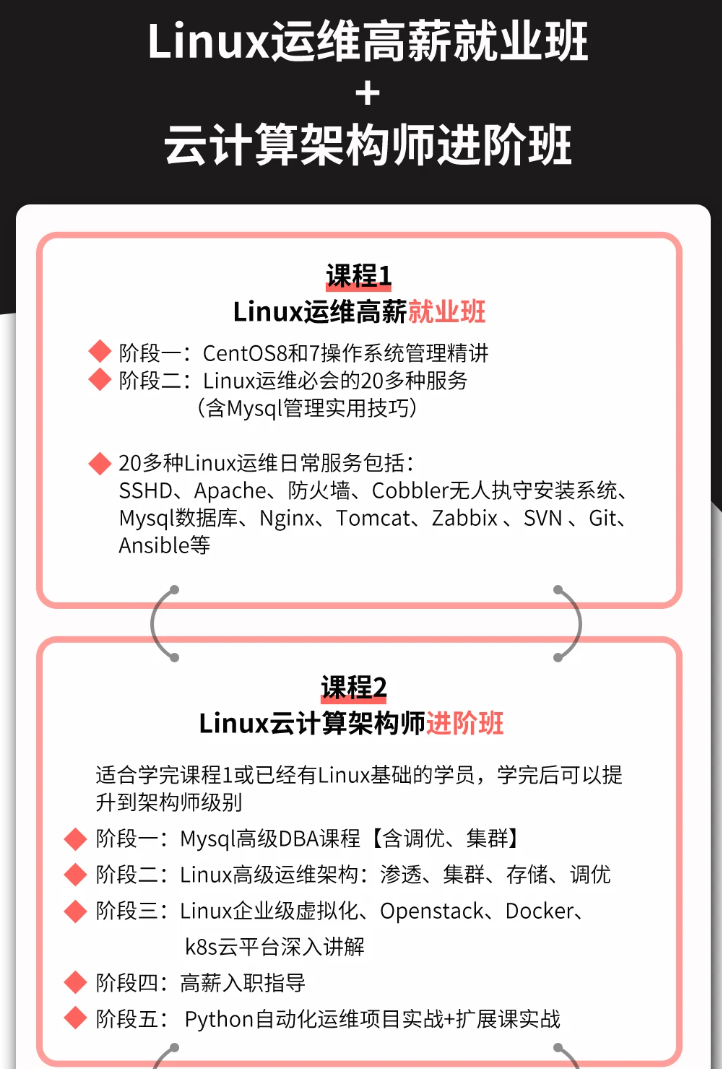

先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前在阿里

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!

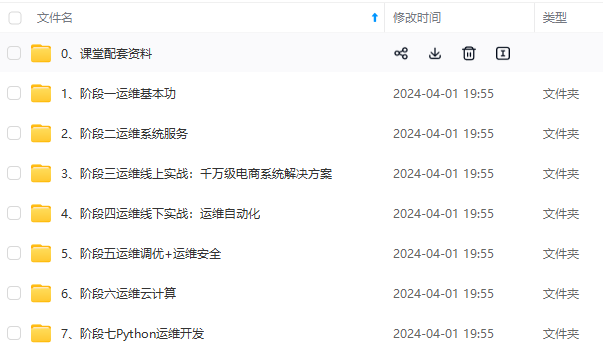

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

前言

在当今的人工智能领域,部署大型深度学习模型是一个挑战,尤其是对于那些不熟悉复杂技术栈的用户而言。然而,随着开源技术的不断发展,出现了一些强大的工具,如 Ollama 和 Open WebUI,使得部署大型模型变得更加简单和高效。

Ollama 是一个功能强大的开源平台,专门用于部署深度学习模型。

与此同时,Open WebUI 是一个开源的 Web 用户界面工具,为用户提供了友好的界面来与 Ollama 平台进行交互。通过 Open WebUI,用户可以直观地浏览模型的性能指标、调整模型参数,并进行部署和监控。

本文将介绍如何利用 Ollama 和 Open WebUI 在 Linux 平台上部署大型深度学习模型。通过简单的步骤,您将能够快速搭建起一个高效的模型部署环境

一、Ollama 安装

Ollama 的安装步骤如下:

- 安装 Docker:

首先,确保您的系统已经安装了 Docker。您可以按照 Docker 官方文档提供的指南来安装 Docker:https://docs.docker.com/get-docker/

2. 拉取 Ollama 镜像:

打开终端或命令提示符,运行以下命令来拉取 Ollama 镜像:

docker pull ollama/ollama

- 1

- 2

这将从 Docker Hub 上下载 Ollama 的最新版本。

3. 运行 Ollama 容器:

运行以下命令来启动 Ollama 容器:

docker run -d --restart=always -v /home/docker/ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

- 1

- 2

这将在后台运行一个名为 “ollama” 的容器,并将 /home/docker/ollama 目录挂载到容器内的 /root/.ollama 目录,同时将容器内的端口 11434 映射到宿主机的端口 11434。

4. 访问 Ollama Web 界面:

打开您的浏览器,并访问 http://localhost:11434(如果您的 Docker 守护进程运行在远程主机上,则将 localhost 替换为相应的 IP 地址)。您将会看到 Ollama 的 Web 界面,通过它您可以开始构建、训练和部署深度学习模型。

通过按照以上步骤,您将能够在您的系统上成功安装和运行 Ollama。请注意,确保您的系统满足 Docker 的要求,并且具有足够的存储空间来存储 Ollama 容器中的数据。

二、Open WebUI 安装

要使用 Docker 安装 Open-webui,您可以创建一个 Docker 容器,并在其中运行 Open-webui 服务。以下是安装 Open-webui 的步骤:

- 拉取 Open WebUI 镜像:

首先,您需要从 Docker Hub 上拉取 Open WebUI的镜像。在终端或命令提示符中运行以下命令:

docker pull openwebui/open-webui

- 1

- 2

- 运行 Open WebUI 容器:

使用以下命令在容器中运行 Open WebUI 服务:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

42503)**

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!