【AI绘画Stable Diffusion进阶】室内设计神器:ControlNet MLSD/Seg 实现令人惊叹的视觉转换

赞

踩

前言

你是否已经厌倦了传统的室内设计方式,想探索新方法来增强作品设计感?本期小编就同大家分享一个新武器,用Stable Diffusion的ControlNet来打造一个室内设计全新工作流。无论你是经验丰富的室内设计师还是初学小白,都将使你的日常工作如虎添翼、告别爆肝,焕发出令甲方爸爸们赞叹的设计感。

ControlNet将毛坯房照片转换为高清室内装饰效果图

ControlNet介绍

ControlNet是一种通过添加额外条件来控制扩散模型的AI神经网络结构,它提供了一种增强稳定扩散的方法。在文本生成图像的过程中,使用诸如涂鸦、边缘映射、分割映射、pose关键点等条件输入,可使生成图像更接近输入图像,对比传统图像到图像的生成方式有大幅的改进。

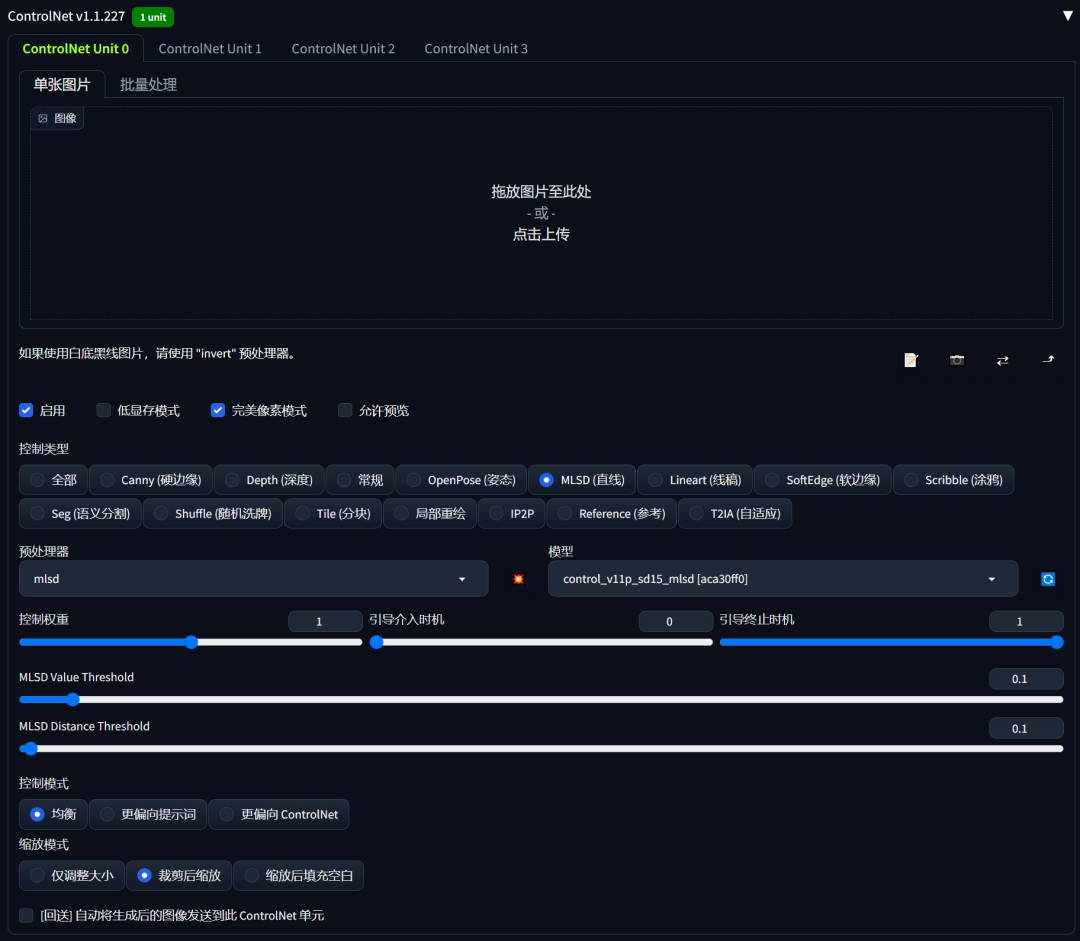

对初识Stable Diffusion的小伙伴们来说,看到ControlNet有这么多预处理器选项,一定很抓狂。

是的,随着ControlNet插件的不断更新,在v1.1.227版本,已经内置了15种预处理器。但没关系,为了方便大家使用,小编对每种预处理器的功能给出了简单的描述,并会在后续的分享中结合实例,演示具体的使用方法:

○ **Canny 硬边缘:**黑色背景带有白色边缘的单色图像;

○ **Depth 深度:**灰度图像,黑色代表深区域,白色代表浅区域;

○ **Normal 常规:**法线图,表示物体的凹凸纹理,常用在3D模型的绘制上;

○ OpenPose 姿态**:**生成角色动作姿态的骨架图;

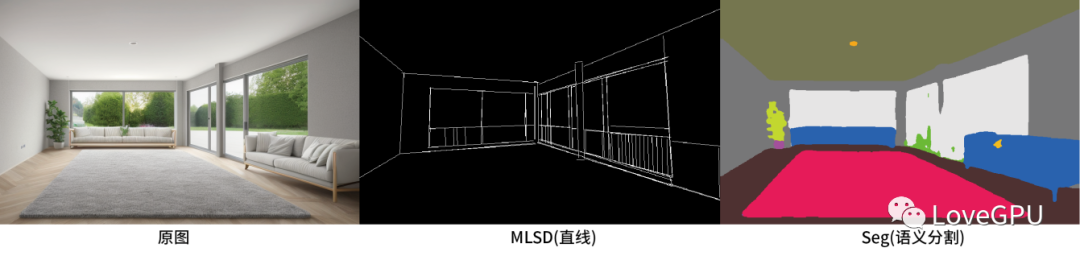

○ **MLSD 直线:**黑色背景上带有白色直线的单色图像;

○ **Lineart 线稿:**黑色背景上带有白色线稿单色图像;

○ **SoftEdge 软边缘:**黑色背景上带有白色软边缘的单色图像;

○ Scribble 涂鸦**:**黑色背景上带有白色轮廓的手绘单色涂鸦图像;

○ **Seg 语义分割:**根据原图中不同素材以相应颜色进行区分的彩色图像;

○ **Shuffle 随机洗牌:**通过使用随机流的方式来洗牌原图像,在控制稳定扩散的前提下重构出新图;

○ **Tile 分块:**将原图分割为一块一块的小区域(Tile/瓦块),然后分别对每个瓦块进行图生图放大,最后集合所有放大后的瓦块,拼成完整的大图;

○ **Inpaint 局部重绘:**用于蒙版部分重绘,能在统一整体效果的前提下,补全蒙版部分的内容;

○ **IP2P 像素对像素指令:**该模型会自动识别像素对应提示词与新输入提示词的关系,并选择性的向新提示词迁移;比如把图片的光照调暗,让白天变为夜晚,在正向提示词中加入(make it night:1.3)、(night:1.3)即可;

○ **Reference 参考:**根据给定的参考图,画同一张图,但是有一定的变化,常用来保持人物角色的一致性;

○ **T2IA 自适应:**提取图片色彩或边缘,用于风格迁移;

到这里小编感觉一定有很多小伙伴们要开始抱怨了,这么多的预处理器,用哪个啊。别担心,本篇中的演示只会运用到两种最具代表性的预处理器,MLSD(直线)和Seg(语义分割),选择它们两个,并按照小编的步骤,即便你只有一张随手拍摄的毛胚房照片,也能完成一副有高级既视感的室内装饰效果图。光看文字有点晦涩,让我们先来看下这两种预处理器的实际效果。

可以看到两种预处理器的处理方式完全不同,接下来就告诉大家具体的使用步骤。

如果你也对此插件感兴趣的话,可以点击声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/IT小白/article/detail/963049?site

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。