- 1第一篇csdn博客 -------个人简介_博客个人简介

- 2mesa LLVMpipe ORCJIT 上游化:一场历时两年的后端合并马拉松,幕后英雄竟是 TA!_llvm和mesa

- 3波动数列 蓝桥真题_蓝桥杯 波动数列 python

- 4RAG 检索增强生成有效评估_rag检索测试数据集

- 5python--石头剪刀布游戏(列表)_pycharm剪刀石头布

- 6IntelliJ IDEA使用教程_apply to files created outside intellij idea

- 7Python爬虫页面分析,带你使用 re&xpath&etree_python中ertree爬虫

- 8SQL Server2019安装步骤教程(图文)_最新教程_sql sever2019下载安装教程

- 9git临时切换分支 管理暂存本地修改的代码_git 临时提交切换分支

- 10【ElasticSearch8】SpringBoot集成ElasticSearch8.x 基本应用(环境安装和CRUD操作)_springboot与es8.x版本整合

Stable Diffusion 入门教程,让你轻松掌握!

赞

踩

最近有在研究AI绘画的同学们,肯定对相关的软件有一些认知了,不知道你们有没有体验过用这些软件怎么制图?今天我们就好好来研究一下Stable Diffusion这个软件!

想学习SD的小伙伴,我已经为您打包好了安装包、大模型、lora和关键词文件,无需自行查找,需要的小伙伴文末扫码获取~

简单来说,Stable Diffusion(简称SD)就是一个AI自动生成图片的软件。通过输入文字,SD就能生成对应的一张图片,不再需要像以前一样要把图片“画”出来,或者是“拍”出来。

这款软件不但可以生成AI人物模型、头像壁纸,还能帮助艺术创作者绘制漫画、做室内设计图等。

今天给大家准备了一篇干货级的分享。从Stable Diffusion的本地部署、操作页面以及插件使用,再到最后的实操案例,一步一步教大家学会使用Stable Diffusion!记得点赞收藏~

1、Stable Diffusion本地部署

Stable Diffusion的配置要求并非很高,显存4G以上就可以,不过要求硬盘至少要有50G以上(建议100G),适用于Win10-11版本。

如果你的电脑满足以上要求,那么就可以进行Stable Diffusion的本地部署了。

(1)下载整合包。将文件解压在全英文的安装路径中,减少后期报错的可能。

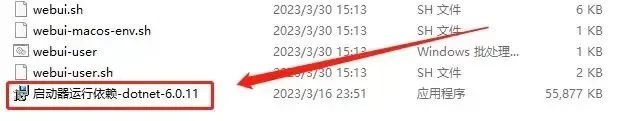

(2)点击"启动器运行依赖"完成启动环境搭建。

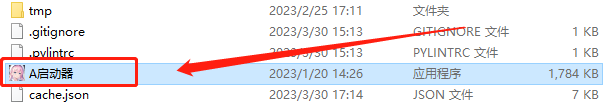

(3)点击启动器应用程序,一键启动Stable Diffusion。

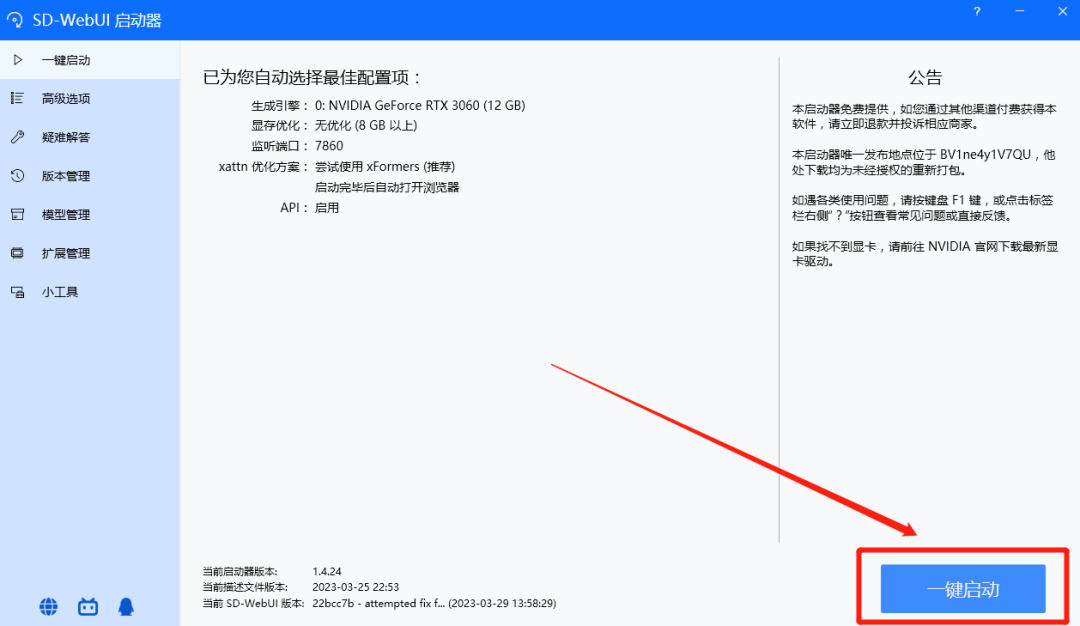

(4)待启动器页面弹出后,点击“一键启动”。

(5)首次启动Stable Diffusion可能需要较长的时间,请耐心等待:

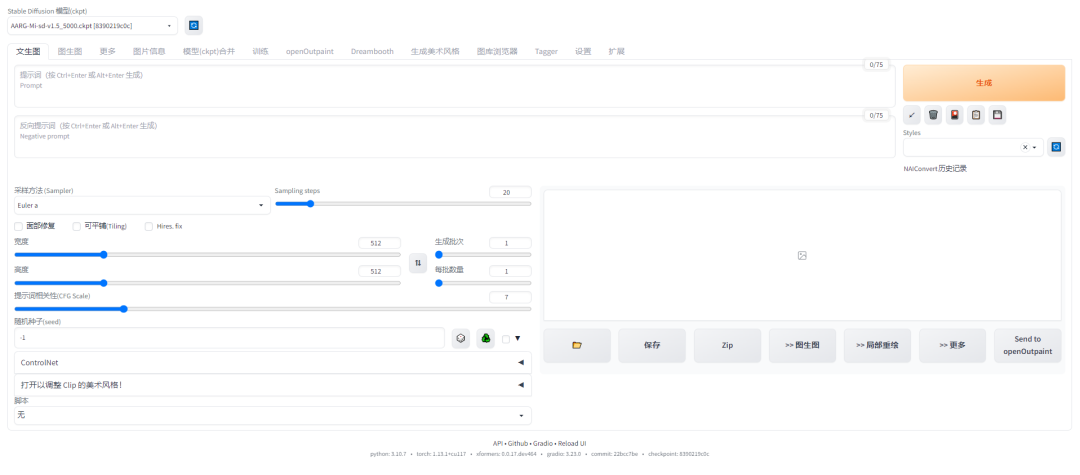

(6)当Stable Diffusion界面自动弹出时,就代表着你已经完成其本地部署。

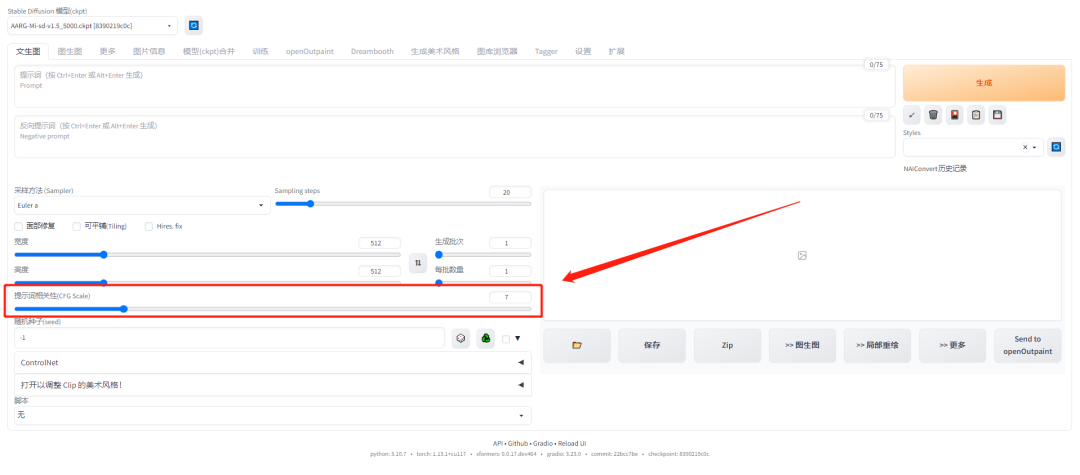

2、熟悉Stable Diffusion界面

(1)在界面的左上角,你可以选择进行创作的基础模型。

(2)在模型选择的下方,是输入提示词的文本栏。

与Midjourney不同的是,Stable Diffusion还拥有一行反提示词文本栏,你可以将不希望呈现在画面中的元素输入进去以贴合创作需求。

(3)提示词文本栏的下方,是采样方法与迭代步数。

简单的来讲,迭代步数影响的是创作画面的细节丰富程度。迭代步数越多,产生的细节就越多。

不是迭代步数越多越好,这需要结合创作项目来进行实际调试。

(4)下方是图片宽度、高度、生成批次、每批数量。

值得注意的是在它们下方的提示词相关性。它控制着产出图片受输入提示词的影响程度。一般取值范围在7-15。

(5)提示词相关性的下方,是十分重要的随机种子参数以及ControlNet插件。

可以说,正是因为有了ControlNet插件,才使得Stable Diffusion区别于Midjourney等“抽盲盒”式AI生成工具,更能应用于建筑、室内设计方向的实际项目之中。

3、Control Net 插件入门

Stable Diffusion安装Control Net插件的方法:

A. 点击页面中的“扩展”。

B. 点击扩展界面中的“可用”。

C. 点击可用界面中的"加载自"。

D. 按住键盘 contorl 键后,按 F键调出检索文本框。

E. 在检索文本框内输入 con-trolnet。

F. 找到“扩散控制网络 (con-trolnet)”,并点击后方的安装。

G. 点击“应用并重启用户界面”等待安装完成。

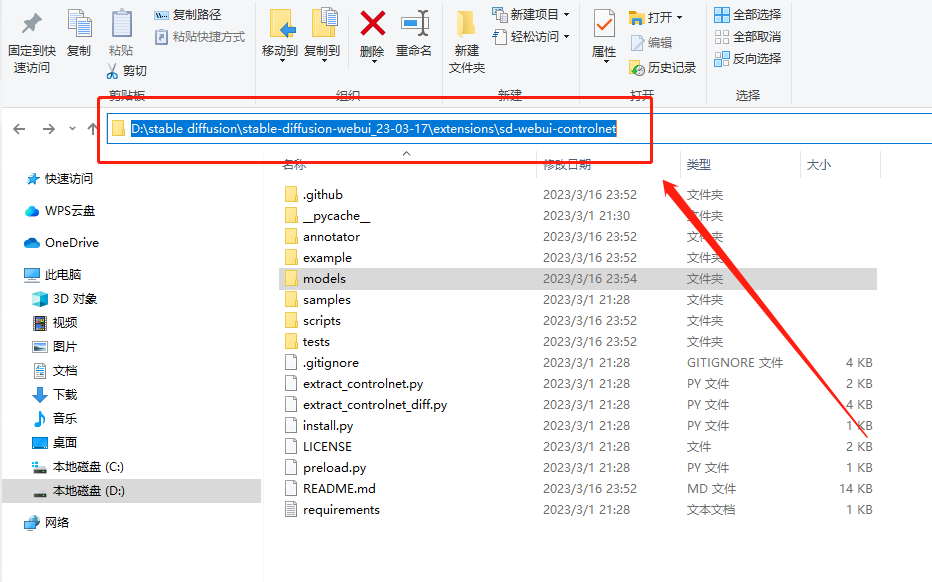

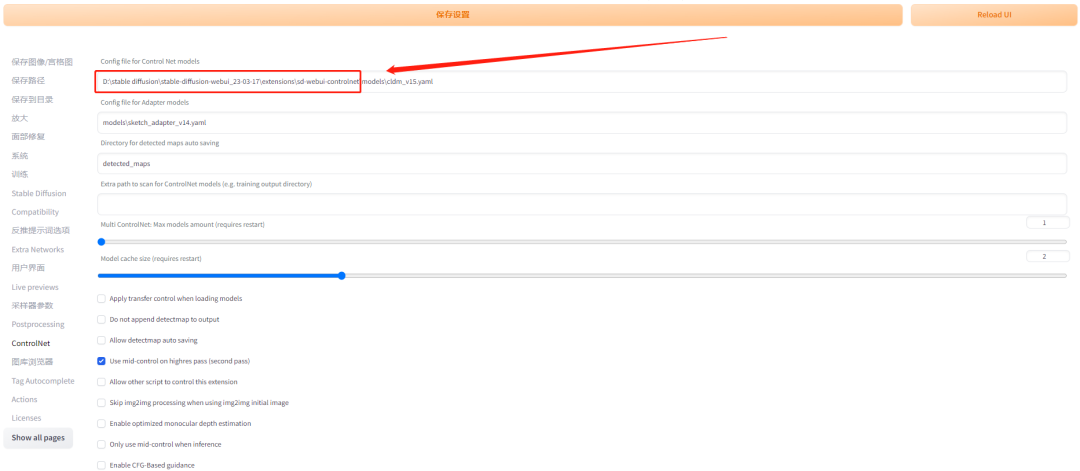

在确保已经安装 Control Net 插件之后,需要将 Control Net 的根路径进行更改,具体流程如下:

A. 点击“设置”找到 Control Net 选项。

B. 复制 Control Net 的根路径。

C. 将 Control Net 根路径粘贴更改到保存路径中。

需要注意的是,该操作需在"科学上网"前提下进行。

4、室内设计实操案例分享

(1)获得室内线稿图

首先,打开3ds max ,简单用box堆一个室内场景出来,你用其他三维软件也可以,然后将这个场景渲染出一个线稿图出来。

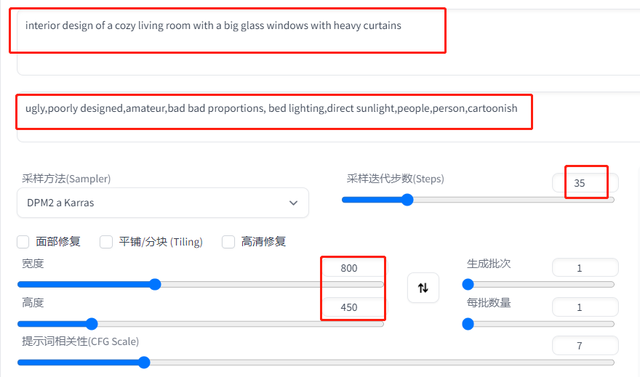

(2)设置提示词

选择文生图,正向关键词和负向关键词见下方,初始迭代步数可以调低一些,宽高比注意和线稿图一致。

正向关键词:

The interior design of a beautiful living room with a big glass windows with heavy curtains,bay window,tv wall

反向关键词:

ugly,poorly designed,amateur,bad bad proportions, bed lighting,direct sunlight,people,person,cartoonish

(3)设置 Control Net

打开 Control Net,将之前渲染得到的线稿拖到 ControlNet 的参考图中,勾选启用,因为是白色背景图片,所以要勾选反色模式。

如果显卡显存低,要勾选低显存优化。因为参考图本身就是线稿,所以预处理器不需要选择,在模型里选择 canny。

引导介入时机 设置为0.1左右,引导退出时机设置为0.6左右。

最后不要忘记尺寸,要设置为和原图比例一致。

出图结果如下。如果这张不满意,可以多出几张,直到有自己喜欢的为止。

需要注意的是:打开 Control Net 后,出图速度会变得非常慢,所以,开始时建议大家把迭代步数和尺寸设置小一些,生成图片批次多设几张,待找到自己满意的图片后,保留种子数,然后再出大图。

选择比较满意的图片后,保留种子数,然后再生成大图。

怎么保留种子数?点击想保留种子数的图片,在左侧有个绿色的按钮,点一下会出来一段数字,这个就是种子数。

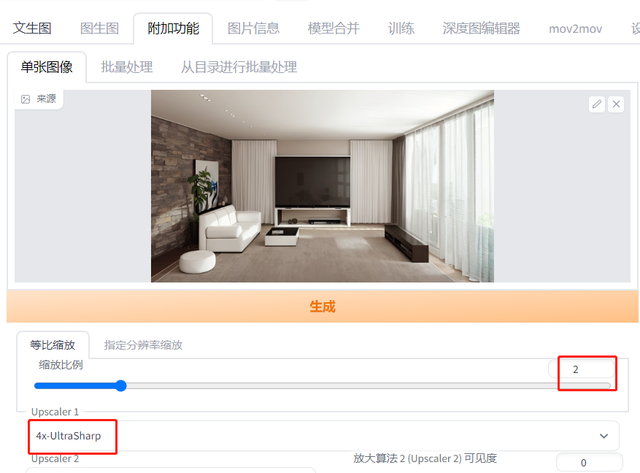

(4)得到4K大图

下面对图片进行放大处理。点击图片下方的图生图,来到图生图界面,你会发现之前在文生图我们用的提示词还有种子数全复制过来了。

接下来设置好采样器、提高迭代步数,按比例提高画面尺寸,最后注意重绘幅度不要太大,否则出图会发生比较大的变化。

最后再到附加功能里,将刚刚图生图得到的图片再进行放大2倍,得到4K高清大图。

如果你花了一些时间,认真的阅读了上述内容,跟着操作了一遍。那么相信你已经成功入门了Stable Diffusion这个AI出图利器。

软件的学习并不难,掌握使用方法,大多数的我们只是要能够学会熟练使用它就够了!大家多多尝试玩起来吧!

AI工具SD整合包、各种模型插件、提示词、AI人工智能学习资料都已经打包好放在网盘中了,无需自行查找,有需要的小伙伴文末扫码自行获取。

写在最后

AIGC技术的未来发展前景广阔,随着人工智能技术的不断发展,AIGC技术也将不断提高。未来,AIGC技术将在游戏和计算领域得到更广泛的应用,使游戏和计算系统具有更高效、更智能、更灵活的特性。同时,AIGC技术也将与人工智能技术紧密结合,在更多的领域得到广泛应用,对程序员来说影响至关重要。未来,AIGC技术将继续得到提高,同时也将与人工智能技术紧密结合,在更多的领域得到广泛应用。

感兴趣的小伙伴,赠送全套AIGC学习资料和安装工具,包含AI绘画、AI人工智能等前沿科技教程,模型插件,具体看下方。

一、AIGC所有方向的学习路线

AIGC所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、AIGC必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新AIGC学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

若有侵权,请联系删除

若有侵权,请联系删除