热门标签

热门文章

- 1Django框架之Cookie和Session_django cookie和session

- 2Guer完成对Gallium Semi的GaN产品组合的收购

- 3Opencv -- 18图像像素类型转换与归一化_图像分割 mask 需要归一化吗

- 4常用SQL命令

- 5Windows下Python安装并为pip配置阿里镜像_pip 指定阿里云镜像

- 6软考&PMP哪个值得考?_软中和pmp的区别

- 7小程序web-view覆盖原生组件_微信小程序 web-view 覆盖

- 8一文看懂“摩根系”,摩根士丹利、摩根大通、大摩、小摩到底有什么关系?_大摩小摩分别是哪家

- 9基于STM32的步进电机驱动设计_stm32步进电机驱动程序

- 10智能车电磁环岛处理方法_山东宁川水处理:电磁阀常见故障与解决方法

当前位置: article > 正文

安装部署大语言模型 | 通义千问

作者:Monodyee | 2024-05-03 14:02:13

赞

踩

安装部署大语言模型 | 通义千问

下载安装

进入ollama的仓库下载 「 qwen 7b 」

libraryGet up and running with large language models.![]() https://ollama.com/library查找阿里的 「 qwen 」

https://ollama.com/library查找阿里的 「 qwen 」

根据自己的电脑配置情况,选择合适的模型

总体来说,模型是越大,效果越好,但是对电脑的配置要求也越高

- 4b 模型要 3GB内存

- 7b 模型要 8GB 内存

- 13b 模型要 16GB 内存

- 70b 模型要 64GB 内存

特别注意:你如果要用于商业用途,需要申请授权,否则只能用于个人学习

千问许可说明:

申请商用授权: 灵积模型服务![]() https://dashscope.console.aliyun.com/openModelApply/qianwen

https://dashscope.console.aliyun.com/openModelApply/qianwen

复制qwen 7b下载命令

ollama pull qwen:7b 7b的模型有4.5GB,我们只需等待安装

7b的模型有4.5GB,我们只需等待安装

安装完成,随便问他几个问题

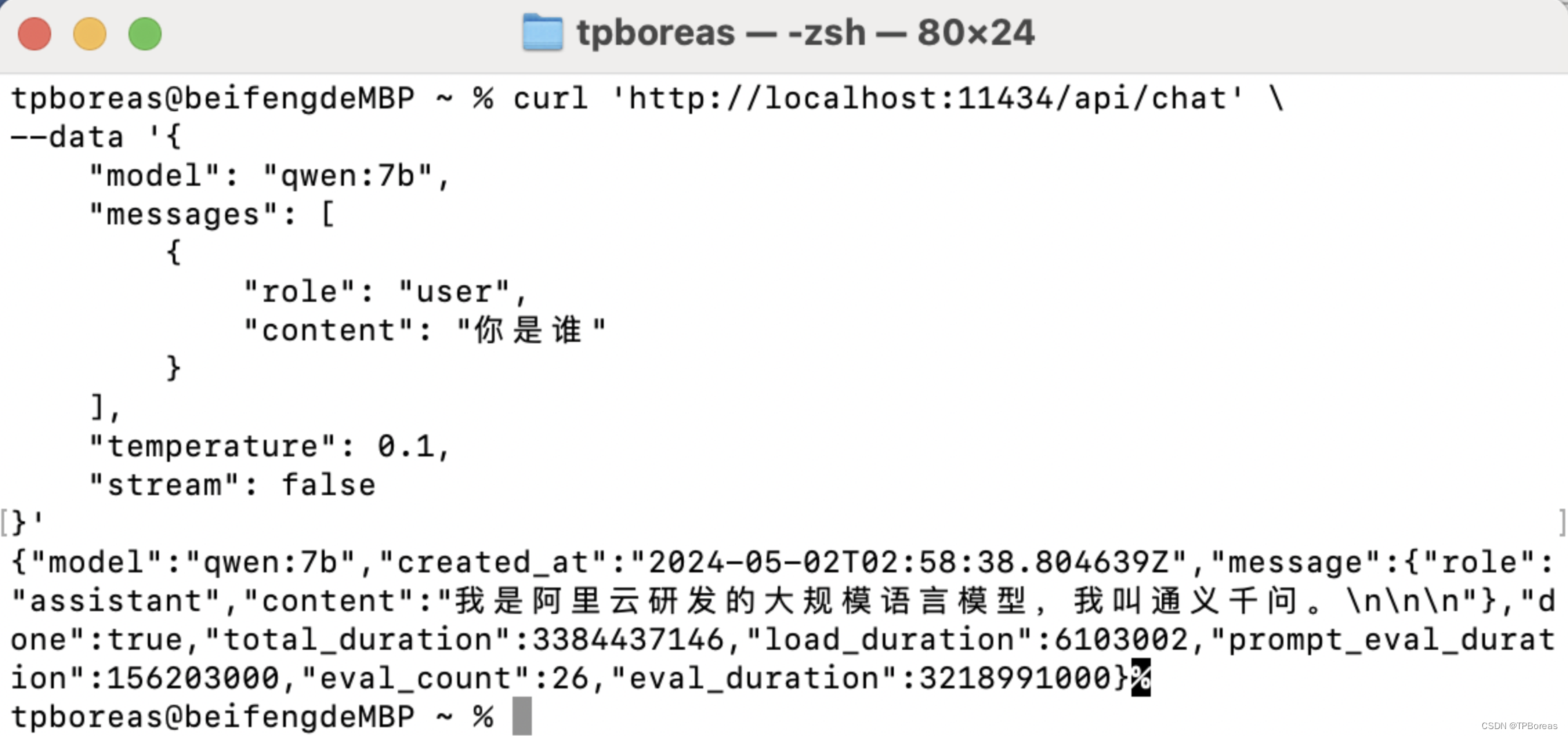

测试API请求

Mac/Linux下执行

- curl 'http://localhost:11434/api/chat' \

- --data '{

- "model": "qwen:7b",

- "messages": [

- {

- "role": "user",

- "content": "你是谁"

- }

- ],

- "temperature": 0.1,

- "stream": false

- }'

Windows下执行:

- curl "http://localhost:11434/api/chat" ^

- --data "{""model"": ""qwen:7b"", ""messages"": [{""role"": ""user"", ""content"": ""你是谁""}], ""temperature"": 0.1, ""stream"": false}"

测试结果

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Monodyee/article/detail/530001

推荐阅读

相关标签