- 1DNS、DNS劫持与HTTPDNS:原理、应用与安全分析

- 25-OAuth2.1的已知变动_oauth2.1 码农胖哥

- 3Google Earth KML中文说明_geemap显示kml数据

- 4ChatGPT指令百科全书:1000条ChatGPT 指令_chatgpt指令库

- 5react-native系列(3)入门篇:使用VSCode及RN的代码调试过程_拉取rn项目后使用vscode打开需要install吗

- 6人工智能未来发展的10大趋势_人工智能未来十大趋势

- 7软件测试外包公司怎么样?有什么好处和坏处?为什么没人去?_游戏测试外包公司怎么样

- 8推荐开源项目:Antd Auto - 基于Ant Design的自动化表单生成器

- 9【C++】双指针算法:和为s的两个数字

- 10GitHub 3.6k Satr自监督学习(Self-Supervised Learning)资源你值得拥有!_learning image representations by completing damag

Centos7安装Kafka_centos7 kafka

赞

踩

这里我们需要安装一个kafkaMQ队列,用于消息系统。

在安装Kafka之前我们需要做一些准备工作,kafka是依赖于zookeeper分布式锁,所以我们需要在Centos系统中先安装zookeeper,但是zookeeper需要jdk环境,所以我们同样需要安装JDK。

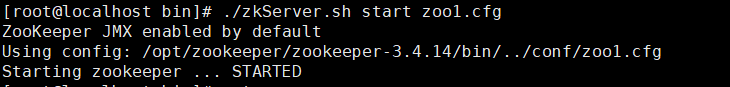

这里安装zookeeper就不在细说了,不会的可以看我的:https://blog.csdn.net/gelong_bokewang/article/details/89157375

这里是我已经启动的zookeeper任务:

下面我们开始安装kafka服务:

1.我们需要下载kafka这里是下载路径:https://www.apache.org/dyn/closer.cgi?path=/kafka/2.2.0/kafka_2.11-2.2.0.tgz

这里建议下载:

2.上传Centos7服务器上,并且解压安装。

上传我使用的lrzsz工具,没有的可以选择安装,或者使用ftp都行。

安装lrzsz命令:yum -y install lrzsz

上传后对文件进行安装编译,命令是:tar -zxvf kafka_2.11-2.2.0.tgz

3.修改kafka的配置文件:

kafka的配置文件在的目录和文件名称如下:

下面我们解释一下配置文件内容(这里只讲几个主要的注解字段)

- #一个broker在集群中的唯一标示,要求是正数。在改变IP地址,不改变broker.id的话不会影响consumers

- broker.id=1

-

- #listeners=PLAINTEXT://:9092

-

- #advertised.listeners=PLAINTEXT://your.host.name:9092

-

- #listener.security.protocol.map=PLAINTEXT:PLAINTEXT,SSL:SSL,SASL_PLAINTEXT:SASL_PLAINTEXT,SASL_SSL:SASL_SS

-

- # broker 处理消息的最大线程数,一般情况下不需要去修改

- num.network.threads=3

-

- # broker处理磁盘IO 的线程数 ,数值应该大于你的硬盘数

- num.io.threads=8

-

- # socket的发送缓冲区(SO_SNDBUF)

- socket.send.buffer.bytes=102400

-

- # socket的接收缓冲区 (SO_RCVBUF)

- socket.receive.buffer.bytes=102400

-

- # socket请求的最大字节数。为了防止内存溢出,message.max.bytes必然要小于

- socket.request.max.bytes=104857600

-

- #kafka数据的存放地址,多个地址的话用逗号分割 /tmp/kafka-logs-1,/tmp/kafka-logs-2

- log.dirs=/opt/kafka/data/log

-

- # 每个topic的分区个数,更多的partition会产生更多的segment file

- num.partitions=1

-

- num.recovery.threads.per.data.dir=1

-

- offsets.topic.replication.factor=1

- transaction.state.log.replication.factor=1

- transaction.state.log.min.isr=1

-

- # 当达到下面的消息数量时,会将数据flush到日志文件中。默认10000

- #log.flush.interval.messages=10000

-

- # 当达到下面的时间(ms)时,执行一次强制的flush操作。interval.ms和interval.messages无论哪个达到,都会flush。默认3000ms

- #log.flush.interval.ms=1000

-

- # 日志保存时间 (hours|minutes),默认为7天(168小时)。超过这个时间会根据policy处理数据。bytes和minutes无论哪个先达到都会触发。

- log.retention.hours=168

-

- #log.retention.bytes=1073741824

-

- # 控制日志segment文件的大小,超出该大小则追加到一个新的日志segment文件中(-1表示没有限制)

- log.segment.bytes=1073741824

-

- # 日志片段文件的检查周期,查看它们是否达到了删除策略的设置(log.retention.hours或log.retention.bytes)

- log.retention.check.interval.ms=300000

-

- # Zookeeper quorum设置。如果有多个使用逗号分割 例如 ip:prot,ip:prot,ip:prot

- zookeeper.connect=localhost:2181

-

- # 连接zk的超时时间

- zookeeper.connection.timeout.ms=6000

-

- # ZooKeeper集群中leader和follower之间的同步实际

- group.initial.rebalance.delay.ms=0

上面就是我的配置文件。

4.启动kafka服务。

命令需要切换到kafka的bin目录下,

./kafka-server-start.sh -daemon /opt/kafka/kafka_2.11-2.2.0/config/server.properties

5.我们测试kafka服务是否生效。

创建单分区 topic 副本,依然需要在bin目录下运行。

命令: ./kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic test

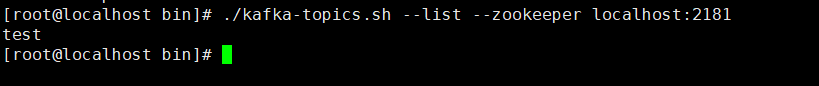

这样我们就创建了一个topic分区,下面的命令是查看topic分区

命令:./kafka-topics.sh --list --zookeeper localhost:2181

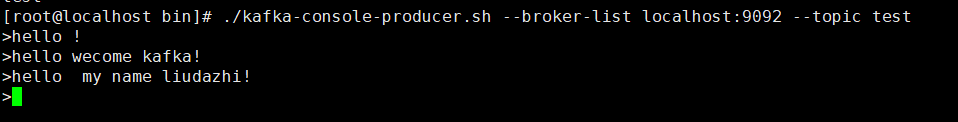

6.测试我们的kafka服务,我们使用自主创建生产-消费模式,我们使用命令生产消息,并且消费消息。

生产消息命令:./kafka-console-producer.sh --broker-list localhost:9092 --topic test

在命令输入信息,输入的内容,并敲击回车,每一次回车换行表示一条消息,使用ctrl+c结束生产消息。

注意:

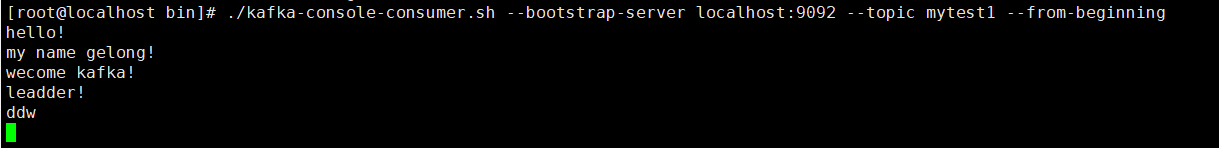

消费者消费消息命令:./kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic test --from-beginning

或者使用命令:./kafka-console-consumer.sh --zookeeper localhost:2181 --topic test --from-beginning

这两个命令下面的适用于低版本的kafka,而不是用于高版本的。

结果:

下面是kafka的集群部署:

这里我们介绍的单机多点broker。

利用单节点部署多个broker。不同的broker不同的id,监听端口以及日志目录,如:

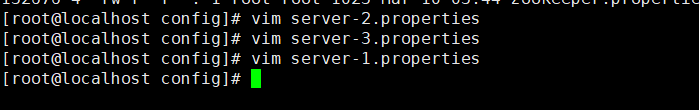

将conf目录下的配置文件复制两份。我们使用server-1 server-2 server-3 进行集群。

修改server-1 server-2 server-3的配置文件。

- vim config/server-1.properties

- #修改内容

- broker.id=1

- listeners=PLAINTEXT://your.host.name:9092

- log.dirs=/data/kafka-logs-1

-

-

- vim config/server-2.properties

- #修改内容

- broker.id=2

- listeners=PLAINTEXT://your.host.name:9093

- log.dirs=/data/kafka-logs-2

-

-

- vim config/server-3.properties

- #修改内容

- broker.id=3

- listeners=PLAINTEXT://your.host.name:9094

- log.dirs=/data/kafka-logs-3

根据不同的配置文件server-1 server-2 server-3 启动多个kafka服务。

同时这里我们创建topic副本空间时候就要根据我们启动数量的kafka服务而定了。

命令:

./kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 3 --partitions 1 --topic mytest1

factor:指的使我们副本的数量,这里我们需要三个副本去对应我们的三个broker,让他们自动选举leader。

查看topic使用:./kafka-topics.sh --list --zookeeper localhost:2181

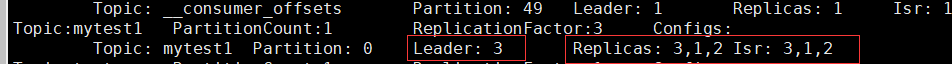

查看详细信息:./kafka-topics.sh --describe --zookeeper localhost:2181 ,此时的leader:主的broker ,replicas:代表副本对应的broker id 号, Isr:代表活着的broker

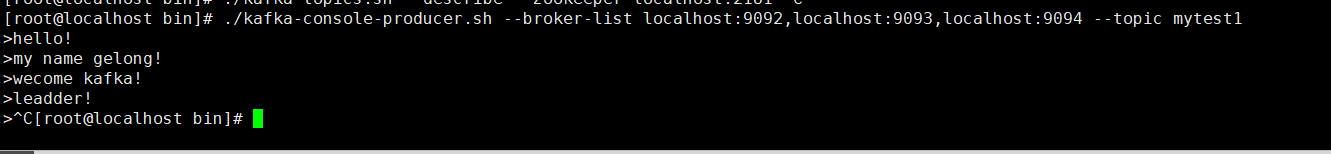

我们开始创建消息生产者

命令:./kafka-console-producer.sh --broker-list localhost:9092,localhost:9093,localhost:9094 --topic mytest1

消费者消费消息和之前一样

命令:./kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic mytest1 --from-beginning