- 1MySQL面经整理_myaql面经

- 27个源代码(库)搜索引擎的网站_搜索引擎 源代码

- 3视觉深度学习:迁移学习和微调_迁移学习 微调 csdn

- 4Redis实现延迟任务的几种方案_java zset redis延迟队列如何实现

- 5【PTA 5-10 树的遍历 (25分)】+ 二叉树_pta西南石油大学二叉树遍历

- 6智能反射面| 宽带情况的智能反射面信道估计——arxiv上的最新paper阅读笔记_broadband channel estimation for intelligent refle

- 7非计算机专业考软考考哪个方向,非计算机专业考软考初级哪个更容易过

- 8「他山之石」:大模型时代的“小模型”_基于大模型开发小模型

- 9探索开源图书馆管理平台:GitCode上的Library-Management项目

- 10第2章 大模型的基础知识2.2 大模型的关键技术2.2.3 参数共享与注意力机制

【玩转 GPU】搭建本地知识库--chatGLM+langchain(尝鲜篇)_chatglm本地知识库、

赞

踩

有一天发现,在腾讯文档中想搜索之前写的东西需要收费了。这钱非花不可吗?好像不用。我们可以利用langchain+chatGLM在本地搭建自己的知识库,除了能搜索到文档这个功能,还能基于知识库内容和你进行对话问答~

上文我们介绍了如何在本地部署chatGLM,本文就介绍如何搭建你的本地知识库问答系统。

1 知识库搭建思路

先抛开技术,假设现在知识库就在手边,我们是如何搜索想要的答案的?

首先,把所有的文档看一遍,对文档进行分类;

然后,找出和问题相关的文档内容;

最后,对相关内容进行总结,得到答案。

其实算法的整体思路也是这些步骤,明显只靠LLM是不够的,我们还需要一些其他功能将LLM应用起来,langchain就提供了一整套框架帮我们更好的应用LLM。

1.1 langchain介绍

https://github.com/hwchase17/langchain

langchain是一个开发基于语言模型应用程序开发框架,链接面向用户程序和LLM之间的中间层。利用LangChain可以轻松管理和语言模型的交互,将多个组件链接在一起,比如各种LLM模型,提示模板,索引,代理等等。

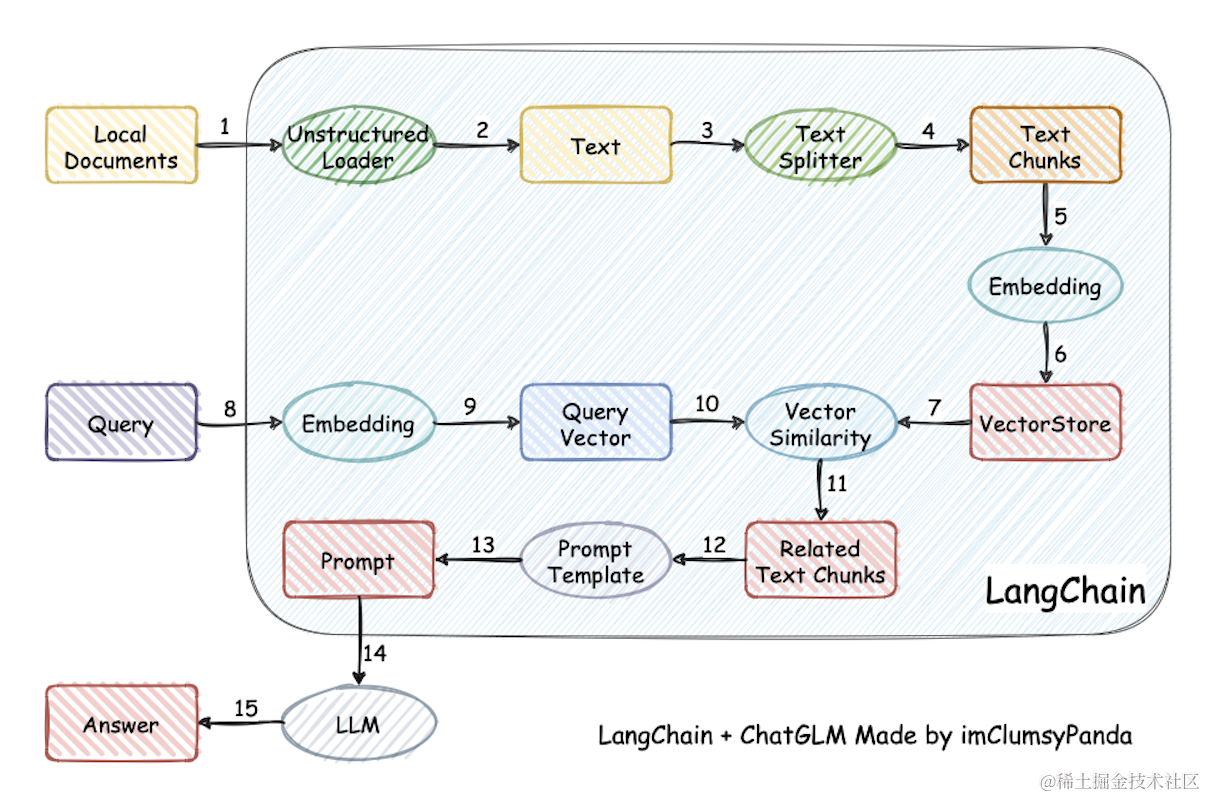

1.2 langchain-ChatGLM流程介绍

langchain-ChatGLM项目就是参考了Langchain的思路,我们一起看下langchain-ChatGLM搭建本地知识库的流程。

https://github.com/imClumsyPanda/langchain-ChatGLM/blob/master/README.md

如上图,本地知识库搭建的流程如下:

(1-2)准备本地知识库文档目前支持 txt、docx、md、pdf 格式文件,使用Unstructured Loader类加载文件,获取文本信息,loader类的使用参考https://python.langchain.com/en/latest/modules/indexes/document_loaders/examples/unstructured_file.html

(3-4)对文本进行分割,将大量文本信息切分为chunks

(5)选择一种embedding算法,对文本向量化

(6)将知识库得到的embedding结果保存到数据库,就不用每次应用都进行前面的步骤

(8-9)将问题也用同样的embedding算法,对问题向量化

(10)从数据库中查找和问题向量最相似的N个文本信息

(11)得到和问题相关的上下文文本信息

(12)获取提示模板

(13)得到输入大模型的prompt比如:问题:,通过以下信息汇总得到答案。

(14)将prompt输入到LLM得到答案

以上只是简单的步骤流程,实际应用中每一步都会有遇到很多问题,比如文本格式如何加载;文本如何分割才能尽可能少的不分开紧密相关上下文;embedding算法的选取;关于提问信息的相关上下文的召回和排序问题;提示模板的形式;大模型的选取等等等等。本文只是尝鲜搭建整套流程,所以不探索这些问题。

2 知识库搭建步骤

2.1 硬件需求

首先确定机器性能是否满足要求,仍然使用ChatGLM-6B模型

通过上文介绍,大家应该可以在本地跑通chatGLM-6B模型了。

2.2 环境安装

首先安装后续要用到的相关库

代码语言:javascript

pip install langchain

--chatGLM相关的上一篇已介绍

-- 加载文档

pip install unstructured

-- 解析表格

pip install tabulate

-- 我使用的sentence_transformers进行embedding

pip install sentence_transformers

-- 向量数据库

pip install chromadb

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

2.3 部署和使用

环境搭建好,就可以直接应用了,上代码~

step1: 加载文档并切分文本

代码语言:javascript

from langchain.document_loaders import UnstructuredFileLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

# 导入文本

loader = UnstructuredFileLoader("./data/test_doc.txt")

# 将文本转成 Document 对象

data = loader.load()

print(f'documents:{len(data)}')

# 初始化加载器

# chunk_size每个分片的最大大小,chunk_overlap分片之间的覆盖大小,可以保持连贯性

text_splitter = RecursiveCharacterTextSplitter(chunk_size=100, chunk_overlap=0)

# 切割加载的 document

split_docs = text_splitter.split_documents(data)

print("split_docs size:", len(split_docs), type(split_docs))

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

step2: 对文本embedding,注意在提问时也需要保持embedding方案的一致性

代码语言:javascript

from langchain.vectorstores import Chroma from langchain.embeddings.huggingface import HuggingFaceEmbeddings import IPython import sentence_transformers # 选择模型---https://huggingface.co/models?pipeline_tag=sentence-similarity&sort=downloads embedding_model_dict = { "ernie-tiny": "nghuyong/ernie-3.0-nano-zh", "ernie-base": "nghuyong/ernie-3.0-base-zh", "text2vec": "GanymedeNil/text2vec-large-chinese", "text2vec2":"uer/sbert-base-chinese-nli", "text2vec3":"shibing624/text2vec-base-chinese", } EMBEDDING_MODEL = "text2vec3" # 初始化 hugginFace 的 embeddings 对象 embeddings = HuggingFaceEmbeddings(model_name=embedding_model_dict[EMBEDDING_MODEL], ) embeddings.client = sentence_transformers.SentenceTransformer( embeddings.model_name, device='mps') print("embeddings", embeddings) print("embeddings model_name", embeddings.model_name)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

step3: 词向量持久化保存到数据库

代码语言:javascript

from langchain.vectorstores import Chroma

# 初始化加载器

db = Chroma.from_documents(split_docs, embeddings, persist_directory="./data/doc_embeding")

# 持久化

db.persist()

- 1

- 2

- 3

- 4

- 5

step4: 问答应用,首先将持久化后的数据加载,然后将问题向量化,并搜索和问题相关的内容

代码语言:javascript

# 加载之前持久化数据

db = Chroma(persist_directory="./data/doc_embeding", embedding_function=embeddings)

question = "什么是用户画像"

similarDocs = db.similarity_search(question, include_metadata=True, k=4)

info = ""

for similardoc in similarDocs:

info = info + similardoc.page_content

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

step5: 根据提问,结合上下文进行问答

代码语言:javascript

tokenizer = AutoTokenizer.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True)

# INT8 量化的模型将"THUDM/chatglm-6b-int4"改为"THUDM/chatglm-6b-int8"

model = AutoModel.from_pretrained("THUDM/chatglm-6b-int4", trust_remote_code=True).half().cuda()

model = model.eval()

history = []

question = "结合以下信息:" + info + "回答" + question

response, history = model.chat(tokenizer, question, history=history)

print("\033[31m 提问:{}\033[0m".format(question))

print("\033[32m 回答:{}\033[0m".format(response))

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

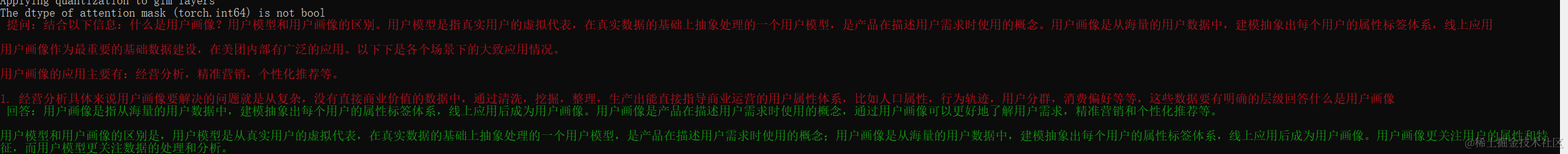

以下是我将用户画像学习笔记作为知识库后,得到的结果,效果。。一般般吧~

如何系统的去学习大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。