- 1图数据库 之 Neo4j - 应用场景1 - 欺诈检测(6)_neo4j适用场景

- 2Linux 安装 Oracle_linux安装oracle

- 3spring boot自定义启动图案(1)

- 4MySQL8.0的下载安装与使用(图文教程、新手必备、手把手保姆级别、Windows版、2023年新版)_mysql8.0安装教程

- 57种经典推荐算法模型的应用,java多线程面试题总结_推荐模型算法 java

- 6libcurl教程_libcurl监听端口

- 7处理IDEA 找不到 git.exe : Cannot Run Git File not found: git.exe

- 8完美解决ERROR: Could not find a version that satisfies the requirement <软件包> (from versions: none)问题

- 9学术会议推荐:2023年自动化控制和电气工程国际学术会议 (ACEE 2023)_电气工程与控制国际会议

- 10C# WPF Prism框架-2.MVVM的绑定和命令_c#的mvvm的代码

柏拉图表征假说:AI模型趋同于现实的统一表征_柏拉图表征假说论文中文

赞

踩

引言

近日,Ilya Sutskever在离开OpenAI后不久点赞了一篇由MIT团队发表的AI论文,这篇题为《The Platonic Representation Hypothesis》的论文引起了广泛关注。这篇论文探讨了AI模型在不同数据和模态上的训练是否趋向于收敛成一个共享的现实世界统计模型。本文将深入解析该论文的核心思想,并探讨其对未来AI发展的重要意义。

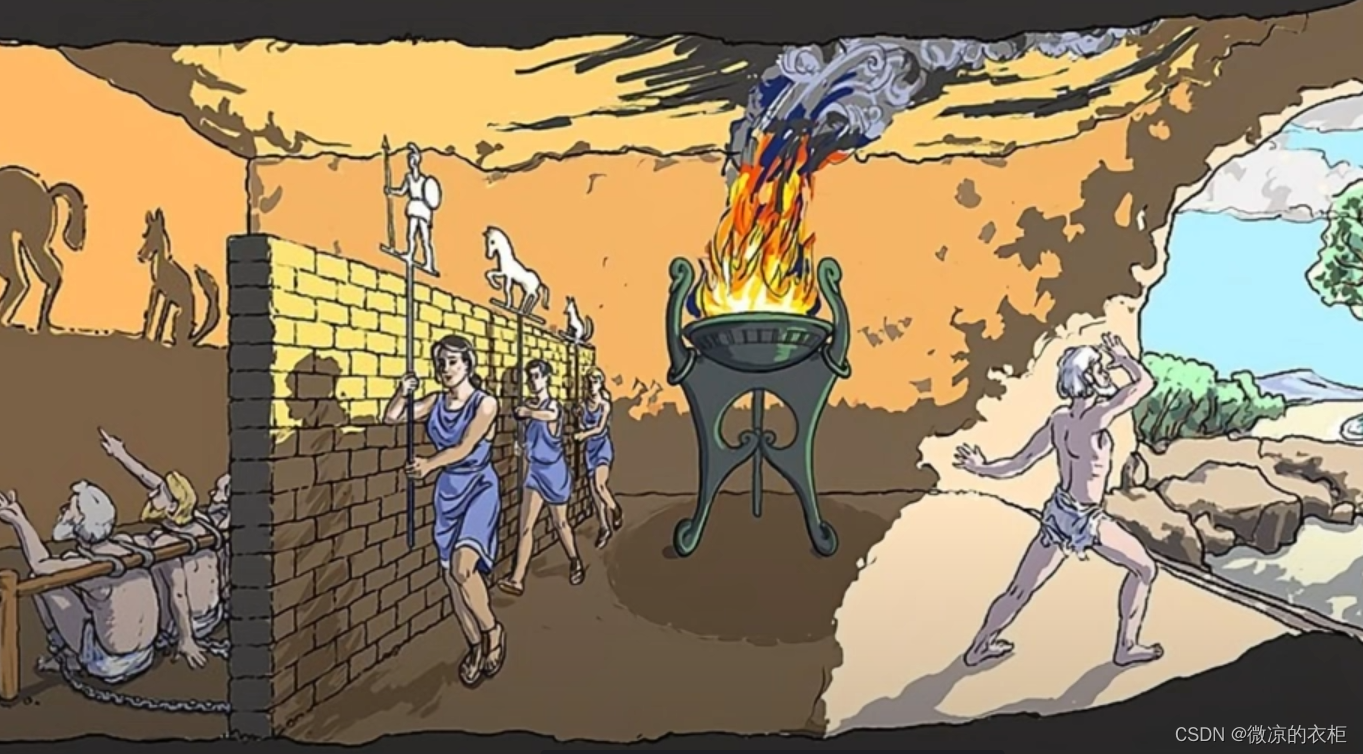

柏拉图的洞穴寓言

要理解柏拉图表征假说,首先需要了解柏拉图的洞穴寓言。在柏拉图的著作《理想国》中,他描述了一群囚犯从出生就被锁在洞穴中,只能看到身后物体在墙上的影子。这些影子成为了他们眼中的“现实”,但实际上这些影子只是现实的投影。哲学家被比喻为从洞穴中走出来,看到阳光下真实世界的人,他们通过逻辑、数学和自然科学等手段理解更高层次的“现实”。今天,这个目标传递到了AI科学家的手中。

柏拉图表征假说

柏拉图表征假说的核心是:不同的神经网络模型在不同的数据和模态上训练,最终会在其表征空间中收敛成一个共享的现实世界统计模型。换句话说,随着AI模型规模和训练数据的增加,不同的AI模型会趋向于对现实进行统一的表征。

理论解释与模型拼接

论文中提出了一种验证柏拉图假说的方法——模型拼接(Model Stitching)。该方法通过将两个模型的中间表示层连接起来,形成一个新的“缝合”模型,如果这个缝合模型表现良好,说明两个原始模型的表征是兼容的。通过这种方法,研究者分析了78个计算机视觉(CV)模型,发现性能越强的模型其表征相似度越高。

表征收敛的三大原因

论文指出,AI模型表征收敛主要有以下三大原因:

- 任务通用性:当一个AI模型需要同时完成多种任务时,其表征空间会收敛到一个小范围,因为每个任务目标都会对模型施加额外的约束。

- 模型容量:模型越大,越容易逼近全局最优表征,从而推动表征收敛。更大的模型能够找到一个共享的全局最优解,实现跨模态的通用性和适应性。

- 简单性偏见:深度神经网络倾向于选择最简单的解决方案,这种倾向随着模型变大而更加显著。这种简单性偏见符合奥卡姆剃刀原则,促使模型找到更高质量的解决方案。

实验结果与应用启示

实验结果表明,模型性能越强,其表征相似度越高。论文作者提出了多种方法来验证柏拉图表征假说的有效性,并发现强大的模型往往在表征上趋同。

这给我们的启示是:随着模型参数、任务多样性和算力的增加,AI模型的表征会逐渐收敛趋同。这是否意味着只要扩大模型规模就可以实现通用人工智能(AGI)呢?答案是复杂的。尽管扩大模型规模能实现表征收敛,但对于某些独立任务而言,单独训练一个专用模型可能更具经济价值。

未来展望

柏拉图表征假说为我们提供了一个新的视角来审视多模态数据之间的关系。即使训练集中不存在跨模态的配对数据,不同模态的数据也会对模型训练有直接帮助。未来,随着AI技术的不断进步,我们能否借助AI的力量走出洞穴,理解高维度的真正现实呢?让我们拭目以待。

结论

柏拉图表征假说为AI模型的训练和发展提供了一个新的理论框架。通过模型拼接和表征对齐等技术手段,我们可以验证不同AI模型在对现实的表征上是否趋同。未来,随着模型规模和任务多样性的增加,AI模型有望实现更加准确的现实表征,从而推动通用人工智能的发展。