热门标签

热门文章

- 1什么是Scrum?Scrum的核心要点和精髓_scrum框架

- 2微信小程序onShareAppMessage分享

- 3关于感情

- 4Profiler内存检测和使用小结_profile leakcanary

- 5buck电路,boost电路及buck-boost降压升压原理三合一及buck,boost输入输出公式推导一文足矣_buck boost

- 6达梦两个表模糊查询_SQL高级知识——临时表

- 7hadoop集群启动失败的一些常见问题_hadoop集群shell一键启停为啥启动不了

- 8【Python基础】一文搞懂:Python 中 Excel 文件的写入与读取_python pandas openpyxl

- 9大模型如何可信?字节跳动研究的最新《可信赖的大型语言模型》综述,提出评估 LLMs 可信度时需要考虑的七大维度_大模型价值观对齐应该考虑哪些维度

- 10100多个常用API接口免费分享_文章api接口有那些

当前位置: article > 正文

使用Ollama简单部署本地Qwen2_ollama 部署qwen2

作者:人工智能uu | 2024-07-14 00:44:38

赞

踩

ollama 部署qwen2

Ollama 是一个开源的、本地运行的 AI 聊天模型,允许在自己的设备上运行 LLM,无需依赖云服务。它支持多种 LLM。目前Ollama library已经支持Qwen2,可以直接使用。

首先安装ollama, 访问官网 下载 ollama 对应版本 Download Ollama on macOS

windows下选择exe ,然后运行安装,安装完成后。添加一个系统环境变量OLLAMA_MODELS,否则Ollama 会将模型默认下载到C盘,比如我这里指了D盘:

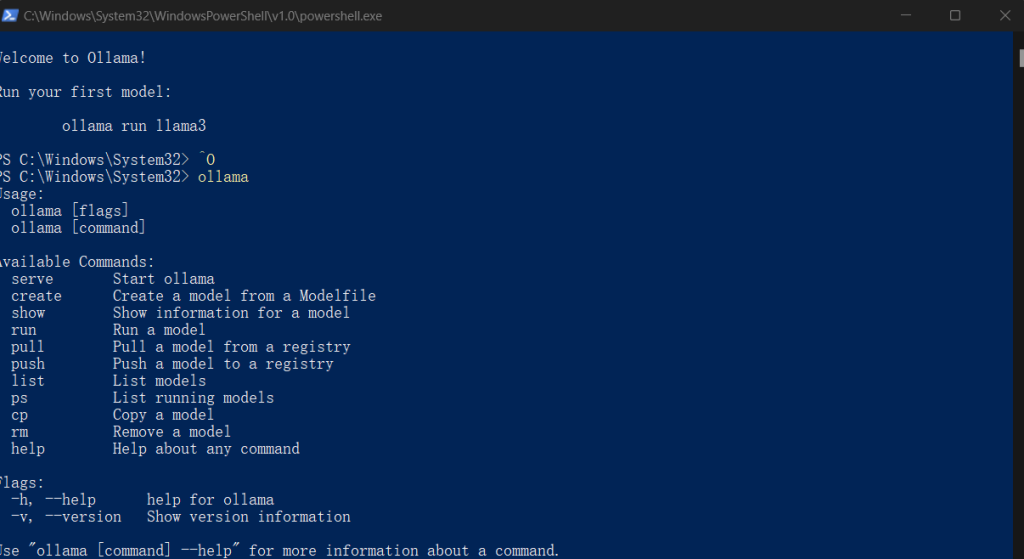

然后打开powershell 运行一下,注意不是CMD是powershell ,看是否安装成功

然后我们安装qwen大模型

ollama run qwen2:1.5b1.5b就是对应安装Qwen2 1.5b大模型,如果使用7b 就是 ollama run qwen2:7b

运行完成后就可以和大模型对话了,不过ollama 只有命令行模式运行,这里我下载了chatbox软件来运行,打开软件 模型设置选择ollama 以及 对应的ollama模型。

运行结果:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/人工智能uu/article/detail/822358

推荐阅读

相关标签