热门标签

热门文章

- 1SeqGAN论文笔记

- 2计算机原理---网络配置4要素_网络配置的组成

- 3入门级 开源SpringBoot+Vue项目_springboot+vue简单博客系统开源项目

- 4开源聚合路由 OpenMPTCProuter 配置使用

- 5ECS磁盘扩容与添加新的硬盘_fdisk 阿里云扩容

- 6freeCAD手册(7)_python 画零件角度freecad

- 7Java中==和equals()的区别_java equals和==区别

- 8数码相册项目_基于s5p6818的数码相册设计的摘要部分

- 9【赠书活动】大数据智能风控:模型、平台与业务实践

- 10云服务器扩容系统盘优点,UCloud云服务器扩容系统盘且不影响已运行数据「还得备份」...

当前位置: article > 正文

NLP——神经网络介绍_nlp神经网络

作者:人工智能uu | 2024-07-19 02:40:53

赞

踩

nlp神经网络

深度学习

机器学习的分支,人工神经网络为基础,对数据的特征进行学习的方法

机器学习与深度学习的区别

1.特征提取

- 人工的特征抽取的过程

- 深度学习:自动进行特征抽取

2.数据量

- 机器学习:数据少,效果不是特别好

- 深度学习:数据多(参数多),效果更好

应用场景

- 图像识别

- NPL(自然语言处理技术)

- 机器翻译

- 文本识别

- 聊天对话

- 语音识别

框架

1.PyTorch:类似Numpy

2.TensorFlow

神经网络

人工神经网络:

神经网络、类神经网络,是一种仿生物神经网络,模拟生物的神经系统,对函数进行估计或者近似。(无需考虑特征的规则,只想了解数据的格式之类的)

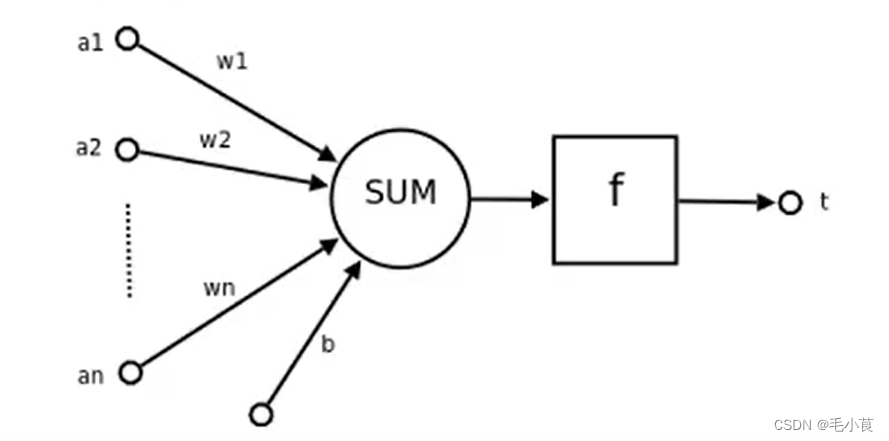

神经元:

其中:

其中:

- a1,a2…an为各个输入的分量

- v1,v2…vn为各个输入分量对应的权重参数

- b为偏置

- f为激活函数(常见的激活函数有tanh、sigmoid、relu)

- t为神经元的输出

- 使用数学公式表达:

t = f ( W T A + b ) t=f(W^TA+b) t=f(WTA+b)

一个神经元的功能是求得输入向量与权向量得内积后,经一个非线性传递函数得到的一个标量结果

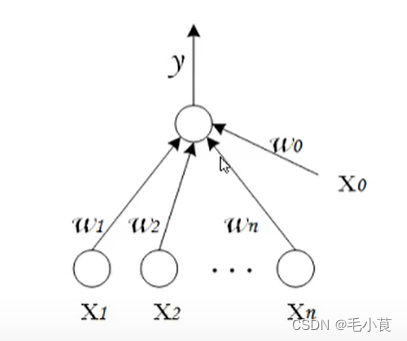

感知机:

两层神经网络,输入层接收外界输入信号传递到输出层(输出+1正例,-1反例)

简单的二分类模型,给定阈值,判断数据属于哪一部分

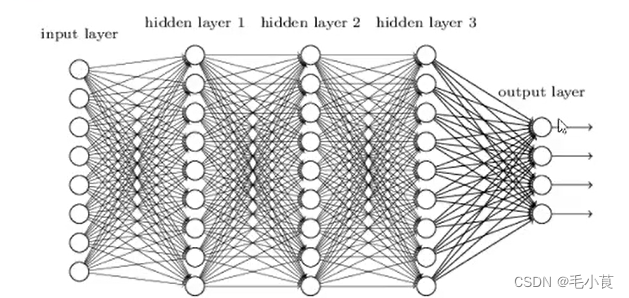

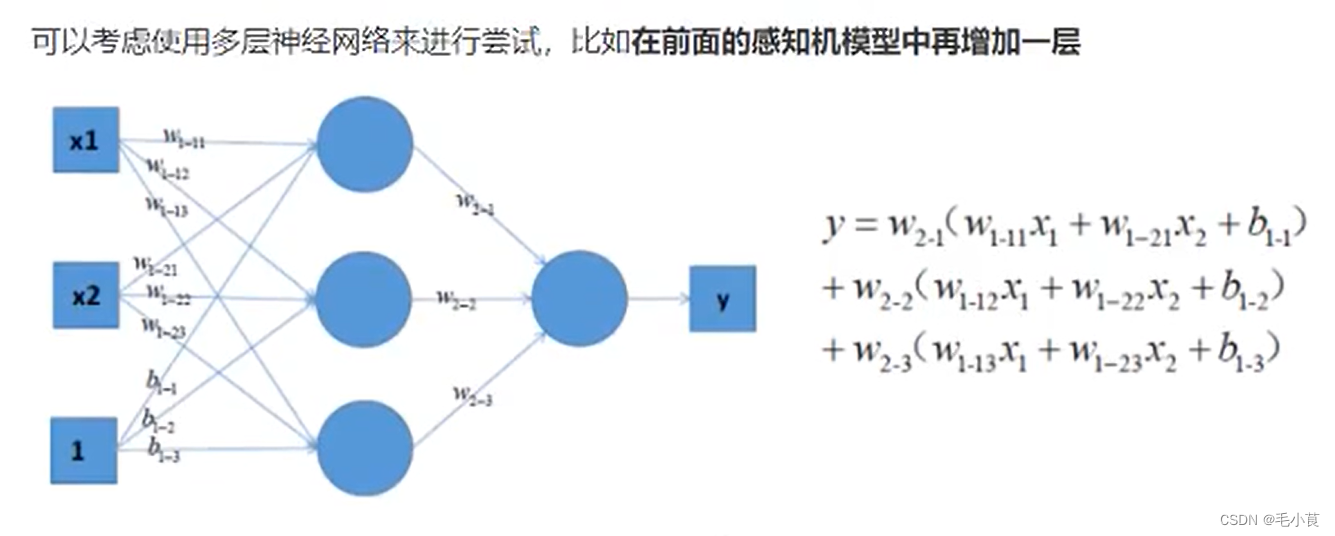

多层神经网络:

- 输入层:众多神经元接收大量的输入信息

- 输入层:众多神经元接收大量的输入信息

- 输出层:消息在神经元链接中传输、分析、权衡,形成输出效果。

- 隐藏层:“隐层”,多层,每一层神经元个数不确定。是输入层与输出层之间众多神经元和链接组成的各个层面。

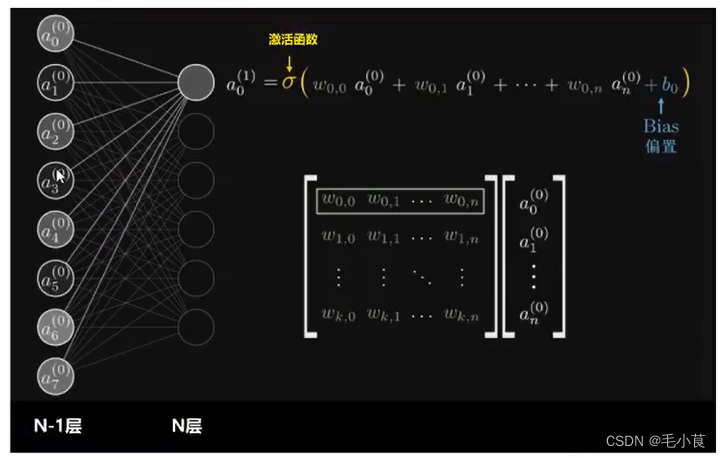

- 全连接层:当前一层和前一层每个神经元相互链接,我们称当前这一层为全连接层。

*进行的是 y = W x + b y=Wx+b y=Wx+b

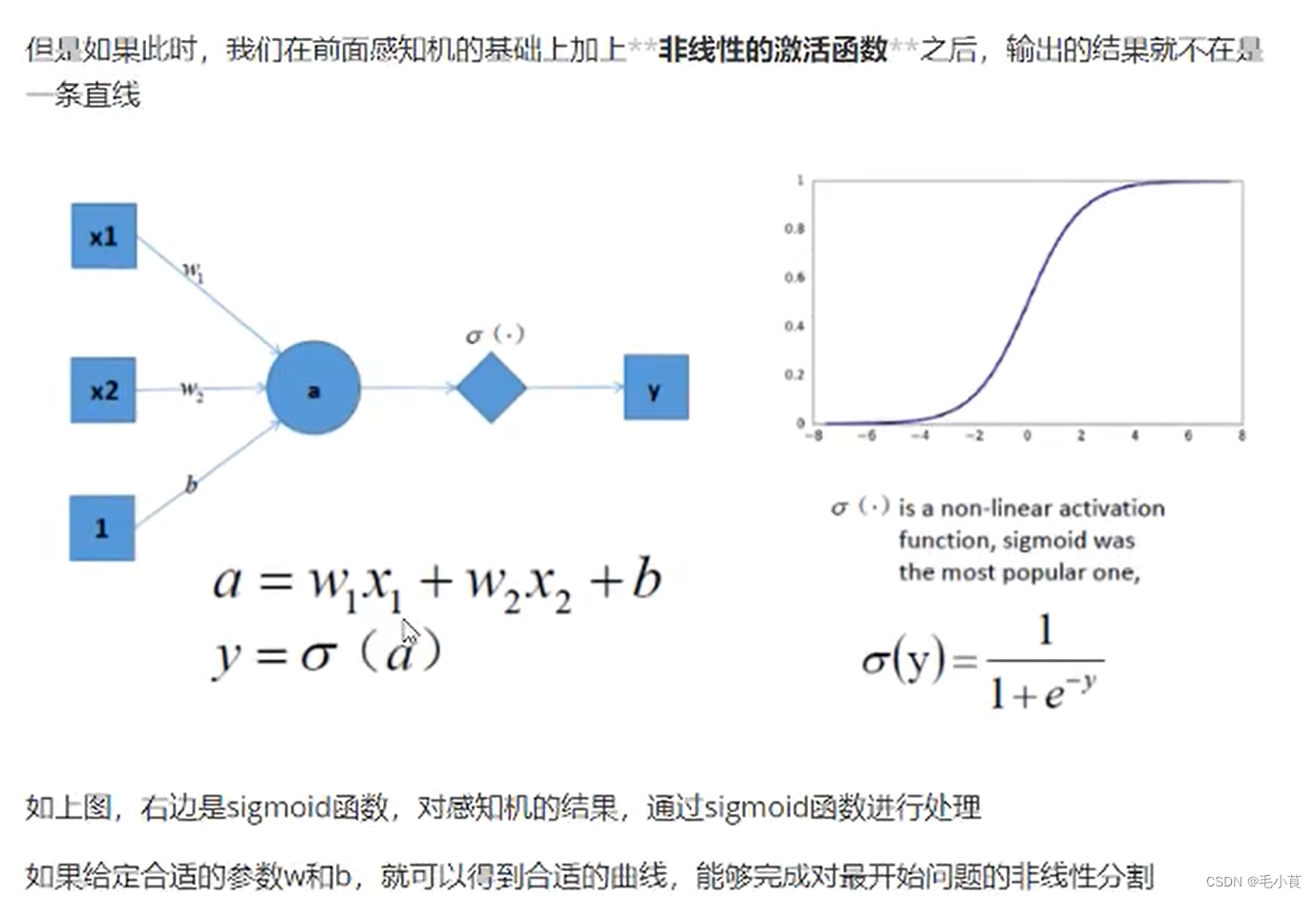

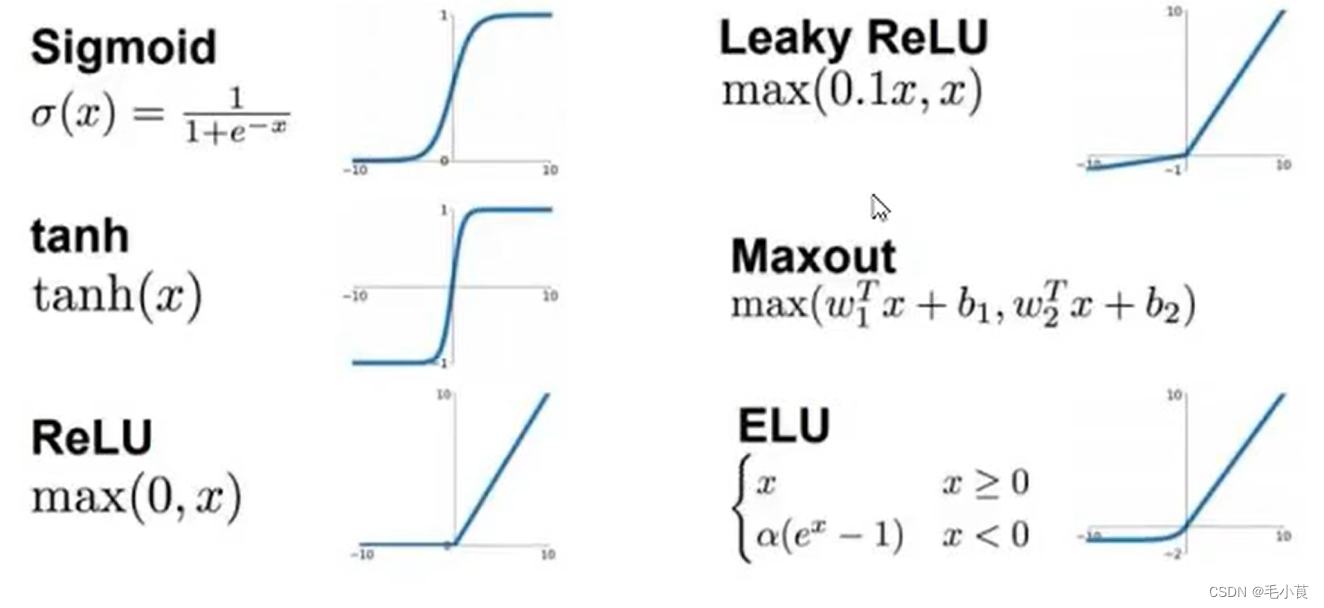

激活函数:

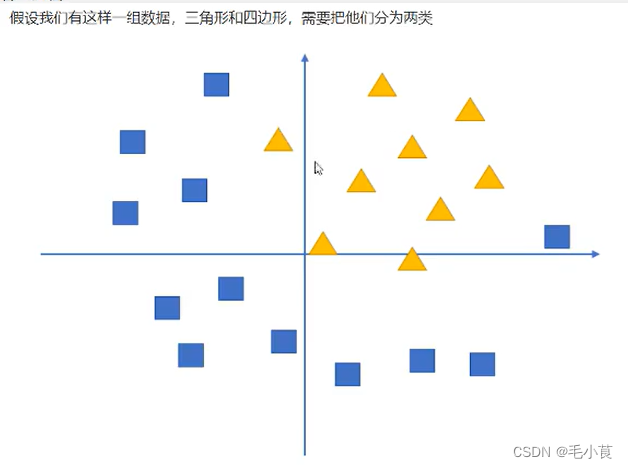

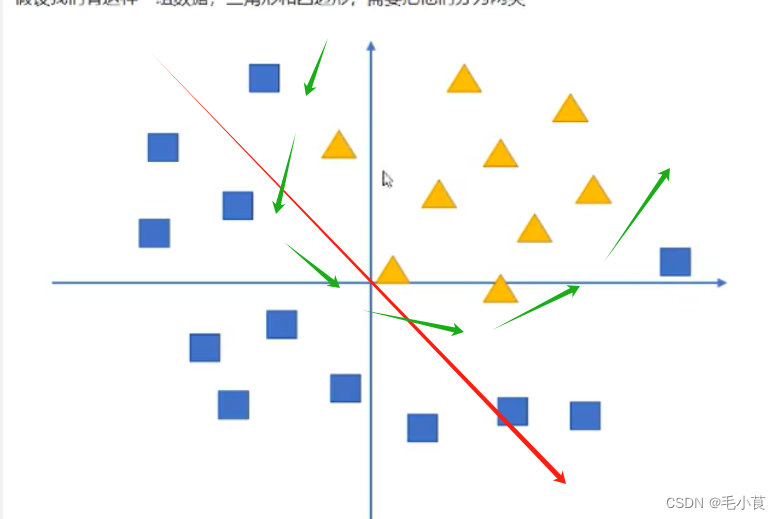

无法通过一条直线将数据完全分为两类

使用多层神经网络来解决->多次分割

- 线性

i. 系统:函数,f,模型 f ( x ) = y f(x)=y f(x)=y

ii. f ( x 1 + x 2 ) = y 1 + y 2 f(x_1+x_2)=y_1+y_2 f(x1+x2)=y1+y2

iii. f ( k + 1 ) = k y 1 f(k+1)=ky_1 f(k+1)=ky1 - 作用:

a. 增加模型的非线性分割能力

b. 提供模型的稳健性

c. 缓解梯度消失

点加速模型的收敛 - 常见激活函数:

a. sigmold:(0,1)

b. tanh:(-1,1)

c. relu:(0,x)

d. ELU: a ( e x − 1 ) a(e^x-1) a(ex−1)

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/人工智能uu/article/detail/849011

推荐阅读

相关标签