热门标签

热门文章

- 1HarmonyOS 鸿蒙开发测试:分布式UI测试框架_鸿蒙ui自动测试

- 2nginx文件位置_nginx目录下status

- 3学习IIS服务器勿使用CGI程式_服务器iis如何取消cgi

- 4fopen/open,fread/read,fwrite/write的区别_fread fwrite fopen和read write open什么区别

- 5Foxit_pdf_sdk_9_2_linux Patch

- 6开启想象翅膀:轻松实现文本生成模型的创作应用,支持LLaMA、ChatGLM、UDA、GPT2、Seq2Seq、BART、T5、SongNet等模型,开箱即用

- 7蓝桥杯校内模拟赛8.长草(java)ArrayDeque实现bfs_疯长的草 java

- 82023研究生科学道德与学术规范期末考试(雨课堂)_仅仅依赖高等学校的内控不足以控制所有学术不端行为的原因不包括

- 9Vue 实现轮播图功能_vue轮播图

- 10linux下wget命令详解_wget -o和-o区别

当前位置: article > 正文

Grok-1_grok-1使用

作者:从前慢现在也慢 | 2024-03-23 07:43:04

赞

踩

grok-1使用

继2024年的Claude3大模型的推出,马斯克的AI创企xAI于2024年 3 月 17 日公布新的语言大模型Grok-1的基本模型权重和网络架构。该模型是一个具有3140 亿个参数的专家混合模型,相比于大模型 (Grok-0)的 330 亿个参数具有较大的提升 。据官网发布的对比信息,Announcing Grok

这个对比信息只对比了Claude2,但是没有对比前几天刚发布的Claude3,这有点小缺陷。

这个对比信息只对比了Claude2,但是没有对比前几天刚发布的Claude3,这有点小缺陷。

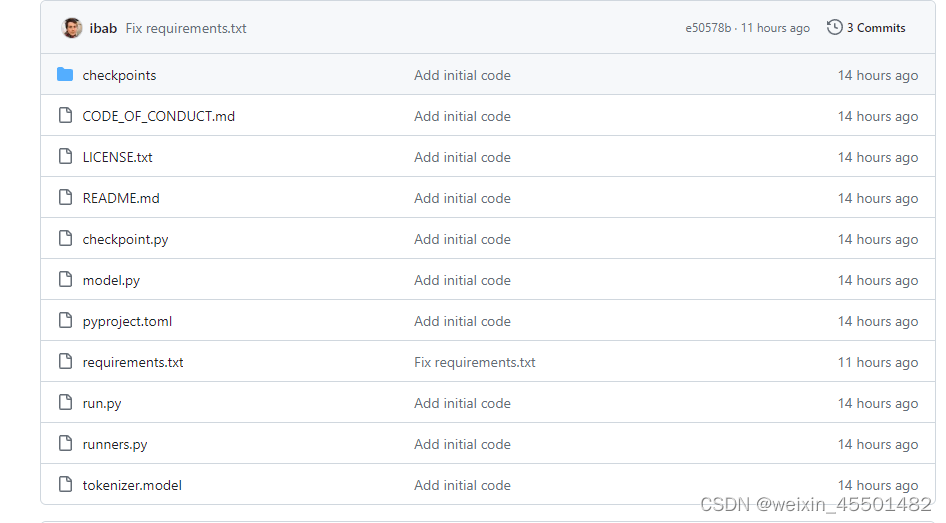

了Grok-1公布的代码和权重https://github.com/xai-org/grok-1,

该存储库包含用于加载和运行 Grok-1 开放权重模型的 JAX 示例代码。使用之前,用户需要确保先下载 checkpoint,并将 ckpt-0 目录放置在 checkpoint 中, 然后,运行下面代码进行测试:

- pip install -r requirements.txt

- python run.py

项目说明中明确强调,由于 Grok-1 是一个规模较大(314B 参数)的模型,因此需要有足够 GPU 内存的机器才能使用示例代码测试模型。此外,该存储库中 MoE 层的实现效率并不高,之所以选择该实现是为了避免需要自定义内核来验证模型的正确性。

用户可以使用 Torrent 客户端和这个磁力链接来下载权重文件:

magnet:?xt=urn:btih:5f96d43576e3d386c9ba65b883210a393b68210e&tr=https%3A%2F%2Facademictorrents有网友开始好奇 314B 参数的 Grok-1 到底需要怎样的配置才能运行。对此有人给出答案:可能需要一台拥有 628 GB GPU 内存的机器(每个参数 2 字节)。这么算下来,8xH100(每个 80GB)就可以了。

跟多详细的信息可以查看一下华尔街见闻,写的更加详细。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/从前慢现在也慢/article/detail/293941