为大模型而生!顶流大佬发起成立学术会议 COLM,或成为未来 NLP 最强顶会?!_如何看待 colm 顶会

赞

踩

夕小瑶科技说 原创

作者 | 智商掉了一地、ZenMoore

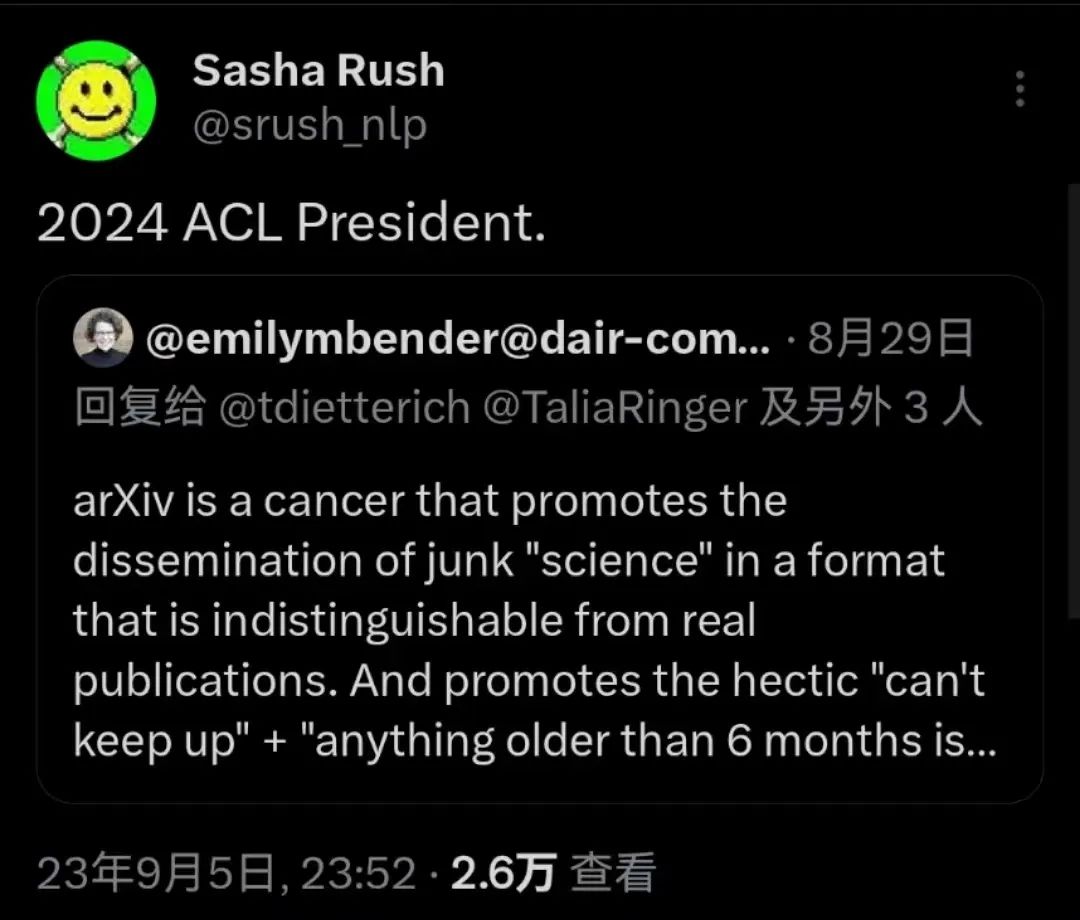

前段时间,ACL 2024 的主席公开抨击称“ arXiv是科研的毒瘤”,这引发了大范围的争论。

一时间,大家对 *CL 的抵触情绪愈发高涨,绝大多数学界都在这场辩论中站在了支持 arXiv+Twitter 的一方。

大模型研究测试传送门

GPT-4传送门(免墙,可直接测试,遇浏览器警告点高级/继续访问即可):

Hello, GPT4!

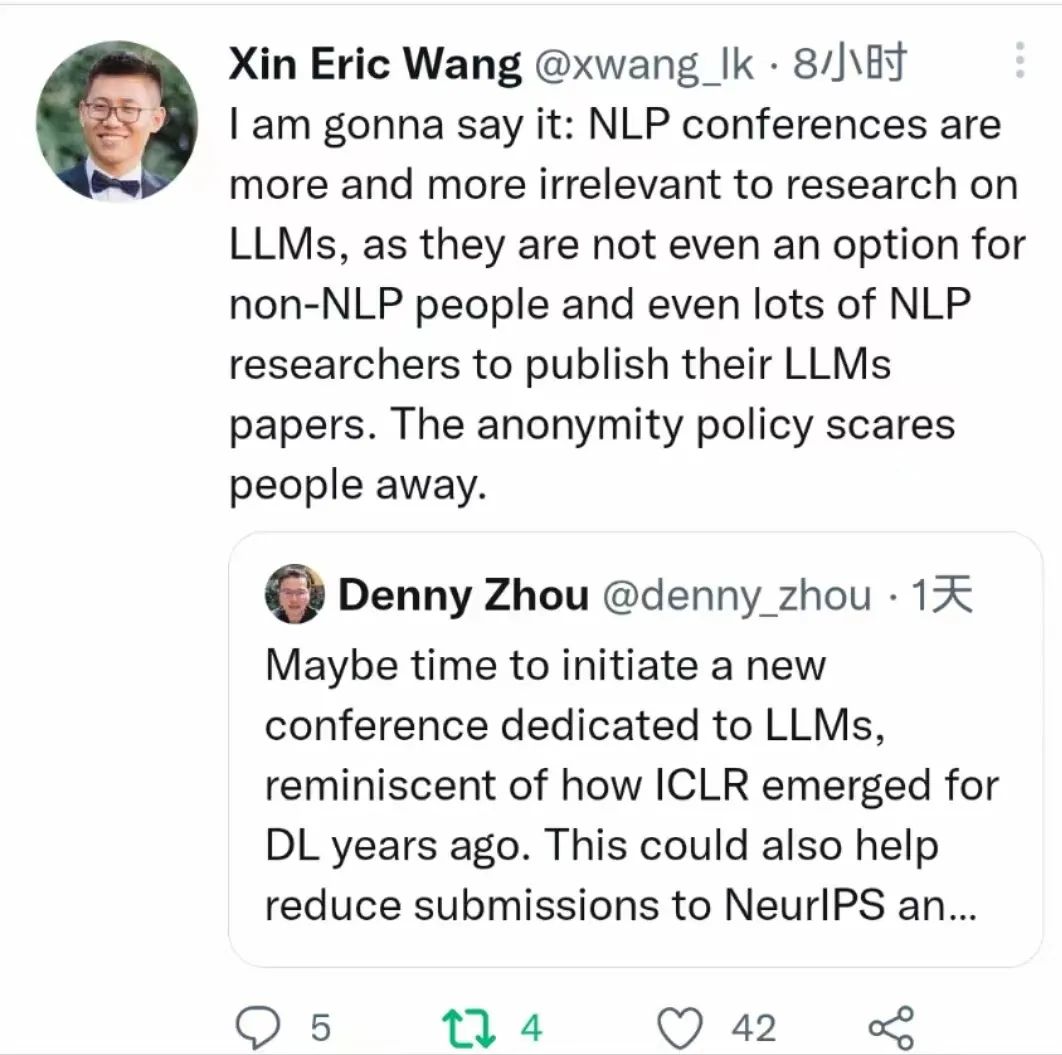

实际上除此之外,学界不止一次地对于学术出版和会议制度进行了广泛辩论,许多顶尖科研人员都表达了对ACL等会议匿名期政策的不满,称论文长达5个月甚至10个月无法在 arXiv 公开,导致常被其他不准备投稿会议的论文抢发,他们甚至还联合发起过一项反对 ACL 设置匿名期的联合署名行动。

这些学者普遍认为,这些匿名政策阻碍了科技的快速进步,限制了文献交流的自由,使得现在的作者们都不太愿意在ACL或类似的会议上投稿。尤其是在这个大模型技术爆炸的年代,arXiv+Twitter 或者 arXiv+微信公众号 的论文宣发方式成为了主流。

一时间,大家纷纷呼吁新会当立...

COLM 的创立

在这个背景下,领域内的一些大佬认为应该为这一新的领域(LLM)设立一场专门的学术会议。类似于 2013 年 ICLR 的成立,就是专门为了 DL 这个新兴领域。

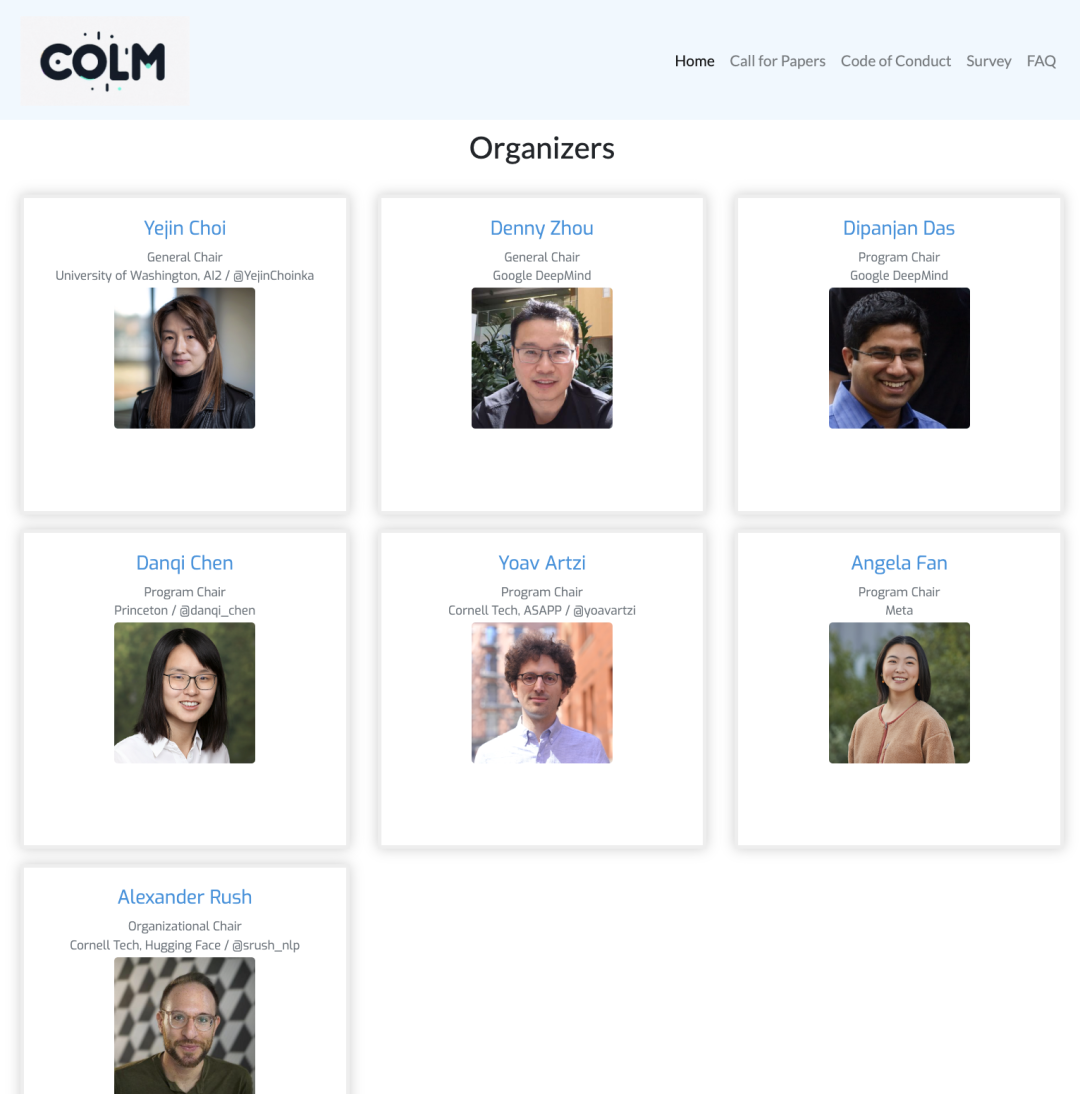

于是,Sasha Rush、Denny Zhou、Yejin Choi 等 NLP 头部科学家联合创立了 NLP 新会议 Conference On Language Modeling(COLM),旨在通过这个专注于语言建模研究的学术平台,创建一个拥有不同学科专业知识的研究人员社区,专注于理解、改进和批评语言模型技术的发展。

COLM 这个新会议的创立不仅是学界的一次创新,也是一个积极的尝试,旨在推动语言模型领域的进一步研究和合作。

回顾 ICLR 在成立后短短五年内就成为了人工智能领域的几大顶级会议之一,我们可以期望三到五年后的 COLM 也将成为 NLP 领域的头部学术会议,甚至超越 ACL/EMNLP/NAACL 目前这三大 NLP 顶会的影响力。

会议链接:https://colmweb.org/

发起人团队

COLM 的第 1 届会议由一支具备广泛语言建模研究经验的团队发起,多位领域内的大佬既包括来自工业界的研究人员,也包括来自学术界的研究人员。

会议投稿主题

COLM 鼓励广泛全面的投稿,涵盖了 LLM 的各个方面,包括对语言模型的理解、改进和批评。该会议的议题包括但不限于:

-

对齐:微调、指导微调、强化学习(包括人类反馈)、提示微调以及上下文对齐。

-

数据:预训练数据、对齐数据以及通过手动或算法分析、采集或生成的合成数据。

-

评估:基准、模拟环境、可扩展监督、评估协议和度量标准,包括人工或机器评估。

-

社会影响:偏见、公平性、滥用、工作、气候变化等。

-

安全性:安全、隐私、错误信息、对抗性攻击和防御。

-

语言模型的科学:规模定律、基本限制、新兴能力、解密、可解释性、复杂性、训练动态、学习理论等。

-

计算高效的语言模型: 优化模型效率,包括模型蒸馏、压缩、量化等。

-

大型语言模型的工程学: 如何在不同的硬件设置上进行分布式训练和推理。

-

语言模型的学习算法: 涵盖元学习、模型混合、持续学习等。

-

语言模型的推理算法: 包括解码、推理、搜索算法等。

-

人类思维、大脑、哲学、法律与语言模型: 从多个角度如认知科学、神经科学、哲学来研究模型。

-

面向所有人的语言模型: 主要关注多语言和文化多样性。

-

语言模型与世界: 包括模型的事实性、常识推理等。

-

具身的语言模型: 和感知、行动、机器人等多模态结合。

-

语言模型与交互: 聚焦交互式学习和多智能体学习。

-

带工具和代码的语言模型: 如何与现有工具和API集成。

-

多模态与新应用领域的语言模型: 探索在视觉、代码、数学等多模态和新应用上的可能性。

COLM 提供了广泛的主题,为研究人员提供了一个独特的平台,以共同推进语言模型领域的研究,他们将采用 NeurIPS 的投稿和评审政策,并采用 OpenReview 的相关流程。

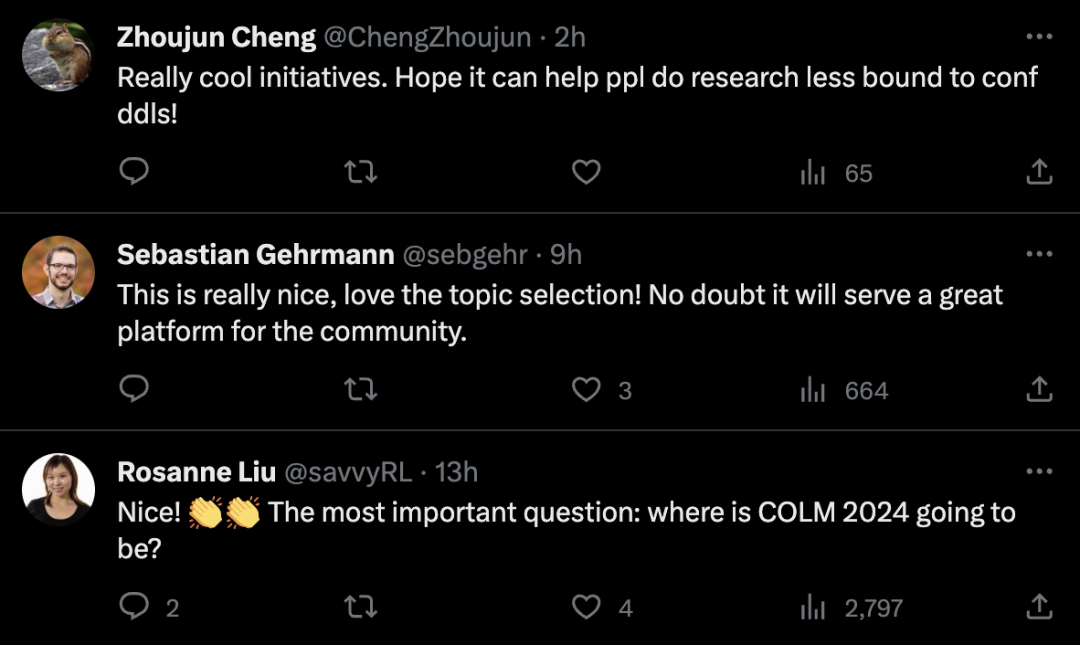

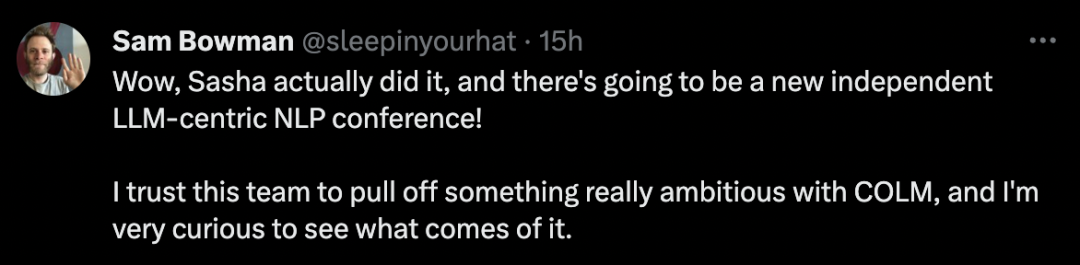

有许多研究人员对于这个新创办的会议表达了期待与赞同。

会议重要时间节点

-

截稿日期:2024 年 3 月 15 日(AoE 时间)

-

举办时间:2024 年 10 月

Fun Facts

最后,比较有趣的是,COLM 会议博客中解释了为什么选择了羊驼的照片,将其形容为“丑萌丑萌的”。这不仅为 COLM 添加了一些幽默,也使这个新会议变得独具特色。

那么问题来了,大家准备投稿这个会议吗?欢迎在评论区留言想法~