- 1在IDE中刷LeetCode,编码调试一体化,刷题效率直线up!

- 2Python深度学习十大核心算法!_深度学习算法

- 3【Flutter】Flutter CLI (4):命令 flutter build 构建应用_flutter build 命令

- 4LSTM分类模型

- 5R3LIVE代码详解(一)_r3live代码解析

- 6spring中的事务传播机制_propagation.not_supported

- 7python3爬取网易云歌单数据清洗_实例 | 使用网易云音乐数据演示数据整合与数据清洗...

- 8探究flask中的celery后台任务_flask_celeryext

- 9用过Apifox这个API接口工具后,确实感觉postman有点鸡肋......_apifox接口生成太垃圾了

- 10springboot+mysql+微信小程序点餐系统-计算机毕业设计源码65933_面馆点餐小程序mysql源代码

idea上java项目连接hdfs_java maven项目连接hadoop,端口需要改吗

赞

踩

提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

前言

在开发udf过程中,遇到了需要访问hdfs的情况,开发好udf之后需要在idea上测试,因此需要连接公司的远程Hadoop集群。

提示:以下是本篇文章正文内容,下面案例可供参考

一、本地Hadoop环境配置(需要先有jdk环境)

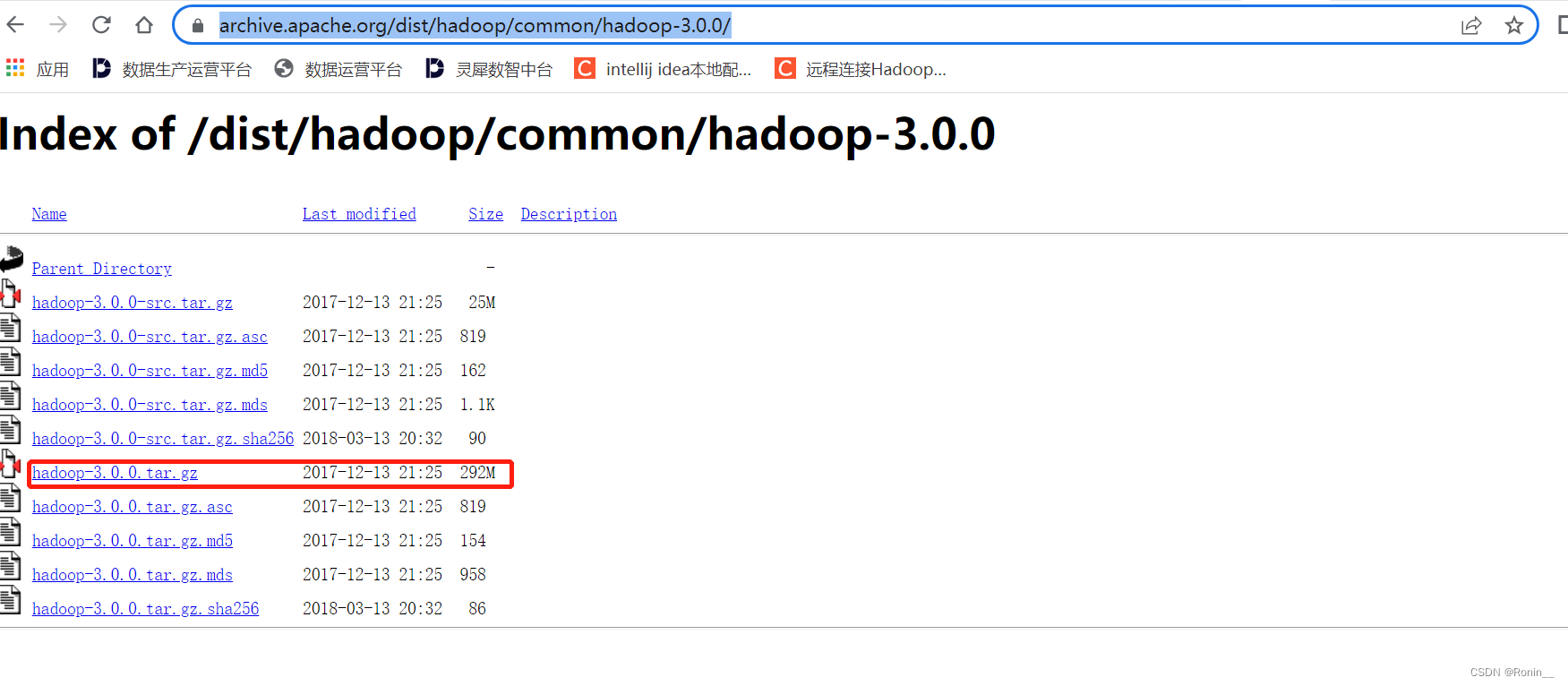

第一步:下载与服务器上的hadoop同版本的hadoop安装包,解压到某个目录(https://archive.apache.org/dist/hadoop/common/hadoop-3.0.0/)

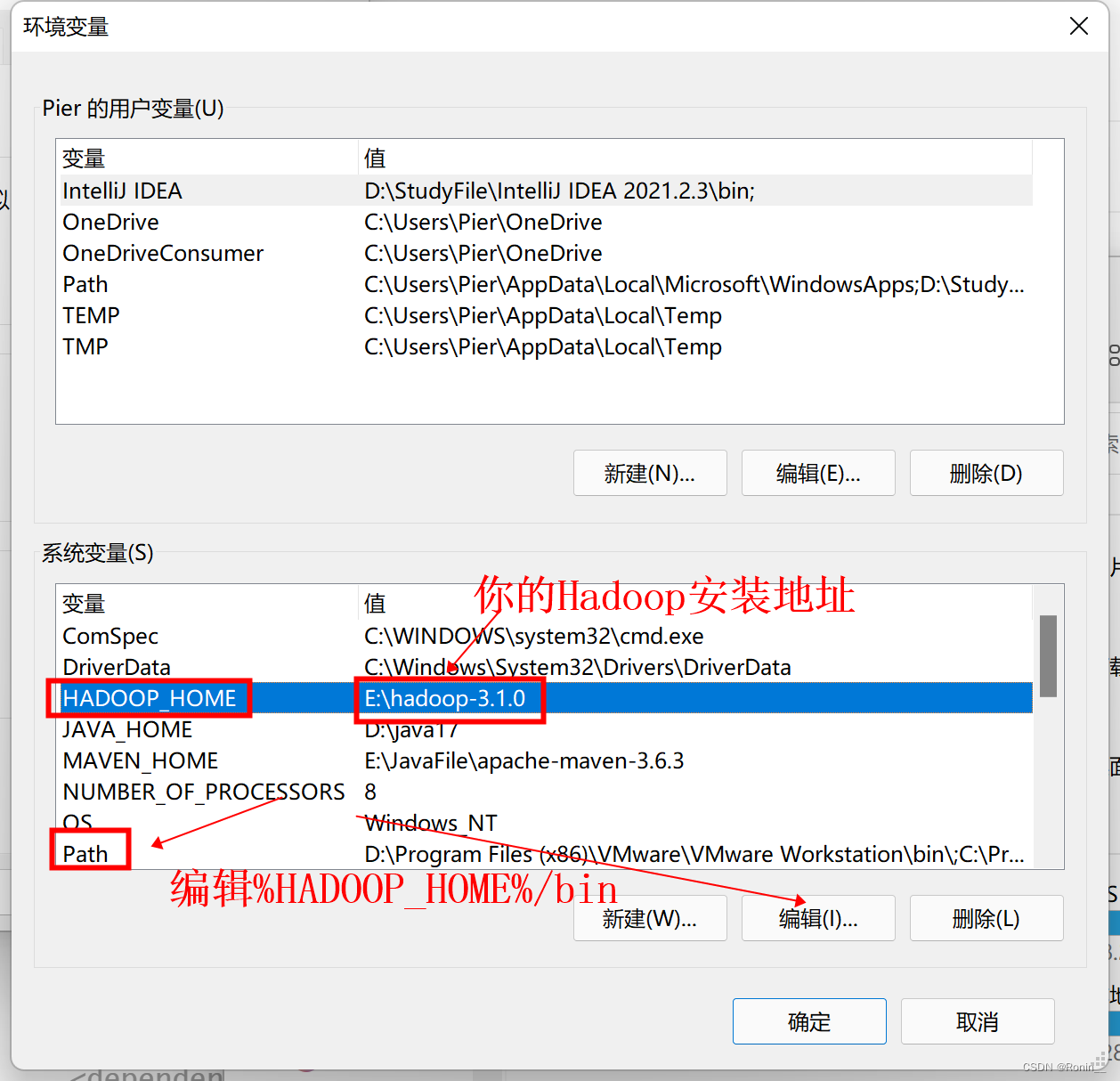

第二步:配置HADOOP_HOME环境变量,然后重启电脑

第二步:配置HADOOP_HOME环境变量,然后重启电脑

%HADOOP_HOME%\bin

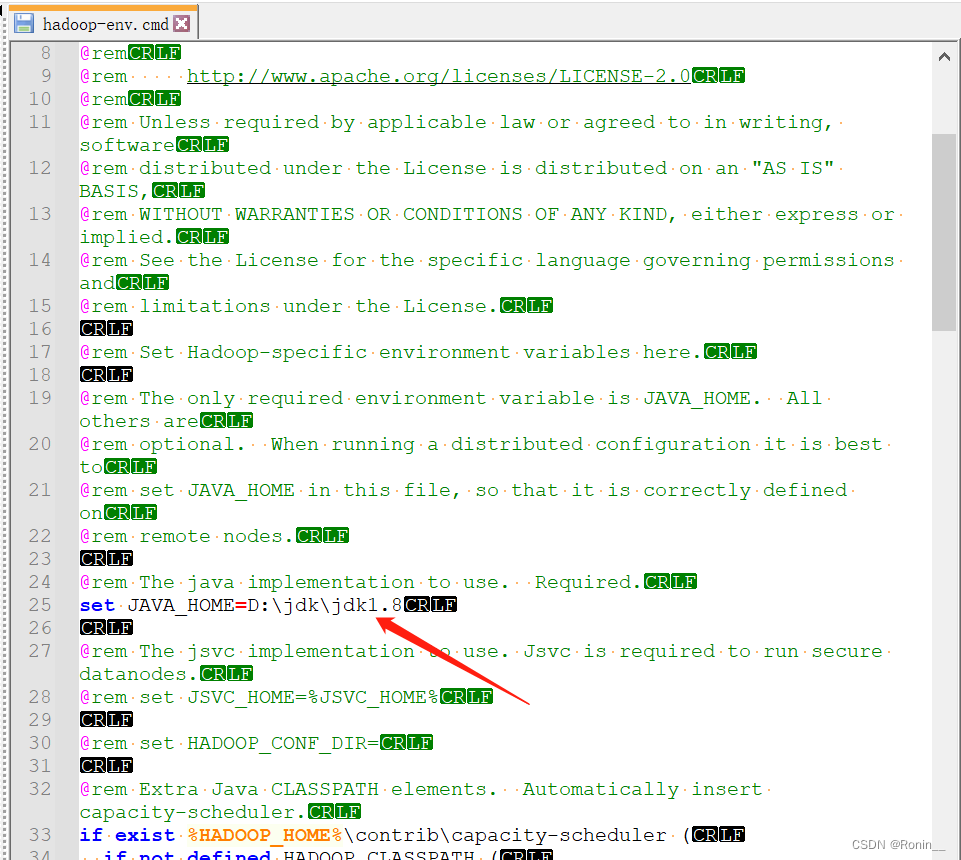

第三步:修改hadoop-env.cmd文件的JAVA_HOME为本地的jdk地址

第三步:修改hadoop-env.cmd文件的JAVA_HOME为本地的jdk地址

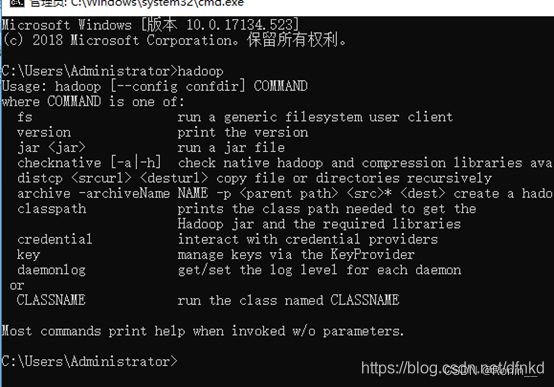

第四步:检验:在dos窗口中输入hadoop

第四步:检验:在dos窗口中输入hadoop

第五步:下载windows下连接hadoop需要的文件hadoop.dll和winutils.exe(https://github.com/cdarlint/winutils/tree/master/hadoop-3.0.2/bin)

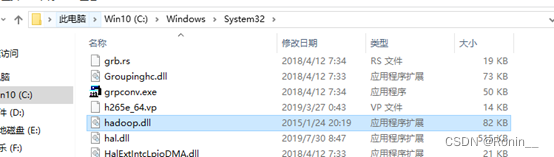

(1)将hadoop.dll复制到C:\Windows\System32目录下

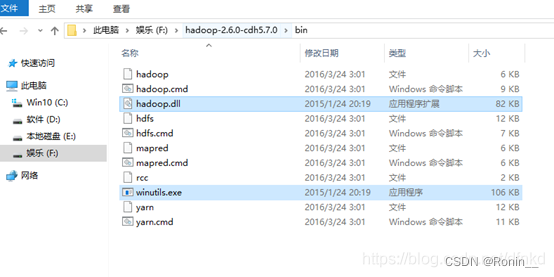

(2)将hadoop.dll和winutils.exe复制到F:\hadoop-2.6.0-cdh5.7.0\bin目录下

(2)将hadoop.dll和winutils.exe复制到F:\hadoop-2.6.0-cdh5.7.0\bin目录下

二、idea配置

1.创建maven,导入pom.xml依赖

pom.xml如下(这几个依赖尽量写上,不然可能报错):

</dependency> <!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-common --> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-common</artifactId> <version>2.8.5</version> </dependency> <!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-hdfs --> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-hdfs</artifactId> <version>2.8.5</version> </dependency> <!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-mapreduce-client-core --> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-mapreduce-client-core</artifactId> <version>2.8.5</version> </dependency> <!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-client --> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-client</artifactId> <version>2.8.5</version> </dependency> <!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-yarn-api --> <dependency> <groupId>org.apache.hadoop</groupId> <artifactId>hadoop-yarn-api</artifactId> <version>2.8.5</version> </dependency>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

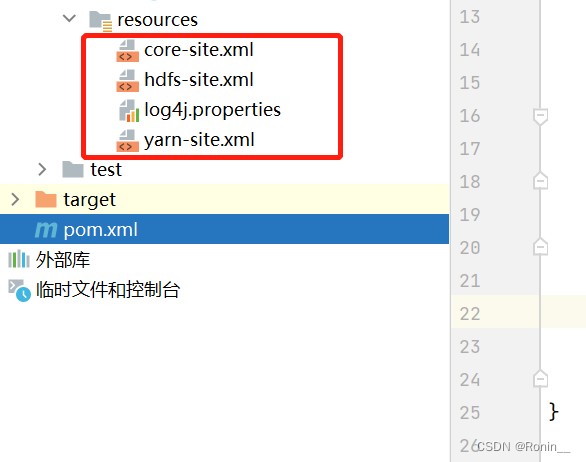

2.导入集群配置文件

把公司集群里的core-site.xml、hdfs-site.xml、yarn-site.xml这几个文件下载下来,丢到maven项目的resources

3.测试

代码如下(示例):

import org.apache.hadoop.conf.Configuration; import org.apache.hadoop.fs.FileSystem; import org.apache.hadoop.fs.Path; import java.io.IOException; public class hdfs_test { public static void main(String[] args) throws IOException { String filename = "hdfs://nameservice1/user/hive/warehouse/ods_broadband_obd_dtl_df/month_id=202206/"; Configuration conf = new Configuration(); conf.set("fs.defaultFS","hdfs://nameservice1"); FileSystem fs = FileSystem.get(conf); if (fs.exists(new Path(filename))){ System.out.println("the file is exist"); }else{ System.out.println("the file is not exist"); } fs.close(); System.out.println("over"); } }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

问题

遇到没有权限访问hdfs路径的情况:Permission denied: user=administrator, access=WRITE

在系统的环境变量里面添加HADOOP_USER_NAME=hadoop(HDFS上的有权限的用户,具体看自己的情况),修改完环境变量后,记得重启一下idea

参考:https://blog.csdn.net/zhangjunli/article/details/106321516