热门标签

热门文章

- 1python3写一个http接口服务(get, post),给别人调用2--flask_如何将自己的python算法发布一个服务,别人能够post请求

- 22024年新高考1卷数学试题-第19题AI解析_2024新高考一卷19题答案

- 3python脚本开发_编写python脚本

- 4Java性能优化实践:分享Java性能优化的实践经验

- 5「小白必读」国内超火的 8 款 AI 大模型,你的副业都来自它_类似文心一言的ai大模型

- 6大数据Hadoop,XShell,启动集群(HDFS,YARN)和关闭防火墙代码_xshell启动hadoop命令

- 7传神社区|数据集合集第4期|中文NLP数据集合集

- 8Flink教程(06)- Flink批流一体API(Source示例)_flink fromsource

- 9Python爬虫使用的IP协议主要是什么

- 10共享虚拟主机容量越大越好嘛?

当前位置: article > 正文

论文笔记 EMNLP 2019|HMEAE: Hierarchical Modular Event Argument Extraction_hmeae:hierarchical modular event argument extracti

作者:从前慢现在也慢 | 2024-06-27 03:35:16

赞

踩

hmeae:hierarchical modular event argument extraction[

1 简介

论文题目:HMEAE: Hierarchical Modular Event Argument Extraction

论文来源:EMNLP 2019

论文链接:https://aclanthology.org/D19-1584.pdf

代码链接:https://github.com/thunlp/HMEAE

1.1 动机

- 现有方法将参数角色视为相互独立,没有考虑到一些论元角色与其他论元角色是相似的。

1.2 创新

- 为每个论元角色分配上级概念(superordinate concepts),如下图,通过建模多个上级概念(人工设计8个),提高论元抽取的准确率。

2 方法

模型的整体框架如下图,主要分为下面三个部分:

- Instance Encoder: 一个实例为一个n个词的序列

x

=

{

w

1

,

.

.

.

,

t

,

.

.

.

,

a

,

.

.

.

,

w

n

}

x=\{w_1,...,t,...,a,...,w_n\}

x={w1,...,t,...,a,...,wn}(其中t为触发词,a为候选论元),分别使用bert或者cnn编码,然后进行动态多池化操作,公式如下:

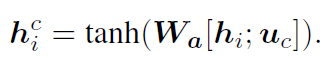

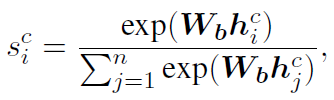

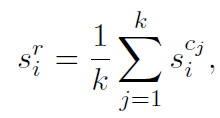

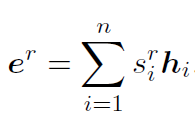

- Hierarchical Modular Attention: 此模块分为两部分,首先计算每个隐藏向量对每个上级概念的注意力分数(如下面第一行公式, u c u_c uc为可学习的向量,表示一个具体的上级概念c),然后进行将注意力分数进行融合,再求出相应的向量(一个论元角色可能属于多个上级概念,如下面第二行公式)。

|

|

|

|

- Argument Role Classifier: 将上述得到的向量与实例编码x进行拼接,然后进行论元角色分类,公式如下:

目标函数为:

3 实验

实验数据集为ACE 2005和TAC KBP 2016(没有训练数据集,鼓励使用其他资源进行训练,本篇论文使用ACE 2005数据集训练),对于进行bert编码,为了利用事件类型的信息,使用一个特殊的token表示事件类型,实验结果如下图:

Case Study:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/从前慢现在也慢/article/detail/761192

推荐阅读

相关标签