热门标签

热门文章

- 1快速体验 Llama3 的 4 种方式,本地部署,800 tokens/s 的推理速度真的太快了!_llama3 8b token

- 2【2019秋招刷题】华为0911笔试题_华为9.11笔试

- 3单元测试的心法分享

- 4Error while loading conda entry point: conda-libmamba-solver (libarchive.so.19: cannot open shared o

- 5HDMI接口协议_hdmi协商过程

- 6【AWS基础】AWS服务介绍与基本使用

- 7oracle sql经典面试题,经典SQL面试题2

- 8git 默认使用vim编辑器命令_git中的vim命令

- 9vue代码提交时忽略./history和node_modules文件修改_vscode 提交git 忽略.history文件

- 10如何在Macbook上安装MySQL

当前位置: article > 正文

Win环境下Ollama+OpenWebUI本地部署llama教程_win10 openwebui

作者:从前慢现在也慢 | 2024-08-05 14:04:52

赞

踩

win10 openwebui

本文将简单介绍如何在Windows环境下通过Ollama本地部署大语言模型(LLM),并通过OpenWebUI实现访问。

一、准备工作

1. 系统要求

- 操作系统:Windows 10 或更新版本

- 内存:16GB 以上

- GPU:性能和显存足够,如RTX 3060以上

二、安装Ollama

1. 下载和安装

- 访问Ollama的官网下载适用于Windows的安装包

https://ollama.com/download

- 运行下载的安装包,按照提示完成安装。默认安装路径为:

C:\Users\username\AppData\Local\Programs\Ollama

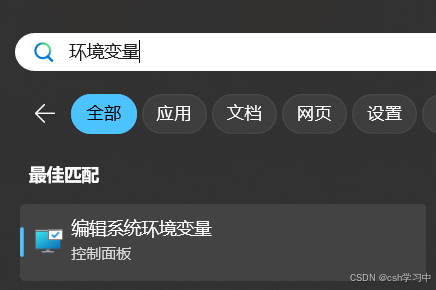

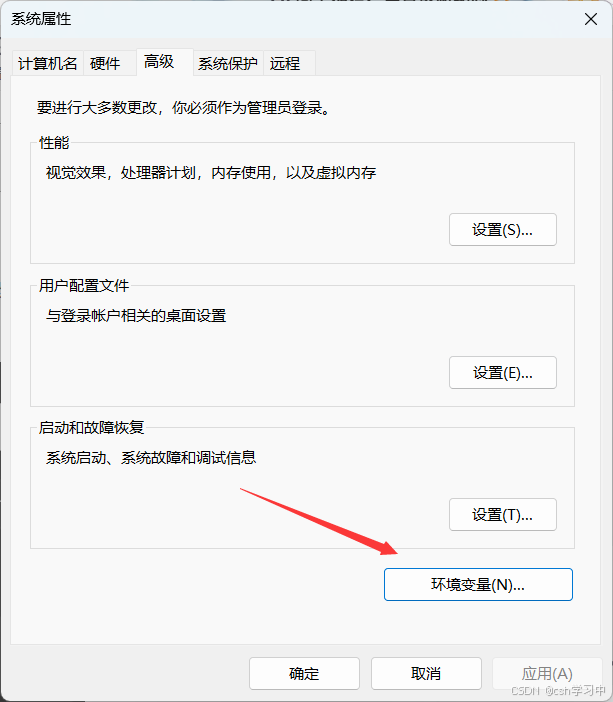

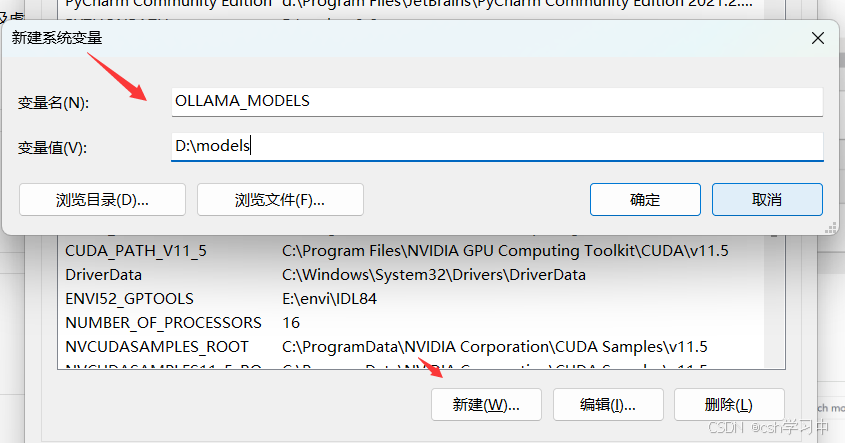

2. 配置环境变量

同时,因为默认安装和模型下载路径为C盘,为了更改模型的下载路径,可以在环境变量中这样修改:

三、运行Ollama模型

1. 下载模型

Ollama支持多种LLM模型,例如Llama2、Llama3等。你可以使用以下命令下载并运行模型:

ollama run llama2如果Ollama找不到模型,它会自动下载。下载完成后,你可以在命令行中输入提示以测试模型。

2. 列出本地模型

使用以下命令查看已下载的模型列表:

ollama list四、安装OpenWebUI

1. 下载和安装

OpenWebUI是一个用户友好的Web界面,便于与LLM进行交互。你可以从其GitHub仓库下载最新版本。以下是非Docker方式的安装步骤:

- 下载OpenWebUI的安装包,并解压到指定目录。

- 打开命令行,进入OpenWebUI的解压目录,运行以下命令安装依赖:

npm install安装完成后,启动OpenWebUI:

npm start2. 配置和访问

启动后,OpenWebUI将在本地的3000端口运行。你可以在浏览器中访问http://localhost:3000查看和使用Web界面。

五、实现公网访问

如果你需要在公网环境中访问本地部署的LLM,可以使用内网穿透工具如cpolar:

安装并配置cpolar,具体步骤请参考cpolar官网,并运行以下命令将本地的3000端口暴露到公网:

cpolar http 3000获取公网地址后,你可以在任何地方通过该地址访问OpenWebUI界面。

【参考资料】

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/从前慢现在也慢/article/detail/932747

推荐阅读

相关标签