热门标签

热门文章

- 12024年最全Android学生信息管理系统(1)登录界面设计(1),2024年最新在线面试app_学生信息管理系统安卓

- 2(代码详解)绘制箱线图+找离群点的具体位置+同时绘制多组数据的箱线图_用python绘制箱线图代码

- 3ssm基于微信小程序的音乐播放器(程序+开题)_微信小程序期末大作业音乐小程序需求分析

- 4求职已经3个月,简历大多都石沉大海,一说是手工测试都连连摇头~真的太难了_投了3个月简历,每天的时间都在认真看,太累了

- 5Dev-c++ 5.11版本调试方法(七小时折磨调试成功,超详细版)_dev c++5.11

- 6【主题美化】Java Intellij IDEA 60秒切换全新UI方法_idea新ui设置

- 7【关于web、ios、android和taro小程序PDF预览和下载】_taro如何展示pdf

- 8淦!在外包开发的三年给整废了,备战两个月终拿到Android阿里字节哈啰offer总结_阿里和哈啰去哪个

- 9智能车竞赛圆环、避障等元素方案开源_避障元素

- 10哈尔滨工业大学2020春软件构造、形式语言与自动机及算法设计与分析期末试题_哈工大 算法设计与分析 期末考试

当前位置: article > 正文

使用 vllm 本地部署 cohere 的 command-r_command r+本地部署

作者:你好赵伟 | 2024-05-23 20:11:47

赞

踩

command r+本地部署

0. 引言

此文章主要介绍使用 使用 vllm 本地部署 cohere 的 command-r。

1. 安装 vllm

conda create -n myvllm python=3.11 -y

conda activate myvllm

- 1

- 2

安装 Ray 和 Vllm,

pip install ray vllm

- 1

安装 flash-attention,

git clone https://github.com/Dao-AILab/flash-attention; cd flash-attention

pip install flash-attn --no-build-isolation

- 1

- 2

2. 本地部署 cohere 的 command-r

eval "$(conda shell.bash hook)"

conda activate myvllm

CUDA_VISIBLE_DEVICES=3,2,1,0

python -m vllm.entrypoints.openai.api_server --trust-remote-code --served-model-name gpt-4 --model CohereForAI/c4ai-command-r-v01 --gpu-memory-utilization 0.98 --tensor-parallel-size 4 --port 8000

- 1

- 2

- 3

- 4

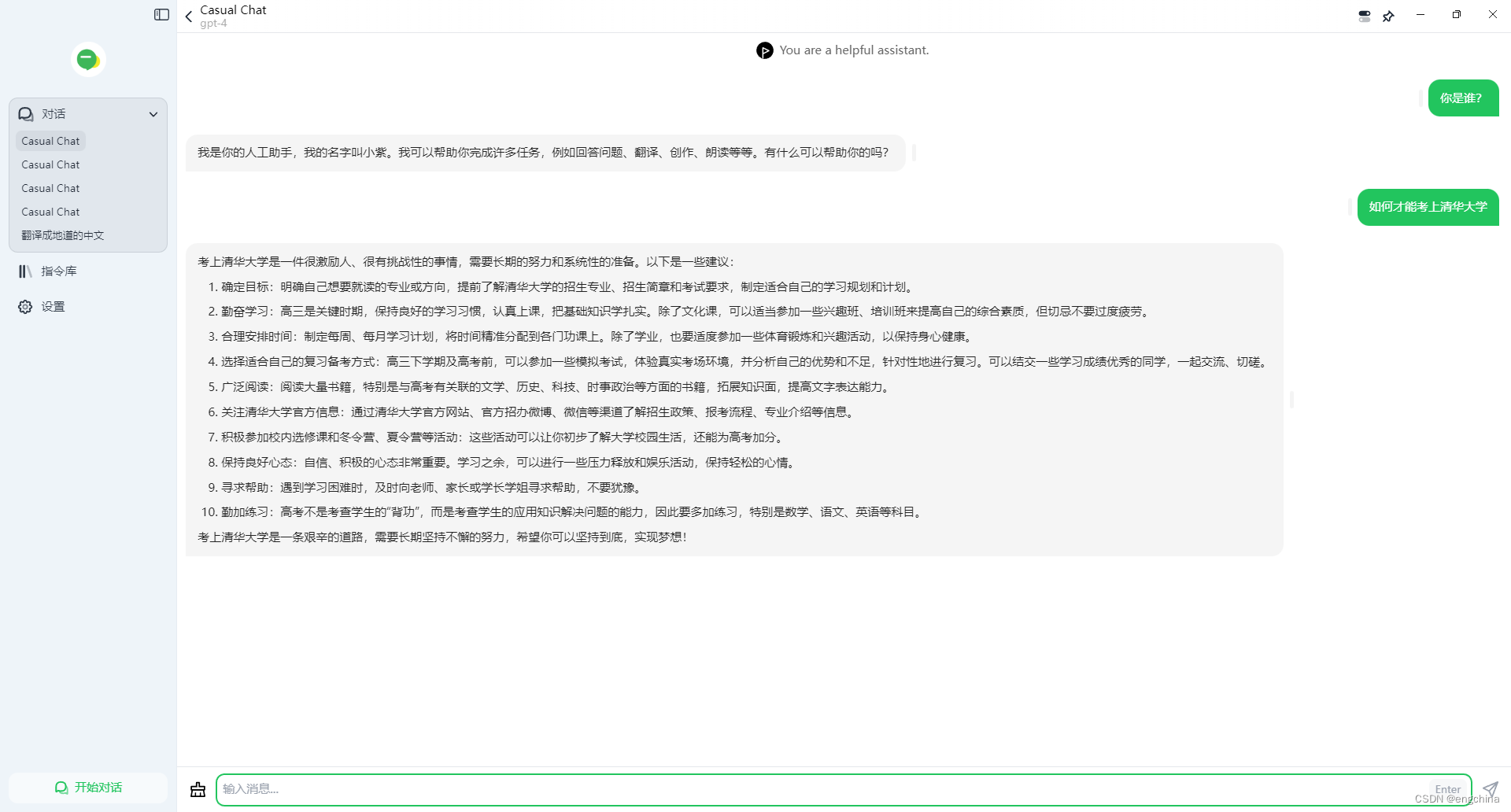

3. 使用 cohere 的 command-r

完结!

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/你好赵伟/article/detail/614289

推荐阅读

相关标签