- 1软件测试mysql面试题:NVL函数,IFNULL函数和ISNULL函数有什么区别?_nvl函数和isnull函数一样吗

- 2nvm安装版本失败,github访问失败导致_dial tcp 20.205.243.166:443: connectex: a connecti

- 3与ChatGPT竞争的其他AI语言模型:BERT、ELMo、GPT-Neo等_chatgpt类似的预训练语言模型

- 4【ESP32接入语言大模型之通义千问】_esp32接入大模型

- 5c语言max函数是什么,什么是C语言函数

- 6redis数据类型之string,list

- 7Informer开源项目(3)_informerstack

- 8Java的类和对象

- 92024免费MacBook清理工具CleanMyMac X4.15_clearmymac 4.15.3

- 10【观察】提速中国大数据普惠之路,曙光大数据的沉淀与释放

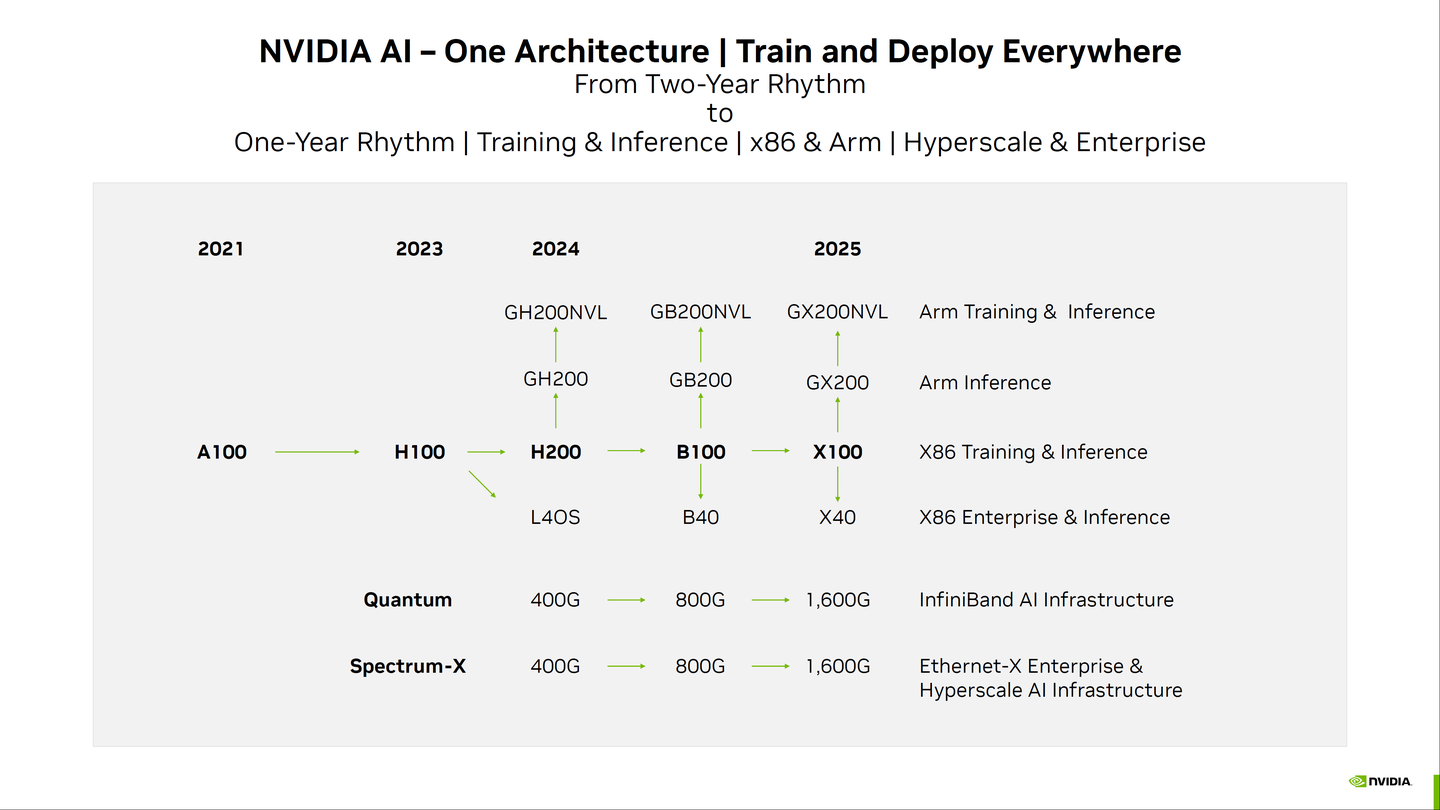

Nvidia B100/B200/GB200 关键技术解读_a100 h100 b100 b200

赞

踩

芯片

1. GPU芯片

-

晶体管数:

-

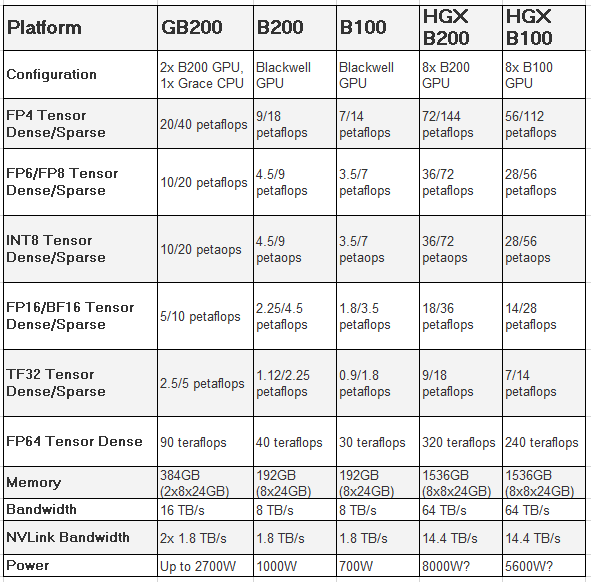

B200 GPU的晶体管数量是现有H100的两倍多,但B200封装了2080亿个晶体管(而H100/H200上为800亿个)。这意味着B200芯片封装密度比H100进一步提高,对管理散热和功耗也提出了更高的要求。

-

FP4精度:

-

引入一种新的计算精度,位宽比FP8进一步降低,B200峰值算力达18P。

-

FP6精度:

-

位宽介于FP4和FP8之间。

-

NV高带宽接口(Nvidia High Bandwidth Interface):

-

B200有两个Die,高速连接通道NV-HBI达到10TB/s。两个Die是一个统一的Cuda GPU。NV-HBI会占用一定的芯片面积。

-

内存:

-

B200每个Die有4个24GB的HBM3e stack,合计一个Cuda GPU有192GB内存,内存带宽达8TB/s。相比H200时代六个内存控制器,可以减少内存接口的芯片面积,从而使得计算面积可以更大。

-

GB200:

-

有两个B200(4个GPU Die)和一个Grace CPU,2700W。

2. NVLink芯片

第五代NV-Link芯片,双向带宽达1.8TB/s = 18(links) * 50GB/s (bandwidth each direction) * 2,是Hopper GPU使用的第四代NV-Link的2倍。最大支持576个GPU的连接,相比上一代是256个。

3. NVSwitch芯片

第四代NVSwitch芯片,7.2TB/s的全双工带宽,是上一代的两倍。

4. DPU和CPU没有更新

服务器

-

HGX B200:

-

一机八B200整机解决方案。每个B200是1000W。

-

HGX B100:

-

一机八B100整机解决方案。每个B100是700W。

GB200 SuperPOD 服务器

-

GB200 superchip:

-

2个CPU和4个B200。这个compute tray是1U的,液冷。

-

GB200 NVL72:

-

包含18个1U compute tray(共72个B200)、9个Switch Tray(共18个Switch )。

-

GB200 superPOD:

-

576个B200 GPU。与H100相比,superpod的训练性能提升4倍,推理性能提高30倍,能效提高25倍。

Blackwell 架构的 GPU

基本技术参数

一文看懂英伟达A100、A800、H100、H800各个版本有什么区别? - 知乎 (zhihu.com)

AI核弹B200发布:超级GPU新架构30倍H100单机可训15个GPT-4模型,AI进入新摩尔时代 - 知乎 (zhihu.com)

先进计算技术路线图(2023) - 知乎 (zhihu.com)

建议收藏!大模型100篇必读论文 - 知乎 (zhihu.com)

马斯克起诉 OpenAI:精彩程度堪比电视剧,马斯克与奥特曼、OpenAI的「爱恨纠缠史」 - 知乎 (zhihu.com)

2023第一性原理科研服务器、量化计算平台推荐 - 知乎 (zhihu.com)

Llama-2 LLM各个版本GPU服务器的配置要求是什么? - 知乎 (zhihu.com)

人工智能训练与推理工作站、服务器、集群硬件配置推荐

整理了一些深度学习,人工智能方面的资料,可以看看

机器学习、深度学习和强化学习的关系和区别是什么? - 知乎 (zhihu.com)

人工智能 (Artificial Intelligence, AI)主要应用领域和三种形态:弱人工智能、强人工智能和超级人工智能。

买硬件服务器划算还是租云服务器划算? - 知乎 (zhihu.com)

深度学习机器学习知识点全面总结 - 知乎 (zhihu.com)

自学机器学习、深度学习、人工智能的网站看这里 - 知乎 (zhihu.com)

2023年深度学习GPU服务器配置推荐参考(3) - 知乎 (zhihu.com)

多年来一直专注于科学计算服务器,入围政采平台,H100、A100、H800、A800、L40、L40S、RTX6000 Ada,RTX A6000,单台双路256核心服务器等。