- 1Ubuntu服务器更改远程端口号的方法_ubuntu网络port怎么设置

- 2CloudFlare域名管理系统_cloudflare批量管理

- 3php论坛源代码,php论坛源代码下载

- 4AutoCompress: An Automatic DNN Structured Pruning Framework for Ultra-High Compression Rates

- 5Strongswan与Andriod野蛮模式L2TPoverIPsec对接有时候不成功。_strongswan ipsec不生效

- 6算法32:环形链表(有双指针)_求环形链表的节点数java

- 7idea2018项目导入2020.1idea依赖包失败的解决方法_getloadedimportedassetsandartifactids called with

- 8Python爬虫:代理ip电商数据实战

- 9聚类分析之 K均值_k均值聚类适用于什么样的数据

- 10python uiautomator2 安装及使用_python uiautomatic2 使用方法

揭秘大模型AI Agent:人工智能的新纪元_ai agent四大特征

赞

踩

什么是AI Agent(LLM Agent)

“Agent”是一个跨学科的概念,涵盖了哲学、计算机科学、经济学、生物学等多个领域。尽管定义和应用范围各异,代理的核心特征在于其自主性、感知和决策能力,以及目标导向的行动能力。理解代理在不同领域中的具体应用和特征,有助于更全面地认识和利用这一概念。

哲学领域中的Agent

在哲学中,Agent通常指具有意图和行动能力的个体或实体。主要特征包括:意图性(Intentionality):代理的行动是基于某种目标或意图的、行动能力(Agency):代理能够自主选择和执行行动、道德和法律责任:代理对其行为的结果负有责任。哲学中的代理可以是人、动物,甚至是具有一定自主性的抽象实体(如公司、政府)。研究内容包括自由意志、道德责任和意识等。

计算机科学和人工智能中的Agent

在计算机科学和人工智能领域,Agent通常指一种能够感知环境、做出决策并采取行动的软件或硬件系统。根据其复杂程度和功能,智能体可以分为以下几类:简单反应智能体(Simple Reflex Agents):基于当前感知做出预定义的反应、基于模型的智能体(Model-Based Agents):维护环境的内部模型,根据模型进行决策、目标导向智能体(Goal-Based Agents):基于目标进行规划和行动、效用导向智能体(Utility-Based Agents):评估不同目标的效用以选择最佳策略。

软件工程中的Agent

在软件工程中,Agent是指一种自主的、具备决策能力的软件组件。这些智能体可以用于自动化任务管理、数据处理和用户交互。特征包括:自主性(Autonomy):智能体可以独立运行和决策,社会性(Social Ability):智能体可以与其他智能体或系统进行交互,反应性和主动性(Reactivity and Proactivity):智能体不仅能够对环境变化做出反应,还能够主动采取行动。

Agent 的复杂程度各不相同,一个简单的恒温器可以是一个 Agent,一个大型的国家或者一个生物群体也可能是个 Agent。感知环境、自主决策、具备行动能力,设定明确的目标和任务,适应环境及学习能力,都是 Agent 的关键特点。

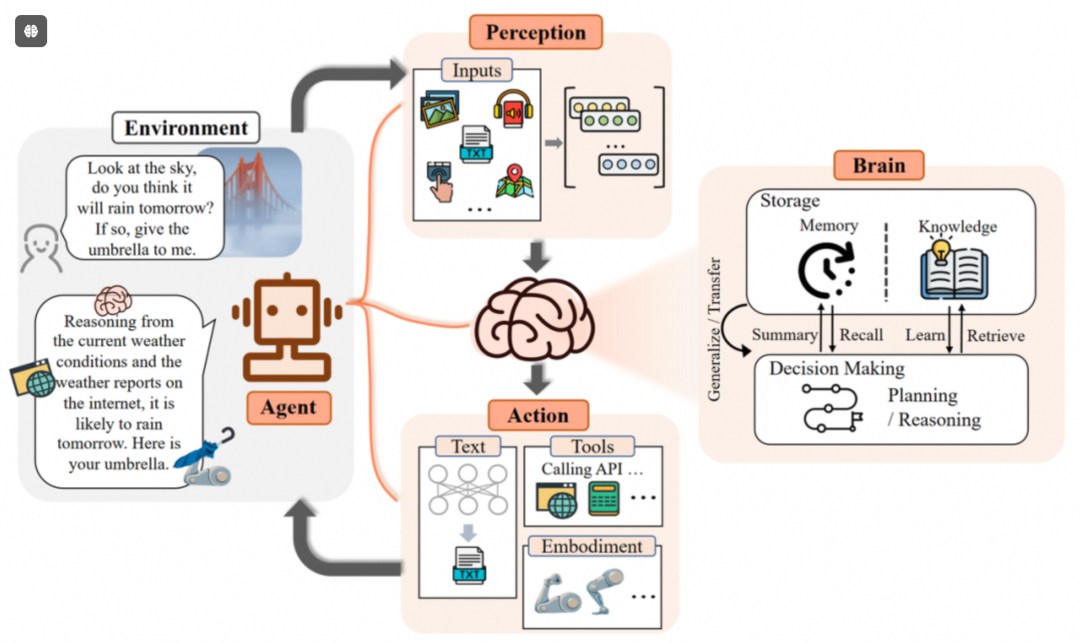

通常来说,一个智能体(Agent)可以分为三个主要模块:大脑(Brain)、感知(Perception)和行动(Action)。

大脑(Brain)

大脑模块是智能体的核心,用于进行规划和决策。这个模块通常由一个大语言模型(如GPT)构成,能够处理复杂的推理和决策任务。大脑模块的主要功能包括:

-

存储感知信息:接收并存储从感知模块传来的环境数据。

-

知识库检索:访问和检索内部知识库中的相关信息,以支持决策过程。

-

计划制定:根据当前的环境状态和目标,制定详细的行动计划。

-

推理决策:进行逻辑推理,选择最优行动策略。

感知(Perception)

感知模块负责对环境进行感知和理解。它通过处理各种类型的数据,如文本、视觉和音频,来拓展智能体对环境的感知能力。感知模块的主要功能包括:

-

文本感知:处理和理解自然语言文本,提取有用信息。

-

视觉感知:通过图像和视频数据识别和理解环境中的物体和场景。

-

音频感知:处理声音和语音信号,识别语音指令和环境声音。

行动(Action)

-

行动模块负责执行大脑模块制定的决策。它调用相关工具和执行具体操作,并根据执行结果提供反馈。行动模块的主要功能包括:

-

工具调用:根据决策调用特定的工具或服务,例如执行某个软件命令或控制硬件设备。

-

任务执行:按照制定的计划执行具体任务,如机器人移动、数据处理等。

-

反馈获取:监控执行过程,获取执行结果,并将反馈信息传回大脑模块进行进一步处理。

模块间的交互

-

感知模块收集和处理环境信息,将处理后的数据传递给大脑模块。

-

大脑模块存储这些信息,并通过知识库检索、计划制定和推理决策来生成具体的行动策略。

-

行动模块根据大脑模块的决策执行具体操作,并提供执行反馈。

示例

自动驾驶智能体

-

大脑:使用深度学习模型进行路径规划和决策,包括路线选择和避障。

-

感知:通过摄像头、激光雷达和雷达感知道路和周围环境。

-

行动:控制车辆的方向盘、油门和刹车,执行驾驶操作。

智能家居助手

-

大脑:根据用户指令和环境数据进行决策,例如调节温度或播放音乐。

-

感知:通过传感器收集家庭环境数据,如温度、湿度和活动情况。

-

行动:控制家电设备,根据用户需求和感知数据执行操作。

这种模块化设计使智能体能够灵活应对各种环境和任务需求,提高系统的效率和可靠性

AI Agent的结构模型

智能体的应用结构主要分为三种类型:这三种结构各有其特点和适用场景,可根据具体应用需求选择合适的智能体应用结构。

单智能体(Single-Agent)系统

单智能体系统指的是在任务处理或决策过程中,仅依赖一个独立的智能体来完成所有工作。该智能体具有感知、决策和行动的能力,并通过与环境进行交互来实现目标。

感知(Perception):智能体通过传感器或其他输入渠道感知周围环境的状态。

决策(Decision-Making):智能体基于感知到的环境状态,使用内部的规则、算法或学习模型进行推理和决策。

行动(Action):根据决策结果,智能体执行相应的行动,影响环境状态,并反馈到下一轮的感知和决策中。

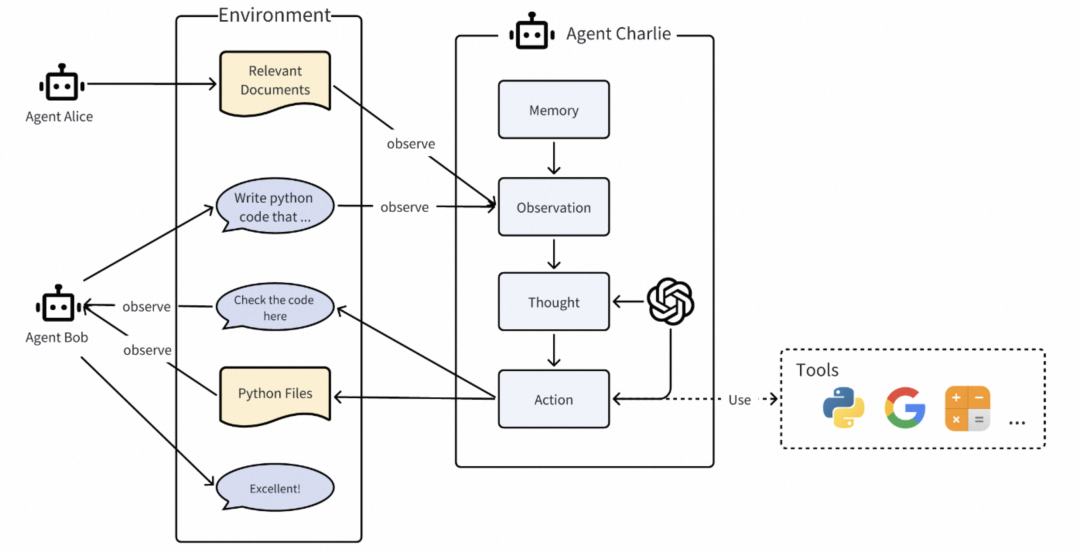

多智能体(Multi-Agent)系统

1. 环境与输入

Relevant Documents: 相关文档,作为任务的输入信息来源,Python Files: Python文件,作为任务的输出信息来源。

2. Agent Alice 与 Agent Bob 的角色

Agent Alice: 任务:从相关文档中提取信息,观察任务要求,行为:根据文档编写Python代码,交互:把生成的代码部分传送给Agent Bob进行检查。

Agent Bob: 任务:检查Agent Alice生成的代码,行为:根据需求进一步测试和验证代码的正确性,交互:将校验后的Python文件输出。

3. Agent Charlie 的角色

Observation(观察):Agent Charlie从环境中观察信息,包括从Agent Alice和Agent Bob那里接收的任务进展。

Memory(记忆):保留和管理任务和代码相关的记忆信息。

Thought(思考):基于观察到的任务信息进行思考和推理,可能通过调用外部的智能体如OpenAI的GPT-3进行高级处理。

Action(行动):在思考和决策之后采取相应的行动,其中包含使用外部工具辅助任务。

4、工具使用

Agent Charlie可能会调用工具来辅助完成特定任务:Python: 编写和测试Python代码,Google搜索: 查找相关信息和资源,计算工具: 进行必要的计算和处理。

5、流程概览

Agent Alice 获取文档内容:从Relevant Documents中获取需要的信息,生成初步的Python代码。

Agent Bob 校验代码:对Agent Alice生成的代码进行检查和验证,并观察是否符合需求。

Agent Charlie 观察并行动:利用观察到的任务信息,思考和决策之后可能调用外部工具进行辅助,并执行必要的行动。

6、协作与循环

多个智能体通过观察环境交互,不断协作,完成使命任务。这种多智能体系统可以显著提高处理复杂任务的效率和准确性。

人机协作系统

结合了人类的智能和机器的计算能力,通过互动和协作完成任务。这种结构特别适用于需要人类进行复杂决策或创意工作的场合,智能体提供辅助和支持。

交互界面:提供直观的用户界面使人类与智能体进行有效的交流和协作。

辅助决策:智能体根据数据分析和算法提供建议和支持,辅助人类决策。

反馈与学习:智能体从人类的反馈中进行学习,优化自身行为和决策策略。

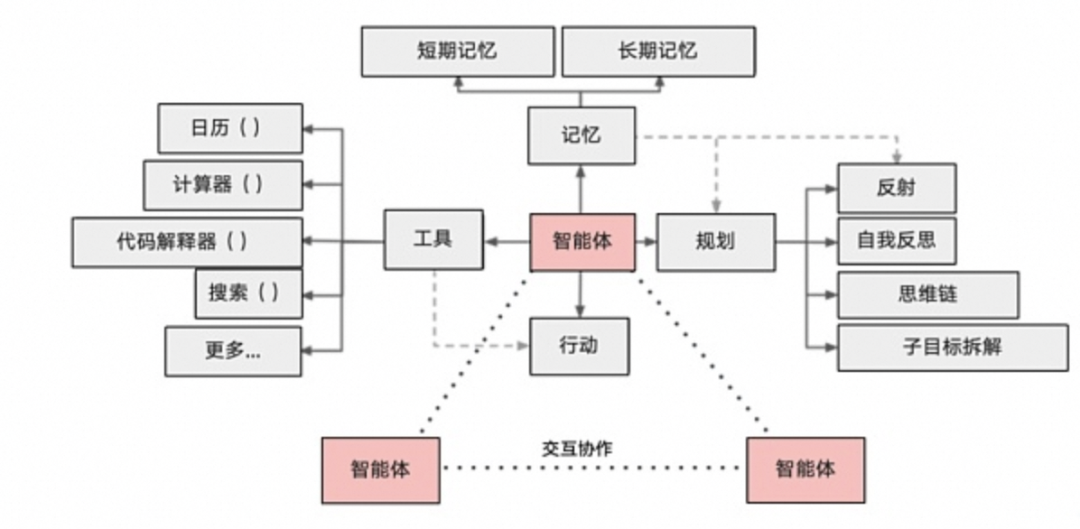

AI Agent的结构模型

一个基于大模型的AI Agent系统可以拆分为大模型、规划、记忆与工具使用四个组件部分。Agent=LLM+规划技能+记忆+工具使用的基础架构,其中LLM扮演了Agent的“大脑”,在这个系统中提供推理、规划等能力。

大模型与规划:Agent 的“大脑”实现任务分解

智能代理(Agent)的“大脑”通过思维链(Chain of Thought)能力来实现任务的分解和处理。大语言模型(LLM)具备逻辑推理的能力,Agent 可以进一步激发和利用这种能力。当大模型规模足够大时,LLM 就具备了强大的推理功能。在简单推理问题上,LLM 已经展示出很高的准确性,但面对复杂推理问题时,有时仍会出现错误。

实际上,用户无法通过 LLM 获得理想回答的一个主要原因在于提示词(Prompt)设计不够合适,无法充分激发出 LLM 的推理能力。通过追加辅助推理提示词,可以显著提升 LLM 的推理效果。例如,《Large Language Models are Zero-Shot Reasoners》这篇论文的测试中,通过在向 LLM 提问时追加“Let’s think step by step”,数学推理测试集 GSM8K 上的推理准确率从 10.4% 提升到 40.7%。

作为智能体代理,Agent 能够根据给定的目标自主创建合适的提示词,从而更好地激发大模型的推理能力。通过这种方式,Agent 可以以更高的效率和准确度进行复杂任务的分解和解决。

AI 一些术语解读

代理(Agent)

代理通常指能够自主进行决策和行为的实体。在哲学中,代理可以是人、动物,甚至是具有自主性的概念或实体。

人工智能代理(AI Agent)

人工智能代理(AI Agent)是能够感知其环境、做出决策并执行相应操作的智能体。它们通过复杂的算法和模型来分析输入信息,并采取合适的行动。

机器人流程自动化(RPA)

机器人流程自动化(RPA)是一种能够模拟人类在计算机上执行手动操作的软件自动化技术。RPA系统可以自动完成大量重复性和基于规则的任务,例如在银行中处理纸质文件输入、票据验证、数据提取、跨系统数据迁移及自动化IT应用操作等。其主要优势包括降低劳动成本、提高生产力、减少出错率、操作可监控以及开发周期短。RPA在金融、办公自动化和IT流程自动化等领域中应用广泛。

Copilot

Copilot 类似于飞机的“副驾驶”。这一概念依托于底层的大型语言模型(LLM),用户只需简单地下达指令,Copilot 就能生成类似于人类撰写的文本及其他内容。

LangChain

LangChain是一个强大的框架,旨在帮助开发人员构建由语言模型(LLM)和聊天模型驱动的端到端应用程序。它提供了一套工具、组件和接口,简化了应用程序的开发过程。这些应用程序包括文档分析和摘要、聊天机器人以及代码分析等。

大型语言模型(LLM)

大型语言模型(LLM)是一种人工智能算法,利用深度学习技术和海量数据集来进行理解、总结、生成和预测新内容。这些模型在处理自然语言方面表现出色,广泛应用于各种语言处理任务中。

感知记忆(Sensory Memory)

感知记忆是信息处理的初始阶段,涉及对通过感官接收的信息进行短暂的存储。通常持续几百毫秒到几秒钟。例如,当你看到一张美丽的风景照片,感知记忆会暂时保存这张照片的颜色和形状。即使闭上眼睛,你也能在脑海中短暂地“看到”这张照片,这就是感知记忆的作用。

短期记忆(Short-term Memory)

短期记忆类似于一个临时工作台,它能够暂时存储和处理少量信息。举例来说,当你试图记住一个电话号码时,你可能会重复念叨这个号码,直到你拨打它,这就是短期记忆在发挥作用。所有的上下文学习(In-context Learning)都依赖于模型的短期记忆来进行。

长期记忆(Long-term Memory)

长期记忆像一个庞大的仓库,能够存储我们的经验、知识和技能,存储时间可以非常长,甚至延续一生。比如,你学会骑自行车的技能,即使多年不骑,你仍然记得怎么骑行,这就是长期记忆。智能体通常通过外部向量存储和快速检索来实现长期记忆。

记忆流(Memory Stream)

记忆流存储了智能体过去的观察、思考和行动序列。就像人脑依赖记忆系统回溯先前的经验来制定策略和做出决策一样,智能体也需要特定的记忆机制来确保能够熟练处理一系列连续任务。

模块化推理、知识与语言(MRKL)

MRKL代表一种构建AI的方法,用于自主代理的神经符号结构。它将推理、知识理解和语言能力作为不同的模块处理,像搭积木一样,每个积木代表AI的某一能力,组合在一起使AI能够进行复杂的思考和交流。

工具增强的语言模型(TALM)

工具增强的语言模型是指通过工具或技术来增强的语言处理模型,通常通过微调实现。例如,一个AI聊天机器人通过接入搜索引擎或其他数据库,能够提供更准确的回答和信息。

参考文章:

-

Software 2.0 https://karpathy.medium.com/software-2-0-a64152b37c35

-

A Survey on Large Language Model based Autonomous Agents https://arxiv.org/abs/2308.11432

-

细说复旦大学,斯坦福大学智能代理AI-Agent(二更) 细说复旦大学,斯坦福大学智能代理AI-Agent(二更)

-

AI Agent,启动!复旦NLP团队发86页长文综述,智能体社会近在眼前AI Agent,启动!复旦NLP团队发86页长文综述,智能体社会近在眼前-腾讯云开发者社区-腾讯云《综述:全新大语言模型驱动的Agent》——4.5万字详细解读复旦NLP和米哈游最新Agent Survey - 知乎

-

AI Agent引爆AGI时代,十篇研报透视AI智能体的现在与未来 https://mp.weixin.qq.com/s/oc08ID6FUb85_wfNeRrDtw