热门标签

热门文章

- 1国产720亿参数开源免费模型来了!对标Llama2 70B,一手实测在此

- 22021软件测试面试题汇总【备战金九银十】内容较长建议收藏_希音软件测试面试题

- 3android 的C++代码都加 namespace android_android c++ 自定义类属于哪个namespace

- 4如何探索和可视化用于图像中物体检测的 ML 数据

- 5PTA-藏尾诗_藏尾诗c语言pta

- 6VUE 之 Axios 的get和post前后端传参详解_axios.get

- 7OAuth2.0实战 认证、资源服务异常自定义这些骚操作_handling error: invalidgrantexception, bad credent

- 8【解决方案】adb无法连接雷电模拟器问题_雷电模拟器adb

- 9分布式与集群场景_分布式集群化的部署应用

- 10Docker 数据卷详解

当前位置: article > 正文

练习4-权重衰减(李沐函数简要解析)

作者:小小林熬夜学编程 | 2024-03-23 23:22:23

赞

踩

练习4-权重衰减(李沐函数简要解析)

环境:练习1的环境

代码详解

0.导入库

import torch

from torch import nn

from d2l import torch as d2l

- 1

- 2

- 3

1.初始化数据

这里初始化出train_iter test_iter 可以查一下之前的获取Fashion数据集后的数据格式与此对应

n_train, n_test, num_inputs, batch_size = 20, 100, 200, 5

true_w, true_b = torch.ones((num_inputs, 1)) * 0.01, 0.05

train_data = d2l.synthetic_data(true_w, true_b, n_train)

train_iter = d2l.load_array(train_data, batch_size)

test_data = d2l.synthetic_data(true_w, true_b, n_test)

test_iter = d2l.load_array(test_data, batch_size, is_train=False)

- 1

- 2

- 3

- 4

- 5

- 6

2.简洁实现

这补充个多层的写法

optimizer = torch.optim.SGD([

{“params”: net[0].weight, “weight_decay”: wd},

{“params”: net[0].bias},

{“params”: net[1].weight, “weight_decay”: wd},

{“params”: net[1].bias},

{“params”: net[2].weight, “weight_decay”: wd},

{“params”: net[2].bias}

], lr=lr)

def train_concise(wd): #定义了一层线性层模型,输入特征个数是num_inputs(怎么来的?) 输出个数是1 net=nn.Sequential(nn.Linear(num_inputs,1)) for param in net.parameters(): #初始化w,b 按照(均值为0,方差为1)来初始化,b会被随机初始化为较小的值 param.data.normal_() #定义损失函数 loss=nn.MSELoss(reduction='none') num_epochs,lr=100,0.03 #定义优化器(这里开始设置限制w^2对于损失函数的影响大小了 -> wd) #这段代码包含了神经网络第一层的所有参数,并且为这些参数应用了不同的设置或限制 #因为这个模型只有一层 trainer=torch.optim.SGD([ {"params":net[0].weight,'weight_decay': wd}, {"params":net[0].bias}], lr=lr) #x轴是epochs y轴是loss #x轴设置范围从第五轮到 最后一轮 y轴设置对数标度 对数标度:对原始数据进行对数变换后显示的 #legend=['train', 'test']: 这为图表设置了图例,标识两条曲线分别代表训练集("train")和测试集("test")的损失值 animator = d2l.Animator(xlabel='epochs', ylabel='loss', yscale='log', xlim=[5, num_epochs], legend=['train', 'test']) for epoch in range(num_epochs): for X, y in train_iter: trainer.zero_grad() l = loss(net(X), y) l.mean().backward() trainer.step() if (epoch + 1) % 5 == 0: #相当于在animator增加数据点 epoch,训练平均损失,测试平均损失 animator.add(epoch + 1, (d2l.evaluate_loss(net, train_iter, loss), d2l.evaluate_loss(net, test_iter, loss))) print('w的L2范数:', net[0].weight.norm().item()) #开始测试 train_concise(0)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

重点理解

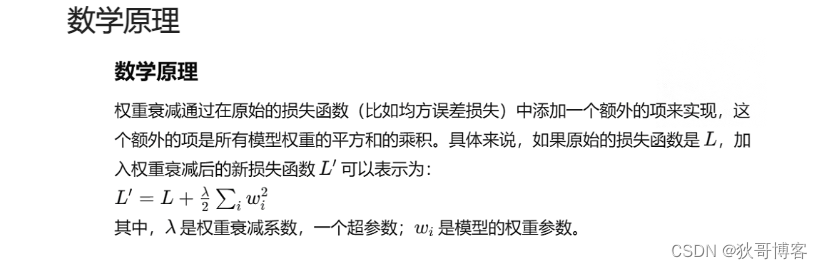

1.权重衰减是怎么做到的:

Loss=Loss+lamb/2 * (w^2)

当w越大Loss越大,Loss越大,越要减小,也同时减小w

2.原理:

多个函数下如何算最值

3.代码实现:

trainer=torch.optim.SGD([

{“params”:net[0].weight,‘weight_decay’: wd},

{“params”:net[0].bias}], lr=lr)

参考视频:

https://www.bilibili.com/video/BV1Z44y147xA/?spm_id_from=333.999.0.0&vd_source=302f06b1d8c88e3138547635c3f4de52

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/小小林熬夜学编程/article/detail/298360

推荐阅读

相关标签