- 1vue实现动画旋转_vue 转圈动画

- 2分布式应用下登录检验解决方案

- 3[HarmonyOS]——开关组件(Switch)_鸿蒙开关组件

- 4android 报错:invalid resource directory name bin/res/crunch

- 5基于yolov5-v7.0开发构建裸土实例分割检测识别模型_yolov7能不能做图像分割

- 6通过vue3自定义指令,实现滚动加载大量数据_vue3 pc 端滚动加载更多数据 组件

- 7(PTA)练习4-11 统计素数并求和_本题要求统计给定整数m和n区间内素数的个数并对它们求和。用函数解答 输入格式:

- 8让ChatGPT介绍一下ChatGPT

- 91000以内的素数_matlab求1000以内素数

- 10linux相对于windows的优势,服务器选择linux,相对windows有哪些优势?

Hadoop-Yarn

赞

踩

一、Yarn资源调度器

思考:

1)如何管理集群资源?

2)如何给任务合理分配资源?

Yarn 是一个资源调度平台,负责为运算程序提供服务器运算资源,相当于一个分布式的操作系统平台。

而 MapReduce 等运算程序则相当于运行于操作系统之上的应用程序。

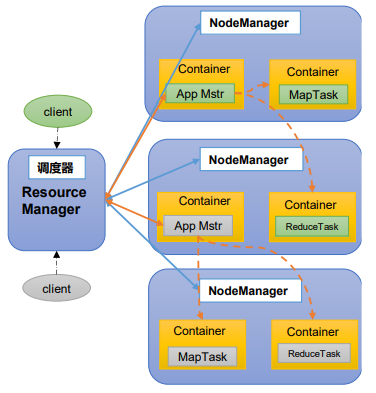

1.1 Yarn基础架构

YARN 主要由 ResourceManager、NodeManager、ApplicationMaster 和 Container 等组件构成。

- ResourceManager(RM)

- 处理客户端请求

- 监控NodeManager

- 资源的分配与调度

- 启动或监控ApplicationMaster

- NodeManager(NM)

- 管理单个节点上的资源

- 处理来自ResourceManager的命令

- 处理来自ApplicationMaster的命令

- ApplicationMaster

- 为应用程序申请资源并分配给内部的任务

- 任务的监控与容错

- Container

- Container是 YARN中的资源抽象,它封装了某个节点上的多维度资源,如内存、CPU、磁 盘、网络等。

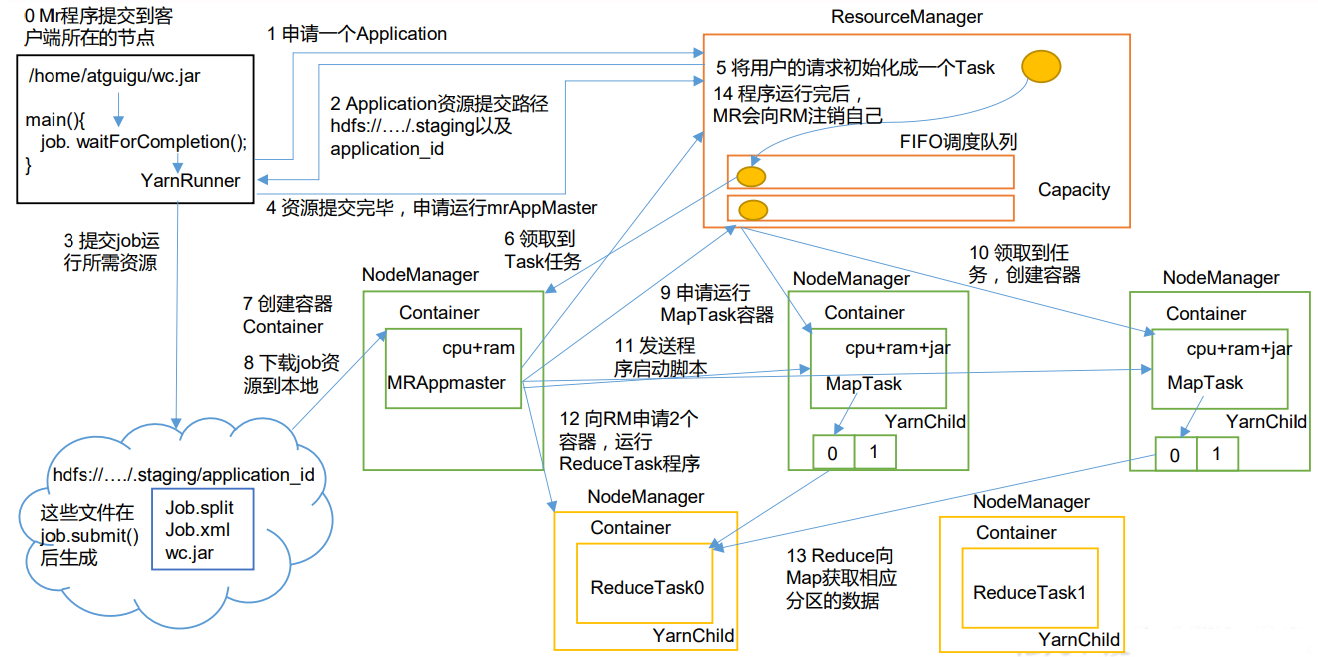

1.2 Yarn工作机制

- MR 程序提交到客户端所在的节点。

- YarnRunner 向 ResourceManager 申请一个 Application。

- RM 将该应用程序的资源路径返回给 YarnRunner。

- 该程序将运行所需资源提交到 HDFS 上。

- 程序资源提交完毕后,申请运行 mrAppMaster。

- RM 将用户的请求初始化成一个 Task。

- 其中一个 NodeManager 领取到 Task 任务。

- 该 NodeManager 创建容器 Container,并产生 MRAppmaster。

- Container 从 HDFS 上拷贝资源到本地。

- MRAppmaster 向 RM 申请运行 MapTask 资源。

- RM 将运行 MapTask 任务分配给另外两个 NodeManager,另两个 NodeManager 分别领取任务并创建容器。

- MR 向两个接收到任务的 NodeManager 发送程序启动脚本,这两个 NodeManager分别启动 MapTask,MapTask 对数据分区排序。

- MrAppMaster 等待所有 MapTask 运行完毕后,向 RM 申请容器,运行 ReduceTask。

- ReduceTask 向 MapTask 获取相应分区的数据。

- 程序运行完毕后,MR 会向 RM 申请注销自己。

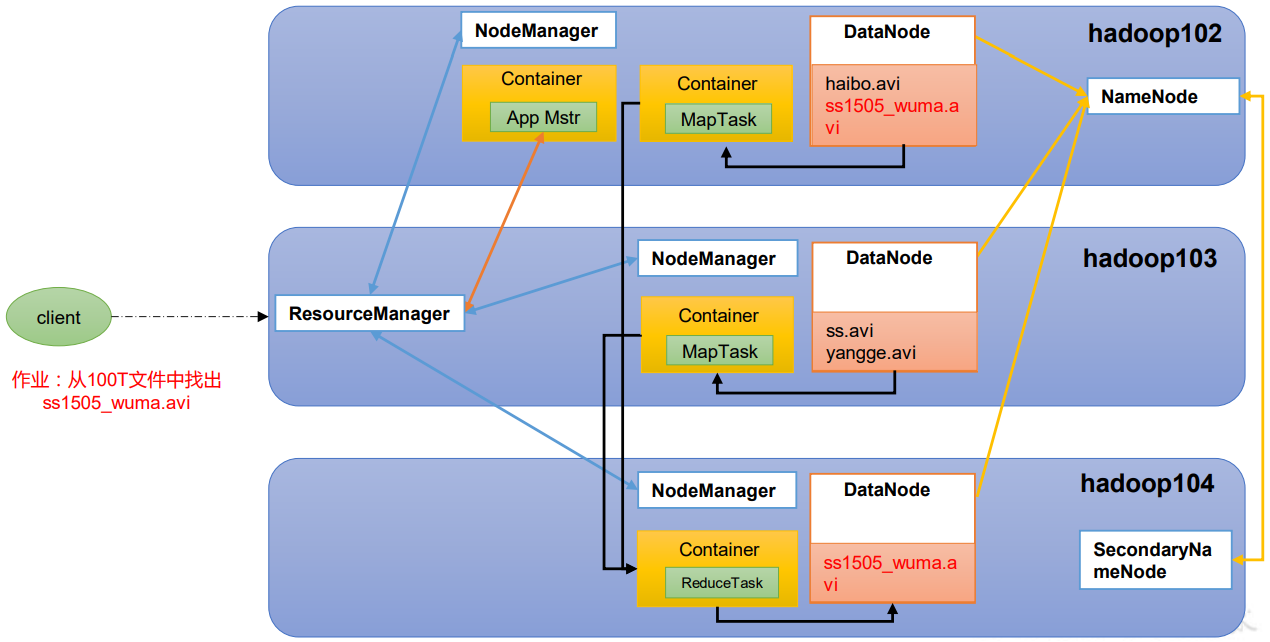

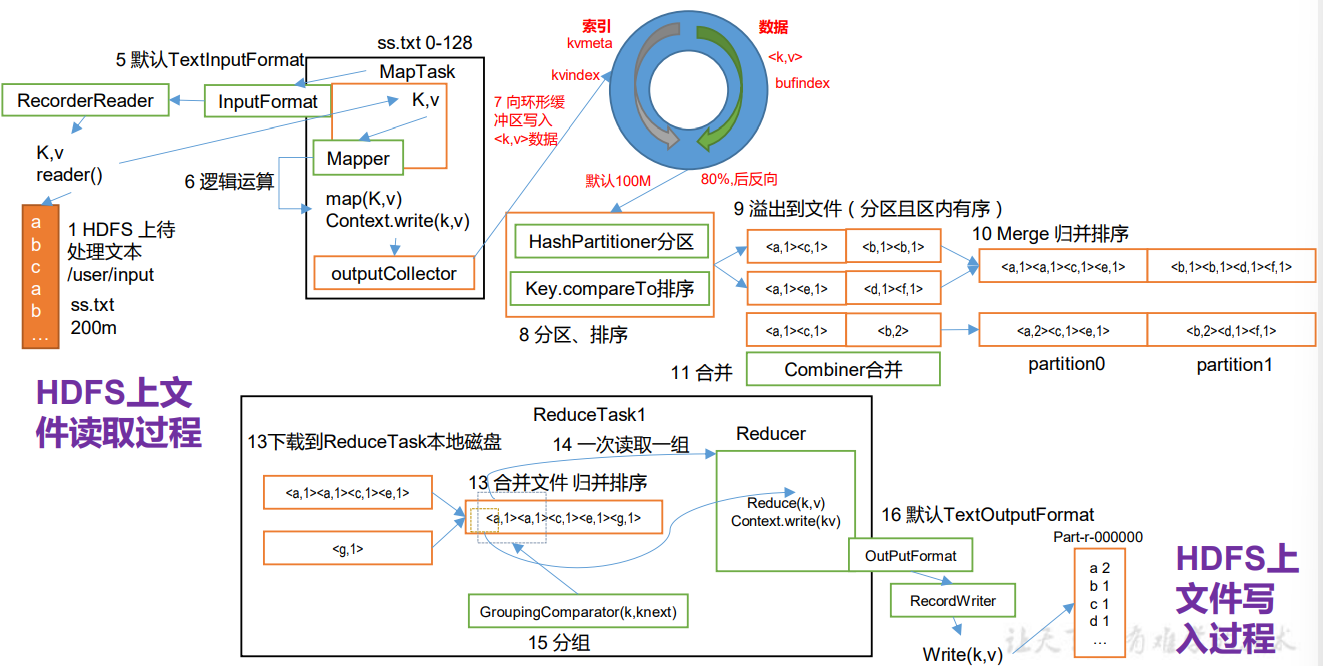

1.3 作业提交全过程

HDFS、YARN、MapReduce三者关系

作业提交过程之YARN:

作业提交过程之HDFS & MapReduce

作业提交全过程详解

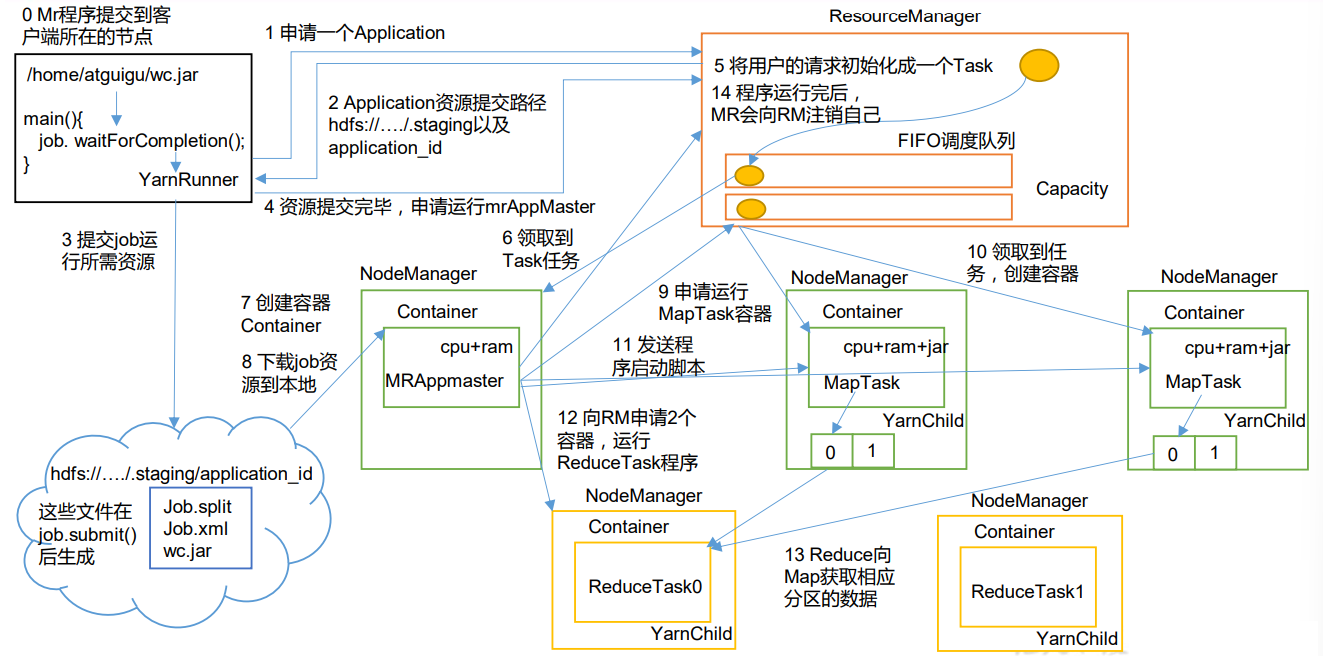

(1)作业提交

第 1 步:Client 调用 job.waitForCompletion 方法,向整个集群提交 MapReduce 作业。

第 2 步:Client 向 RM 申请一个作业 id。

第 3 步:RM 给 Client 返回该 job 资源的提交路径和作业 id。

第 4 步:Client 提交 jar 包、切片信息和配置文件到指定的资源提交路径。

第 5 步:Client 提交完资源后,向 RM 申请运行 MrAppMaster。

(2)作业初始化

第 6 步:当 RM 收到 Client 的请求后,将该 job 添加到容量调度器中。

第 7 步:某一个空闲的 NM 领取到该 Job。第 8 步:该 NM 创建 Container,并产生 MRAppmaster。第 9 步:下载 Client 提交的资源到本地。

(3)任务分配

第 10 步:MrAppMaster 向 RM 申请运行多个 MapTask 任务资源。

第 11 步:RM 将运行 MapTask 任务分配给另外两个 NodeManager,另两个 NodeManager分别领取任务并创建容器。

(4)任务运行

第 12 步:MR 向两个接收到任务的 NodeManager 发送程序启动脚本,这两个NodeManager 分别启动 MapTask,MapTask 对数据分区排序。

第13步:MrAppMaster等待所有MapTask运行完毕后,向RM申请容器,运行ReduceTask。

第 14 步:ReduceTask 向 MapTask 获取相应分区的数据。

第 15 步:程序运行完毕后,MR 会向 RM 申请注销自己。

(5)进度和状态更新

YARN 中的任务将其进度和状态(包括 counter)返回给应用管理器, 客户端每秒(通过mapreduce.client.progressmonitor.pollinterval 设置)向应用管理器请求进度更新, 展示给用户。

(6)作业完成

除了向应用管理器请求作业进度外, 客户端每 5 秒都会通过调用 waitForCompletion()来检查作业是否完成。

时间间隔可以通过 mapreduce.client.completion.pollinterval 来设置。

作业完成之后, 应用管理器和 Container 会清理工作状态。作业的信息会被作业历史服务器存储以备之后用户核查。

1.4 Yarn调度器和调度算法

目前,Hadoop 作业调度器主要有三种:FIFO、容量(Capacity Scheduler)和公平(FairScheduler)。

Apache Hadoop3.1.3 默认的资源调度器是 Capacity Scheduler。CDH 框架默认调度器是 Fair Scheduler。具体设置详见:yarn-default.xml 文件

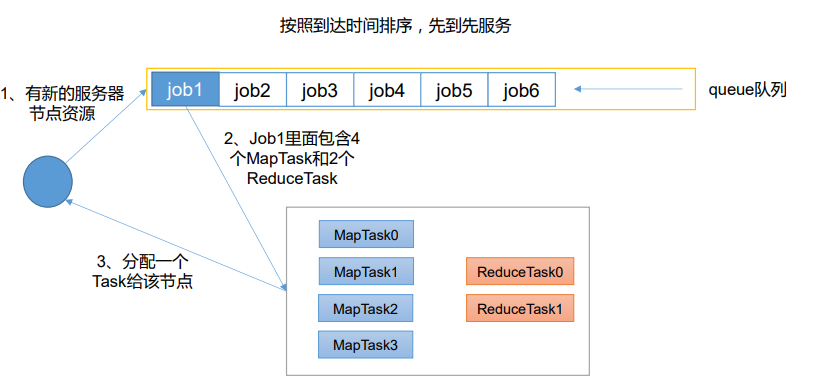

1.4.1 先进先出调度器

FIFO 调度器(First In First Out):单队列,根据提交作业的先后顺序,先来先服务。

优点:简单易懂;

缺点:不支持多队列,生产环境很少使用

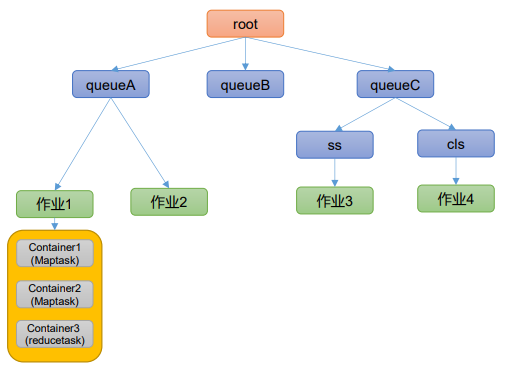

1.4.2 容量调度器

Capacity Scheduler 是 Yahoo 开发的多用户调度器。

- 多队列:每个队列可配置一定的资源量,每个队列采用FIFO调度策略。

- 容量保证:管理员可为每个队列设置资源最低保证和资源使用上限

- 灵活性:如果一个队列中的资源有剩余,可以暂时共享给那些需要资源的队列,而一旦该队列有新的应用程序提交,则其他队列借调的资源会归还给该队列。

- 多租户:支持多用户共享集群和多应用程序同时运行。为了防止同一个用户的作业独占队列中的资源,该调度器会对同一用户提交的作业所占资源量进行限定。

1)队列资源分配

从root开始,使用深度优先算法,优先选择资源占用率最低的队列分配资源。

2)作业资源分配

默认按照提交作业的优先级和提交时间顺序分配资源。

3)容器资源分配

按照容器的优先级分配资源;如果优先级相同,按照数据本地性原则:

(1)任务和数据在同一节点

(2)任务和数据在同一机架

(3)任务和数据不在同一节点也不在同一机架

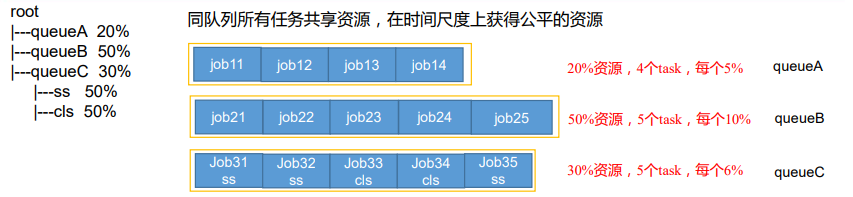

1.4.3 公平调度器

Fair Schedulere 是 Facebook 开发的多用户调度器。

1)与容量调度器相同点

(1)多队列:支持多队列多作业

(2)容量保证:管理员可为每个队列设置资源最低保证和资源使用上线

(3)灵活性:如果一个队列中的资源有剩余,可以暂时共享给那些需要资源的队列,而一旦该队列有新的应用程序提交,则其他队列借调的资源会归还给该队列。

(4)多租户:支持多用户共享集群和多应用程序同时运行;为了防止同一个用户的作业独占队列中的资源,该调度器会对同一用户提交的作业所占资源量进行限定。

2)与容量调度器不同点

(1)核心调度策略

容量调度器:优先选择资源利用率低的队列公平调度器:

优先选择对资源的缺额比例大的

(2)每个队列可以单独设置资源分配方式

容量调度器:FIFO、 DRF

公平调度器:FIFO、FAIR、DRF

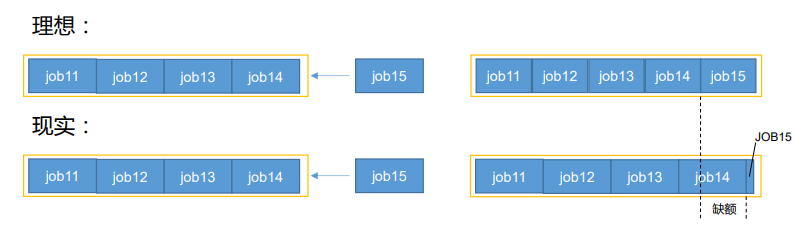

公平调度器设计目标是:在时间尺度上,所有作业获得公平的资源。某一时刻一个作业应获资源和实际获取资源的差距叫“缺额”•

调度器会优先为缺额大的作业分配资源。

公平调度器队列资源分配方式:

1)FIFO策略

公平调度器每个队列资源分配策略如果选择FIFO的话,此时公平调度器相当于上面讲过的容量调度器。

2)Fair策略

Fair 策略(默认)是一种基于最大最小公平算法实现的资源多路复用方式,默认情况下,每个队列内部采用该方式分配资源。这意味着,如果一个队列中有两个应用程序同时运行,则每个应用程序可得到1/2的资源;如果三个应用程序同时运行,则每个应用程序可得到1/3的资源。

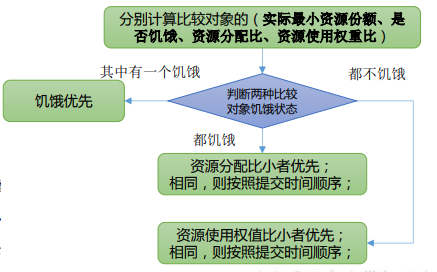

具体资源分配流程和容量调度器一致;(1)选择队列(2)选择作业(3)选择容器

以上三步,每一步都是按照公平策略分配资源

- 实际最小资源份额:mindshare = Min(资源需求量,配置的最小资源)

- 是否饥饿:isNeedy = 资源使用量 < mindshare(实际最小资源份额)

- 资源分配比:minShareRatio = 资源使用量 / Max(mindshare, 1)

- 资源使用权重比:useToWeightRatio = 资源使用量 / 权重

1.5 Yarn常用命令

Yarn 状态的查询,除了可以在 hadoop103:8088 页面查看外,还可以通过命令操作。常见的命令操作如下所示:

1.5.1 yarn application查看任务

(1)列出所有 Application

yarn application -list(2)根据 Application 状态过滤:yarn application -list -appStates (所有状态:ALL、NEW、NEW_SAVING、SUBMITTED、ACCEPTED、RUNNING、FINISHED、FAILED、KILLED)

yarn application -list -appStates(3)Kill 掉 Application:

yarn application -killapplication_1612577921195_00011.5.2 yarn logs查看日志

(1)查询 Application 日志:yarn logs -applicationId

yarn logs -applicationIdapplication_1612577921195_0001(2)查询 Container 日志:yarn logs -applicationId -containerId

yarn logs -applicationIdapplication_1612577921195_0001 -containerIdcontainer_1612577921195_0001_01_0000011.5.3 yarn application attempt 查看尝试运行的任务

(1)列出所有 Application 尝试的列表:yarn applicationattempt -list

yarn applicationattempt -listapplication_1612577921195_0001(2)打印 ApplicationAttemp 状态:yarn applicationattempt -status

yarn applicationattempt -statusappattempt_1612577921195_0001_0000011.5.4 yarn container 查看容器

(1)列出所有 Container:yarn container -list

yarn container -listappattempt_1612577921195_0001_000001(2)打印 Container 状态:yarn container -status

yarn container -statuscontainer_1612577921195_0001_01_0000011.5.5 yarn node 查看节点状态

列出所有节点:yarn node -list -all

yarn node -list -all1.5.6 yarn rmadmin更新配置

加载队列配置:yarn rmadmin -refreshQueues

yarn rmadmin -refreshQueues1.5.7 yarn queue查看队列

打印队列信息:yarn queue -status

yarn queue -status default1.6 Yarn生产环境核心参数

1)ResourceManager相关

- yarn.resourcemanager.scheduler.class 配置调度器,默认容量

- yarn.resourcemanager.scheduler.client.thread-count ResourceManager处理调度器请求的线程数量,默认50

2)NodeManager相关

- yarn.nodemanager.resource.detect-hardware-capabilities 是否让yarn自己检测硬件进行配置,默认false

- yarn.nodemanager.resource.count-logical-processors-as-cores 是否将虚拟核数当作CPU核数,默认false

- yarn.nodemanager.resource.pcores-vcores-multiplier 虚拟核数和物理核数乘数,例如:4核8线程,该参数就应设为2,默认1.0

- yarn.nodemanager.resource.memory-mb NodeManager使用内存,默认8G

- yarn.nodemanager.resource.system-reserved-memory-mb NodeManager为系统保留多少内存

- yarn.nodemanager.pmem-check-enabled 是否开启物理内存检查限制container,默认打开

- yarn.nodemanager.vmem-check-enabled 是否开启虚拟内存检查限制container,默认打开

- yarn.nodemanager.vmem-pmem-ratio 虚拟内存物理内存比例,默认2.1

3)Container相关

- yarn.scheduler.minimum-allocation-mb 容器最最小内存,默认1G

- yarn.scheduler.maximum-allocation-mb 容器最最大内存,默认8G

- yarn.scheduler.minimum-allocation-vcores 容器最小CPU核数,默认1个

- yarn.scheduler.maximum-allocation-vcores 容器最大CPU核数,默认4个