- 1首起针对国内金融企业的开源组件投毒攻击事件_组件投毒 数据库

- 2项目体检(Health Check)升级上线

- 3Mac系统安装及配置python_macbook如何安装python2

- 4python读程序写结果-31.Python:文件读写

- 5Git+TortoiseGit详细安装教程(HTTP方式)_tortoisegit http

- 6Python的日志输出_python日志输出到文件

- 7Springboot+Vue项目-基于Java+MySQL的图书馆管理系统(附源码+演示视频+LW)

- 8阅读小车循迹论文笔记:灰度传感器、仿生处理器、路径跟踪机制()_灰度传感器原理图

- 9SIDE:开启研发新的颠覆式的开发体验

- 10Flask-SQLAlchemy的使用(详解)_flask sqlalchemy options

Spark 完全分布式的安装和部署_spark完全分布式环境搭建步骤

赞

踩

目录

第1关: Standalone 分布式集群搭建

任务描述

掌握 Standalone 分布式集群搭建。

相关知识

我们已经掌握了 Spark 单机版安装,那么分布式集群怎么搭建呢? 接下来我们学习 Standalone 分布式集群搭建。

课程视频

如果你需要在本地配置 Spark 完全分布式环境,可以通过查看课程视频来学习。

Spark分布式安装模式

Spark 分布式环境安装目前有四种模式:

1.Standalone:Spark 自带的简单群资源管理器,安装较为简单,不需要依赖 Hadoop;

2.Hadoop YARN:使用 YARN 作为集群资源管理,安装需要依赖 Hadoop;

3.Apache Mesos:不常用;

4.Kubernetes:不常用。

本地学习测试我们常用 Standalone 模式,生产环境常使用 YARN 模式。

示例集群信息

以下表格为本教程所用示例集群节点信息:

| 节点名称 | 节点角色 |

|---|---|

| master | worker,master |

| slave1 | worker |

| slave2 | worker |

我们准备了三台虚拟服务器,连接方式如下:

| 服务器 | SSH | 密码 | ip |

|---|---|---|---|

| master | ssh 172.18.0.2 | 123456 | 172.18.0.2 |

| slave1 | ssh 172.18.0.3 | 123456 | 172.18.0.3 |

| slave2 | ssh 172.18.0.4 | 123456 | 172.18.0.4 |

第一步我们需要在 evassh 服务器初始化虚拟服务器:

cd /homewrapdockerulimit -f 1024000docker load -i hbase-ssh2_v1.0.tardocker-compose up -d

注意:请不要在各个虚拟服务器之间进行 ssh 登录,这种操作会导致无法保存配置数据。正确方法是:在虚拟服务器里执行 exit 后回到 evassh 服务器,再按上述方法登录各虚拟服务器。

配置免密登录

Hadoop 集群在启动脚本时,会去启动各个节点,此过程是通过 SSH 去连接的,为了避免启动过程输入密码,需要配置免密登录。

1、分别在 master、slave1、slave 生成密钥,命令如下:

ssh-keygen -t rsa

2、 在 master 复制 master、slave1、slave2 的公钥。

cat ~/.ssh/id_rsa.pub>> ~/.ssh/authorized_keysssh root@slave1 cat ~/.ssh/id_rsa.pub>> ~/.ssh/authorized_keysssh root@slave2 cat ~/.ssh/id_rsa.pub>> ~/.ssh/authorized_keys

3、 分别在 slave1、slave2 复制 master 的 authorized_keys 文件。

ssh root@master cat ~/.ssh/authorized_keys>> ~/.ssh/authorized_keys

到此,免密已经成功,可以在各个虚拟服务器之间进行 ssh 登录,而不需要输入密码了。

准备Spark安装包

把 evassh 服务器的 /usr/local 目录下的 spark 安装包通过 SCP 命令上传到 master 虚拟服务器的 /usr/local 目录下。

scp -r /usr/local/spark-2.3.4-bin-hadoop2.7 root@172.18.0.2:/usr/local

密码为:123456。

配置环境变量

我们将 Spark 的安装目录配置到 /etc/profile 中(在文件末尾添加)。

不要忘了 source /etc/profile。

该步骤所有虚拟服务器节点均可执行。

修改 spark-env.sh 配置文件

首先生成一份 spark-env.sh 文件(master节点):

切换目录到:/usr/local/spark-2.3.4-bin-hadoop2.7/conf 执行命令:mv spark-env.sh.template spark-env.sh

修改 spark-env.sh 文件:

执行命令:vi spark-env.sh,添加以下内容:

#指定JAVA安装路径/usr/lib/jvm/jdk1.8.0_111export JAVA_HOME=java安装路径#指定SCALA安装位置,非必须配置,可不指定export SCALA_HOME=scala安装路径#指定spark master webui 端口,默认是 8080,跟 tomcat 冲突SPARK_MASTER_WEBUI_PORT=8888#指定Master节点IP或映射地址export SPARK_MASTER_IP=master节点IP或映射地址

修改 slaves 文件

首先生成一份 slaves 文件(master节点)。

切换到 Spark 的 conf 目录下, 执行命令: mv slaves.template slaves

修改 slaves 文件, 执行命令: vi slaves 在该文件中加入作为 worker 节点 ip 或映射主机名。

masterslave1slave2

分发安装包

把 master 节点的 spark 安装包分发到 slave1 节点和 slave2 节点(通过 scp 命令)。

scp -r spark-2.3.4-bin-hadoop2.7/ root@slave1:/usr/local

启动spark

切换到 master 节点安装目录的 /sbin 目录下 执行命令启动 Spark 集群:./start-all.sh

验证安装

输入 jps 命令查看。 master 节点有以下进程:

masterworker

slave1 节点有以下进程:

worker

slave2 节点有以下进程:

worker

编程要求

请按照步骤小心安装,安装完成后点击测评即可。

测试说明

点击测评后,后台会通过curl http://172.18.0.2:8888/ 命令获取页面,并取其中部分内容来判定你是否安装成功。

预期输出:

<li><strong>Alive Workers:</strong> 3</li>

代码

docker-compose up -d 这个会报错,一直输,可能大概十几次,直到三个服务器都启动:

出现大概这样的字样:master up to data

slave1 up to data

slave2 up to data

表示启动成功

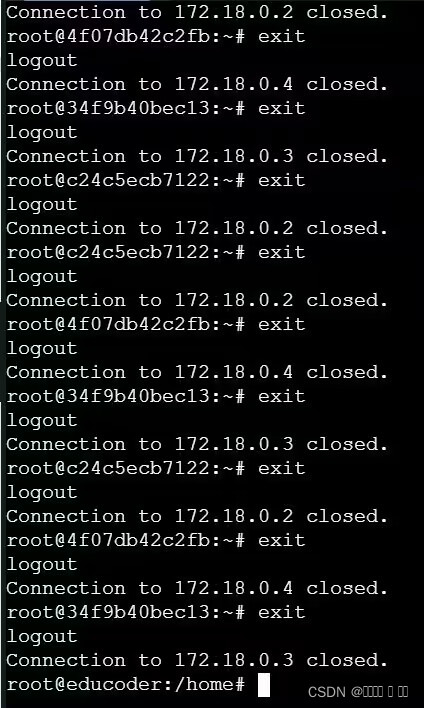

退出到educoder输入exit,可能要很多次,例如:

- cd /home

- wrapdocker

- ulimit -f 1024000

-

- docker load -i hbase-ssh2_v1.0.tar #要等待很长很长时间加载资源

-

- docker-compose up -d #报错多进行几次,直到出现三个服务器

-

- # 分别连接三个服务器

- ssh root@172.18.0.2、172.18.0.3、172.18.0.4 #分开写不要直接复制呦

- ssh-keygen -t rsa #按三次空格建立免密

-

- ssh root@172.18.0.2 # password=123456三个密码都是这个

- cat ~/.ssh/id_rsa.pub>> ~/.ssh/authorized_keys

- ssh root@172.18.0.3 cat ~/.ssh/id_rsa.pub>> ~/.ssh/authorized_keys

- ssh root@172.18.0.4 cat ~/.ssh/id_rsa.pub>> ~/.ssh/authorized_keys

- ssh root@172.18.0.3

- ssh root@172.18.0.2 cat ~/.ssh/authorized_keys>> ~/.ssh/authorized_keys

- ssh root@172.18.0.4

- ssh root@172.18.0.2 cat ~/.ssh/authorized_keys>> ~/.ssh/authorized_keys

- # educoder 多输几次exit,直到退出三个服务器返回到educoder

- scp -r /usr/local/spark-2.3.4-bin-hadoop2.7 root@172.18.0.2:/usr/local

-

-

- #下面都在172.18.0.2服务器进行

-

- ssh root@172.18.0.2

- vim /etc/profile

-

- export SPARK_HOME=/usr/local/spark-2.3.4-bin-hadoop2.7

- export PATH=$PATH:$SPARK_HOME/bin

-

-

- source /etc/profile

-

- cd /usr/local/spark-2.3.4-bin-hadoop2.7/conf

- cp spark-env.sh.template spark-env.sh

- vi spark-env.sh

-

- export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_111

- export SPARK_MASTER_WEBUI_PORT=8888

- export SPARK_MASTER_IP=172.18.0.2

-

-

- cp slaves.template slaves

- vi slaves

-

- # 删除localhost

- 172.18.0.2

- 172.18.0.3

- 172.18.0.4

-

- scp -r /usr/local/spark-2.3.4-bin-hadoop2.7/ root@172.18.0.3:/usr/local

- scp -r /usr/local/spark-2.3.4-bin-hadoop2.7/ root@172.18.0.4:/usr/local

-

- $SPARK_HOME/sbin/start-all.sh

-

- jps