- 101-PostgreSQL安装与远程连接_postgresql 远程连接

- 2群联助手是一个非常实用的u盘工具箱,供大家学习研究参考!_群联量产工具

- 36D姿态估计算法汇总(上)_deep-6dpose

- 4Linux系统本地搭建Tipask开源问答系统站点结合内网穿透发布至公网

- 5matplotlib绘图使用plt.xlabel(“xx“)报错‘str’object is not callable的解决方法_python 画图设置横纵坐标轴名字 'str' object is not callable

- 6黄仁勋从煤气灶下取出最新GPU:7nm全新安培架构,售价20万美元,训练性能顶6张V100...

- 7Linux(Ubuntu)vim极速配置 git clone 无法访问 出坑指南_sudo git clone

- 8常见的用户密码在后台数据库中加密存储方式_实际中常用的数据库加密方式

- 9linux里systemctl找不到postgres对应的服务就这么解决_systemctl命令找不到

- 10自动驾驶攻破的难点在哪,何时能到 Level 5?_自动驾驶算法的裁剪难吗

M2SNet Multi-scale in Multi-scale Subtraction Network for Medical Image Segmentation_busi数据集

赞

踩

M2SNet: Multi-scale in Multi-scale Subtraction Network for Medical Image Segmentation

摘要

- 医学图像分割领域的

U-Net是基于U型结构,并使用相加或拼接的方式,逐步融合解码器中不同级别特征,直到现在依然有许多工作都是这种结构进行改进创新。 - 然而,这两种操作容易生成大量冗余信息,这将削弱不同级别特征之间的互补性,导致很难准确地定位病变目标以及导致病变目标的边缘模糊。

- 针对上述的难点,本文介绍了一种针对医学图像的多尺度减法网络(

multi-scale subtraction network, M2SNet),旨在解决现有方法在融合不同级别特征时产生冗余信息的问题,从而导致病灶定位不准确和边缘模糊的情况。 - 本文设计了基本的减法单元 (

subtraction unit, SU) 来产生编码器中相邻级别之间的差异特征,并将单一尺度的SU扩展到内层多尺度SU,提供像素级和结构级别的差异信息给解码器。此外,还使用具有不同感受野的金字塔多尺度SU在不同级别上进行特征聚合,从而获得丰富的多尺度差异信息。最后,构建了一个无需训练的网络LossNet,从底层到顶层全面监督任务感知特征,从而驱动多尺度减法网络同时捕捉详细和结构性提示。 - 该方法在不同的评估指标下,在包括彩色结肠镜成像、超声成像、计算机断层扫描 (

CT) 和光学相干断层扫描 (OCT) 在内的四种不同医学图像分割任务的十一个数据集上获得了惊艳的性能表现

1 引言

医学图像分割的三大挑战:

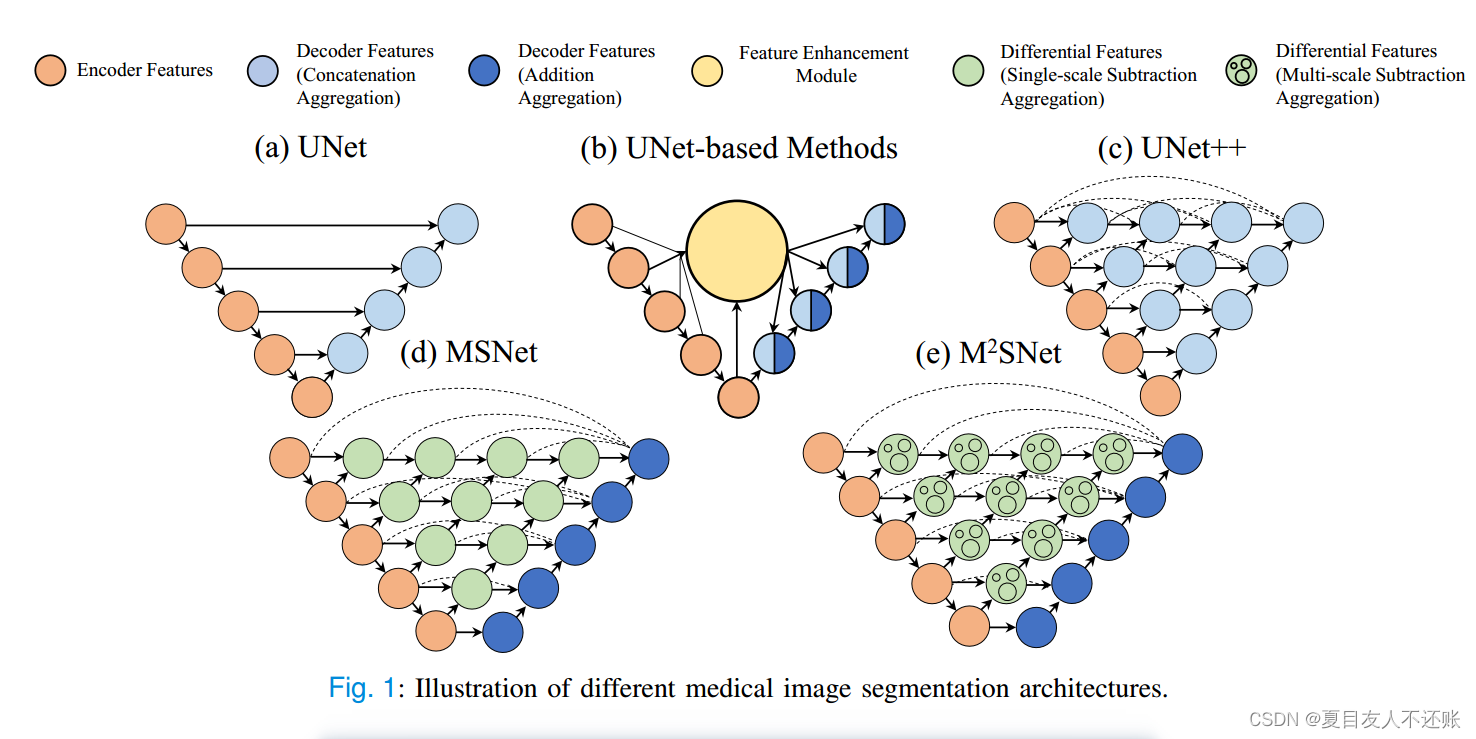

U形结构由于其利用多层次信息重建高分辨率特征图的能力而受到广泛关注。在UNet中,将上采样的特征映射与编码器跳过的特征映射连接起来,并在上采样步骤之间添加卷积和非线性,如图1 (a)所示。随后基于UNet的方法设计了各种特征增强模块,包括注意力机制、门机制、Transformer技术、如图1 (b)所示。UNet++使用嵌套和密集的跳跃连接来减少编码器和解码器特征映射之间的语义差距,如图1 ©所示。高层次的语义信息有助于定位对象,而低层次的语义信息更详细,可以捕捉对象的微妙边界。

(1) UNet、UNet++、attention U-Net直接使用元素加法或拼接来融合来自编码器的不同层级特征,没有更多地关注不同层级之间的差异性信息,导致生成冗余信息并削弱了层级特征的特点,从而无法平衡精确的定位和微妙的边界细化。

(2) 感受野受限: 单一尺度的卷积核难以捕捉大小不同的物体的上下文信息。虽然 ASPP、DenseASPP 等多尺度模块能提取多尺度信息,但同时也会产生许多额外的参数与计算量。

(3) 手工设计损失函数的局限性: L1 loss、CE loss、SSIM loss。虽然这些基本的损失函数及其变体具有不同的优化特性,但是设计复杂的数学形式对于许多研究来说真的很耗时。

为了解决上述问题,本文提出了一种新的多尺度减法网络(M2SNet)用于医学图像分割:

- 采用了减法聚合的方法代替传统的加法或串联特征融合,从而提高了特征的有效性和鲁棒性。减法聚合通过对相邻层特征进行差分运算,突出有用的差异信息并消除冗余部分的干扰。

- 采用了多尺度信息提取的策略,通过金字塔式地连接多个减法单元以获取跨层级别的信息,实现了全方位的多尺度信息互补。此外,通过改进单尺度减法单元,使用具有不同卷积核大小的一组滤波器来实现自然的多尺度减法聚合。

- 提出了一种名为

LossNet的智能损失函数,能够从细节到结构地优化特征图的分割结果,提高了分割精度。同时,LossNet的设计简单且通用,无需复杂的手动数学形式,降低了研究人员的训练难度。

本文贡献:

• 我们提出了一种新的分割框架,用高效的减法聚合取代传统的加法或拼接特征融合。

• 我们提出了一种简单而通用的多尺度中多尺度减法网络(M2SNet),用于各种医学图像分割。通过多尺度模块中的多尺度,可以有效地获得不同层次之间从低阶到高阶的多尺度互补信息,从而全面增强对器官或病变区域的感知。

• 我们设计了一个高效的层内多尺度减法单元(MSU)。由于MSU的参数少,计算量小,因此可以在我们的M2SNet中配置所有的跨层聚合。

• 我们构建了一个通用的无训练损失网络,在特征层上实现了从细节到结构的监督,为基于预测本身的损失设计提供了重要的补充。

• 我们验证了M2SNet在四种具有挑战性的医学分割任务上的有效性:息肉分割、乳腺癌分割、COVID-19肺部感染以及分别对应于彩色结肠镜成像、超声成像、计算机断层扫描(CT)和光学相干断层扫描(OCT)图像输入方式的OCT层分割。此外,M2SNet在MICCAI2022 GOALS国际眼科挑战赛中获得第二名。

2 相关工作

2.1 医学图像分割网络

根据不同器官或病变的特征,我们将现有的医学图像分割方法分为两类:医学通用分割和医学专用分割。

医学通用分割方法:

随着U-Net在医学图像分割领域取得稳定的性能,带编解码器的U型结构已经成为基本的分割基准。U- Net++集成了长连接和短连接,减小了编码器和解码器子网络特征映射之间的语义差距。对于注意U-Net,在编码器和解码器块之间的每个过渡层中嵌入一个注意门,它可以自动学习关注不同形状和大小的目标结构。最近,Transformer架构在许多自然语言处理任务中取得了成功。一些研究探讨了其在医学视觉任务中的有效性。UTNet是一个简单但功能强大的混合Transformer架构,它在编码器和解码器中都应用了自注意力模块,以最小的开销捕获不同规模的远程依赖。另一个代表性的基于Transformer的模型是TransUNet,它通过将图像特征作为序列来编码强全局上下文,并通过U形混合架构设计利用低级CNN特征。

医学专用分割方法:

在息肉分割任务中,SFA和PraNet侧重于恢复息肉与其周围粘膜之间的清晰边界。前者提出了一个共享编码器和两个相互约束的解码器下的选择性特征聚合结构和边界敏感损失函数。后者利用反向注意力模块来建立区域和边界线索之间的关系。此外,Ji等人还利用时空信息构建了视频息肉分割模型。在COVID-19肺部感染任务中,Paluru等人提出了一种基于Transformer深度嵌入的轻量级CNN来分割COVID-19胸部CT图像中的异常。BCS-Net构建了隐式反向注意力和显式边缘注意力来建模边界。BCS-Net具有三个渐进式边界上下文语义重建块,可以帮助解码器捕获肺部感染的碎片区域。在乳腺分割任务中,Byra等通过注意力机制开发了一个选择性核来调节U-Net的接受野,从而进一步提高乳腺肿瘤的分割精度。Chen等人提出了一个嵌套的U-net,通过利用不同的深度和共享权重来实现对乳腺肿瘤的鲁棒表示。

我们可以看到,医学通用方法通常面向通用挑战(即丰富的特征表示、多尺度信息提取和跨层次特征聚合)。而医学特异性方法则根据当前器官或病变的特点提出针对性的解决方案,如设计一系列的注意力机制、边缘增强模块、不确定性估计等。然而,无论是通用-通用模型还是特定模型,都依赖于大量的加法或拼接操作来实现特征融合,这削弱了互补特征之间的特异性部分。我们提出的多尺度减法模块自然侧重于提取差分信息,从而为解码器提供高效的目标特征。

2.2 多尺度特征提取

尺度特征在捕捉对象的语境信息中起着重要作用。尺度空间理论作为一种有效的理论框架已经得到了广泛的验证,受其启发,越来越多的多尺度方法被提出。与单尺度特征相比,多尺度特征有利于解决自然发生的尺度变化。这一特性可以帮助医学分割模型感知不同尺度的病变。根据形式,目前基于多尺度的方法大致可分为两类,即层间多尺度结构和层内多尺度结构。前者是基于特征编码器提取的不同尺度的特征,逐步聚合到解码器中,如U形[1]、[2]、[4]、[9]-[11]、[37]、[38]架构。后者通常是ASPP、DenseASPP、FoldASPP、PAFEM等多尺度可插拔模块,构建不同扩张速率的并行多分支卷积层,获得丰富的感受场组合。与之不同的是,我们通过同时引入层间和层内多尺度,提出了具有极端多尺度信息的多尺度减法模块中的多尺度。层内多尺度减法单元侧重于挖掘从像素-像素到区域-区域的特征对的自差分特性。与单尺度操作相比,整个过程非常高效,没有额外的参数。

2.3 损失方法

大多数图像分割中的损失函数都是基于交叉熵或符合度量的。传统的交叉熵损失对类别信息一视同仁。Long等人提出了每个类的加权交叉熵损失(WCE)来抵消数据中的类不平衡。Lin等人通过引入难易样本的权重来提出Focal loss。在V-Net中提出了Dice系数作为符合度量的损失函数,可以有效地抑制类别不平衡带来的问题。Tversky loss是一个控制Dice系数的正则化版本准确率和召回率对损失函数的贡献。Wong等人提出了指数对数损失(exponential logarithloss, EL loss),通过Dice损失和WCE损失的加权求和来提高小结构物体的分割精度。Taghanaki等人发现单独使用基于重叠的损失函数存在风险,并提出将Dice损失作为正则化项与WCE损失结合起来处理输入输出不平衡问题的comoloss。虽然这些不同的损失函数在不同的层次上有不同的作用,但手工设计这些复杂的函数确实是费时费力的。为此,我们提出了一种自动综合分割损失结构,称为LossNet。

3 方法

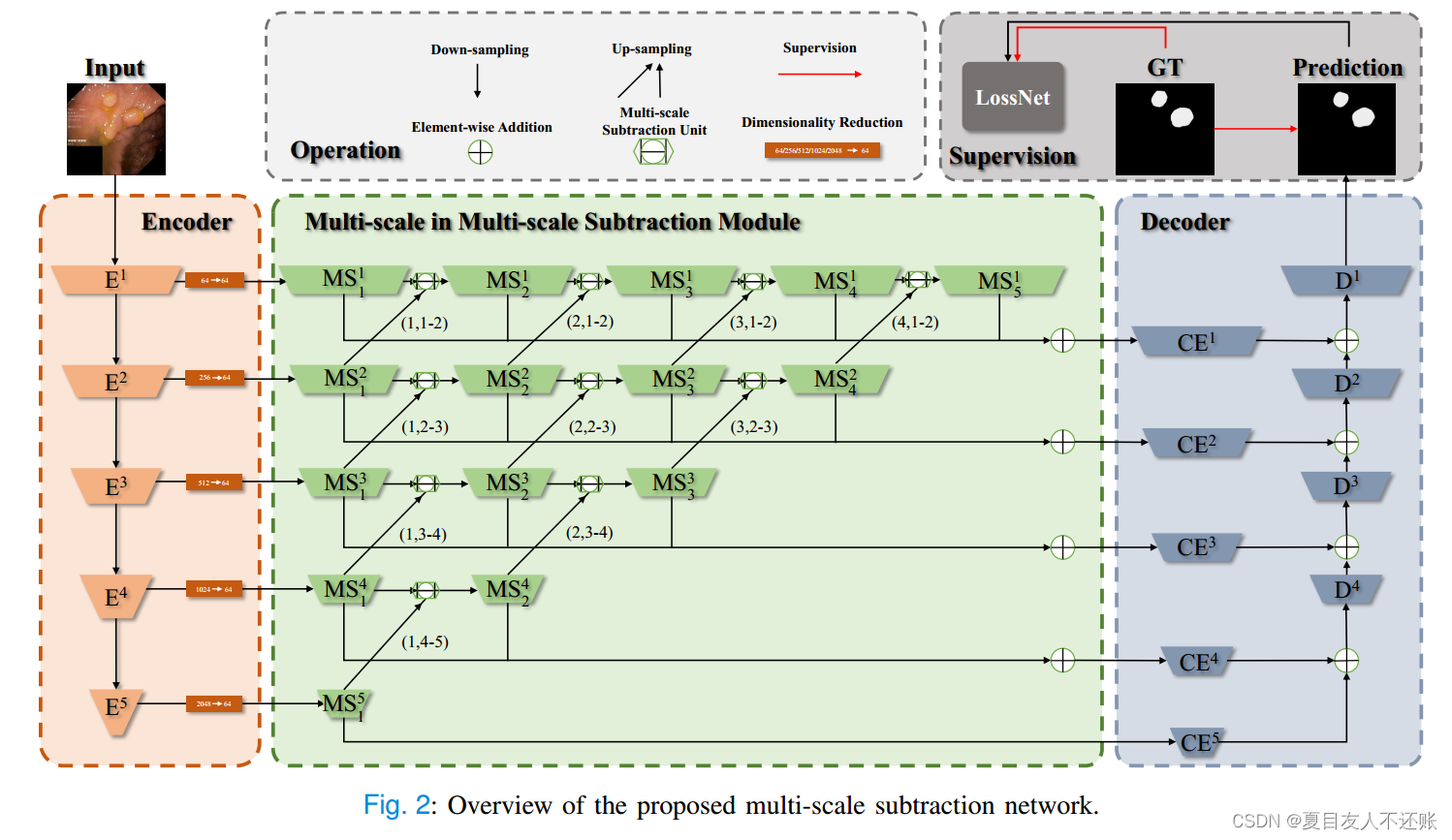

如图2所示, M2SNet包括五个编码器块,一个多尺度减法模块 (MMSM) 和四个解码器块。该网络使用 Res2Net-50 作为骨干网络,提取五个级别的特征。首先,对于每个编码器块的特征图,分别采用 3×3 的卷积将通道减少到 64,从而减少后续操作的参数数量。接着,将这些不同层次的特征送入 MMSM 中,输出五个互补增强特征 CEi, i=1,2,3,4,5。最后,每个 CEi逐步参与解码器并生成最终预测。在训练阶段,预测结果和真实值都输入到 LossNet 中进行监督。

3.1 多尺度减法模块

M2SNet的关键在于多尺度子网和多尺度差分模块,它们能够更好地捕捉初始特征图之间的差异信息,从而提高分割精度。

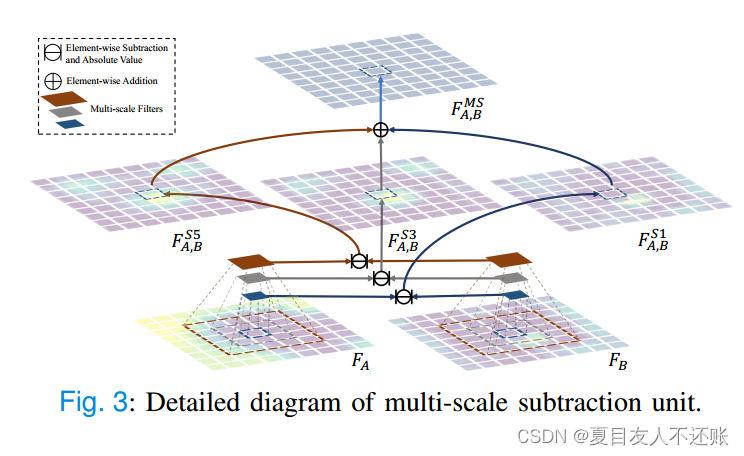

在多尺度差分模块中,本文采用了多尺度卷积滤波器,包括大小为 1×1、3×3 和 5×5 的固定全一权重滤波器。这些滤波器用于计算像素对和区域对的详细结构差异值,能够更好地捕捉结肠息肉的区域特征。与单一尺度的差分模块相比,多尺度差分模块能够提取更多的信息,从而提高模型的准确性。

另外,多尺度子网能够提取高阶互补信息,进一步提高模型的精度。多尺度减法模块中的多尺度细节如图2所示。具体来说,首先水平和垂直地连接了多个多尺度差分模块,用于计算具有不同顺序和感受野的一系列差分特征。然后,对每个尺度的特征进行汇聚,生成互补增强特征,最终用于解码和结肠息肉区域的分割。

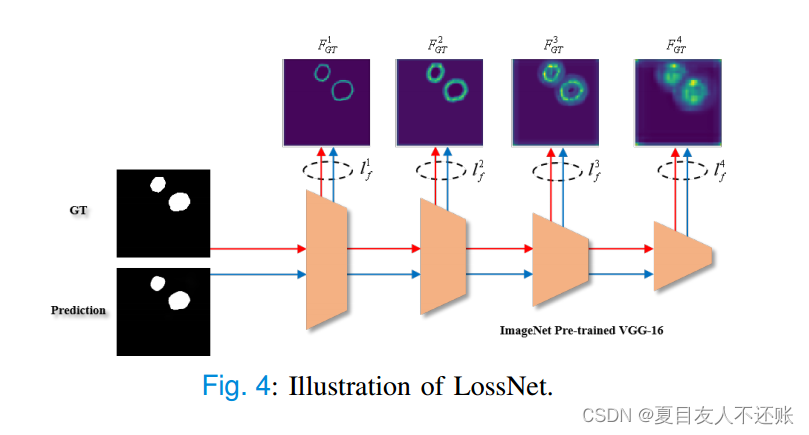

3.2 LossNet

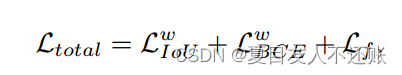

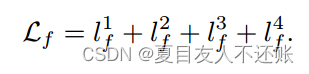

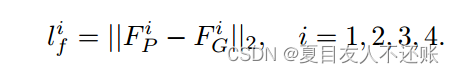

本文设计了一个总训练损失函数,包括加权的 IoU loss 和 BCE loss,以及一个称为 LossNet 的网络来进一步优化分割细节和结构。

其中,IoU loss 和 BCE loss 在分割任务中被广泛采用并已被验证有效。LossNet 使用一个 ImageNet 预训练分类网络(如VGG-16)提取预测和实际值的多尺度特征,并计算它们之间的特征差作为损失函数Lf:

损失 Lf通过像素级别的欧几里得距离 L2 loss 进行监督。该模型可以在特征级别生成全面的监督,低级特征图包含丰富的边界信息,而高级特征图则描绘位置信息。

4 实验

4.1 数据集

为了验证所提出的框架在四种不同类型的医学分割任务上的有效性,这些任务使用了来自不同图像模式的数据,包括彩色结肠镜成像、超声成像、计算机断层扫描(CT)和光学相干断层扫描(OCT)。

息肉分割:

根据GLOBOCAN 2020的数据,结直肠癌是全球第三大常见癌症,也是第二大常见死亡原因。它通常开始于小的,非癌性的(良性)细胞团块,称为息肉,形成于结肠内部。我们在五个基准数据集上对所提出的模型进行了评估:CVC-ColonDB、ETIS、Kvasir、CVC-T和CVC-ClinicDB。我们采用与最新的图像息肉分割方法相同的训练集,即使用来自Kvasir的900个样本和来自CVCClinicDB的550个样本进行训练。剩下的图像和其他三个数据集用于测试。此外,还有一些基于视频的息肉数据集,包括CVC-300和CVC-612。我们遵循最新的视频息肉分割方法,将CVC-300(12个片段)和CVC-612(29个片段)的视频分割为60%用于训练,20%用于验证,20%用于测试。

COVID-19肺部感染:

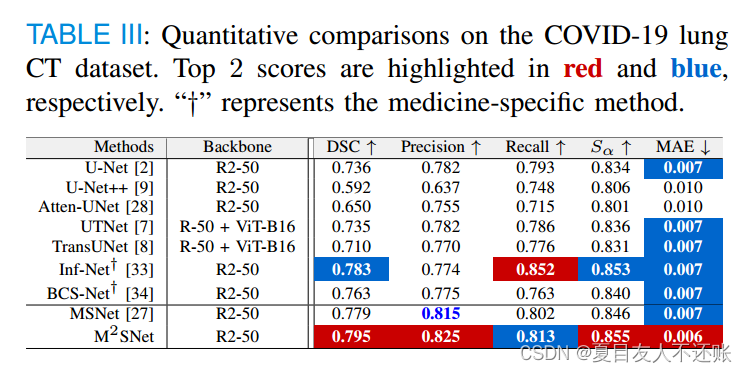

2019冠状病毒病(COVID-19)于2020年初在全球蔓延,使世界面临生存健康危机。目前,用于感染分割的公开的COVID-19肺部CT数据集很少。为了获得相对足够的训练样本,我们对公共数据集[52]进行切片,并与公共数据集[53]进行均匀采样,得到1277张高质量的CT图像。然后,我们进一步将它们分为894张训练图像和383张测试图像。

乳腺超声分割:

乳腺癌是女性最可怕的癌症之一。从乳腺超声图像中分割病灶区域对肿瘤诊断至关重要。BUSI数据集包含600名女性患者的780张图像。其中,正常133例,良性肿瘤437例,恶性肿瘤210例。我们按照流行的乳腺超声分割方法[35]、[36]对BUSI进行四重交叉验证。

OCT层分割:

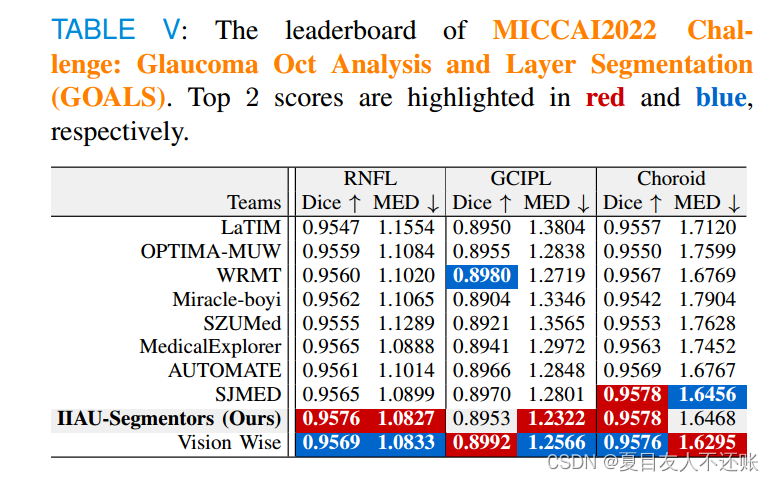

无论是在研究中心还是临床常规中,OCT图像都是基于异常量化和视网膜层厚度计算来更准确地诊断和监测视网膜疾病。目前,很多学者对黄斑OCT扫描中眼底结构的分割进行了研究,但对乳头旁圆形扫描的关注较少。为了充分展示M2SNet在不同医疗任务中的泛化,我们带着我们的M2SNet参加了MICCAI 2022挑战赛:青光眼Oct分析和分层分割(GOALS)。要求参与者将视网膜神经纤维层(RNFL)、神经节细胞-内丛状层(GCIPL)、脉络膜层(choroid layer)三层进行分割,对青光眼的诊断有积极意义,如图5所示。GOALS2022数据集包含300个乳头状OCT。分成三组,每组100张OCT图像,分别用于训练过程、初赛过程和决赛过程。GOALS2022挑战赛吸引了来自世界各地的100支队伍参与,我们最终获得了第二名(2/100)。

4.2 评价指标

在不同的医学分割分支中使用了许多流行的指标。mean Dice (mice)、mean IoU (mIoU)、加权F-measure (F w β)、S-measure (Sα)、E-measure (Emax φ)和平均绝对误差(MAE)被广泛应用于息肉分割。采用5个指标进行定量评价,包括Precision、Recall、Dice Similarity Coefficient (DSC)、Smeasure和MAE。Jaccard、Precision、Recall、Dice和Specificity等方法在乳腺肿瘤分割中较为常用。对于OCT层分割,GOALS2022分别采用Dice系数和平均欧几里德距离(MED)对分割体和边缘进行评价。MAE和MED值越低越好,其他值越高越好。

4.3 实现细节

我们的模型是基于PyTorch框架实现的,并在单个具有小批处理16大小的2080Ti GPU上进行训练. 我们将输入调整为352 × 352,并采用一般的多尺度训练策略。使用随机水平翻转和随机旋转数据增强来避免过拟合。对于优化器,我们采用随机梯度下降法(SGD)。动量衰减和权重衰减分别设置为0.9和0.0005。最大学习率设置为骨干0.005,其他部位0.05。使用预热和线性衰减策略来调整学习率。对于任何医学图像子任务,本文所涉及的所有多尺度减法模型都使用上述训练策略。这些模型之间的区别只是由于收敛速度不同而导致的训练epoch的个数不同。具体为息肉分割、COVID - 19肺感染、乳腺肿瘤分割和OCT层的训练epoch设置个数为50,200,100,100.

4.4 与最先进方法的比较

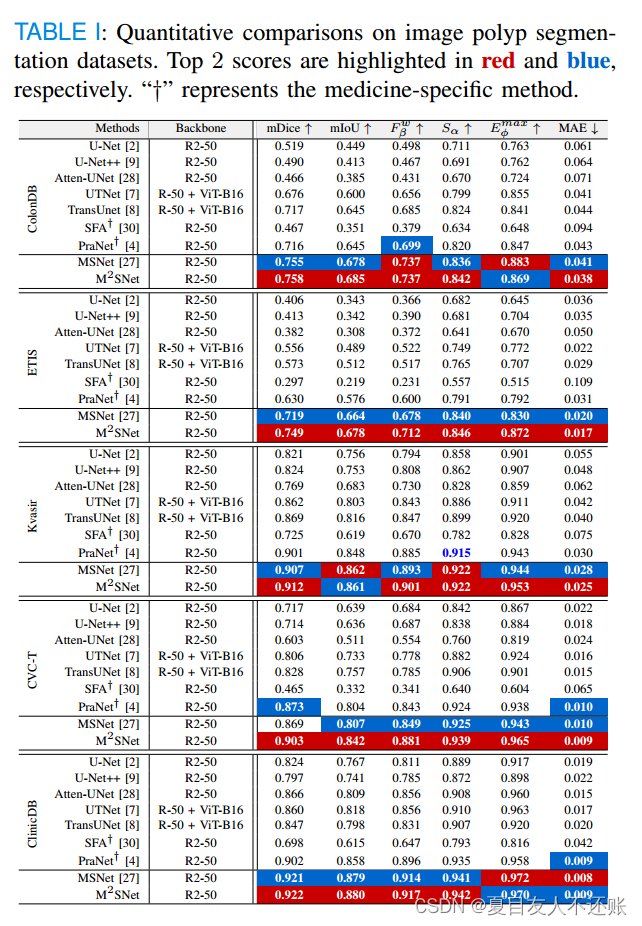

为了公平比较,我们不仅与医学专用方法进行比较,还与具有代表性的医学通用方法进行比较,包括UNet、UNet++、Attention UNet、UTNet和TransUNet。

在5个息肉数据集上与其他 SOTA 方法对比,M2SNet在关键指标 mDice 上均获得了第一名。

在 COVID-19 CT 和 Breast 超声数据集上,M2SNet 在 Dice 精度也是第一。在 MICCAI 2022 OCT (GOALS) 公开挑战赛中,与100支队伍同台竞争荣获第二名!

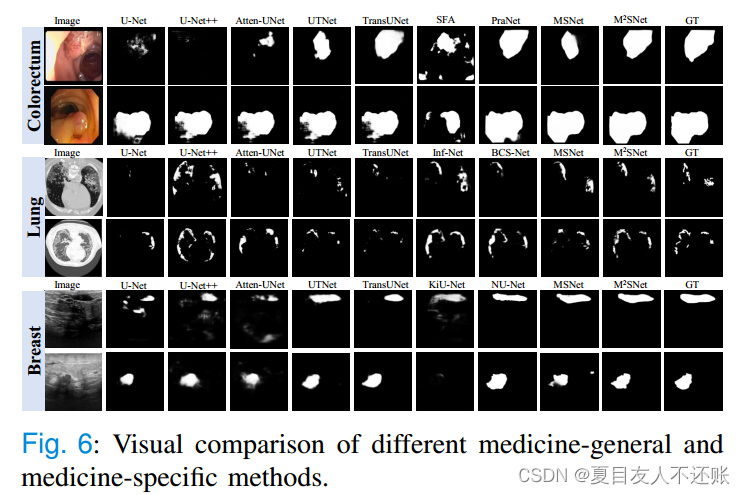

可以很直观地看出,M2SNet 的分割结果在完整度和细腻度上都比其他的模型表现更好,这更充分地证明了 M2SNet 在医学图像分割领域中的先进性与通用性。

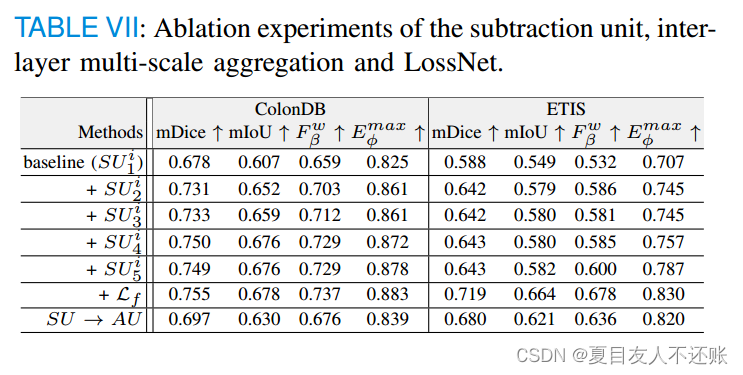

4.5 消融实验

我们以常用FPN网络为基准,分析各组成部分的贡献。

减法单元、层间多尺度减法聚合和LossNet的有效性:

通过逐步增加不同的组件,M2SNet性能都获得了进一步的提升:

层内多尺度减法设计的有效性:

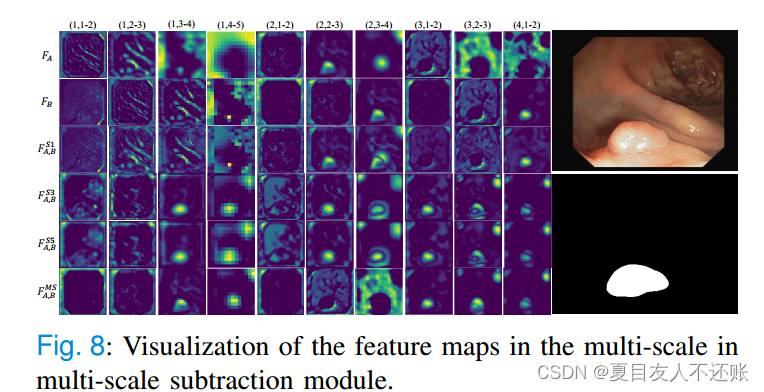

为了更直观地显示不同尺度的差分信息,在多尺度减法模块中将多尺度的所有特征可视化,如图8所示。可以看到,多尺度减法模块中的多尺度可以清晰地突出高层特征与其他高层特征的区别,并将其定位效果传播到低层特征。在同一层次上,层内多尺度聚集设计既能综合捕捉细微差异特征,又能综合捕捉区域差异特征。因此,在不同层次的增强特征中,可以很好地描述全局结构信息和局部边界信息。

5 讨论

多尺度减法单元:不同于以往的加法和级联运算,在多层结构中使用减法,使输入到解码器的结果特征具有了不同的特征不同级别之间的冗余大大减少,其级别特定属性显着增强。在这项工作中,我们进一步探索了减法单元在层内多尺度融合中的潜力。如何在提高精度的同时保持与单量程相同的效率是关键的挑战。给出了使用固定参数的多尺度卷积滤波器的解决方案。与单尺度设计相比,多尺度减法单元可以使网络在像素-像素和邻居-邻居级别上收集到更多的互补信息。多尺度减法单元在效率和精度方面的优势见表8。多尺度信息提取和特征聚合是计算机视觉领域的两个常见问题。我们的多尺度减法单元可以同时解决这两个问题。我们认为这种新的范式可以推动未来对减法运算的更多研究。

6 结论

在本文中,我们反思了以前基于附加或连接的方法,并提出了一种简单而通用的多尺度多尺度减法网络(M2SNet),用于更有效的医学图像分割。基于所提出的层内多尺度减法单元,对相邻层进行金字塔聚合,提取低阶和高阶的跨层互补信息,并结合特定层的信息增强多尺度特征表示。此外,我们设计了一个基于无训练网络的损失函数来监督不同特征层次的预测,从而在后向阶段对结构和细节进行优化分割。针对4个医学分割任务的11个基准数据集的实验结果表明,所提出的模型优于各种最先进的方法。