- 1电脑技巧:分享五款办公文档密码解除小软件_删除文件密码的软件有什么

- 2网站部署证书 百度浏览器仍提示不安全网站怎么办_百度网址安全中心检测正常

- 3C/C++编程笔记:指针篇!从内存理解指针,让你完全搞懂指针_c++ 指针指向其他数组,原数组内存

- 4uniapp微信小程序video不显示,无法播放_uniapp video 提示当前视频没办法播放

- 5MySQL主备HA(keepalived)方案_mysql keepalive + vip的ha方案

- 6蓝桥杯第十四届电子类单片机组程序设计_csdn蓝桥杯十四

- 7数据可视化高级技术Echarts(桑基图&入门)_echart多维桑基图

- 8模拟退火——算法思想与实例_模拟退火算法例题

- 9Swift高级分享 - 使用Swift Package Manager管理依赖项_swift package manager 排除特定依赖

- 10自学Vue开发Dapp去中心化钱包(三)

Docker 网络与资源控制

赞

踩

一 Docker 网络实现原理

Docker使用Linux桥接,在宿主机虚拟一个Docker容器网桥(docker0),Docker启动一个容器时会根

据Docker网桥的网段分配给容器一个IP地址,称为Container-IP,同时Docker网桥是每个容器的默

认网关。因为在同一宿主机内的容器都接入同一个网桥,这样容器之间就能够通过容器的

Container-IP 直接通信。

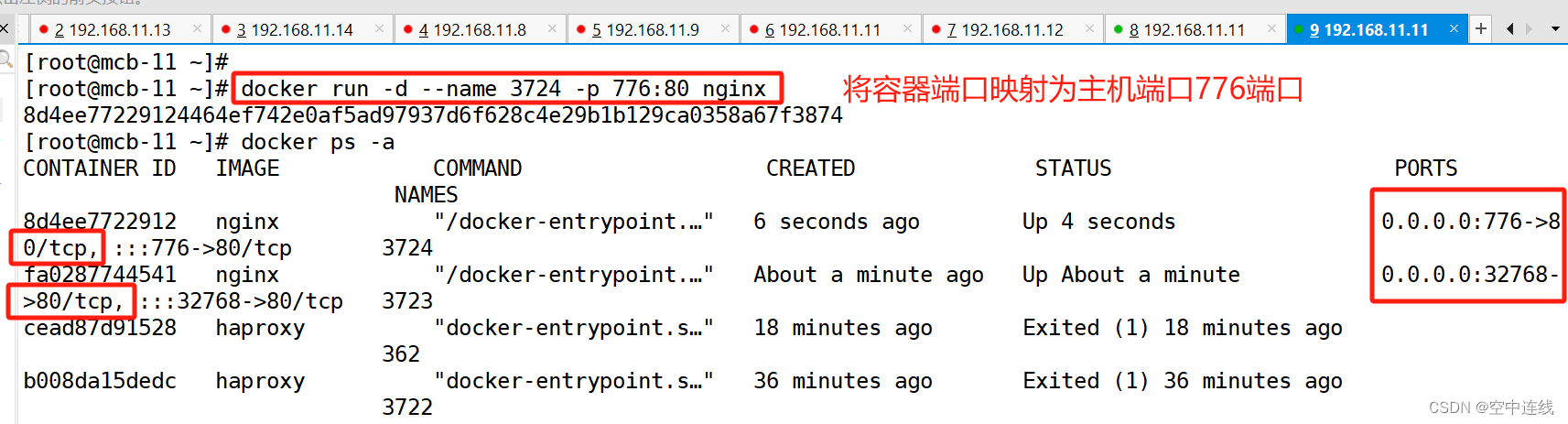

Docker网桥是宿主机虚拟出来的,并不是真实存在的网络设备,外部网络是无法寻址到的,这也

意味着外部网络无法直接通过 Container-IP 访问到容器。如果容器希望外部访问能够访问到,可

以通过映射容器端口到宿主主机(端口映射),即 docker run 创建容器时候通过 -p 或 -P 参数来

启用,访问容器的时候就通过[宿主机IP]:[容器端口]访问容器。

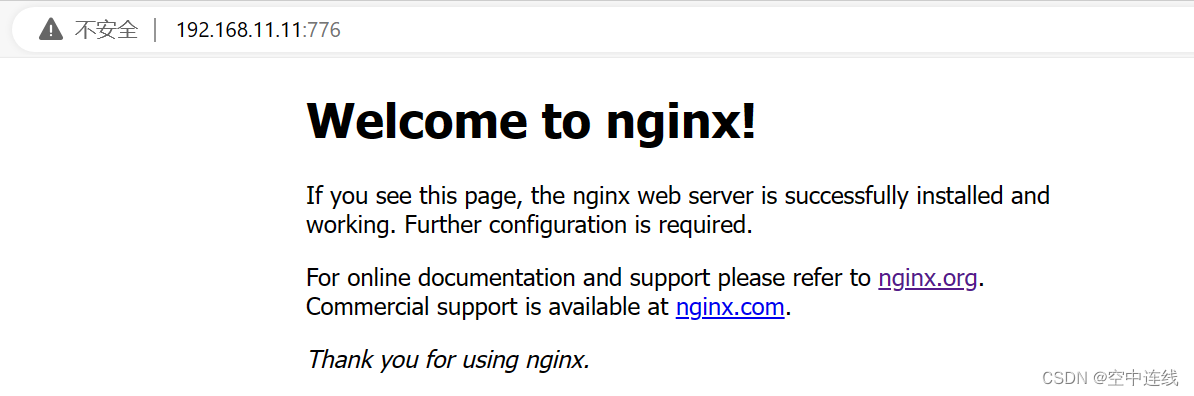

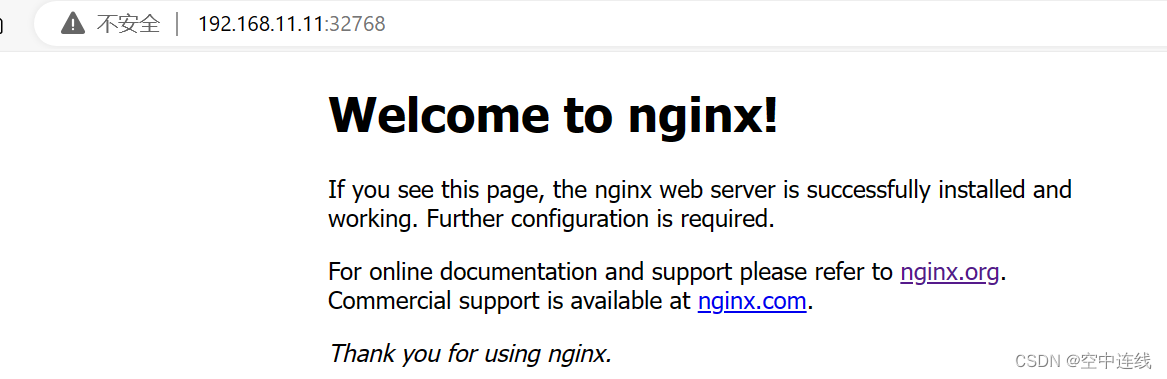

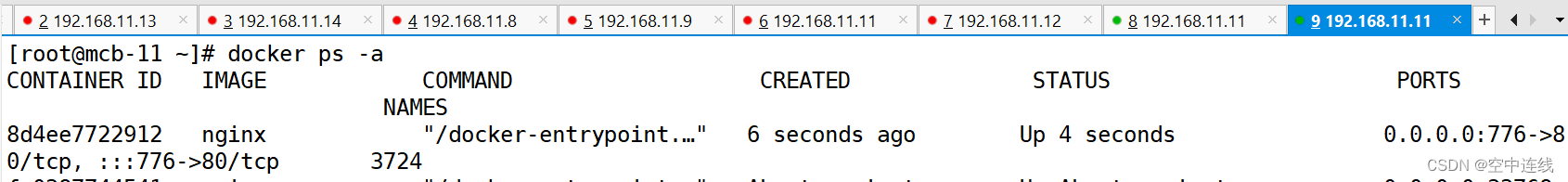

- docker run -d --name test1 -P nginx

-

- #随机映射端口(从32768开始)

-

- docker run -d --name test2 -p 43000:80 nginx

-

- #指定映射端口

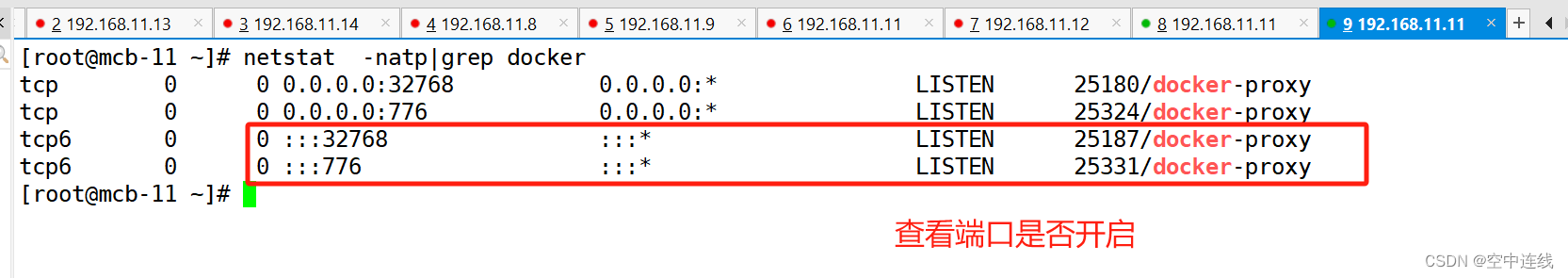

netstat -natp|grep docker

1 查看容器的输出和日志信息

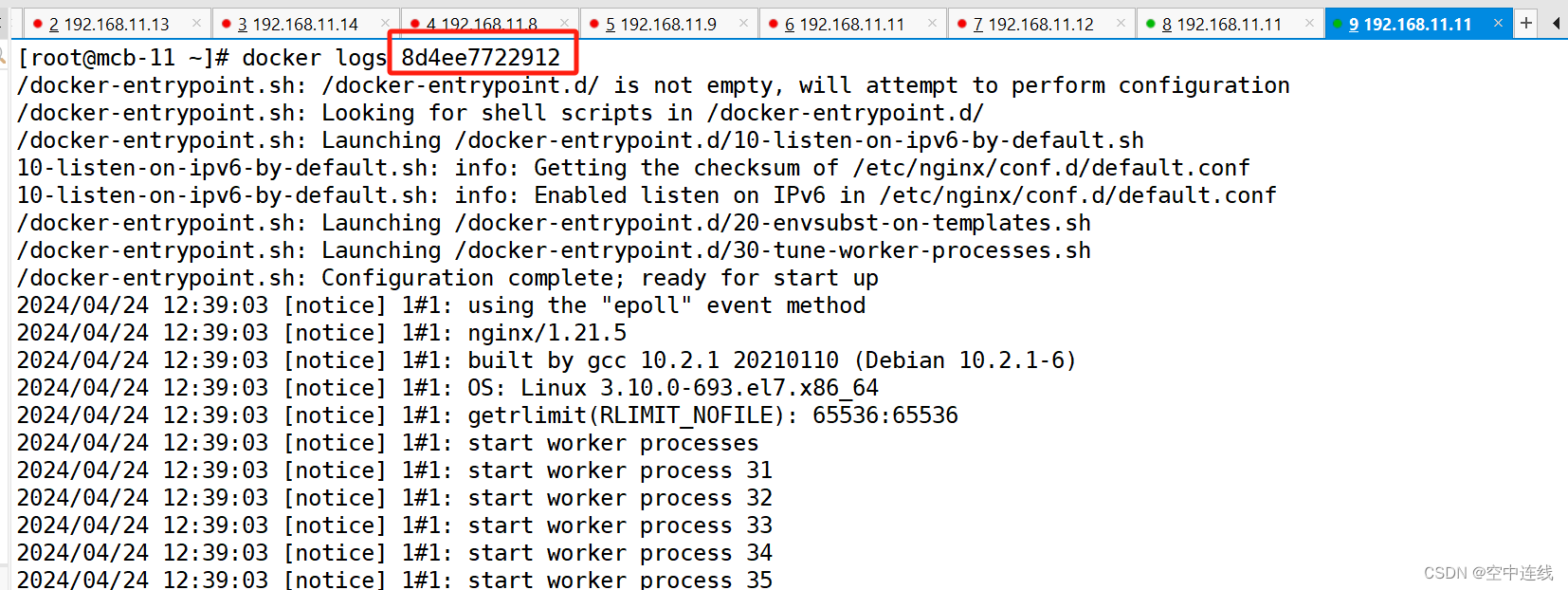

docker logs 容器的ID/名称

2 Docker 的网络模式

1 Host:容器将不会虚拟出自己的网卡,配置自己的IP等,而是使用宿主机的IP和端口。

host 器使用宿主机的网络直接公开服务。这意味着日过你在容器中运行一个web服务,那么它就直

接绑定到主机的网络接口上,而不是通过docker进行任何网络转发

2 Container:创建的容器不会创建自己的网卡,配置自己的IP,而是和一个指定的容器共享IP、端口范围。(同一网络空间下 共享ip 但端口不一样)

这种模式允许容器去共享另一个容器网络命名空间,这说明两个容器可以相同的网络接口和IP地

址,他们共享的是同一网络命名空间

3 None:该模式关闭了容器的网络功能。

是最简单的网络模式,此网络模式表示将容器拥有自己的网路命名空间,但不会进行任何网络配置,这实际给了用户完全的自主权来给自己配置容器的网络

4 Bridge:默认为该模式,此模式会为每一个容器分配、设置IP等,并将容器连接到一个docker0

虚拟网桥,通过docker0网桥以及iptables nat 表配置与宿主机通信。bridge 默认的网络模式每个新

创建的容器都将该网络分配一个IP地址,此网络模式允许所有docker容器之间以及docker宿主机之

间进行互相通信

二 自定义网络

1 docker网络列表

docker network ls 或 docker network list

help

help

docker network llist

2 使用docker run创建Docker容器时,可以用 --net 或 --network 选项指定容器的网络模式

host模式:使用 --net=host 指定。

none模式:使用 --net=none 指定。(几乎用不上)

container模式:使用 --net=container:NAME_or_ID 指定。

bridge模式:使用 --net=bridge 指定,默认设置,可省略。

二 网络模式详解:

1 host模式

相当于Vmware中的桥接模式,与宿主机在同一个网络中,但没有独立IP地址。

Docker使用了Linux的Namespaces技术来进行资源隔离,如PID Namespace隔离进程,Mount

Namespace隔离文件系统,Network Namespace隔离网络等。

一个Network Namespace提供了一份独立的网络环境,包括网卡、路由、iptable规则等都与其他

的Network Namespace隔离。 一个Docker容器一般会分配一个独立的Network Namespace。 但

如果启动容器的时候使用host模式,那么这个容器将不会获得一个独立的Network Namespace,

而是和宿主机共用一个Network Namespace。容器将不会虚拟出自己的网卡、配置自己的IP等,

而是使用宿主机的IP和端口(皆不相同)。

创建名为mcb003 网络模式为host 基于haproxy的镜像

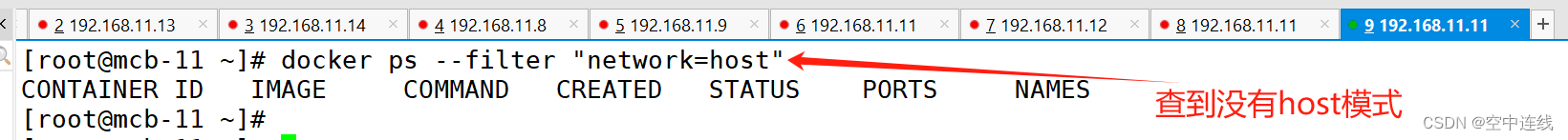

docker ps --filter "network=host"

lsof -i:80

注意:8080端口已经占用就无需添加否则报错

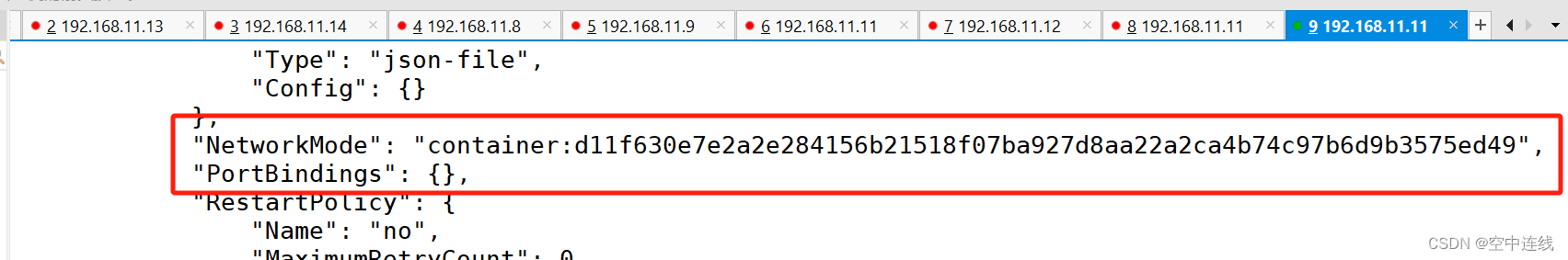

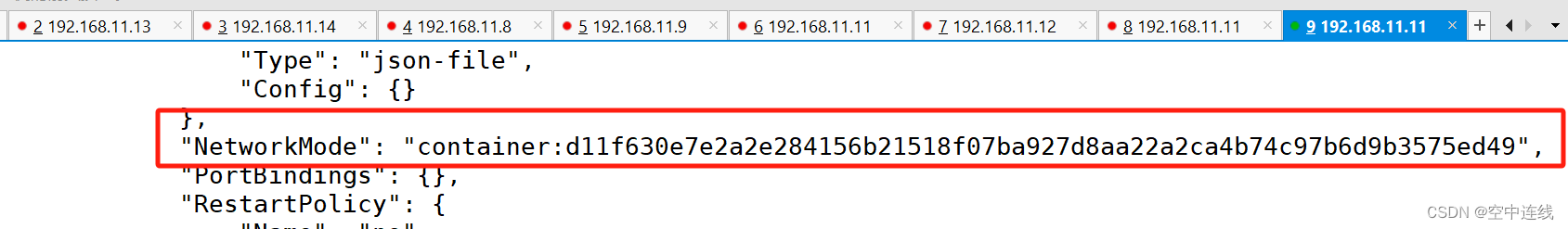

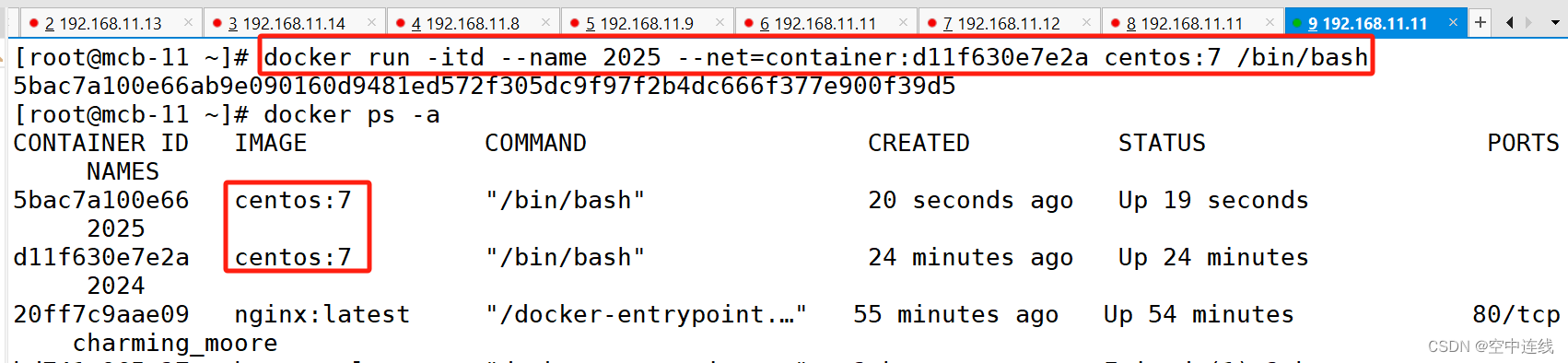

2 container模式

多容器共享网络命名空间

在理解了host模式后,这个模式也就好理解了。这个模式指定新创建的容器和已经存在的一个容器

共享一个Network Namespace,而不是和宿主机共享。新创建的容器不会创建自己的网卡,配置

自己的IP,而是和一个指定的容器共享IP、端口范围等。同样,两个容器除了网络方面,其他的如

文件系统、进程列表等还是隔离的。两个容器的进程可以通过lo网卡设备通信。

实验 1

① name 选项:可以给容器创建一个自定义名称

docker run -itd --name test1 centos:7 /bin/bash

docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

3ed82355f811 centos:7 "/bin/bash" 5 days ago Up 6 hours test1

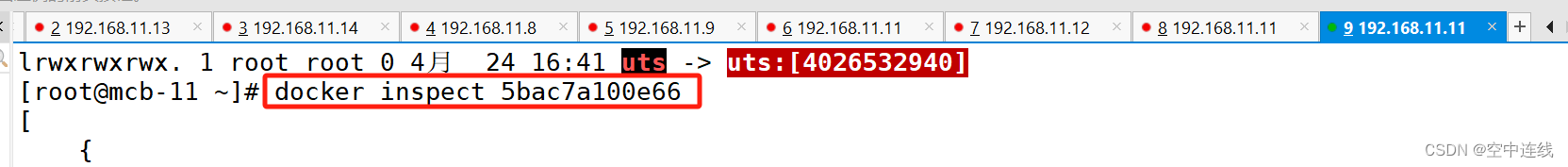

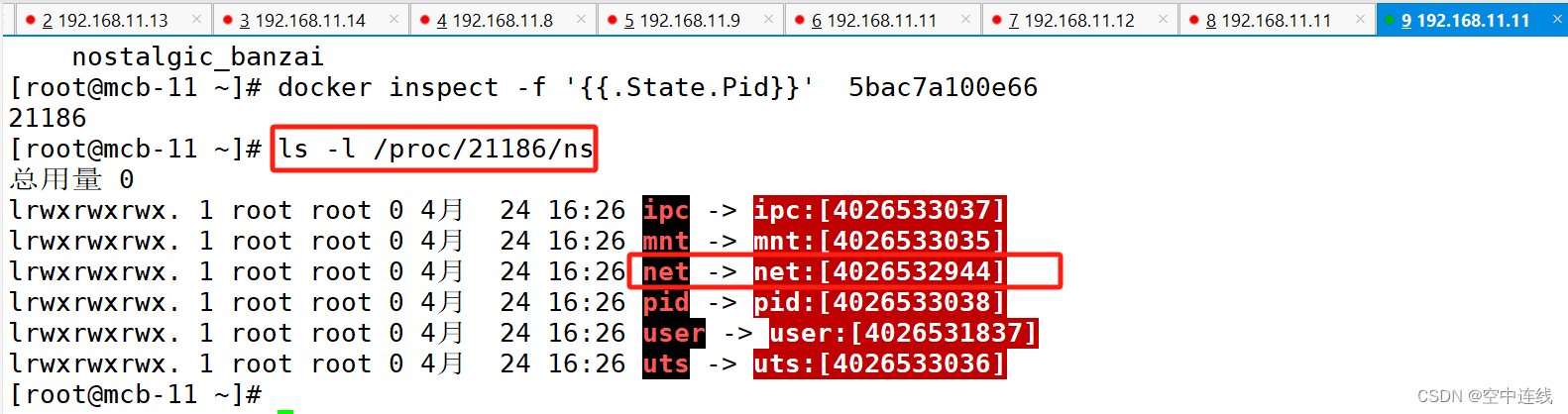

②查看容器进程号

docker inspect -f '{{.State.Pid}}' 3ed82355f811

25945

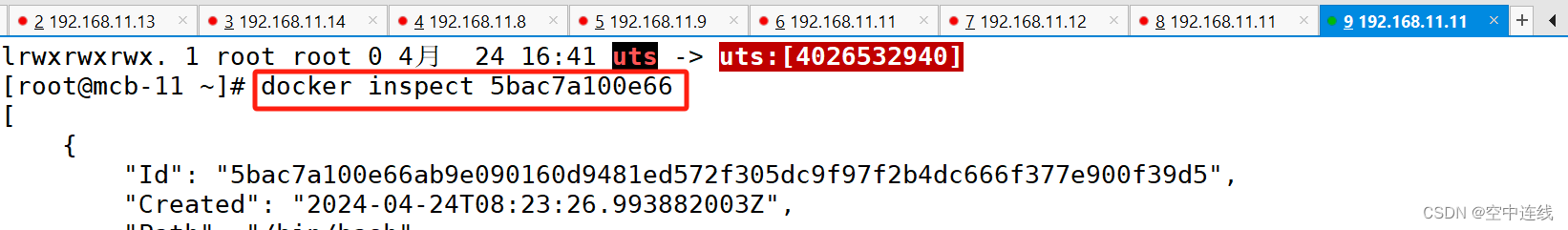

③查看容器的进程、网络、文件系统等命名空间编号

ls -l /proc/25495/ns

实验 2

检测对比:

查看可以发现两个容器的 net namespace 编号相同

3 none模式

Docker容器拥有自己的Network Namespace,但是,并不为Docker容器进行任何网络配置。

Docker容器没有网卡、IP、路由等信息。这种网络模式下容器只有lo回环网络,没有其他网卡。

这种类型的网络没有办法联网,封闭的网络能很好的保证容器的安全性。

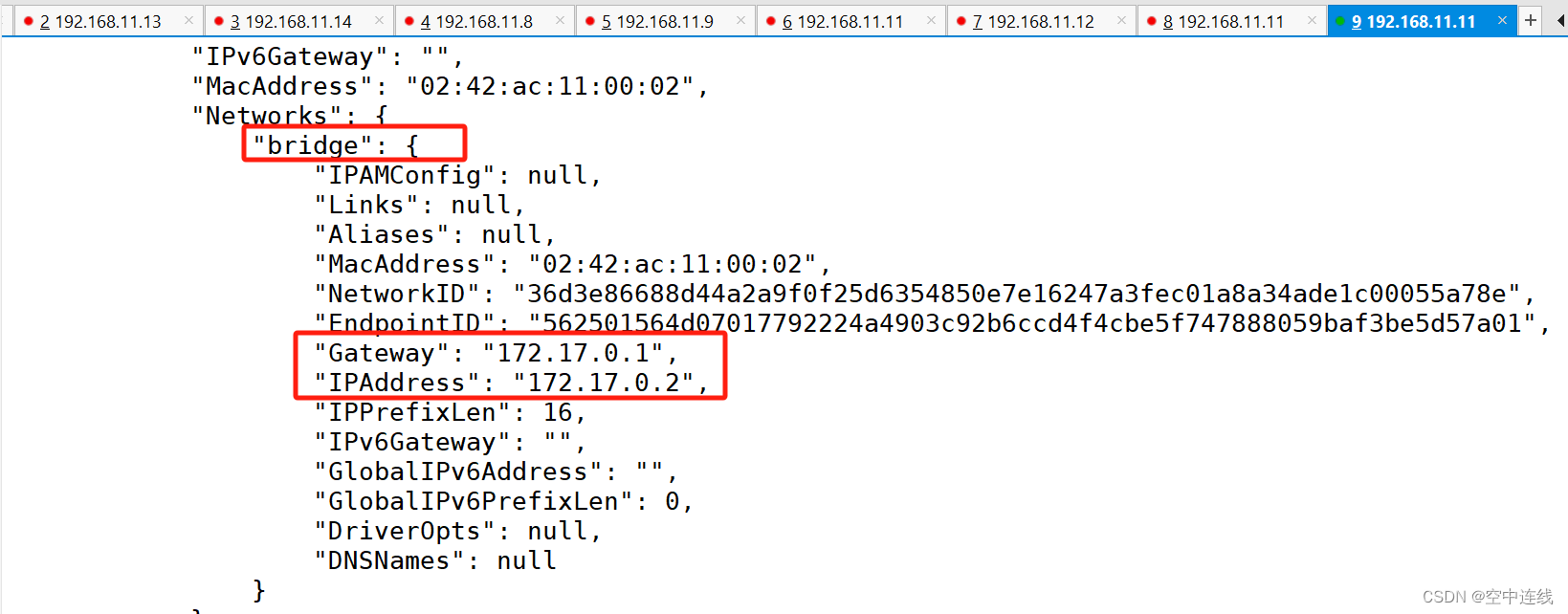

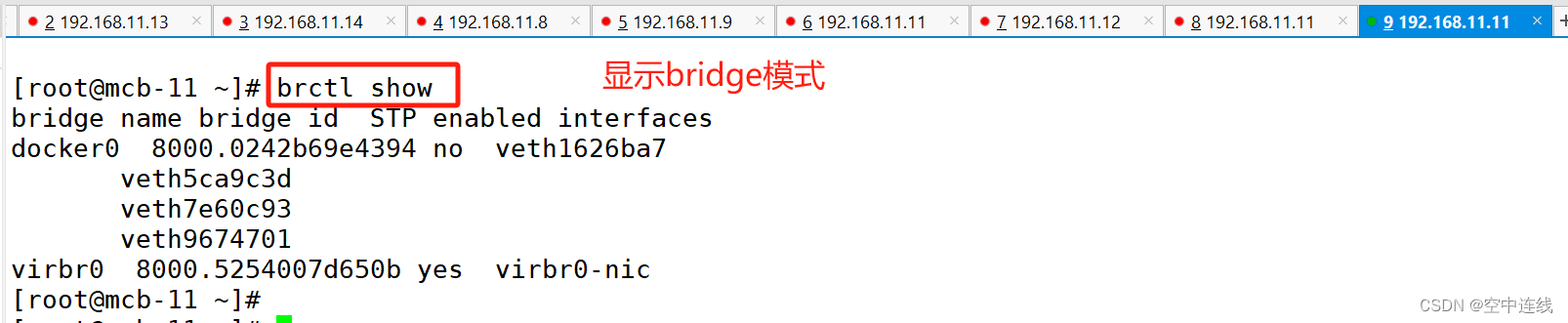

4 bridge模式

bridge模式是docker的默认网络模式,不用--net参数,就是bridge模式。

相当于Vmware中的 nat 模式,容器使用独立network Namespace,并连接到docker0虚拟网卡。

通过docker0网桥以及iptables nat表配置与宿主机通信,此模式会为每一个容器分配Network

Namespace、设置IP等,并将一个主机上的 Docker 容器连接到一个虚拟网桥上。

(1)当Docker进程启动时,会在主机上创建一个名为docker0的虚拟网桥,此主机上启动的

Docker容器会连接到这个虚拟网桥上。虚拟网桥的工作方式和物理交换机类似,这样主机上的所

有容器就通过交换机连在了一个二层网络中。

(2)从docker0子网中分配一个IP给容器使用,并设置docker0的IP地址为容器的默认网关。在主

机上创建一对虚拟网卡veth pair设备。veth设备总是成对出现的,它们组成了一个数据的通道,数

据从一个设备进入,就会从另一个设备出来。因此,veth设备常用来连接两个网络设备。

(3)Docker将 veth pair 设备的一端放在新创建的容器中,并命名为 eth0(容器的网卡),另一

端放在主机中, 以 * 这样类似的名字命名,并将这个网络设备加入到 docker0 网桥中。可以通过

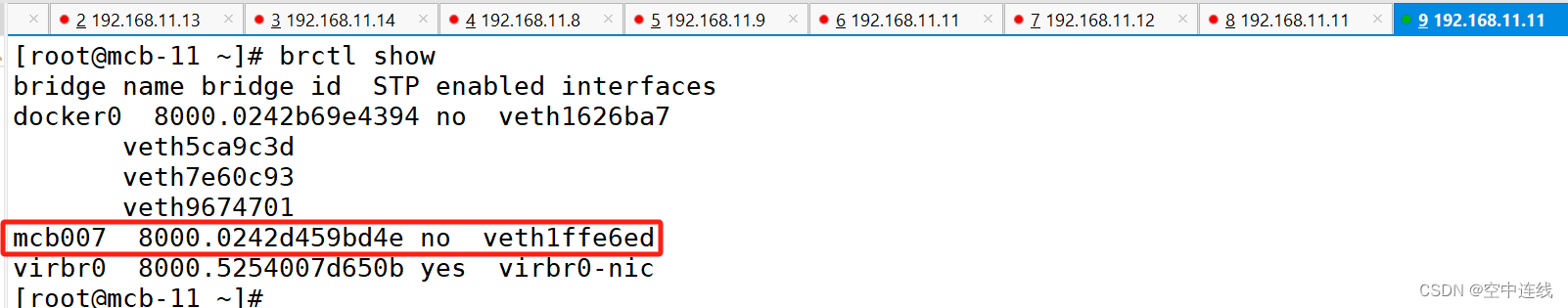

brctl show 命令查看。veth

(4)使用 docker run -p 时,docker实际是在iptables做了DNAT规则,实现端口转发功能。可以使

用iptables -t nat -vnL 查看。

brctl show

三 自定义网络

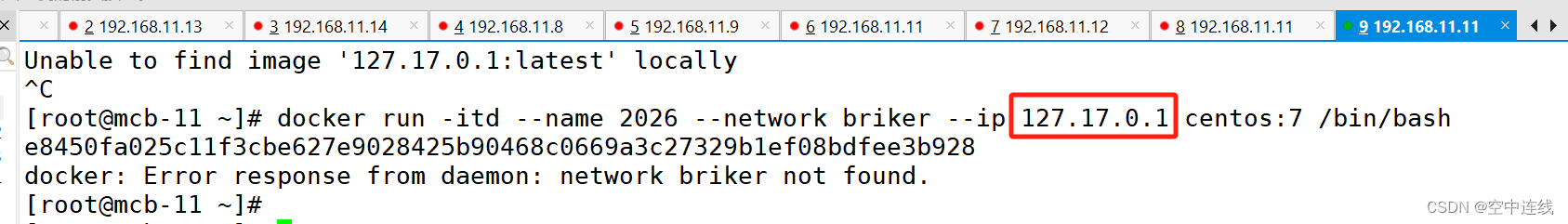

在容器中需设置虚拟IP地址才能用

①直接使用bridge模式,是无法支持指定IP运行docker的,例如执行以下命令就会报错

docker run -itd --name test3 --network bridge --ip 172.17.0.10 centos:7 /bin/bash

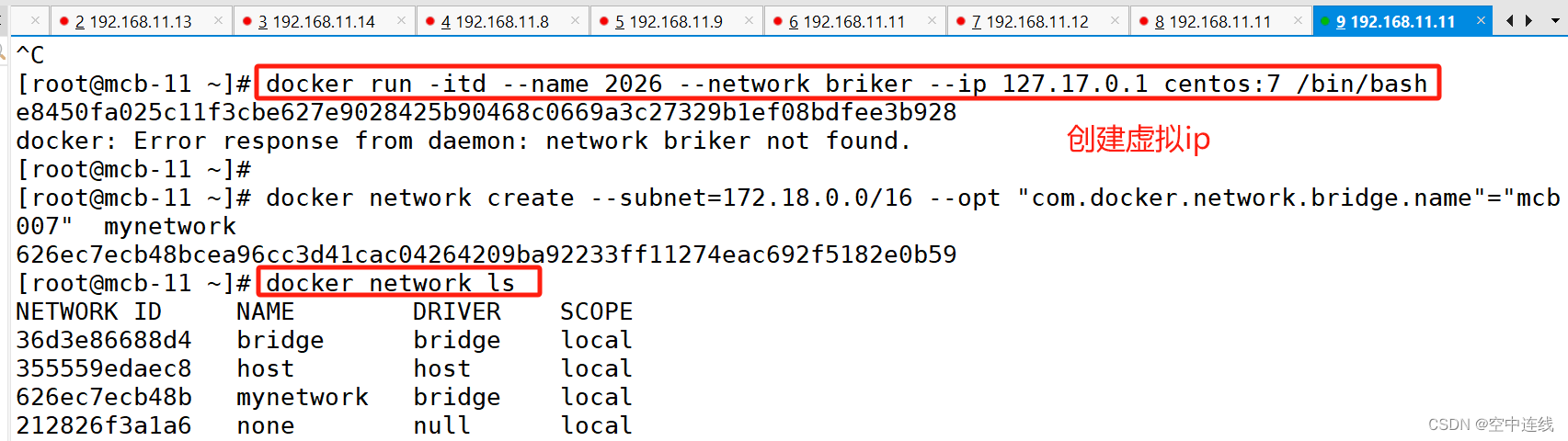

②创建自定义网络,可以先自定义网络,再使用指定IP运行docker

②创建自定义网络,可以先自定义网络,再使用指定IP运行docker

docker network create --subnet=172.18.0.0/16 --opt "com.docker.network.bridge.name"="docker1" mynetwork

docker1 为执行 ifconfig -a 命令时,显示的网卡名,如果不使用 --opt 参数指定此名称,那你在使用 ifconfig -a 命令查看网络信息时,看到的是类似 br-

110eb56a0b22 这样的名字,这显然不怎么好记。

mynetwork 为执行 docker network list 命令时,显示的bridge网络模式名称。

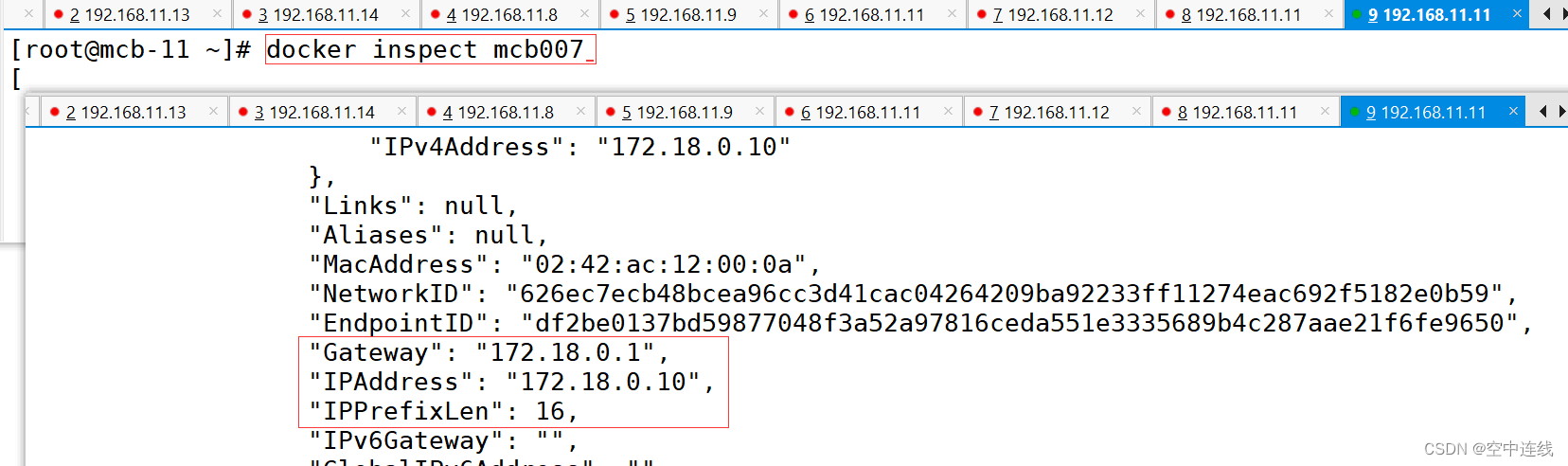

docker run -itd --name mcb007 --net mynetwork --ip 172.18.0.10 centos:7 /bin/bash

四 资源控制

1 CPU 资源控制

cgroups,是一个非常强大的linux内核工具,他不仅可以限制被 namespace 隔离起来的资源, 还

可以为资源设置权重、计算使用量、操控进程启停等等。 所以 cgroups(Control groups)实现了

对资源的配额和度量。

2 cgroups有四大功能:

资源限制:可以对任务使用的资源总额进行限制

优先级分配:通过分配的cpu时间片数量以及磁盘IO带宽大小,实际上相当于控制了任务运行优

先级

资源统计:可以统计系统的资源使用量,如cpu时长,内存用量等

任务控制:cgroup可以对任务执行挂起、恢复等操作

3 cpu 周期 分片

双核

1核 1s=1000ms周期分片

1ms(亳秒)=1000微妙1000毫秒(ms)=1000000微妙linux 操作系统 单位是以微妙为单位

4 设置CPU使用率上限

Linux通过CFS(Completely Fair Scheduler,完全公平调度器)来调度各个进程对CPU的使用。

CFS默认的调度周期是100ms。

我们可以设置每个容器进程的调度周期,以及在这个周期内各个容器最多能使用多少 CPU 时间。

使用 --cpu-period 即可设置调度周期,使用 --cpu-quota 即可设置在每个周期内容器能使用的CPU

时间。两者可以配合使用。

CFS 周期的有效范围是 1ms~1s,对应的 --cpu-period 的数值范围是 1000~1000000。 周期100毫

秒

而容器的 CPU 配额必须不小于 1ms,即 --cpu-quota 的值必须 >= 1000。

docker ps

docker ps -a|grep mcb007

cd /sys/fs/cgroup/cpu/docker/23fabfc51f5865671f58a159cf20a187a6c3d5c7e7fc47af14a22643b10a6596/

cat cpu.cfs_quota_us #表示该cgroups限制占用的时间(微秒),默认为-1,表示不限制。 如果设为50000,表示占用50000/100000=50%的CPU

cat cpu.cfs_period_us #cpu分配的周期(微秒,所以文件名中用 us 表示),默认为100000。

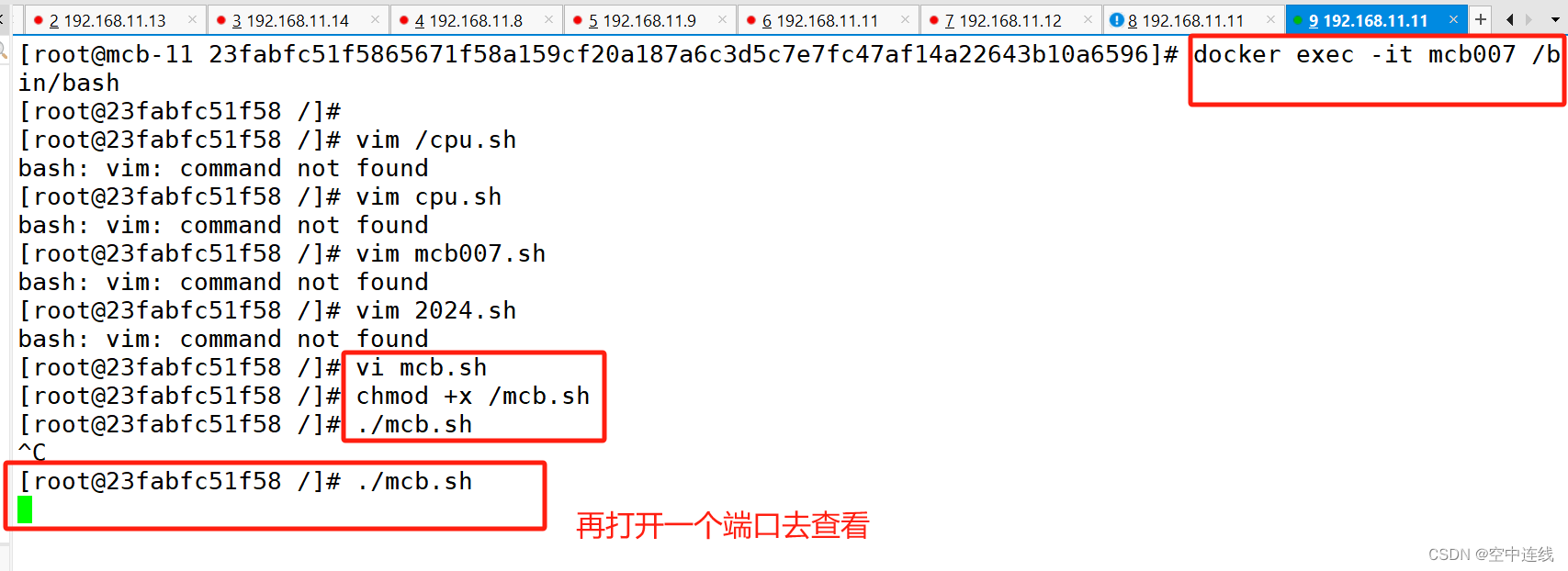

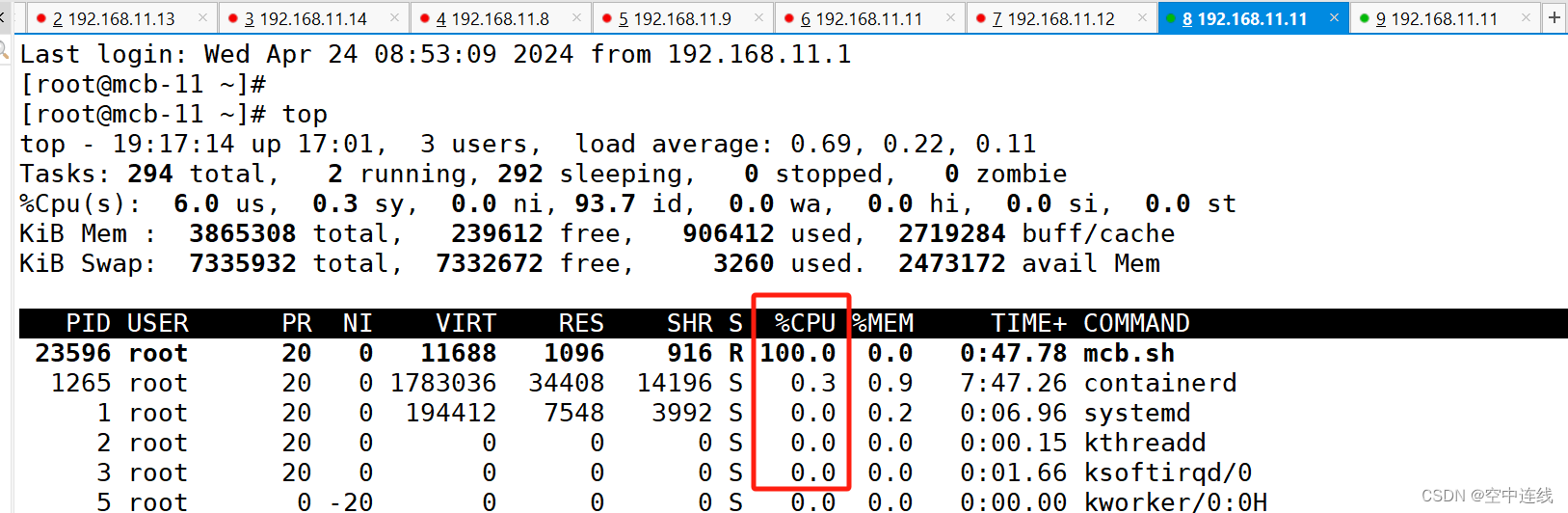

进行CPU压力测试

- vim /cpu.sh

- #!/bin/bash

- i=0

- while true

- do

- let i++

- done

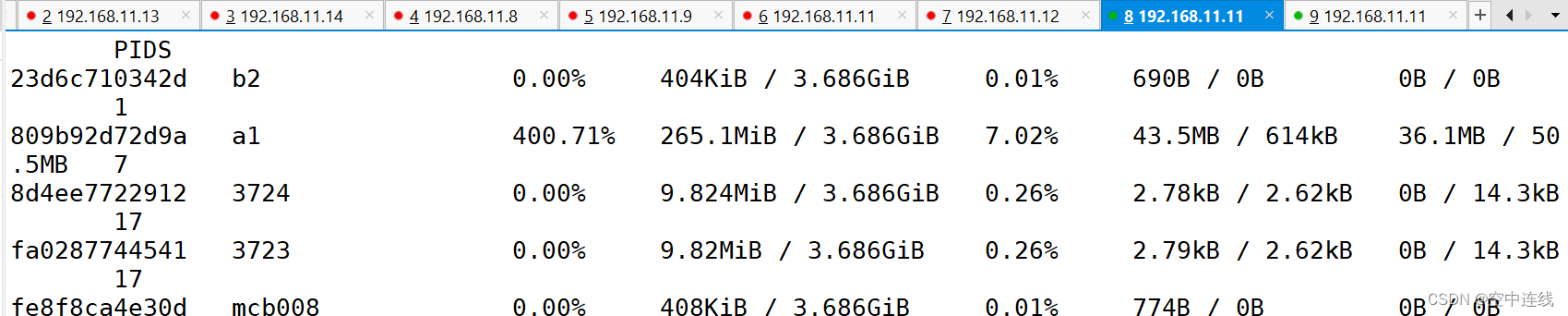

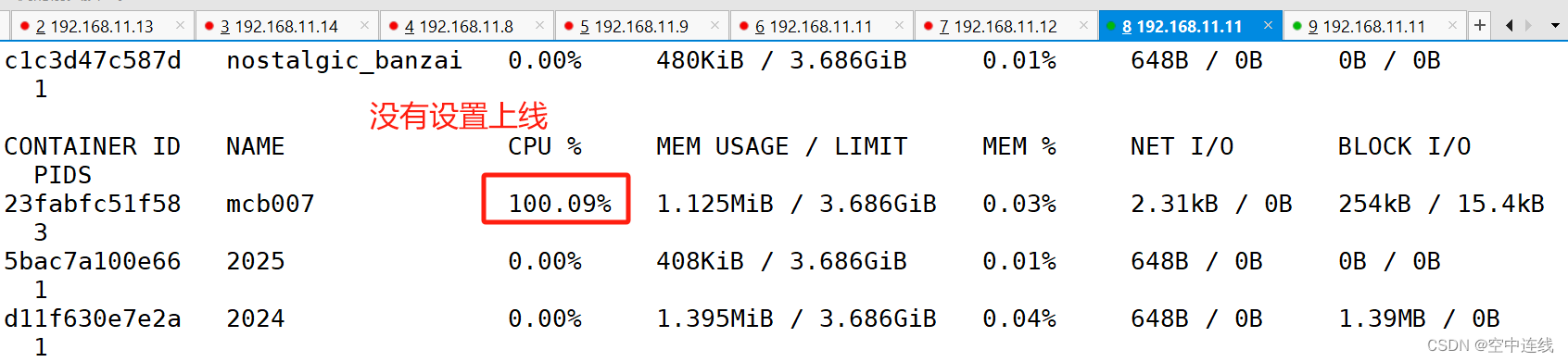

docker stats

5 设置50%的比例分配CPU使用时间上限

docker run -itd --name test6 --cpu-quota 50000 centos:7 /bin/bash #可以重新创建一个容器并设

置限额

或者cd/sys/fs/cgroup/cpu/docker/3ed82355f81151c4568aaa6e7bc60ba6984201c119125360924bf7dfd6eaa42b/

echo 50000 > cpu.cfs_quota_us

docker exec -it 3ed82355f811 /bin/bash

./cpu.sh

top #可以看到cpu占用率接近50%,cgroups对cpu的控制起了效果

- [root@mcb-11 ~]# docker ps

- CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

- fe8f8ca4e30d centos:7 "/bin/bash" 26 seconds ago Up 25 seconds mcb008

- 23fabfc51f58 centos:7 "/bin/bash" 2 hours ago Up 2 hours mcb007

- [root@mcb-11 ~]# echo 50000 > mcb007.cfs_quota_us

- [root@mcb-11 ~]# docker exec -it fe8f8ca4e30d /bin/bash

- [root@fe8f8ca4e30d /]# ./mcb007.sh

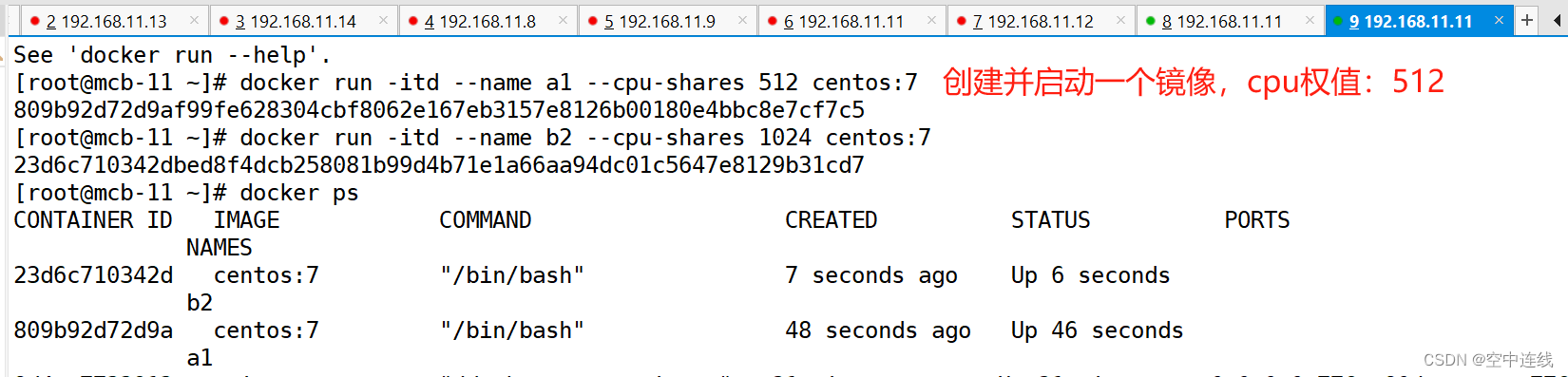

6 设置CPU资源占用比(设置多个容器时才有效)

Docker 通过 --cpu-shares 指定 CPU 份额,默认值为1024,值为1024的倍数。

创建两个容器为 c1 和 c2,若只有这两个容器,设置容器的权重,使得c1和c2的CPU资源占比为

1/3和2/3。

docker run -itd --name c1 --cpu-shares 512 centos:7

docker run -itd --name c2 --cpu-shares 1024 centos:7

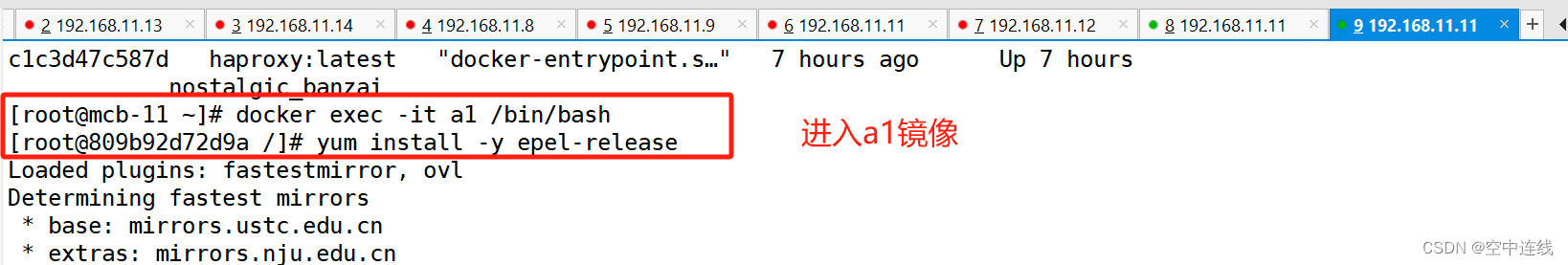

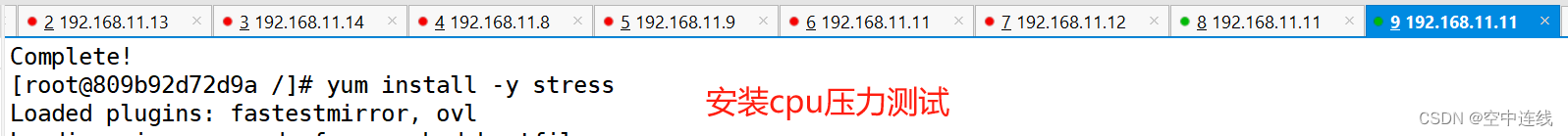

分别进入容器,进行压力测试

yum install -y epel-release

yum install -y stress

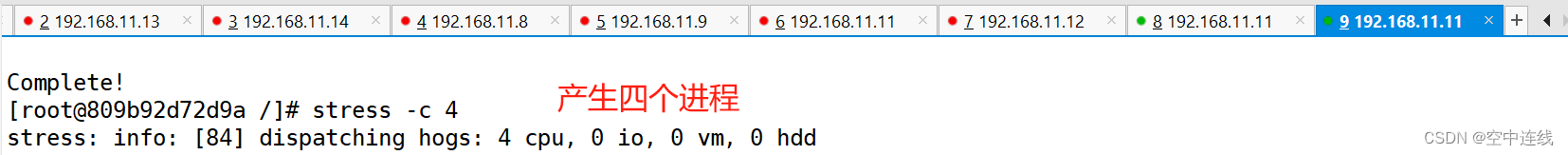

stress -c 4 #产生四个进程,每个进程都反复不停的计算随机数的平方根

docker stats # 查看容器运行状态(动态更新)