- 1SQL Server之自定义函数

- 2docker容器常用命令_创建一个不运行的容器命令

- 310分钟弄懂APP自动化工具:uiautomator2【从入门到精通】

- 42020届字节跳动测试开发(测开)校招 一、二、三技术面——面经_字节3-2面试经验

- 5一篇文章深入理解分布式锁_分布式锁卡死系统

- 6免费JSON接口_免费json视频解析接口

- 7实战 | YOLOv10 自定义数据集训练实现车牌检测 (数据集+训练+预测 保姆级教程)_vs2022 from ultralytics import yolov10

- 8知识蒸馏与推荐系统_deepfm 知识蒸馏

- 9【Leetcode】vector刷题_leetcode vector

- 10《软件定义安全》之六:SDN和NFV安全实践

k8s部署elk+filebeat;springCloud集成elk+filebeat+kafka+zipkin实现多个服务日志链路追踪聚合到es

赞

踩

一、目的

如今2023了,大多数javaweb架构都是springboot微服务,一个前端功能请求后台可能是多个不同的服务共同协做完成的。例如用户下单功能,js转发到后台网关gateway服务,然后到鉴权spring-sercurity服务,然后到业务订单服务,然后到支付服务,后续还有发货、客户标签等等服务。

其中每个服务会启动多个实例做负载均衡,这样一来我们想看这个功能的完成流程日志,需要找到对应的服务器ip,日志文件在哪,其中又要确定具体负载转发到哪些台服务器上了。 如果是生产问题想要快速定位原因,需要一套解决方案!

二、涉及技术栈

- 基本架构:

spring cloud(springBoot+服务发现+网关+负载熔断等netflex)。本人目前使用的是springboot+eureka+gateway+springSercurity+openfeign+springConfig 配合业务功能涉及中间件redis、quartz、kafka、mysql、elasticsearch - 日志采集处理展现:ELK

- elasticsearch:海量json数据存储即席查询

- logstash: 源头采集数据(tcp、file、redis、mq)、格式化处理、推送es存储

- kibana: 官方es可视化交互curd工具

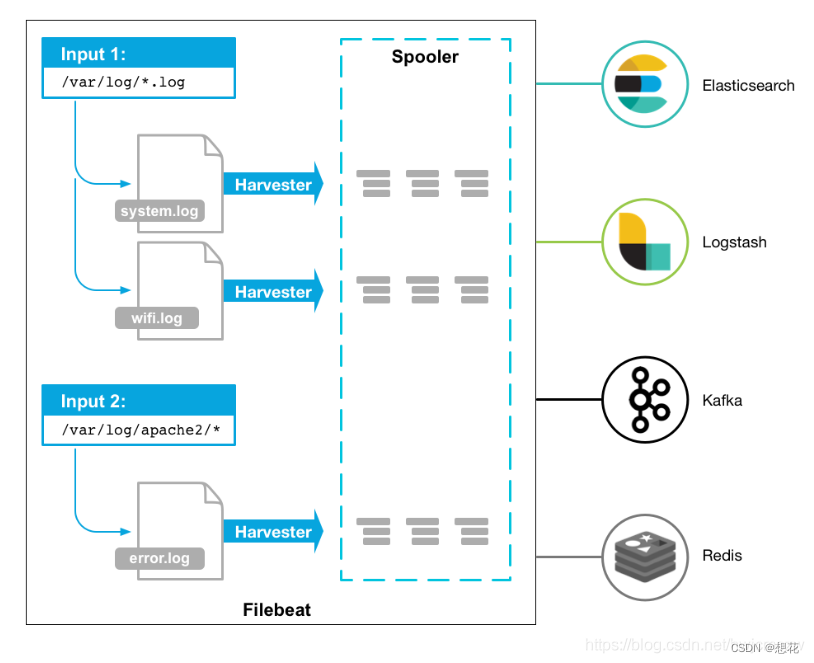

- 高效轻量数据采集工具: filebeat。 监控日志文件实时获取,可以推送到kafka

- kafka:接收filebeat数据,供logstash消费

- 多服务链路追踪:sleuth-zipkin。无代码侵入。简单来说就是打印的日志内容新增了tranceId、spanId。例如

三、流程

-

js发起ajax请求后台网关服务

-

网关服务集成了maven

<artifactId>spring-cloud-starter-zipkin</artifactId>依赖,会自动给当前的请求header中添加tranceId字段和spanId字段。这两个字段值随机生成。其中tranceId等于spanId在header中没有这两个字段的时候:例如tranceId=123a,spanId=123a 并添加到header中。并且打印日志的时候会把这个信息打印出来 -

之后网关根据请求路径转发到业务服务A,A服务的zipkin发现header中有tranceId信息,就只生成spanId,例如tranceId=123a,spanId=231b 并添加到header中。并且打印日志的时候会把这个信息打印出来。

-

A服务又rpc调用了B服务。B服务的zipkin发现header中有tranceId信息,就只生成spanId,例如tranceId=123a,spanId=342h 并添加到header中。并且打印日志的时候会把这个信息打印出来。

-

调用完结返回前端响应。

-

到此服务器的日志文件就会新增上述的日志。然后

filebeat工具监听到了各个服务的新日志,读取并推送到kafka -

消息队列的topic下生产新数据,

logstash工具提前配置并启动消费kafka, 处理并保存数据到elasticsearch。这里好奇为什么不直接通过filebeat直接推送es,或者springboot的log框架直接通过appender直接推送es呢?- 使用filebeat解耦,不影响springboot性能。并且轻量

- 使用kafka是应对大量并发数据,减少logstash压力

- 最终经过logstash推送es是为了加工格式化源数据,再保存到es,这样更加方便es查询日志

-

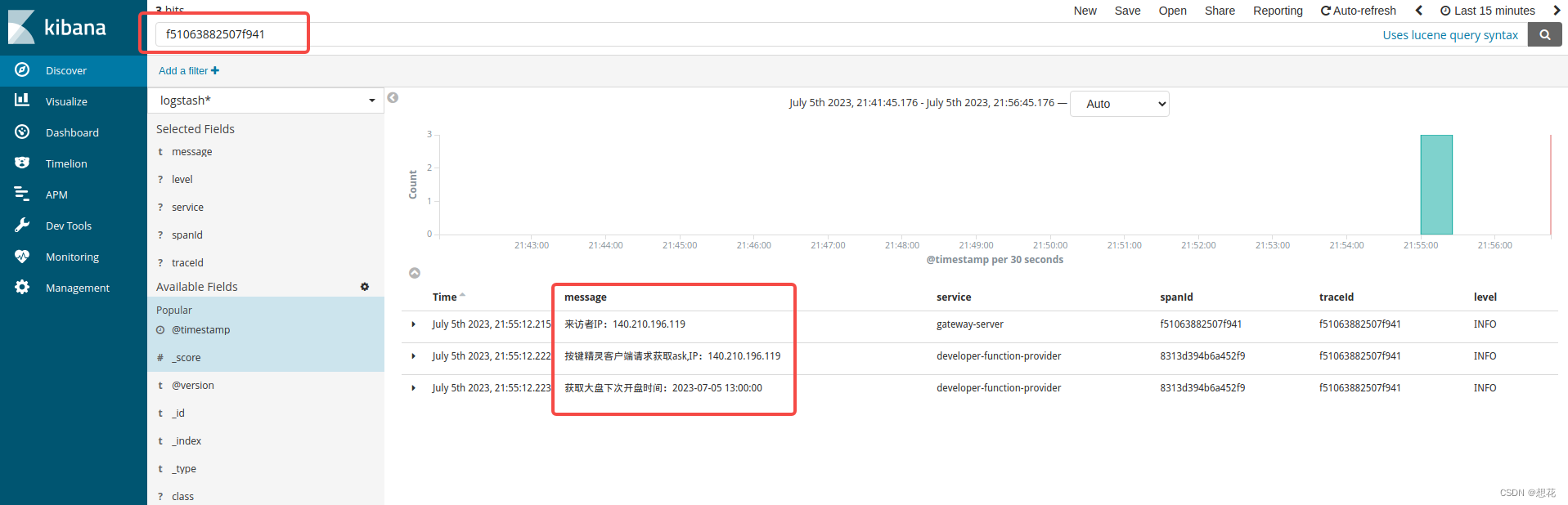

持久化es之后,通过

kibana查询日志,查询条件是tranceId=123a即可查询出完整的日志。

四、整合配置filebeat、kafka、logstash例子

我分了两部分,有些是部署在服务器上的jar,我就通过filebeat采集;有些是部署到本地笔记本上的服务,直接在logback.xml配置一个appender输出到kafka,不经过filebeat。

- java的pom引入依赖

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>6.6</version>

</dependency>

- 1

- 2

- 3

- 4

- 5

- logback-spring.xml文件配置输出格式(部分内容)

<appender name="fileUserLog" class="ch.qos.logback.core.rolling.RollingFileAppender"> <!-- 配置我们自己写的包的日志信息,目的是为了方便查看自己的类日志,此日志文件只有我们自己的的log --> <File>${logdir}/user.${appname}.${serverport}.${KPHOSTNAME}.log</File> <!--滚动策略,按照时间滚动 TimeBasedRollingPolicy--> <rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy"> <!--文件路径,定义了日志的切分方式——把每一天的日志归档到一个文件中,以防止日志填满整个磁盘空间--> <FileNamePattern>${logdir}/history/user.${appname}.${serverport}.%d{yyyy-MM-dd}.${KPHOSTNAME}.log</FileNamePattern> <!--只保留最近90天的日志--> <maxHistory>90</maxHistory> <!--用来指定日志文件的上限大小,那么到了这个值,就会删除旧的日志--> <totalSizeCap>1GB</totalSizeCap> </rollingPolicy> <!--日志输出编码格式化--> <encoder class="net.logstash.logback.encoder.LoggingEventCompositeJsonEncoder"> <providers> <pattern> <pattern> { "dateTime": "%d{yyyy-MM-dd HH:mm:ss.SSS}", "message": "%message", "stackTrace": "%exception", "level": "%level", "traceId": "%X{X-B3-TraceId:-}", "spanId": "%X{X-B3-SpanId:-}", "service": "${appname}", "thread": "%thread", "class": "%logger.%method[%line]" } </pattern> </pattern> <timestamp> <timeZone>GMT+8</timeZone> </timestamp> </providers> </encoder> </appender>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

logstash.conf

input { kafka{ bootstrap_servers => "ssx-kafka-dmsv.ssx:9092" client_id => "logstash_kafka_consumer_id" group_id => "logstash_kafka_consumer_group" auto_offset_reset => "latest" consumer_threads => 1 decorate_events => true topics => ["logstash"] } } filter { json { source => "message" } } output{ elasticsearch{ hosts => ["ssx-elk-dmsv.ssx:9200"] index => "logstash-%{+YYYY.MM.dd}" } }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

kibana

$ cat kibana.yml

server.host: "0.0.0.0"

server.shutdownTimeout: "5s"

elasticsearch.hosts: [ "http://localhost:9200" ]

monitoring.ui.container.elasticsearch.enabled: true

i18n.locale: "zh-CN"

$ cat node.options

--unhandled-rejections=warn

--dns-result-order=ipv4first

## enable OpenSSL 3 legacy provider

#--openssl-legacy-provider

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

filebeat.yml

filebeat.modules: filebeat.inputs: - type: log enabled: true paths: - /spring-boot-logs/*/user.*.log #include_lines: ["^ERR", "^WARN"] # 适用于日志中每一条日志占据多行的情况,比如各种语言的报错信息调用栈 multiline: pattern: '^[[:space:]]' negate: false match: after processors: - drop_fields: fields: ["metadata", "prospector", "offset", "beat", "source","type"] output.kafka: hosts: ["ssx-kafka-dmsv.ssx:9092"] topic: logstash codec.format: string: '%{[message]}'

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

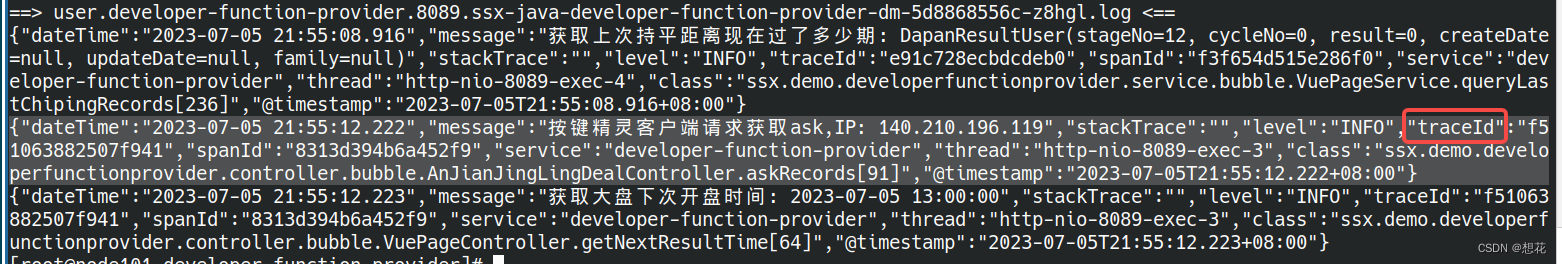

- 22

日志文件内容,我想看这个请求完整的流程

k8s的yaml

apiVersion: apps/v1 kind: Deployment metadata: name: ssx-elk-dmsv namespace: ssx spec: replicas: 1 selector: matchLabels: app: ssx-elk-dmsv template: metadata: labels: app: ssx-elk-dmsv spec: hostAliases: - ip: "192.168.0.101" hostnames: - "node101" - ip: "192.168.0.102" hostnames: - "node102" - ip: "192.168.0.103" hostnames: - "node103" - ip: "127.0.0.1" hostnames: - "elasticsearch" containers: - name: ssx-elasticsearch8-c image: docker.elastic.co/elasticsearch/elasticsearch:8.10.2 imagePullPolicy: IfNotPresent ports: - containerPort: 9200 env: #容器运行前需设置的环境变量列表 - name: discovery.type #环境变量名称 value: "single-node" #环境变量的值 这是mysqlroot的密码 因为是纯数字,需要添加双引号 不然编译报错 - name: xpack.security.enabled #禁用登录验证 value: "false" #环境变量的值 这是mysqlroot的密码 因为是纯数字,需要添加双引号 不然编译报错 - name: ES_JAVA_OPTS value: -Xms512m -Xmx512m volumeMounts: - mountPath: /usr/share/elasticsearch/data #这是mysql容器内保存数据的默认路径 name: c-v-path-elasticsearch8-data - mountPath: /usr/share/elasticsearch/logs #这是mysql容器内保存数据的默认路径 name: c-v-path-elasticsearch8-logs - mountPath: /usr/share/elasticsearch/.cache #这是mysql容器内保存数据的默认路径 name: c-v-path-elasticsearch8-cache - mountPath: /etc/localtime #时间同步 name: c-v-path-lt - name: ssx-kibana-c image: docker.elastic.co/kibana/kibana:8.10.2 imagePullPolicy: IfNotPresent ports: - containerPort: 5601 # 开启本容器的80端口可访问 volumeMounts: - mountPath: /usr/share/kibana/data #无用,我先看看那些挂载需要 name: c-v-path-kibana8-data - mountPath: /usr/share/kibana/config name: c-v-path-kibana8-config - mountPath: /etc/localtime #时间同步 name: c-v-path-lt - name: ssx-logstash-c image: docker.elastic.co/logstash/logstash:8.10.2 imagePullPolicy: IfNotPresent env: #容器运行前需设置的环境变量列表 - name: xpack.security.enabled #禁用登录验证 value: "false" #环境变量的值 这是mysqlroot的密码 因为是纯数字,需要添加双引号 不然编译报错 - name: LOG_LEVEL #禁用登录验证 value: "info" #环境变量的值 这是mysqlroot的密码 因为是纯数字,需要添加双引号 不然编译报错 - name: MONITORING_ENABLED #禁用登录验证 value: "false" #环境变量的值 这是mysqlroot的密码 因为是纯数字,需要添加双引号 不然编译报错 args: ["-f","/myconf/logstash.conf"] volumeMounts: - mountPath: /myconf #配置 name: c-v-path-logstash8-conf - mountPath: /usr/share/logstash/data #data name: c-v-path-logstash8-data - mountPath: /etc/localtime #时间同步 name: c-v-path-lt - name: ssx-filebeat-c image: docker.elastic.co/beats/filebeat:8.10.2 imagePullPolicy: IfNotPresent volumeMounts: - mountPath: /usr/share/filebeat/filebeat.yml #配置 name: c-v-path-filebeat8-conf - mountPath: /usr/share/filebeat/data #配置 name: c-v-path-filebeat8-data - mountPath: /spring-boot-logs #data name: c-v-path-filebeat8-spring-logs - mountPath: /etc/localtime #时间同步 name: c-v-path-lt volumes: - name: c-v-path-elasticsearch8-data #和上面保持一致 这是本地的文件路径,上面是容器内部的路径 hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/elasticsearch8/data #此路径需要实现创建 注意要给此路径授权777权限 不然pod访问不到 - name: c-v-path-elasticsearch8-logs #和上面保持一致 这是本地的文件路径,上面是容器内部的路径 hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/elasticsearch8/logs #此路径需要实现创建 注意要给此路径授权777权限 不然pod访问不到 - name: c-v-path-elasticsearch8-cache #和上面保持一致 这是本地的文件路径,上面是容器内部的路径 hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/elasticsearch8/.cache #此路径需要实现创建 注意要给此路径授权777权限 不然pod访问不到 - name: c-v-path-kibana8-data #和上面保持一致 这是本地的文件路径,上面是容器内部的路径 hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/kibana8/data #此路径需要实现创建 注意要给此路径授权777权限 不然pod访问不到 - name: c-v-path-kibana8-config #和上面保持一致 这是本地的文件路径,上面是容器内部的路径 hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/kibana8/config #此路径需要实现创建 注意要给此路径授权777权限 不然pod访问不到 - name: c-v-path-logstash8-conf hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/logstash8/myconf - name: c-v-path-logstash8-data hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/logstash8/data - name: c-v-path-lt hostPath: path: /etc/localtime #时间同步 - name: c-v-path-filebeat8-conf hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/filebeat8/myconf/filebeat.yml - name: c-v-path-filebeat8-data hostPath: path: /home/app/apps/k8s/for_docker_volume/elk/filebeat8/data - name: c-v-path-filebeat8-spring-logs hostPath: path: /home/ssx/appdata/ssx-log/docker-log nodeSelector: #把此pod部署到指定的node标签上 kubernetes.io/hostname: node101 --- apiVersion: v1 kind: Service metadata: name: ssx-elk-dmsv namespace: ssx spec: ports: - port: 9200 name: ssx-elk8-9200 protocol: TCP targetPort: 9200 - port: 5601 #我暂时不理解,这个设置 明明没用到? name: ssx-kibana8 protocol: TCP targetPort: 5601 # 容器nginx对外开放的端口 上面的dm已经指定了 selector: app: ssx-elk-dmsv type: ClusterIP

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

- 97

- 98

- 99

- 100

- 101

- 102

- 103

- 104

- 105

- 106

- 107

- 108

- 109

- 110

- 111

- 112

- 113

- 114

- 115

- 116

- 117

- 118

- 119

- 120

- 121

- 122

- 123

- 124

- 125

- 126

- 127

- 128

- 129

- 130

- 131

- 132

- 133

- 134

- 135

- 136

- 137

- 138

- 139

- 140

- 141

- 142

- 143

- 144

- 145

- 146

- 147

- 148