热门标签

热门文章

- 1虚拟存储器

- 2FL Studio All Plugins Edition2024中文完整版Win/Mac

- 3vscode:远程主机可能不符合 glibc 和 libstdc++ vs code 服务器的先决条件

- 4Shell编程语法_shell语法

- 5kubernetes之Pod控制器_k8s通过生成pod控制器

- 6Android Framework | AOSP源码下载及编译指南(基于Android13)_android 源码 下载

- 7Linux Shortcuts and Commands_bash: ./qt -openresource-linux -x64 5.12.6.run :ca

- 8Linux 多进程通信开发(七): unix domain socket 之 UDP 通信_domain socket 多进程

- 9Markdown(编辑器)工具与使用总结&Markdown语法图文全面详解_markdown编辑

- 1080端口穿透软件之nat123端口映射原理分析及使用方法_nat123原理

当前位置: article > 正文

GPT1、GPT2、GPT3原理_1gpt

作者:我家自动化 | 2024-02-25 00:28:20

赞

踩

1gpt

一 背景

GPT1:Generative Pre-Training。是一种生成式的预训练模型,由OpenAi团队发表自论文《Improving Language Understanding by Generative Pre-Training》。

h0=UWe+Wp

二 模型整体结构(宏观)

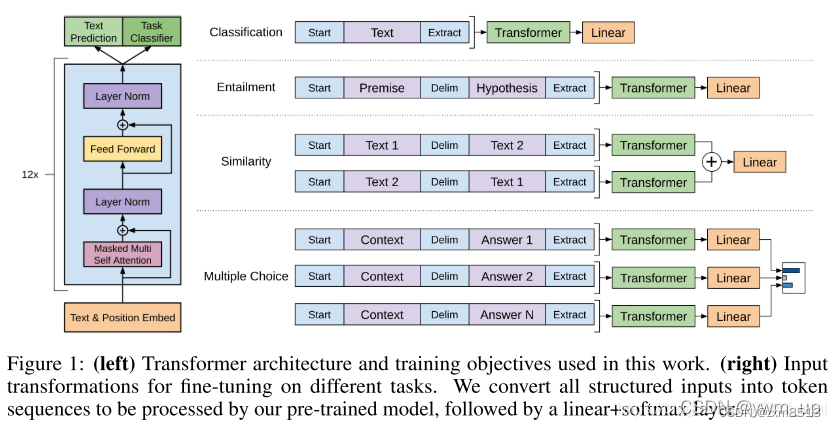

图1 GPT整体结构

左侧为模型的整体结构,由12个Transformer中的Decoder模块经修改后组成(Transformer本身是由6个Encoder和6个Decoder组成)。

三 模型细节(微观)

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/我家自动化/article/detail/137165

推荐阅读

相关标签