- 1kafka rebalance问题解决方案_kafka rebalance问题如何解决

- 2【服务器】Linux 安装 Jenkins+cpolar实现远程访问_linux将本地作为jenkins服务器,其他同网段ip可访问

- 3find: ‘/run/user/1000/gvfs’: Permission denied解决办法_find: ‘/run/user/1000/doc’: 权限不够 find: ‘/run/user/

- 4RabbitMQ-Queue_rabbitmq queues

- 5DATAX:MongoDB增量数据写入到mysql中_datax以增量导入数据

- 6MATLAB算法实战应用案例精讲-【图像处理】小目标检测(附matlab代码实现)_matlab 图像梯度小目标检测

- 7VSCode中找不到UnityEngine.UI命名空间_using unityengine.ui;找不到

- 8IT行业有哪些证书含金量高?

- 9Vue 预览word,excel,ppt等office文档-内网访问(基于onlyoffice,后端返回文件流)_onlyoffice 后端token

- 10为什么大多数TCP服务器采用多线程,以及如何从头开始构建一个多线程的TCP服务器

【深度学习】YOLOv5 工程落地部署过程,MNN转化,使用细节_yolo部署

赞

踩

概述

兜兜转转又回到YOLOv5,YOLOv5的项目代码太易用了,开箱即用,工具多,效果好,谁能不爱呢。我这里对我使用YOLOv5 做简单的记录,以后自己看到能很快用起来就是本篇文章的目的,这篇文章我一直要干到MNN部署方式去。

目标检测模型概述

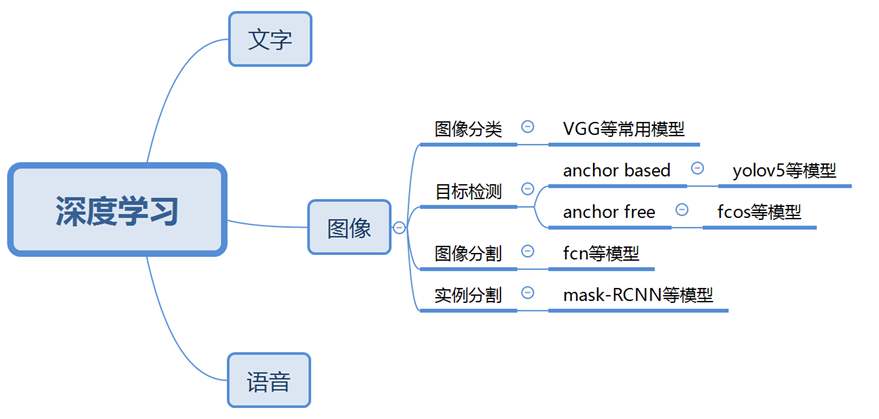

深度学习模型由于其拥有足够的表达能力,能够很好表达从输入数据到输出数据的映射关系,被广泛应用于各类场景中。图1中展现了深度学习模型在文字、图像、语音中的应用场景,其中图像是我个人最熟悉的,也是日常业务中最常遇到的场景。

图像领域有四个主要任务:图像分类、目标检测、图像分割、实例分割。

在目标分割领域中,基本可以分为anchor based方法和anchor free方法,yolov5这个算法模型是anchor based方法,同时也是集大成者,包含目前目标检测领域中所有的比较有效的方法(FPN、PAN、SPP、CSP等),目前仍就是目标检测领域中最为优秀的算法之一。目前学术界的研究在目标检测领域主要分为两个方向,一是使用anchor free方法的模型(学术界普遍认为此种方法更加符合目标检测的原始动机,不带有那么高的监督性),二是使用 NLP领域的一些新模型(比如Transformer、多模态的一些研究)。

就目前学术研究情况(靠学术前沿论坛获知)和各大公司所采用模型情况来看,yolov5依旧是一个值得长期选择和持有的模型。

使用COCO2017体验YOLOv5

在最新版本的yolov5中,只需要python train.py即可开始训练coco128,非常智能。

其实可以用COCO128体验,过程与下面类似,我这里用COCO2017因为我已经下载过了。

下载项目和权重

项目代码:https://github.com/ultralytics/yolov5

字模:https://github.com/ultralytics/yolov5/releases/download/v1.0/Arial.ttf

权重:https://github.com/ultralytics/yolov5/releases

或者直接全部用网盘下载:链接:https://pan.baidu.com/s/1q8WOj-aJgn3p2UhbXVFPtQ?pwd=v3e9

下载处理COCO2017数据

https://github.com/ultralytics/yolov5中yolov5/data/scripts中get_coco.sh脚本就是下载COCO2017数据集的,四个压缩包,coco2017labels.zip是处理过的符合COCO的数据,train2017.zip、val2017.zip、test2017.zip是图片数据。原代码中含有解压的一些操作,下面的代码删除了解压的操作:

#!/bin/bash

# YOLOv5 声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/我家自动化/article/detail/149513?siteCopyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。