- 1随身Wi-Fi刷入debian_随身wifi刷debian

- 2鸿蒙ArkUI实例:【自定义组件】

- 3云原生数据库特征

- 4别再畏惧写作了!这9款AI写作工具让你轻松驾驭文字创作 #科技#其他#知识分享

- 5Spring Boot通过@RequestParam接收前端表单传来的数据_springboot接收表单数据

- 6论文精讲 | CVPR 2022|RHFL-对抗噪声的联邦学习_fedproto: federated prototype learning across hete

- 7SOLIDWORKS® 2024 新功能 - 3D CAD

- 8Windows下运行.sh文件,可在git bash中运行,也可在cmd、pycharm 终端中运行。.sh文件中指定虚拟环境。_windows执行sh文件

- 9全面解读AI框架RAG

- 10【数据结构】什么是算法_数据结构的算法定义

VGG网络与Alex_vgg,alex

赞

踩

VGG网络

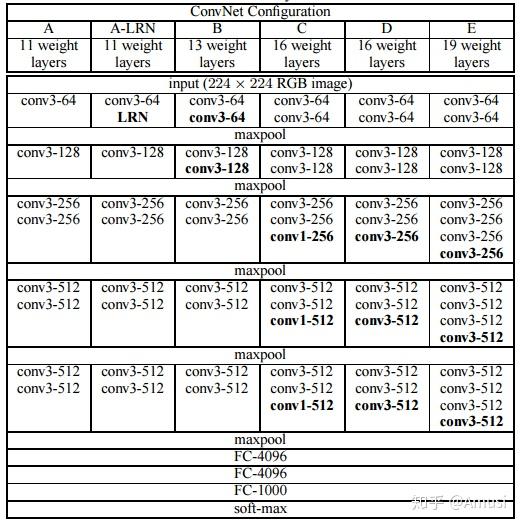

Oxford的Visual Geometry Group的组提出了VGG网络。该网络证明了增加网络的深度能够在一定程度上影响网络最终的性能。VGG有两种结构,分别是VGG16和VGG19,没有本质上的区别,只是单纯的网络深度不一样。

VGG网络的原理

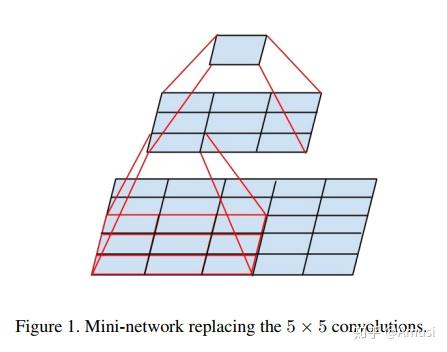

在VGG中,使用了3个3x3卷积核来代替7x7卷积核,使用了2个3x3卷积核来代替5*5卷积核,这样做的主要目的是在保证具有相同感知野的条件下,提升了网络的深度,在一定程度上提升了神经网络的效果。

比如,3个步长为1的3x3卷积核的一层层叠加作用可看成一个大小为7的感受野(其实就表示3个3x3连续卷积相当于一个7x7卷积),其参数总量为 3x(9xC^2) ,如果直接使用7x7卷积核,其参数总量为 49xC^2 ,这里 C 指的是输入和输出的通道数。很明显,27xC^2小于49xC^2,即减少了参数;而且3x3卷积核有利于更好地保持图像性质。

5x5卷积看做一个小的全连接网络在5x5区域滑动,我们可以先用一个3x3的卷积滤波器卷积,然后再用一个全连接层连接这个3x3卷积输出,这个全连接层我们也可以看做一个3x3卷积层。这样我们就可以用两个3x3卷积级联(叠加)起来代替一个 5x5卷积。

网络结构

VGG16包含了16个隐藏层(13个卷积层和3个全连接层),如上图中的D列所示;VGG19包含了19个隐藏层(16个卷积层和3个全连接层),如上图中的E列所示。

VGG优点

- VGGNet的结构非常简洁,整个网络都使用了同样大小的卷积核尺寸(3x3)和最大池化尺寸(2x2)。

- 几个小滤波器(3x3)卷积层的组合比一个大滤波器(5x5或7x7)卷积层好:

- 验证了通过不断加深网络结构可以提升性能。

VGG缺点

- VGG耗费更多计算资源,并且使用了更多的参数(这里不是3x3卷积的锅),导致更多的内存占用(140M)。其中绝大多数的参数都是来自于第一个全连接层。VGG可是有3个全连接层啊!

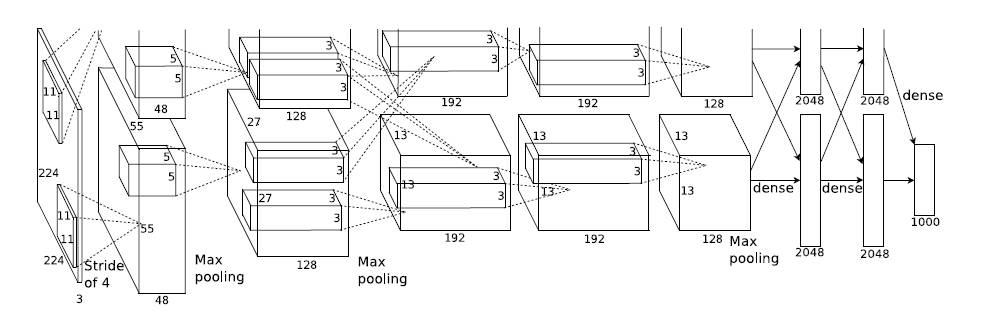

Alexnet

模型结构只有寥寥八层,但是它有60M以上的参数总量,事实上在参数量上比后面的网络都大。

这个图卷积部分都是画成上下两块,是说这一层计算出来的feature map分开,但是前一层用到的数据要看连接的虚线,如图中input层之后的第一层第二层之间的虚线是分开的,是说二层上面的128map是由一层上面的48map计算的,下面同理;而第三层前面的虚线是完全交叉的,就是说每一个192map都是由前面的128+128=256map同时计算得到的。

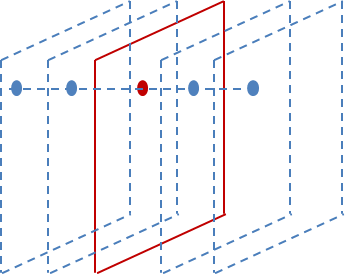

Alexnet有一个特殊的计算层,LRN层,做的事是对当前层的输出结果做平滑处理。下面是我画的示意图:

前后几层(对应位置的点)对中间这一层做一下平滑约束,计算方法是: