- 1chatGPT看图写小作文

- 2建模实训报告总结_模型实训的心得体会

- 3Python实现VMware自动化资源巡检

- 4开始支持鸿蒙系统的设备,速来围观:华为鸿蒙操作系统2.0支持的设备清单流出...

- 5python学生管理系统(pyqt5 含界面)_学生管理系统pyqt5

- 6零基础实战部署云服务器项目-服务器部署(window server2012)_vs2013服务器配置要求

- 7Android studio制作简单计算器apk文件_android 自制计算器

- 8C语言 二维数组与字符型数组_c语言字符型二维数组

- 9Android Studio : Read timed out和connect timed out的解决方法_安卓connect timed out

- 10vue3.2 element-plus el-tree添加结构线/引导线_element-tree-line

【YOLO v5 v7 v8 v9小目标改进】辅助超推理SAHI:分而治之,解决高分辨率图像中小物体检测的问题_yolov7 sahi

赞

踩

论文:https://arxiv.org/pdf/2202.06934.pdf

代码:https://github.com/obss/sahi

设计思路

用一个超高清的相机拍摄一片风景,而你想在这张大照片里找到一些非常小的物体,比如远处的小鸟或花朵。

因为这些物体在整张照片中占的比例非常小,所以直接找它们会很困难,而且需要非常强大的算力。

你有一张大拼图,它由成百上千的小拼图块组成。

如果你试图一次性理解整张图的内容可能会感到困难和压力,特别是如果这张图非常复杂,细节丰富。

但是,如果你将拼图分成几个部分,一块一块地完成,每一块拼好之后再把所有的小块合并起来,最终得到的将是一幅完整的图画。

这种方法不仅使任务变得更加管理和操作上可行,而且每完成一小块就能带来成就感,激励你继续前进。

在科学和工程领域,这种思路同样适用。

例如,在计算机科学中,大型软件项目往往会被分解为多个小模块或组件,每个部分由不同的团队独立开发。

只有当这些独立开发的模块都完成并通过测试后,它们才会被集成在一起,形成完整的软件系统。

这样做的优点包括提高了开发效率,降低了错误和问题的复杂性,使得更容易定位和修复问题。

我们提出了一个办法来解决这个问题:

-

把大照片切成小块:就像用剪刀把一张大照片切成很多小片一样。这样,每个小块里的小物体相对于这个小块就变得更大了,更容易被找到。

-

在每个小块上做“练习”:我们有一些事先训练好的模型,它们擅长找东西,但主要是在比较小的图片中找。我们用这些模型在每个小块上找我们想要的小物体。

-

再把找到的东西放回原位:当我们在所有小块中都找完后,就把找到的小物体的位置标记起来,再放回到原来的大照片中相应的位置。

这样做的好处是,我们既没有错过任何小物体,又没有需要非常强大的计算力去一次性处理整张大照片。

这个方法可以用在任何需要找小物体的场景中,比如用监控摄像头监视一片区域,或者用无人机拍摄的大面积地图上寻找特定的小目标。

为了解决高分辨率图像中小物体检测的问题,我们提出了一个基于切片的通用框架,在模型的微调和推理阶段使用。

结构

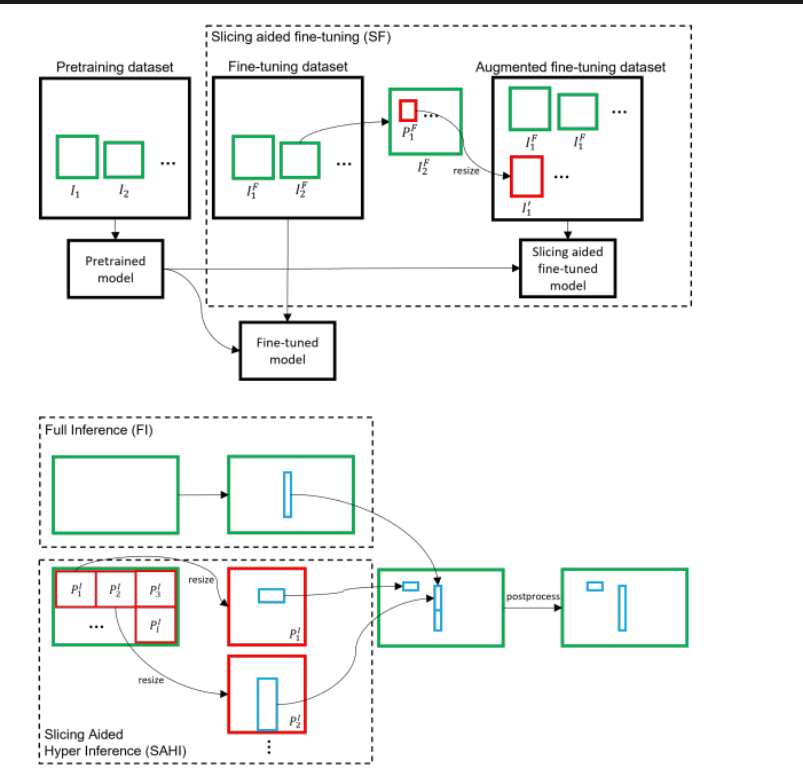

这张图是一幅流程图,展示了基于切片的模型微调(Slicing Aided Fine-tuning, SF)和基于切片的高效推理(Slicing Aided Hyper Inference, SAHI)两种方法。

流程图的上半部分(Slicing Aided Fine-tuning, SF)说明了以下步骤:

- 从预训练数据集中,选取图片(例如 I F 1 I_{F1} IF1 和 I F 2 I_{F2} IF2)进行微调。

- 图片被切割成较小的重叠片段或补丁(例如 P F 1 P_{F1} PF1 和 P F 2 P_{F2} PF2),然后这些片段被调整大小到一个更大的尺寸。

- 这些增强后的图片片段(例如 I 0 ′ I'_{0} I0′)被用于微调预训练好的模型,生成了微调后的模型。

流程图的下半部分(Slicing Aided Hyper Inference, SAHI)描述了推理阶段的以下步骤:

- 原始查询图像(例如 ( I ))被切割成多个重叠的小片段(例如 P I 1 P_{I1} PI1 到 P I l P_{Il} PIl)。

- 每个小片段大小调整后,单独进行物体检测推理,并生成预测。

- 接着,所有小片段的预测结果通过非极大值抑制(NMS)转换回原始图像的坐标尺度。

- 可选地,可以加入从原始图像的全尺寸推理中得到的预测结果。

这个框架包含以下两个主要部分:

-

切片辅助微调 (SF):使用流行的物体检测框架(如Detectron2、MMDetection和YOLOv5)的预训练权重,我们通过将高分辨率图像切割成重叠的小块(称为切片)来增强数据集。

这些切片相对于原图中的小物体具有更大的像素面积,使得小物体在网络训练时变得更明显,从而提高了模型对小物体的检测性能。

- 子特征:选择切片尺寸作为超参数,然后在微调过程中将切片调整大小以保持宽度在800到1333像素之间,从而相对于原始图像扩大了物体的相对尺寸。

之所以采用这种方法,是因为预训练的模型通常在低分辨率图像上表现良好,但对高分辨率图像中的小物体检测效果不佳。 -

切片辅助高效推理 (SAHI):在推理步骤中,也采用了切片方法。

首先,将原始查询图像切割成多个重叠的M×N尺寸的切片,每个切片在保持宽高比的情况下调整大小。

然后,独立地对每个切片进行物体检测推理。

此外,可以选择使用原始图像进行完整推理以检测较大的物体。

最后,将所有重叠切片的检测结果(如果使用了完整推理,还包括完整推理的结果)通过非极大抑制(NMS)合并回原始图像大小。

在NMS过程中,删除那些IoU比预定义匹配阈值低的检测框。

- 子特征:通过这种方法,可以优化小物体的检测效率和准确性,同时保留了对大物体检测的能力。

之所以使用切片辅助推理,是因为直接对高分辨率图像进行全图推理对于小物体而言效果不佳,而且计算成本高。

- 子特征:通过这种方法,可以优化小物体的检测效率和准确性,同时保留了对大物体检测的能力。

小目标涨点

更新中…