热门标签

热门文章

- 1Proteus8 交流220V电压源的两种设置方法_proteus交流电压源

- 2上弦外媒新闻发稿:2024年度国外主流新闻媒体和海外媒体软文分发平台有哪些?

- 3实验三 关系代数_关系代数至少选修两门课

- 4图像分类实战:mobilenetv2从训练到TensorRT部署(pytorch)_mobilenetv2训练

- 5AI人工智能 Agent:在智能医疗中的应用

- 6美团内推面试记录_美团内推挂掉内推人知道吗

- 7《自然语言处理简明教程》读书笔记:第十四章 文本数据挖掘_tdm数据与文本挖掘

- 8终端make命令和Git学习

- 9Can‘t find third_party/gtest. Run git submodule update --init, or disable with CMake -DBUILD_TEST

- 10mac pro M1/M2/M3(ARM)安装:VMWare Fusion及linux(centos7/ubuntu)(一)_centos-7-aarch64-08191738

当前位置: article > 正文

鸢尾花数据集分类

作者:我家自动化 | 2024-06-07 17:53:49

赞

踩

鸢尾花数据集

数据集介绍 共有数据150组,每组包括花萼长、花萼宽、花瓣长、花瓣宽4个输入特征。 同时给出了,这一组特征对应的鸢尾花类别。类别包括Setosa Iris(狗尾草 鸢尾),Versicolour Iris(杂色鸢尾),Virginica Iris(弗吉尼亚鸢尾)三 类,分别用数字0,1,2表示。

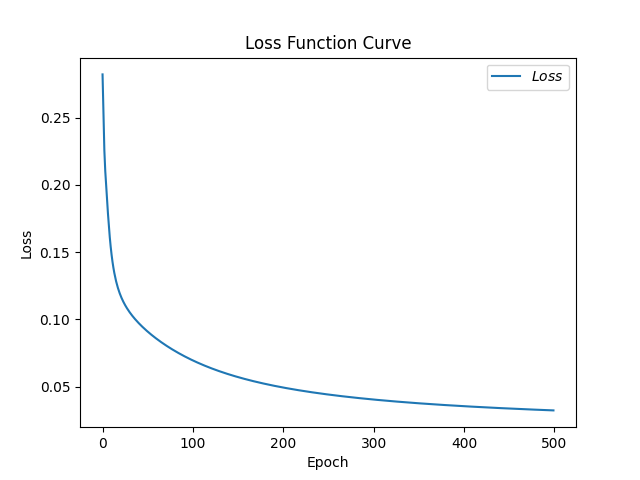

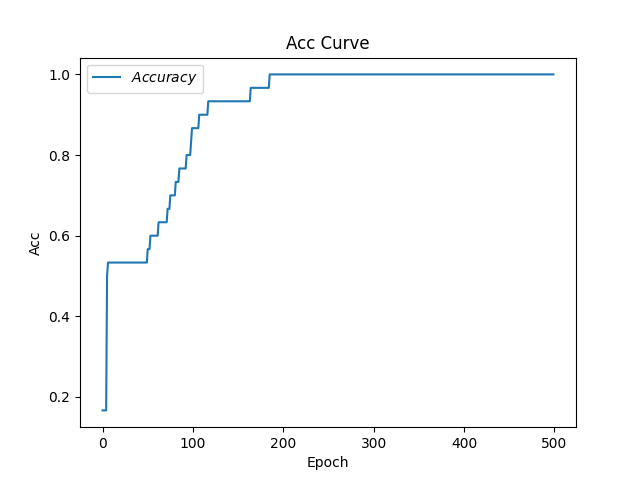

手动实现前向传播、反向传播,可视化loss曲线

可视化整个训练过程,对应于理论学习的步骤

- # -*- coding: UTF-8 -*-

- # 利用鸢尾花数据集,实现前向传播、反向传播,可视化loss曲线

-

- # 导入所需模块

- import tensorflow as tf

- from sklearn import datasets

- from matplotlib import pyplot as plt

- import numpy as np

-

- # 导入数据,分别为输入特征和标签

- x_data = datasets.load_iris().data

- y_data = datasets.load_iris().target

-

- # 随机打乱数据(因为原始数据是顺序的,顺序不打乱会影响准确率)

- # seed: 随机数种子,是一个整数,当设置之后,每次生成的随机数都一样(为方便教学,以保每位同学结果一致)

- np.random.seed(116) # 使用相同的seed,保证输入特征和标签一一对应

- np.random.shuffle(x_data)

- np.random.seed(116)

- np.random.shuffle(y_data)

- tf.random.set_seed(116)

-

- # 将打乱后的数据集分割为训练集和测试集,训练集为前120行,测试集为后30行

- x_train = x_data[:-30]

- y_train = y_data[:-30]

- x_test = x_data[-30:]

- y_test = y_data[-30:]

-

- # 转换x的数据类型,否则后面矩阵相乘时会因数据类型不一致报错

- x_train = tf.cast(x_train, tf.float32)

- x_test = tf.cast(x_test, tf.float32)

-

- # from_tensor_slices函数使输入特征和标签值一一对应。(把数据集分批次,每个批次batch组数据)

- train_db = tf.data.Dataset.from_tensor_slices((x_train, y_train)).batch(32) # 120/32+1 = 4,分为4个批次

- test_db = tf.data.Dataset.from_tensor_slices((x_test, y_test)).batch(32)

- # print(list(train_db.as_numpy_iterator()))

-

- # 生成神经网络的参数,4个输入特征故,输入层为4个输入节点;因为3分类,故输出层为3个神经元

- # 用tf.Variable()标记参数可训练

- # 使用seed使每次生成的随机数相同(方便教学,使大家结果都一致,在现实使用时不写seed)

- w1 = tf.Variable(tf.random.truncated_normal([4, 3], stddev=0.1, seed=1))

- b1 = tf.Variable(tf.random.truncated_normal([3], stddev=0.1, seed=1))

-

- lr = 0.1 # 学习率为0.1

- train_loss_results = [] # 将每轮的loss记录在此列表中,为后续画loss曲线提供数据

- test_acc = [] # 将每轮的acc记录在此列表中,为后续画acc曲线提供数据

- epoch = 500 # 循环500轮

- loss_all = 0 # 每轮分4个step,loss_all记录四个step生成的4个loss的和

-

- # 训练部分

- for epoch in range(epoch): #数据集级别的循环,每个epoch循环一次数据集

- for step, (x_train, y_train) in enumerate(train_db): #batch级别的循环 ,每个step循环一个batch

- with tf.GradientTape() as tape: # with结构记录梯度信息

- y = tf.matmul(x_train, w1) + b1 # 神经网络乘加运算

- y = tf.nn.softmax(y) # 使输出y符合概率分布(此操作后与独热码同量级,可相减求loss)

- y_ = tf.one_hot(y_train, depth=3) # 将标签值转换为独热码格式,方便计算loss和accuracy

- loss = tf.reduce_mean(tf.square(y_ - y)) # 采用均方误差损失函数mse = mean(sum(y-out)^2)

- loss_all += loss.numpy() # 将每个step计算出的loss累加,为后续求loss平均值提供数据,这样计算的loss更准确

- # 计算loss对各个参数的梯度

- grads = tape.gradient(loss, [w1, b1])

-

- # 实现梯度更新 w1 = w1 - lr * w1_grad b = b - lr * b_grad

- w1.assign_sub(lr * grads[0]) # 参数w1自更新

- b1.assign_sub(lr * grads[1]) # 参数b自更新

-

- # 每个epoch,打印loss信息

- print("w1:", w1)

- print("b1:", b1)

- print("Epoch {}, loss: {}".format(epoch, loss_all/4))

- train_loss_results.append(loss_all / 4) # 将4个step的loss求平均记录在此变量中?

- loss_all = 0 # loss_all归零,为记录下一个epoch的loss做准备

-

- # 测试部分

- # total_correct为预测对的样本个数, total_number为测试的总样本数,将这两个变量都初始化为0

- total_correct, total_number = 0, 0

- for x_test, y_test in test_db:

- # 使用更新后的参数进行预测

- y = tf.matmul(x_test, w1) + b1

- y = tf.nn.softmax(y)

- pred = tf.argmax(y, axis=1) # 返回y中最大值的索引,即预测的分类

- # 将pred转换为y_test的数据类型

- pred = tf.cast(pred, dtype=y_test.dtype)

- # 若分类正确,则correct=1,否则为0,将bool型的结果转换为int型

- correct = tf.cast(tf.equal(pred, y_test), dtype=tf.int32)

- # 将每个batch的correct数加起来

- correct = tf.reduce_sum(correct)

- # 将所有batch中的correct数加起来

- total_correct += int(correct)

- # total_number为测试的总样本数,也就是x_test的行数,shape[0]返回变量的行数

- total_number += x_test.shape[0]

- # 总的准确率等于total_correct/total_number

- acc = total_correct / total_number

- test_acc.append(acc)

- print("Test_acc:", acc)

- print("--------------------------")

-

- # 绘制 loss 曲线

- plt.title('Loss Function Curve') # 图片标题

- plt.xlabel('Epoch') # x轴变量名称

- plt.ylabel('Loss') # y轴变量名称

- plt.plot(train_loss_results, label="$Loss$") # 逐点画出trian_loss_results值并连线,连线图标是Loss

- plt.legend() # 画出曲线图标

- plt.show() # 画出图像

-

- # 绘制 Accuracy 曲线

- plt.title('Acc Curve') # 图片标题

- plt.xlabel('Epoch') # x轴变量名称

- plt.ylabel('Acc') # y轴变量名称

- plt.plot(test_acc, label="$Accuracy$") # 逐点画出test_acc值并连线,连线图标是Accuracy

- plt.legend()

- plt.show()

-

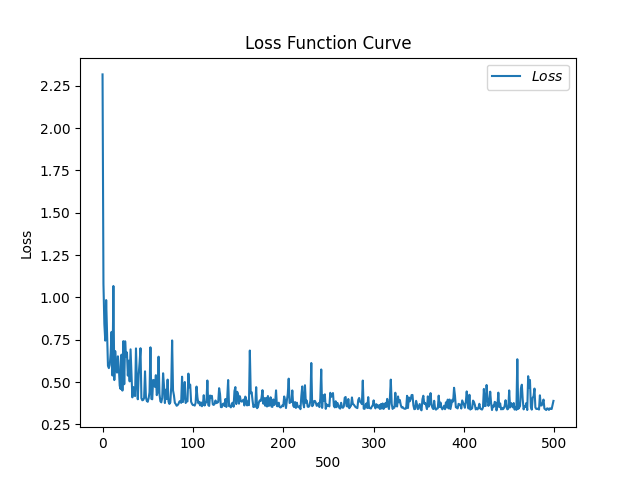

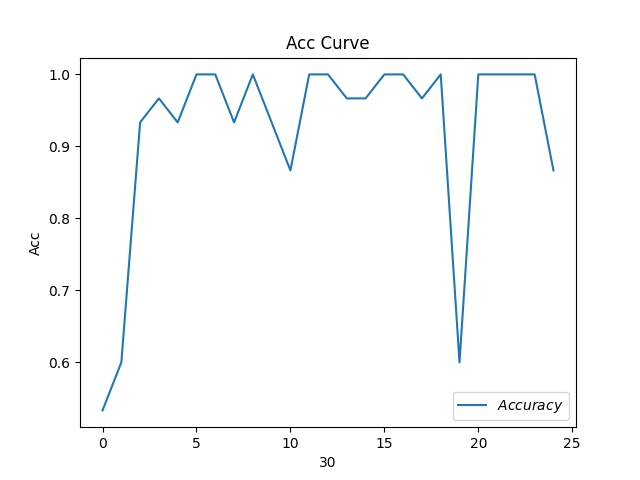

利用sklearn封装的函数进行训练

- import tensorflow as tf

- from sklearn import datasets

- import numpy as np

-

- x_train = datasets.load_iris().data

- y_train = datasets.load_iris().target

-

- np.random.seed(116)

- np.random.shuffle(x_train)

- np.random.seed(116)

- np.random.shuffle(y_train)

- tf.random.set_seed(116)

-

- model = tf.keras.models.Sequential([

- tf.keras.layers.Dense(3, activation='softmax', kernel_regularizer=tf.keras.regularizers.l2())

- ])

-

- model.compile(optimizer=tf.keras.optimizers.SGD(lr=0.1),

- loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=False),

- metrics=['sparse_categorical_accuracy'])

-

- model.fit(x_train, y_train, batch_size=32, epochs=500, validation_split=0.2, validation_freq=20)

-

- model.summary()

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/我家自动化/article/detail/686459

推荐阅读

相关标签