- 1一文全面了解word2vec(CBOW、Skip-Gram、层序softmax、负采样)_层序softmax应用连续词袋

- 2<Rust><iced>在iced中显示gif动态图片的一种方法

- 3Python 利用pickle库查看pkl文件实例演示,pkl是什么类型的文件?怎么来打开它?_pkl文件怎么打开

- 4pg 出现视图依赖表,导致字段不能修改_cannot alter type of a column used by a view or ru

- 5基于Java+MySQL+Tomcat+maven+JavaScript+Servlet的个人博客系统_java写博客

- 6Mac M1 安装 iTerm2+Oh My Zsh+zsh-syntax-highlighting 真香!_mac m1配置iterm2

- 7PyTorch实现DCGAN(生成对抗网络)生成新的假名人照片实战(附源码和数据集)_pytorch生成一个假脸模型

- 8AI开源概览及工具使用_开源ai

- 9nodejs中的require,exports使用说明

- 10Redis持久化之RDB_redis-server.exe!rdbsavelzfstringobject

【秋招】最全算法岗面试,吃透offer拿到手软!_算法岗面试代码

赞

踩

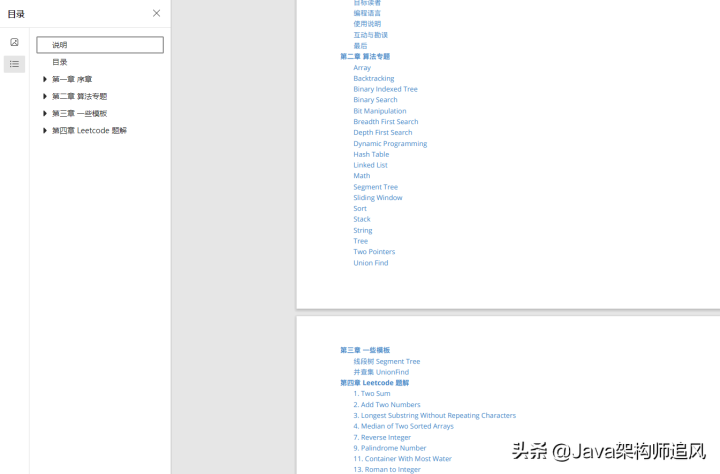

算法是比较复杂又基础的学科,每个学编程的人都会学习大量的算法。而根据统计,以下这28个问题是面试中最容易遇到的,本文给出了一些基本答案,供算法方向工程师或对此感兴趣的程序员参考。

除了文章提到的这些题目之外我还整理了很多LeetCode上面的算法题以及刷题笔记

转发本文+关注+查看评论区获取方式!!

编辑切换为居中

添加图片注释,不超过 140 字(可选)

编辑切换为居中

添加图片注释,不超过 140 字(可选)

LSTM是循环神经网络RNN的变种,包含三个门,分别是输入门,遗忘门和输出门。

LSTM 与 GRU区别

(1)LSTM和GRU的性能在很多任务上不分伯仲;

(2)GRU参数更少,因此更容易收敛,但是在大数据集的情况下,LSTM性能表现更好;

(3)GRU 只有两个门(update和reset),LSTM 有三个门(forget,input,output),GRU 直接将hidden state 传给下一个单元,而 LSTM 用memory cell 把hidden state 包装起来。

Transformer的原理

Transformer本身是一个典型的encoder-decoder模型,Encoder端和Decoder端均有6个Block,Encoder端的Block包括两个模块,多头self-attention模块以及一个前馈神经网络模块;Decoder端的Block包括三个模块,多头self-attention模块,多头Encoder-Decoder attention交互模块,以及一个前馈神经网络模块;需要注意:Encoder端和Decoder端中的每个模块都有残差层和Layer Normalization层。

Transformer的计算公式,K,Q,V怎么算

\text { Attention }(Q, K, V)=\operatorname{softmax}\left(\frac{Q K^{T}}{\sqrt{d_{k}}}\right) V

Q、K、V分别是输入X线性变换得到的。

Transformer为