- 1【前端Vue3】——JQuery知识点总结(超详细)_在vue3 中使用jquery

- 2Spark数据倾斜的七种解决方案(全)_spark数据倾斜的解决方案

- 3GPT-4o vs GPT-4:免费的比收费的更强?不科学啊!OpenAI旗舰模型全面评测_openai 4o比4turbo的劣势

- 4Git切换用户常用命令,绝了_git 更换用户

- 5基于大数据的城市活跃度研究

- 6AI2.0时代如何快速落地AI智能应用开发,抓住时代机会_阅读以上材料,谈谈你打算如何迎接变化,抓住不变来拥抱ai时代的道理。

- 7SAM(segment anything)模型本地部署_sam部署

- 8Mendix UI页面布局以案说法_mendix 弹窗

- 9大数据解决之道 ——动态数据库方案V1.0

- 10InSAR技术与北斗高精度定位技术在输电线路安全监测中的应用_insar卫星数据北斗

Paddlenlp之UIE模型实战实体抽取任务【打车数据、快递单】_uie模型的训练数据集

赞

踩

0.背景介绍

本项目将演示如何通过小样本样本进行模型微调,快速且准确抽取快递单中的目的地、出发地、时间、打车费用等内容,形成结构化信息。辅助物流行业从业者进行有效信息的提取,从而降低客户填单的成本。

数据集情况:

waybill.jsonl文件是快递单信息数据集:

{“id”: 57, “text”: “昌胜远黑龙江省哈尔滨市南岗区宽桥街28号18618391296”, “relations”: [], “entities”: {“id”: 111, “start_offset”: 0, “end_offset”: 3, “label”: “姓名”}, {“id”: 112, “start_offset”: 3, “end_offset”: 7, “label”: “省份”}, {“id”: 113, “start_offset”: 7, “end_offset”: 11, “label”: “城市”}, {“id”: 114, “start_offset”: 11, “end_offset”: 14, “label”: “县区”}, {“id”: 115, “start_offset”: 14, “end_offset”: 20, “label”: “详细地址”}, {“id”: 116, “start_offset”: 20, “end_offset”: 31, “label”: “电话”}}

{“id”: 58, “text”: “易颖18500308469山东省烟台市莱阳市富水南路1号”, “relations”: [], “entities”: {“id”: 118, “start_offset”: 0, “end_offset”: 2, “label”: “姓名”}, {“id”: 119, “start_offset”: 2, “end_offset”: 13, “label”: “电话”}, {“id”: 120, “start_offset”: 13, “end_offset”: 16, “label”: “省份”}, {“id”: 121, “start_offset”: 16, “end_offset”: 19, “label”: “城市”}, {“id”: 122, “start_offset”: 19, “end_offset”: 22, “label”: “县区”}, {“id”: 123, “start_offset”: 22, “end_offset”: 28, “label”: “详细地址”}}

doccano_ext.jsonl是打车数据集:

{“id”: 1, “text”: “昨天晚上十点加班打车回家58元”, “relations”: [], “entities”: {“id”: 0, “start_offset”: 0, “end_offset”: 6, “label”: “时间”}, {“id”: 1, “start_offset”: 11, “end_offset”: 12, “label”: “目的地”}, {“id”: 2, “start_offset”: 12, “end_offset”: 14, “label”: “费用”}}

{“id”: 2, “text”: “三月三号早上12点46加班,到公司54”, “relations”: [], “entities”: {“id”: 3, “start_offset”: 0, “end_offset”: 11, “label”: “时间”}, {“id”: 4, “start_offset”: 15, “end_offset”: 17, “label”: “目的地”}, {“id”: 5, “start_offset”: 17, “end_offset”: 19, “label”: “费用”}}

{“id”: 3, “text”: “8月31号十一点零四工作加班五十块钱”, “relations”: [], “entities”: {“id”: 6, “start_offset”: 0, “end_offset”: 10, “label”: “时间”}, {“id”: 7, “start_offset”: 14, “end_offset”: 16, “label”: “费用”}}

{“id”: 4, “text”: “5月17号晚上10点35分加班打车回家,36块五”, “relations”: [], “entities”: {“id”: 8, “start_offset”: 0, “end_offset”: 13, “label”: “时间”}, {“id”: 1, “start_offset”: 18, “end_offset”: 19, “label”: “目的地”}, {“id”: 9, “start_offset”: 20, “end_offset”: 24, “label”: “费用”}}

{“id”: 5, “text”: “2009年1月份通讯费一百元”, “relations”: [], “entities”: {“id”: 10, “start_offset”: 0, “end_offset”: 7, “label”: “时间”}, {“id”: 11, “start_offset”: 11, “end_offset”: 13, “label”: “费用”}}

结果展示预览

输入:

代码语言:txt

复制

城市内交通费7月5日金额114广州至佛山

从百度大厦到龙泽苑东区打车费二十元

上海虹桥高铁到杭州时间是9月24日费用是73元

上周末坐动车从北京到上海花费五十块五毛

昨天北京飞上海话费一百元

- 1

- 2

- 3

- 4

- 5

输出:

代码语言:txt

复制

{"出发地": [{"text": "广州", "start": 15, "end": 17, "probability": 0.9073772252165782}], "目的地": [{"text": "佛山", "start": 18, "end": 20, "probability": 0.9927365183877761}], "时间": [{"text": "7月5日", "start": 6, "end": 10, "probability": 0.9978010396512218}]}

{"出发地": [{"text": "百度大厦", "start": 1, "end": 5, "probability": 0.968825147409472}], "目的地": [{"text": "龙泽苑东区", "start": 6, "end": 11, "probability": 0.9877913072493669}]}

{"目的地": [{"text": "杭州", "start": 7, "end": 9, "probability": 0.9929172180094881}], "时间": [{"text": "9月24日", "start": 12, "end": 17, "probability": 0.9953342057701597}]}

{#"出发地": [{"text": "北京", "start": 7, "end": 9, "probability": 0.973048366717471}], "目的地": [{"text": "上海", "start": 10, "end": 12, "probability": 0.988486130309397}], "时间": [{"text": "上周末", "start": 0, "end": 3, "probability": 0.9977407699595275}]}

{"出发地": [{"text": "北京", "start": 2, "end": 4, "probability": 0.974188953533556}], "目的地": [{"text": "上海", "start": 5, "end": 7, "probability": 0.9928200521486445}], "时间": [{"text": "昨天", "start": 0, "end": 2, "probability": 0.9731559534465504}]}

- 1

- 2

- 3

- 4

- 5

1.数据集加载(快递单数据、打车数据)

doccano_file: 从doccano导出的数据标注文件。

save_dir: 训练数据的保存目录,默认存储在data目录下。

negative_ratio: 最大负例比例,该参数只对抽取类型任务有效,适当构造负例可提升模型效果。负例数量和实际的标签数量有关,最大负例数量 = negative_ratio * 正例数量。该参数只对训练集有效,默认为5。为了保证评估指标的准确性,验证集和测试集默认构造全负例。

splits: 划分数据集时训练集、验证集所占的比例。默认为0.8, 0.1, 0.1表示按照8:1:1的比例将数据划分为训练集、验证集和测试集。

task_type: 选择任务类型,可选有抽取和分类两种类型的任务。

options: 指定分类任务的类别标签,该参数只对分类类型任务有效。默认为"正向", “负向”。

prompt_prefix: 声明分类任务的prompt前缀信息,该参数只对分类类型任务有效。默认为"情感倾向"。

is_shuffle: 是否对数据集进行随机打散,默认为True。

seed: 随机种子,默认为1000.

*separator: 实体类别/评价维度与分类标签的分隔符,该参数只对实体/评价维度级分类任务有效。默认为"##"。

代码语言:python

复制

!python doccano.py \

--doccano_file ./data/doccano_ext.jsonl \

--task_type 'ext' \

--save_dir ./data \

--splits 0.8 0.1 0.1 \

--negative_ratio 5

- 1

- 2

- 3

- 4

- 5

- 6

代码语言:python

复制

[2022-07-14 11:34:26,474] [ INFO] - Converting doccano data... 100%|████████████████████████████████████████| 40/40 [00:00<00:00, 42560.16it/s] [2022-07-14 11:34:26,477] [ INFO] - Adding negative samples for first stage prompt... 100%|███████████████████████████████████████| 40/40 [00:00<00:00, 161009.75it/s] [2022-07-14 11:34:26,478] [ INFO] - Converting doccano data... 100%|██████████████████████████████████████████| 5/5 [00:00<00:00, 21754.69it/s] [2022-07-14 11:34:26,479] [ INFO] - Adding negative samples for first stage prompt... 100%|██████████████████████████████████████████| 5/5 [00:00<00:00, 44057.82it/s] [2022-07-14 11:34:26,479] [ INFO] - Converting doccano data... 100%|██████████████████████████████████████████| 5/5 [00:00<00:00, 26181.67it/s] [2022-07-14 11:34:26,480] [ INFO] - Adding negative samples for first stage prompt... 100%|██████████████████████████████████████████| 5/5 [00:00<00:00, 45689.59it/s] [2022-07-14 11:34:26,482] [ INFO] - Save 160 examples to ./data/train.txt. [2022-07-14 11:34:26,482] [ INFO] - Save 20 examples to ./data/dev.txt. [2022-07-14 11:34:26,482] [ INFO] - Save 20 examples to ./data/test.txt. [2022-07-14 11:34:26,482] [ INFO] - Finished! It takes 0.01 seconds

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

输出部分展示:

代码语言:txt

复制

{"content": "上海到北京机票1320元", "result_list": [{"text": "上海", "start": 0, "end": 2}], "prompt": "出发地"}

{"content": "上海到北京机票1320元", "result_list": [{"text": "北京", "start": 3, "end": 5}], "prompt": "目的地"}

{"content": "上海到北京机票1320元", "result_list": [{"text": "1320", "start": 7, "end": 11}], "prompt": "费用"}

{"content": "上海虹桥到杭州东站高铁g7555共73元时间是10月14日", "result_list": [{"text": "上海虹桥", "start": 0, "end": 4}], "prompt": "出发地"}

{"content": "上海虹桥到杭州东站高铁g7555共73元时间是10月14日", "result_list": [{"text": "杭州东站", "start": 5, "end": 9}], "prompt": "目的地"}

{"content": "上海虹桥到杭州东站高铁g7555共73元时间是10月14日", "result_list": [{"text": "73", "start": 17, "end": 19}], "prompt": "费用"}

{"content": "上海虹桥到杭州东站高铁g7555共73元时间是10月14日", "result_list": [{"text": "10月14日", "start": 23, "end": 29}], "prompt": "时间"}

{"content": "昨天晚上十点加班打车回家58元", "result_list": [{"text": "昨天晚上十点", "start": 0, "end": 6}], "prompt": "时间"}

{"content": "昨天晚上十点加班打车回家58元", "result_list": [{"text": "家", "start": 11, "end": 12}], "prompt": "目的地"}

{"content": "昨天晚上十点加班打车回家58元", "result_list": [{"text": "58", "start": 12, "end": 14}], "prompt": "费用"}

{"content": "2月20号从南山到光明二十元", "result_list": [{"text": "2月20号", "start": 0, "end": 5}], "prompt": "时间"}

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

2.模型训练

代码语言:python

复制

!python finetune.py \

--train_path "./data/train.txt" \

--dev_path "./data/dev.txt" \

--save_dir "./checkpoint" \

--learning_rate 1e-5 \

--batch_size 8 \

--max_seq_len 512 \

--num_epochs 100 \

--model "uie-base" \

--seed 1000 \

--logging_steps 10 \

--valid_steps 50 \

--device "gpu"

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

代码语言:python

复制

部分训练效果展示:**具体输出已折叠**

[2022-07-12 15:09:47,643] [ INFO] - global step 250, epoch: 13, loss: 0.00045, speed: 3.90 step/s

[2022-07-12 15:09:47,910] [ INFO] - Evaluation precision: 1.00000, recall: 1.00000, F1: 1.00000

[2022-07-12 15:09:50,399] [ INFO] - global step 260, epoch: 13, loss: 0.00043, speed: 4.02 step/s

[2022-07-12 15:09:52,966] [ INFO] - global step 270, epoch: 14, loss: 0.00042, speed: 3.90 step/s

[2022-07-12 15:09:55,464] [ INFO] - global step 280, epoch: 14, loss: 0.00040, speed: 4.00 step/s

[2022-07-12 15:09:58,028] [ INFO] - global step 290, epoch: 15, loss: 0.00039, speed: 3.90 step/s

[2022-07-12 15:10:00,516] [ INFO] - global step 300, epoch: 15, loss: 0.00038, speed: 4.02 step/s

[2022-07-12 15:10:00,781] [ INFO] - Evaluation precision: 1.00000, recall: 1.00000, F1: 1.00000

[2022-07-12 15:10:03,348] [ INFO] - global step 310, epoch: 16, loss: 0.00036, speed: 3.90 step/s

[2022-07-12 15:10:05,836] [ INFO] - global step 320, epoch: 16, loss: 0.00035, speed: 4.02 step/s

[2022-07-12 15:10:08,393] [ INFO] - global step 330, epoch: 17, loss: 0.00034, speed: 3.91 step/s

[2022-07-12 15:10:10,888] [ INFO] - global step 340, epoch: 17, loss: 0.00033, speed: 4.01 step/s

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

代码语言:python

复制

推荐使用GPU环境,否则可能会内存溢出。CPU环境下,可以修改model为uie-tiny,适当调下batch_size。 增加准确率的话:--num_epochs 设置大点多训练训练 可配置参数说明: **train_path:** 训练集文件路径。 **dev_path:** 验证集文件路径。 **save_dir:** 模型存储路径,默认为./checkpoint。 **learning_rate:** 学习率,默认为1e-5。 **batch_size:** 批处理大小,请结合显存情况进行调整,若出现显存不足,请适当调低这一参数,默认为16。 **max_seq_len:** 文本最大切分长度,输入超过最大长度时会对输入文本进行自动切分,默认为512。 **num_epochs:** 训练轮数,默认为100。 **model** 选择模型,程序会基于选择的模型进行模型微调,可选有uie-base和uie-tiny,默认为uie-base。 **seed:** 随机种子,默认为1000. **logging_steps:** 日志打印的间隔steps数,默认10。 **valid_steps:** evaluate的间隔steps数,默认100。 **device:** 选用什么设备进行训练,可选cpu或gpu。

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

3模型评估

代码语言:python

复制

!python evaluate.py \

--model_path ./checkpoint/model_best \

--test_path ./data/test.txt \

--batch_size 16 \

--max_seq_len 512

- 1

- 2

- 3

- 4

- 5

代码语言:python

复制

[2022-07-11 13:41:23,831] [ INFO] - ----------------------------- [2022-07-11 13:41:23,831] [ INFO] - Class Name: all_classes [2022-07-11 13:41:23,832] [ INFO] - Evaluation Precision: 1.00000 | Recall: 1.00000 | F1: 1.00000 [2022-07-11 13:41:35,024] [ INFO] - ----------------------------- [2022-07-11 13:41:35,024] [ INFO] - Class Name: 出发地 [2022-07-11 13:41:35,024] [ INFO] - Evaluation Precision: 1.00000 | Recall: 1.00000 | F1: 1.00000 [2022-07-11 13:41:35,139] [ INFO] - ----------------------------- [2022-07-11 13:41:35,139] [ INFO] - Class Name: 目的地 [2022-07-11 13:41:35,139] [ INFO] - Evaluation Precision: 1.00000 | Recall: 1.00000 | F1: 1.00000 [2022-07-11 13:41:35,246] [ INFO] - ----------------------------- [2022-07-11 13:41:35,246] [ INFO] - Class Name: 费用 [2022-07-11 13:41:35,246] [ INFO] - Evaluation Precision: 1.00000 | Recall: 1.00000 | F1: 1.00000 [2022-07-11 13:41:35,313] [ INFO] - ----------------------------- [2022-07-11 13:41:35,313] [ INFO] - Class Name: 时间 [2022-07-11 13:41:35,313] [ INFO] - Evaluation Precision: 1.00000 | Recall: 1.00000 | F1: 1.00000

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

model_path: 进行评估的模型文件夹路径,路径下需包含模型权重文件model_state.pdparams及配置文件model_config.json。

test_path: 进行评估的测试集文件。

batch_size: 批处理大小,请结合机器情况进行调整,默认为16。

max_seq_len: 文本最大切分长度,输入超过最大长度时会对输入文本进行自动切分,默认为512。

model: 选择所使用的模型,可选有uie-base, uie-medium, uie-mini, uie-micro和uie-nano,默认为uie-base。

debug: 是否开启debug模式对每个正例类别分别进行评估,该模式仅用于模型调试,默认关闭。

4 结果预测

代码语言:python

复制

from pprint import pprint import json from paddlenlp import Taskflow def openreadtxt(file_name): data = [] file = open(file_name,'r',encoding='UTF-8') #打开文件 file_data = file.readlines() #读取所有行 for row in file_data: data.append(row) #将每行数据插入data中 return data data_input=openreadtxt('./input/nlp.txt') schema = ['出发地', '目的地','时间'] few_ie = Taskflow('information_extraction', schema=schema, batch_size=1,task_path='./checkpoint/model_best') results=few_ie(data_input) with open("./output/test.txt", "w+",encoding='UTF-8') as f: #a : 写入文件,若文件不存在则会先创建再写入,但不会覆盖原文件,而是追加在文件末尾 for result in results: line = json.dumps(result, ensure_ascii=False) #对中文默认使用的ascii编码.想输出真正的中文需要指定ensure_ascii=False f.write(line + "\n") print("数据结果已导出")

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

输入文件展示:

代码语言:txt

复制

城市内交通费7月5日金额114广州至佛山

从百度大厦到龙泽苑东区打车费二十元

上海虹桥高铁到杭州时间是9月24日费用是73元

上周末坐动车从北京到上海花费五十块五毛

昨天北京飞上海话费一百元

- 1

- 2

- 3

- 4

- 5

输出展示:

代码语言:txt

复制

{"出发地": [{"text": "广州", "start": 15, "end": 17, "probability": 0.9073772252165782}], "目的地": [{"text": "佛山", "start": 18, "end": 20, "probability": 0.9927365183877761}], "时间": [{"text": "7月5日", "start": 6, "end": 10, "probability": 0.9978010396512218}]}

{"出发地": [{"text": "百度大厦", "start": 1, "end": 5, "probability": 0.968825147409472}], "目的地": [{"text": "龙泽苑东区", "start": 6, "end": 11, "probability": 0.9877913072493669}]}

{"目的地": [{"text": "杭州", "start": 7, "end": 9, "probability": 0.9929172180094881}], "时间": [{"text": "9月24日", "start": 12, "end": 17, "probability": 0.9953342057701597}]}

{"出发地": [{"text": "北京", "start": 7, "end": 9, "probability": 0.973048366717471}], "目的地": [{"text": "上海", "start": 10, "end": 12, "probability": 0.988486130309397}], "时间": [{"text": "上周末", "start": 0, "end": 3, "probability": 0.9977407699595275}]}

{"出发地": [{"text": "北京", "start": 2, "end": 4, "probability": 0.974188953533556}], "目的地": [{"text": "上海", "start": 5, "end": 7, "probability": 0.9928200521486445}], "时间": [{"text": "昨天", "start": 0, "end": 2, "probability": 0.9731559534465504}]}

- 1

- 2

- 3

- 4

- 5

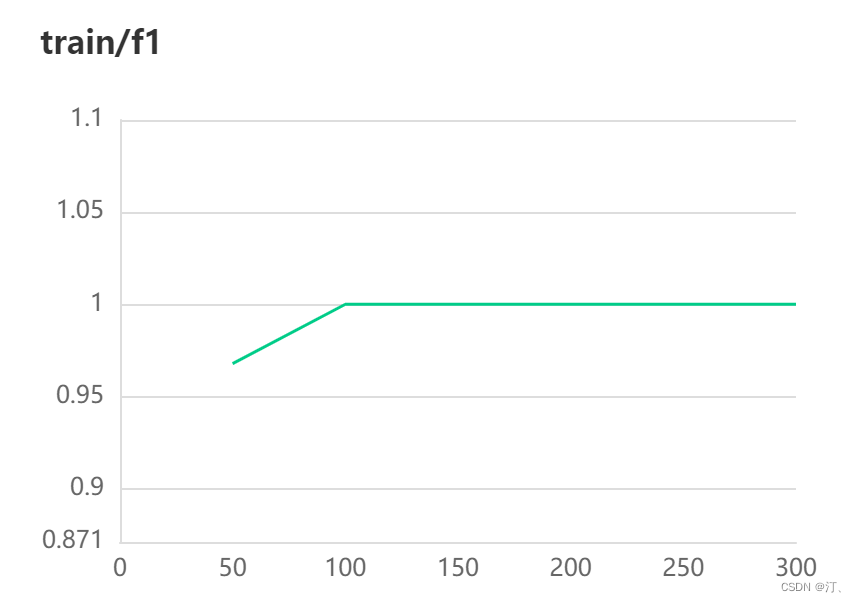

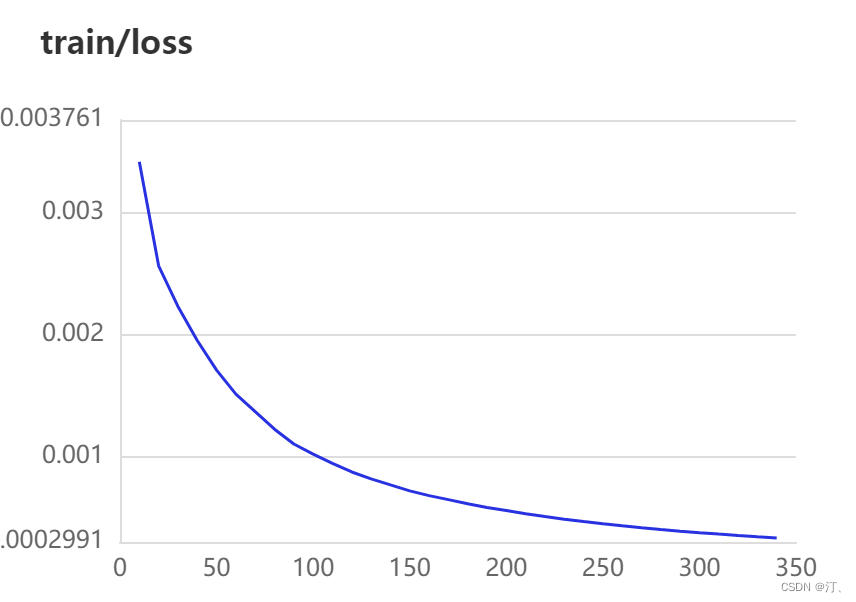

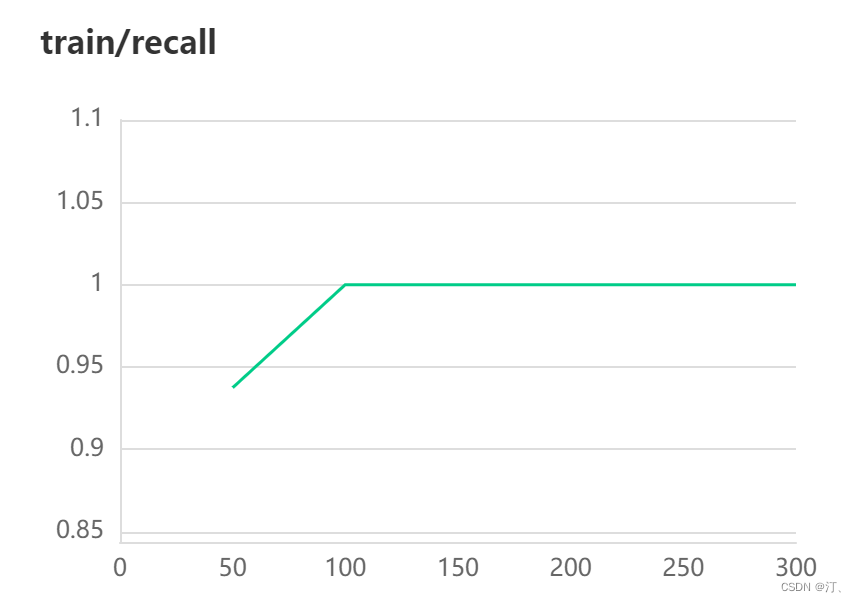

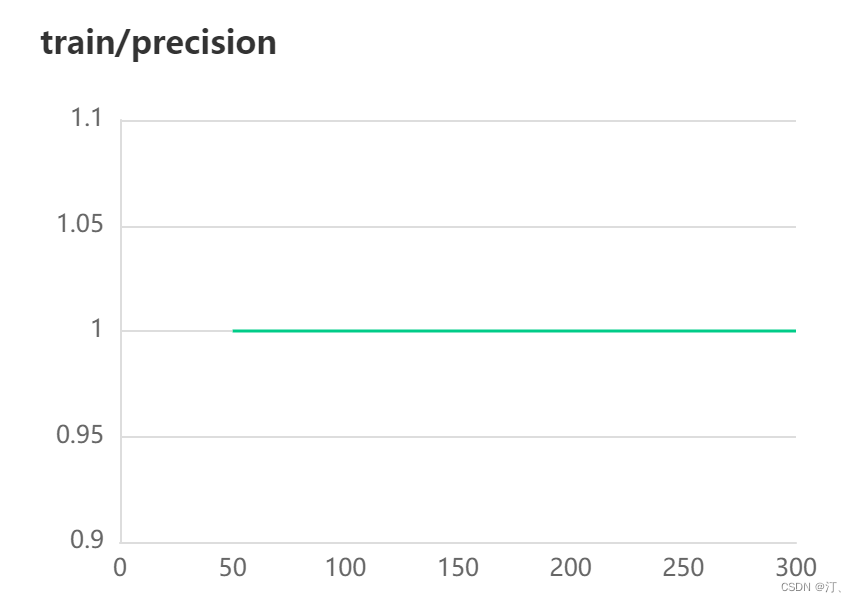

5.可视化显示visualDL

详细文档可以参考:

https://aistudio.baidu.com/aistudio/projectdetail/1739945?contributionType=1

有详细讲解,具体实现参考代码,

核心是:添加一个初始化记录器

下面是结果展示:

在这里插入图片描述

在这里插入图片描述

在这里插入图片描述

在这里插入图片描述

6.小技巧:获取paddle开源数据集

数据集网站:https://paddlenlp.readthedocs.io/zh/latest/data_prepare/dataset_list.html#id2

数据集名称 简介 调用方法

CoLA 单句分类任务,二分类,判断句子是否合法 paddlenlp.datasets.load_dataset(‘glue’,‘cola’)

SST-2 单句分类任务,二分类,判断句子情感极性

paddlenlp.datasets.load_dataset(‘glue’,‘sst-2’)

MRPC 句对匹配任务,二分类,判断句子对是否是相同意思 paddlenlp.datasets.load_dataset(‘glue’,‘mrpc’)

STSB 计算句子对相似性,分数为1~5 paddlenlp.datasets.load_dataset(‘glue’,‘sts-b’)

QQP 判定句子对是否等效,等效、不等效两种情况,二分类任务 paddlenlp.datasets.load_dataset(‘glue’,‘qqp’)

MNLI 句子对,一个前提,一个是假设。前提和假设的关系有三种情况:蕴含(entailment),矛盾(contradiction),中立(neutral)。句子对三分类问题 paddlenlp.datasets.load_dataset(‘glue’,‘mnli’)

QNLI 判断问题(question)和句子(sentence)是否蕴含,蕴含和不蕴含,二分类 paddlenlp.datasets.load_dataset(‘glue’,‘qnli’)

RTE 判断句对是否蕴含,句子1和句子2是否互为蕴含,二分类任务 paddlenlp.datasets.load_dataset(‘glue’,‘rte’)

WNLI 判断句子对是否相关,相关或不相关,二分类任务 paddlenlp.datasets.load_dataset(‘glue’,‘wnli’)

LCQMC A Large-scale Chinese Question Matching Corpus 语义匹配数据集 paddlenlp.datasets.load_dataset(‘lcqmc’)

通过paddlenlp提供的api调用,可以很方便实现数据加载,当然你想要把数据下载到本地,可以参考我下面的输出就可以保存数据了。

代码语言:python

复制

#加载中文评论情感分析语料数据集ChnSentiCorp

from paddlenlp.datasets import load_dataset

train_ds, dev_ds, test_ds = load_dataset("chnsenticorp", splits=["train", "dev", "test"])

with open("./output/test2.txt", "w+",encoding='UTF-8') as f: #a : 写入文件,若文件不存在则会先创建再写入,但不会覆盖原文件,而是追加在文件末尾

for result in test_ds:

line = json.dumps(result, ensure_ascii=False) #对中文默认使用的ascii编码.想输出真正的中文需要指定ensure_ascii=False

f.write(line + "\n")

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

7 总结

UIE(Universal Information Extraction):Yaojie Lu等人在ACL-2022中提出了通用信息抽取统一框架UIE。该框架实现了实体抽取、关系抽取、事件抽取、情感分析等任务的统一建模,并使得不同任务间具备良好的迁移和泛化能力。PaddleNLP借鉴该论文的方法,基于ERNIE 3.0知识增强预训练模型,训练并开源了首个中文通用信息抽取模型UIE。该模型可以支持不限定行业领域和抽取目标的关键信息抽取,实现零样本快速冷启动,并具备优秀的小样本微调能力,快速适配特定的抽取目标。

UIE的优势

使用简单: 用户可以使用自然语言自定义抽取目标,无需训练即可统一抽取输入文本中的对应信息。实现开箱即用,并满足各类信息抽取需求。

降本增效: 以往的信息抽取技术需要大量标注数据才能保证信息抽取的效果,为了提高开发过程中的开发效率,减少不必要的重复工作时间,开放域信息抽取可以实现零样本(zero-shot)或者少样本(few-shot)抽取,大幅度降低标注数据依赖,在降低成本的同时,还提升了效果。

效果领先: 开放域信息抽取在多种场景,多种任务上,均有不俗的表现。

本人本次主要通过实体抽取这个案例分享给大家,主要对开源的paddlenlp的案例进行了细化,比如在结果可视化方面以及结果输入输出的增加,使demo项目更佳完善。

当然标注问题是所有问题的痛点,可以参考我的博客来解决这个问题

如何系统的去学习大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。